探讨机器学习与深度学习基本概念与运算过程

描述

人工智慧、机器学习以及深度学习已变成现今最热门的话题之一,但以字面上的意思不足以清楚的表达其意义,使得人们常常混淆。以下这篇文章将带领各位理解其定义,并且简单的探讨机器学习与深度学习基本概念与运算过程。

一、人工智慧(Artificial Intelligence) :

所谓的人工智慧(Artificial Intelligence) 是人类建立于机器上的类似大脑智慧的一种判断机制。其目的以编写程式的方式,模拟出人类大脑中的决策,并模仿、理解、学习等等特性,而形成类似人类的「智慧」。其中利用大量的硬体设备作为资讯来源作为讯息的接收,举例以镜头串流影像作为人眼、以麦克风收集声音作为耳朵等等。

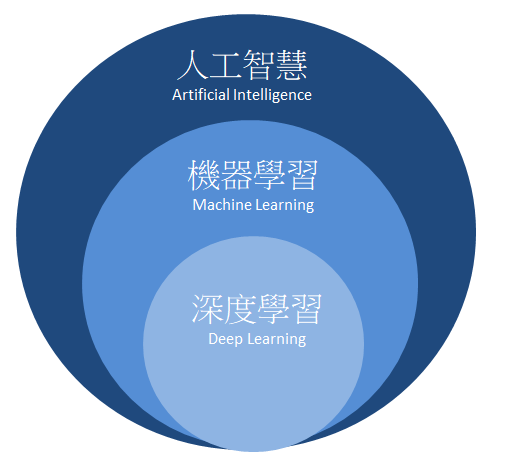

人工智慧隶属于大範畴,包含了机器学习(Machine Learning) 与深度学习(Deep Learning)。如下图所示,我们最兴趣的深度学习则是规範于机器学习之中的一项分支,而以下段落将简单介绍机器学习与深度学习的差异。

二、机器学习(Machine Learning):

机器学习是一种透过演算法设计,让机器去寻求最佳化的一种学科。能帮助人们探讨一些复杂的问题,比如需要从一大堆数据资料判断猫与狗时,从前人们必须利用过往的实验经验反覆地找出判断规则或是最佳的判断机制。而透过机器学习方式则提供许多有效率的演算法,帮助人们分析资料,比如说资料群聚分布,资料的回归模型等等,将资料送至机器上进行演算找出最好的解答或是模型。以下将介绍机器学习的类别:

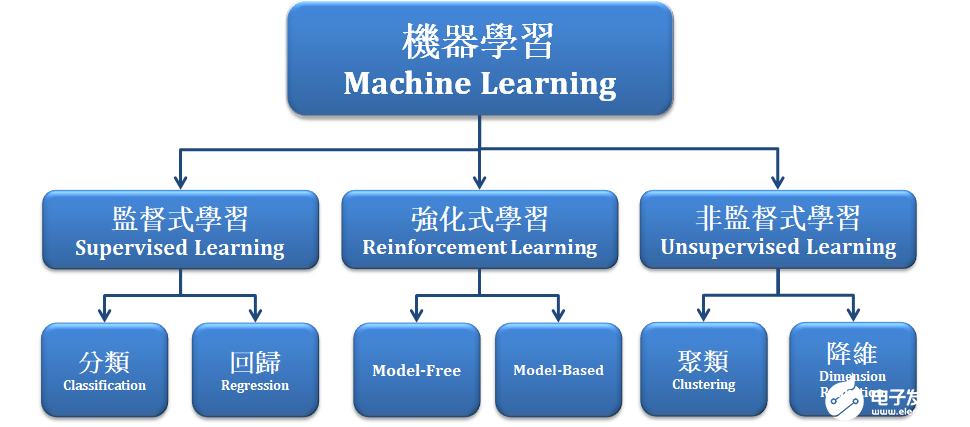

机器学习主要可分类成

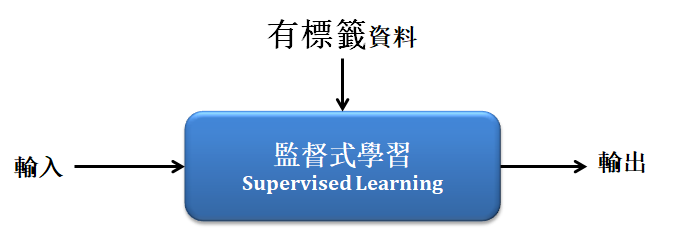

1. 监督式学习 :

须将每笔资料标记上一个「标籤」,比如是与非回答、狗与猫、苹果与橘子,利用大量已知标籤资讯与资料训练的方式建立出一个分类器(Classifier)或称模型(Model)。除了资料分类,监督式学习亦包含回 归分析(Regression)算法。最具代表的算法有 Adaboost 、SVM 、Neural Network 等等。

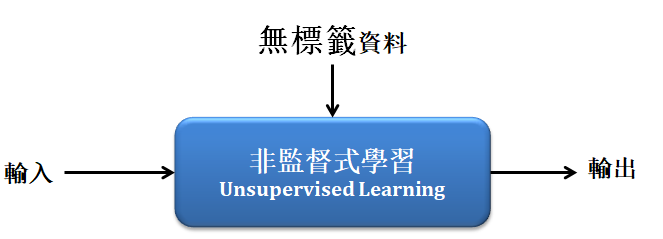

非监督式学习 :

「无须标记标籤」于每笔资料,常以资料的分布状况去建立一个分类器。除了聚类分类(clustering),非监督式学习亦包含降低维度(dimensionality reduce)以及关联规则( association rule)等演算法。 最具代表的算法有 Kmean 、PCA 等等。

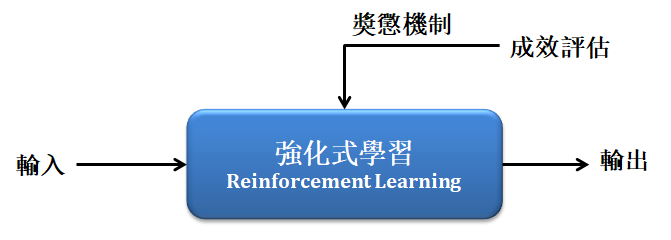

强化式学习 :

则是「不需给机器任何资料」,让机器不断从互动中学习,并利用奖惩与成效评估的机制,不断尝试与修正至最佳化的模型。最具代表的算法有 Q-Learning 、SARSA 等等。

近年来深度学习的基础皆来至于类神经网路的演算法,以下先简单介绍此算法。

类神经网路(Neural Network):

近年回归于热门的就是类神经网路(Neural Network),起源1943年于 沃伦·麦卡洛克 和 沃尔特·皮茨 为一种阈值逻辑的演算法。因为利用数个节点进行判断,很像人类的神经元故以神经网路而命名。然而此算法运算量颇大,当时又缺乏硬体设备,造成神经网路的发展受到侷限,且当时支撑向量机(SVM)正受到学界关注,故类神经网路不受青睐。

时间线回到现今,因有充足的硬体设备使得神经网路重新受到瞩目,竟而发展出 RNN 递迴神经网路、 LSTM 长短时记忆网路、 RBF 神经网路等等算法,我们所认知的卷积神经网路(CNN)也是从中发展而来,其中类神经网路最具代表性的设计为反向传递的机制 ,经由不断迭代,对比预测值与实际值之间的误差,以修正模组中的权重,竟而达到最佳化之目的,以下将简单介绍类神经网路(NN)的算法。

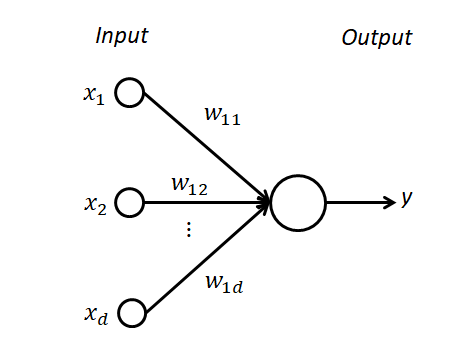

探讨架构之前须理解感知器(Perceptron),而所谓的感知器可想像为人类大脑中的每一个神经元,我们透过这些神经网的传递与讯号,给我们做出正确的判断。如下图所示,我们可将资料作为 x1 至 xd 并代入权重相加计算,得到一个评分数值 y,藉由这个数值去判断是与否、狗与猫等等二元分类的答案。

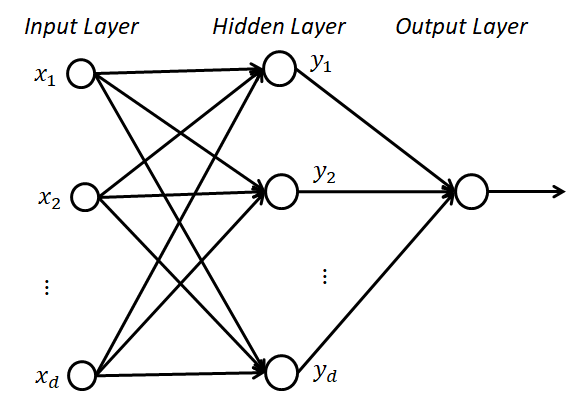

回到类神经网路可以说是一种多层的感知器模型,可以想像成数个神经元(感知器)所构成的复杂网路。最基础神经网路架构可分作输入层、隐藏层、输出层,如下图所示:

而透过大量的资料训练以及反向传播的机制,不断误差修正各个感知器的权重,因此可以清楚地反映资料分布,竟可能找出最佳化真实模型。训练资料的方式常以是数张图片,以同样规格尺寸与特徵进行训练与分类。虽然神经网路可以很好的反应出最佳化模型,但直接代入图片至类神经网路进行训练并不能获得一个很好的模型,其状况是因为构成良好的模组之前须带入有效的特徵数据或是良好的特徵撷取,才能获得较佳的模型。

叁、深度学习(Deep Learning)

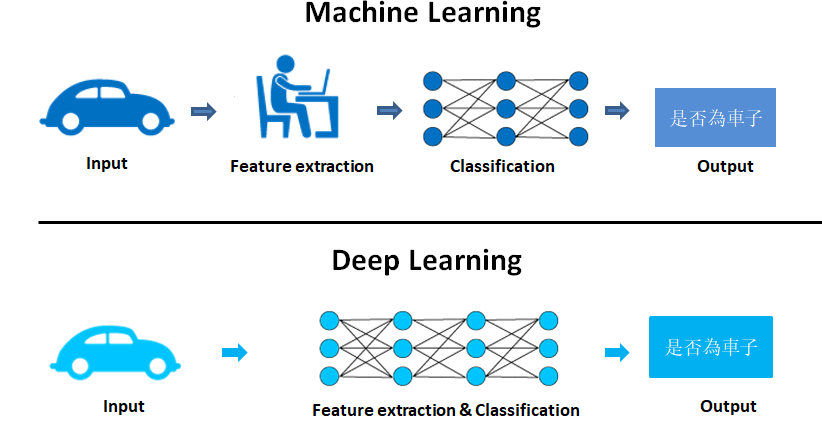

对于有效的特徵数据一直都是机器学习中一个较深论的课题,近年来深度学习出现简化这项问题, 直接打破上述这些思维。所谓的深度学习与机器学习最大的差异,就是输入端的特徵提取!! 而深度学习将会透过卷积的方式,取代了特徵提取这个环节,如下图说明机器学习与深度学习的主要差异。

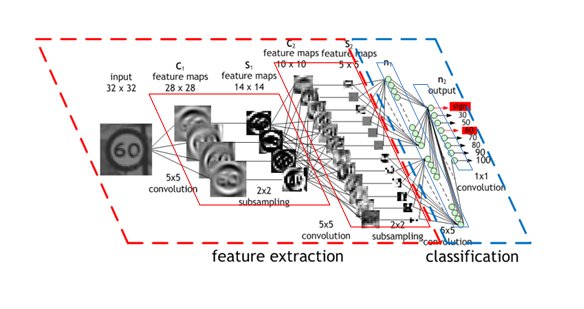

卷积神经网路(Convolutional Neural Network, CNN ),为具代表性的深度学习算法之一,是由类神经网路演化而来。 如下图所示,此算法透过卷积(Convolution)的方式,对图片进行特徵提取(feature extraction),其中卷积的遮罩係数则是随机产生的。透过卷积滤波器产生的特徵,送至分类器(Classification)进行分类即为卷积神经网路。

(此图出处于参考文献)

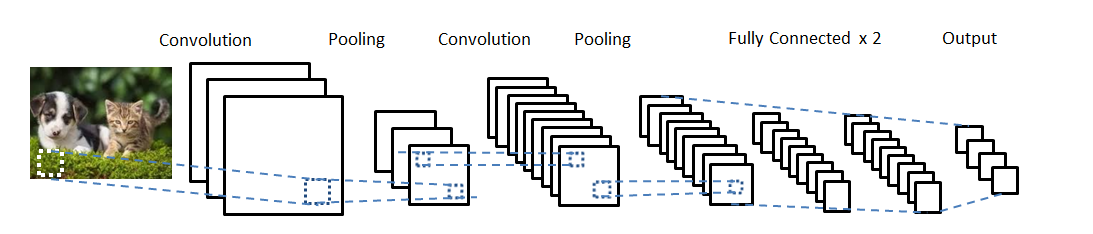

卷积神经网路(CNN)主要可分为

卷积层(convolution layer):利用随机产生的遮罩进行特徵提取。

池化层(pooling layer):对不同位置的特徵进行统计,并取平均值或最大值作为最佳参考点,以减少资料特徵维度。

全连接层(fully connected layer):是将之前的卷积与池化后之结果进行平坦化,并接到最基本的神经网络。

透过上述所介绍的主要的叁个层,即可完成一个CNN架构,如下图所示为最典型的CNN架构。

透过深度学习的方式,简单的将提取到有效的特徵。尽而逼近最佳模型。因此近年来有许多学术专家对 CNN 架构进行研究并举办比赛,目前较热门的 CNN 模型有 LeNet、VGG、ResNet 等等,并经由研究得知只要架构的深度够深,对于模型的準确度越高,故而称为深度学习。

-

深度学习与数据挖掘的关系2018-07-04 0

-

人工智能基本概念机器学习算法2021-09-06 0

-

什么是机器学习_十张图带你解析机器学习的基本概念2018-06-30 3382

-

人工智能、机器学习、深度学习三者关系分析2018-01-04 4327

-

深度学习算法背后的数学2018-06-01 8082

-

机器学习算法基本概念及选用指南2019-01-15 2458

-

从概念和特点上阐述机器学习和深度学习的关系2019-01-24 5335

-

机器学习与人工智能和深度学习有什么关系?2021-01-12 3868

-

从五个方面详谈机器学习和深度学习的区别2021-03-01 15890

-

机器学习和深度学习有什么区别?2021-03-12 7873

-

深度学习基本概念2023-08-17 1188

-

机器学习和深度学习的区别2023-08-17 3419

-

OpenCV库在图像处理和深度学习中的应用2023-08-18 509

-

深度学习和机器学习的定义和优缺点 深度学习和机器学习的区别2023-08-21 2200

全部0条评论

快来发表一下你的评论吧 !