NLP:现有联合抽取工作的不足之处

描述

这是一篇关于实体关系联合抽取的工作。关于现有的联合抽取工作,作者提出了两点不足之处:

Feature Confusiong: 用于同样的特征表示进行NER和RE(关系分类)两项任务,可能会对模型的学习造成误解;

现有的基于Table-Filling方法去完成联合抽取的工作,会将表结构转化成一个序列结构,这样导致丢失了重要的结构信息。

因此本文的工作有以下特点:

针对NER和RE,分别学习出不同的序列表示(sequence representations)和表格表示(table representations); 这两种表示能分别捕获任务相关的信息,同时作者还涉及了一种机制使他们彼此交互;

保持表格的结构,通过神经网络结构来捕捉二维表格中的结构信息;同时,引入BERT中的attention权重,进行表格中元素表示的学习。

模型的核心部分包括以下模块:

Text Embedding: 对于一个输入的包含n个words的句子,其词向量、字符向量和BERT词向量的共同构成了每个word的表示。

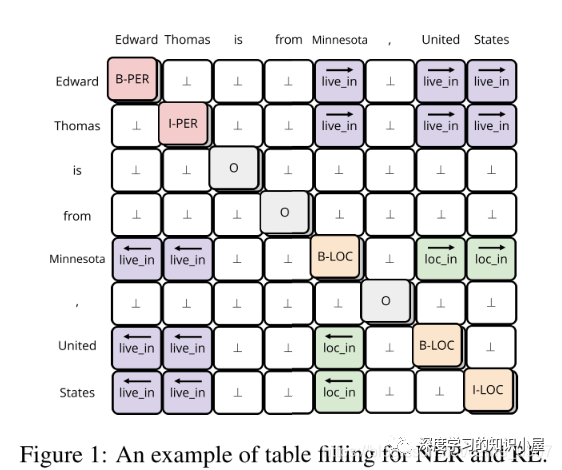

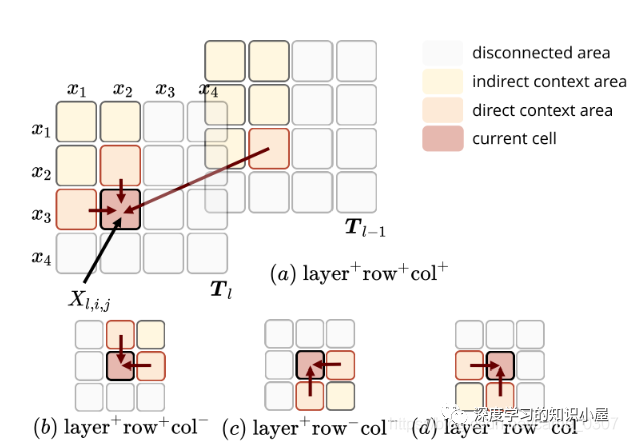

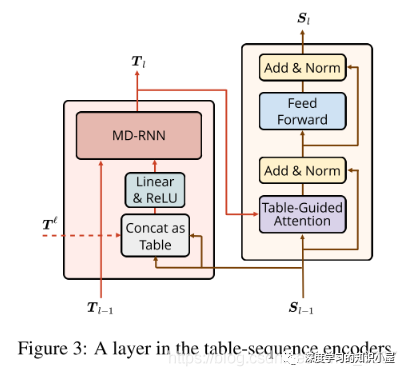

Table Encoder: 目标在于学出 N×N 表格下的向量表示,表格第i行第j列的向量表示,与句子中的第i个和第j个词相对应,如Figure1所示。文中使用基于GRU结构的MD-RNN(多维RNN)作为Text Encoder,在更新表格中当前cell的信息时,通过MDRNN融合其上下左右四个方向上的信息,从而利用了表格的结构特点;同时引入当前cell所对应的两个词在Sequence Encoder下的表示,使得Table Encoder和Sequence Encoder之间发生信息的交流;

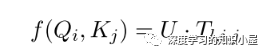

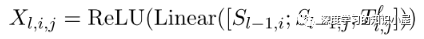

Sequence Encoder: Sequence Encoder的结构与Transformer类似,不同之处在于将Transformer中的scaled dot-product attention 替换为文中提出的 table-guided attention。具体地,将Transformer中计算Q,K之间分值的过程直接替换为对应两个word在table中对应的向量:

由于 T_ij 融合了四个方向上的信息,能够更加充分的捕捉上下文信息以及词与词之间的关系,同时也使Table Encoder和Sequence Encoder之间产生了双向的信息交流。

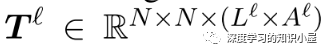

Exploit Pre-trained Attention Weights: Text Embeddings部分有用到BERT,因此将BERT中各个层上多头attention每个头上的atention权重堆叠起来,得到张量T l ∈ R N × N × ( L l × A l ) T^{l} in mathbb{R}^{N imes N imes (L^l imes A^l)} T和 Text Embedding中每个词的表示,来构成Table的初始输入:

作者通过在不同数据集上的实验证明了模型的有效性,并通过消融实验进行了相关的分析。

责任编辑:xj

原文标题:【EMNLP2020】用填表的方式进行实体关系联合抽取

文章出处:【微信公众号:深度学习自然语言处理】欢迎添加关注!文章转载请注明出处。

-

【mbot试用体验】mbot不足之处及建议2016-04-12 0

-

分析我国仪器仪表产品的不足之处2017-07-10 0

-

全面拥抱Transformer:NLP三大特征抽取器(CNNRNNTF)比较2020-05-29 0

-

与以往的压缩标准相比,JPEG2000标准有什么优点和不足之处?2021-04-06 0

-

请问分立式电阻、滤波、交流共模抑制和高噪声增益有什么不足之处?2021-04-13 0

-

物联网存在哪些不足之处?2021-05-19 0

-

RS-232-C接口有哪些不足之处?2022-02-16 0

-

现有的网络方案及不足之处2017-02-09 160

-

红米Note4X怎么样?唯一的不足之处就是外观2017-03-07 12065

-

小米6评测:上手小米6将近5天,你不知道的BUG!神机也有不足之处2017-05-02 9190

-

智能家居目前的不足之处2018-03-28 10430

-

区块链的优势可以弥补中心化游戏产业的不足之处2018-12-03 751

-

如何解决企业物联网身份管理的一些不足之处2019-07-08 743

-

模型NLP事件抽取方法总结2020-12-31 9738

-

如何弥补现有MRAM的不足之处2021-03-03 595

全部0条评论

快来发表一下你的评论吧 !