RLAIF:一个不依赖人工的RLHF替代方案

描述

LLM可以标记人类偏好数据,用于强化学习吗?尽管之前有一些类似的研究,但从没有人系统地对比RLHF和RLAIF的性能。今天,我们为大家带来一项Google最新的研究,来看看LLM是否懂得人类的偏好。

基于人类反馈的强化学习(RLHF)通过收集人类反馈,以强化学习方法训练LLM,可以更好地理解人类偏好。然而,这个方法有一个很大的问题:收集高质量的人类反馈非常困难和耗时。

那有没有更好的方法呢?

RLAIF方法

RLAIF即Reinforcement learning from AI feedback。顾名思义,RLAIF是指使用LLM来代替人类标记偏好,基于这些标记数据训练奖励模型,然后进行RL微调。

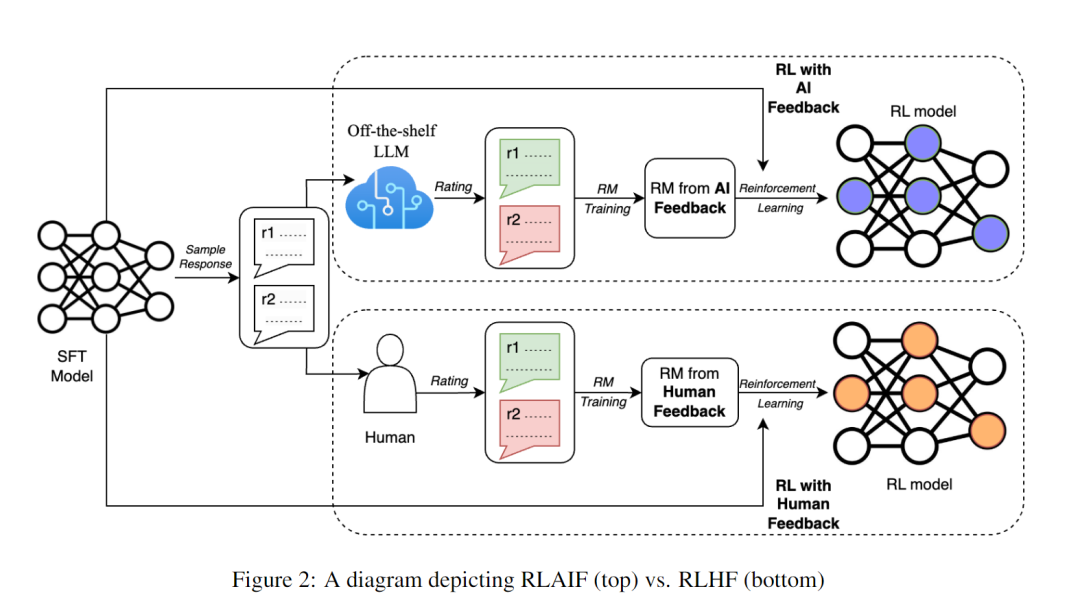

下图是一个展示了RLAIF(上)和RLHF(下)的基本流程。

如图所示,在RLAIF中,首先使用LLM来评估给定的文本和2个候选回复,然后,这些由LLM生成的偏好数据被用来训练一个奖励模型,这个奖励模型用于强化学习,以便进一步优化LLM。

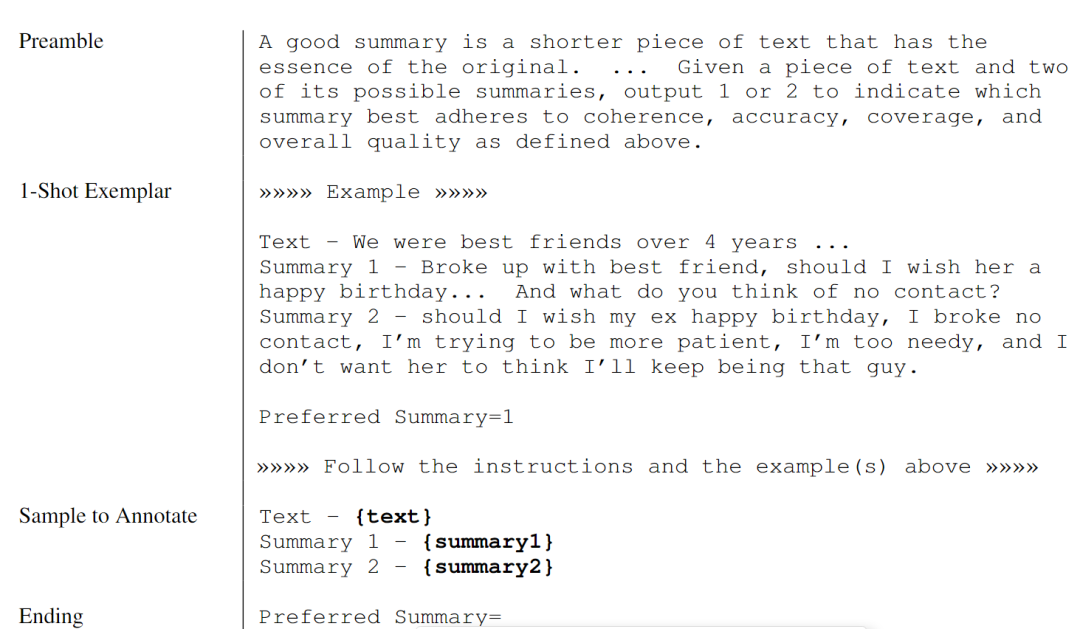

一个LLM用于评估回复的prompt示例如下图,遵循以下流程:

Preamble-描述任务介绍和说明

Few-shot exemplars(可选)

Sample to annotate

结束字符串

在这篇研究中,作者还探索了:

避免位置偏差: 候选回复喂给LLM的顺序可能会偏向它喜欢的候选顺序,尤其是在 LLM 参数较小的情况下。为了减轻位置偏差的影响,作者进行了双重推理和平均处理。

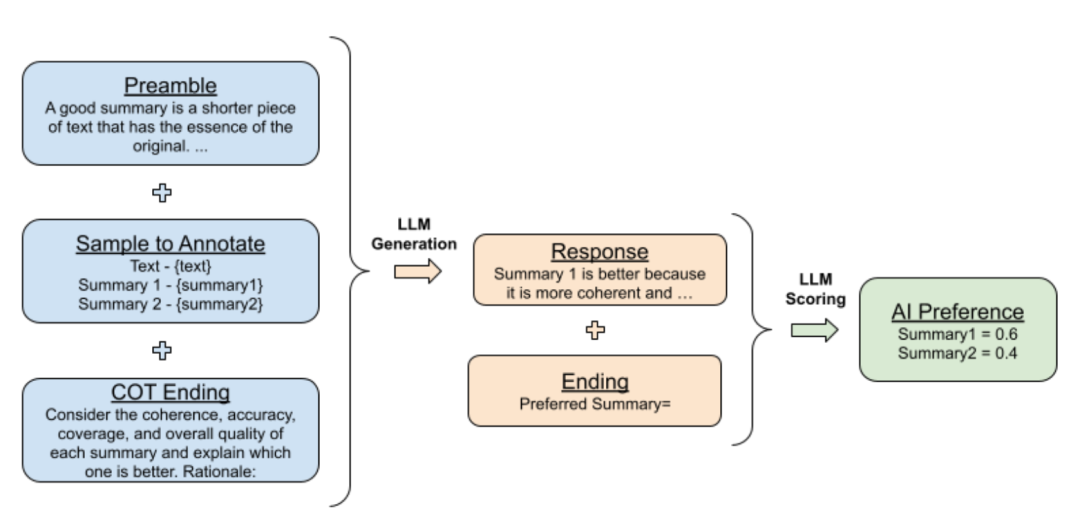

prompt改进: 还尝试了使用思维链(CoT)推理和self-consistency等方法促进LLM的评估。

实验结果

作者使用PaLM 2 Extra-Small(XS)在OpenAI的过滤过的TL;DR数据集上训练了一个SFT模型作为baseline。

对于RLHF方法,奖励模型在OpenAI的TL;DR人类偏好数据集上进行训练。

对于RLAIF方法,使用PaLM 2 L生成AI标记的偏好

对于强化学习,使用A2C训练策略。策略和价值模型都是从SFT模型初始化的。

实验主要有以下发现:

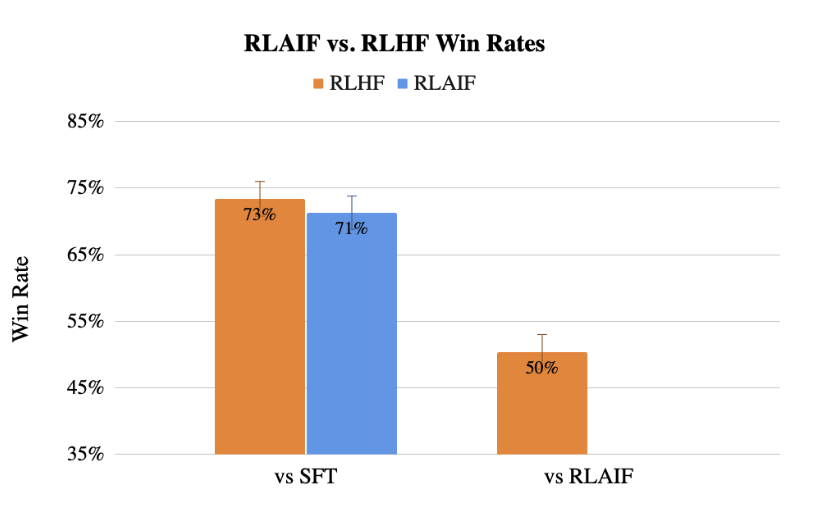

在性能方面:RLAIF与RLHF有相似的表现。

在人类评估上,与SFT策略相比,RLAIF被偏好71%的时间,而RLHF则被偏好73%的时间。尽管RLHF略微优于RLAIF,但这个差异在统计上并不显著。

直接对比胜率:RLAIF与RLHF在被偏好的程度上是平等的,胜率都是50%。

与人工写的摘要比较:RLAIF和RLHF生成的摘要分别在79%和80%的时间内被更偏好,与参考摘要的差异也不具统计意义。

影响因素:RLAIF和RLHF策略倾向于生成比SFT策略更长的摘要,这可能是质量提升的一个因素。

长度调整后表现:即使控制摘要的长度,RLAIF和RLHF都依然在同样的幅度内优于SFT策略。

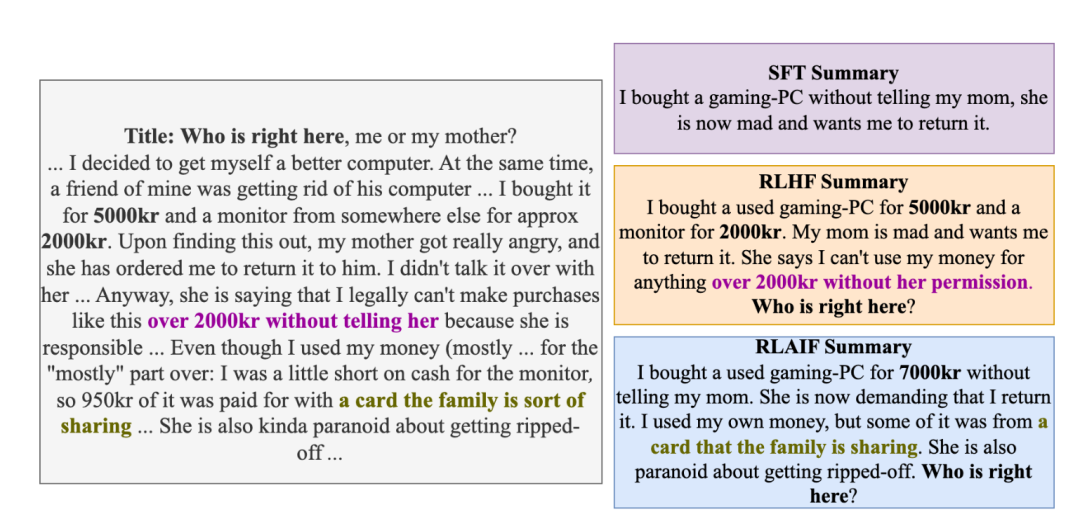

下图是SFT,RLHF和RLAIF策略生成的示例摘要。RLHF和RLAIF 比SFT产生更高质量的摘要。

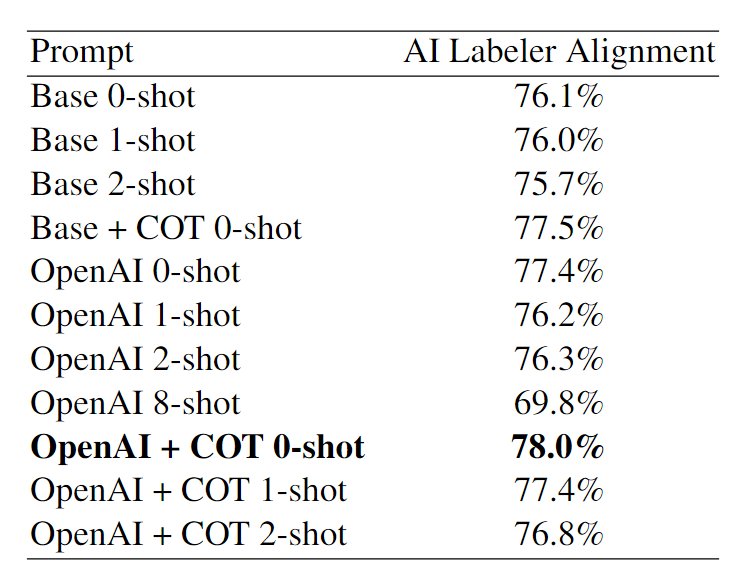

对于prompt方式,使用详细的OpenAI preamble和CoT给出了最高的对齐性能。少样本提示并没有提高准确性,甚至可能使它变得更糟。

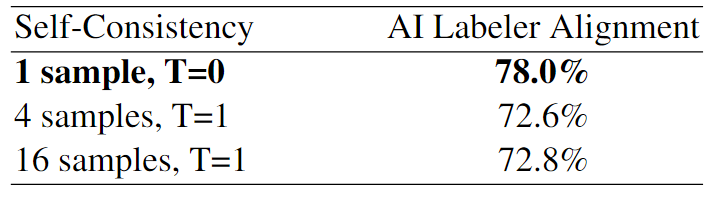

Self-Consistency with CoT对性能的影响如下,用T=1采样会导致与人类偏好的一致性较低。

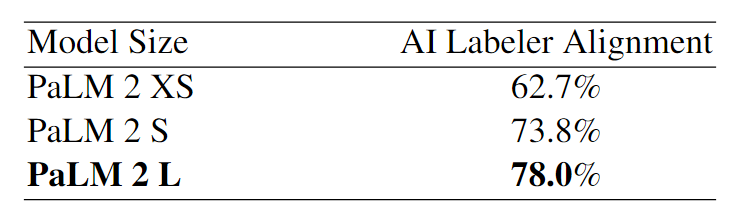

作者还对用于评估的LLM的参数大小进行了探索,发现与人类偏好的一致性随着LLM大小的增加而增加。

总结

这项工作似乎暗示RLAIF是一个不依赖于人工标注的、与RLHF可行的替代方案。但是,为了更好地了解这些发现是否能推广到其他NLP任务,还需要在更广泛的任务范围内进行实验。

-

SILABS CP2103芯片是否不依赖于我错过的微/ picoblaze处理器?2019-07-23 0

-

一种不依赖于棋盘格等辅助标定物体实现像素级相机和激光雷达自动标定的方法2021-09-01 0

-

一个新的Ad hoc安全组密钥管理方案2009-05-25 713

-

飞兆半导体智能高侧开关提供可靠解决方案替代分立设计2012-05-04 707

-

据调查64%的人表示:日常生活中不依赖物联网设备2018-10-27 1744

-

量子技术革GPS的命:不依赖卫星就可以进行导航2018-11-19 286

-

PHP简单实现不依赖于Unix系统Cron的定时任务程序资料说明2019-03-01 589

-

INS是一种不依赖于外部信息的自主式导航系统2020-06-08 2126

-

一个种不依赖昂贵检测设备的偏置电流测试方法2020-09-30 2705

-

以色列成立新研究中心,开发不依赖GPS的导航系统2021-04-12 1741

-

智行者发布国内首款不依赖高精地图的高级别自动驾驶解决方案2022-08-19 2265

全部0条评论

快来发表一下你的评论吧 !