在MPU上实现AI模型的迁移与应用流程

嵌入式技术

1333人已加入

描述

如今的MPU已不再是以前MPU了,性能是越来越强,用它来跑简单的系统有点“大材小用”了。

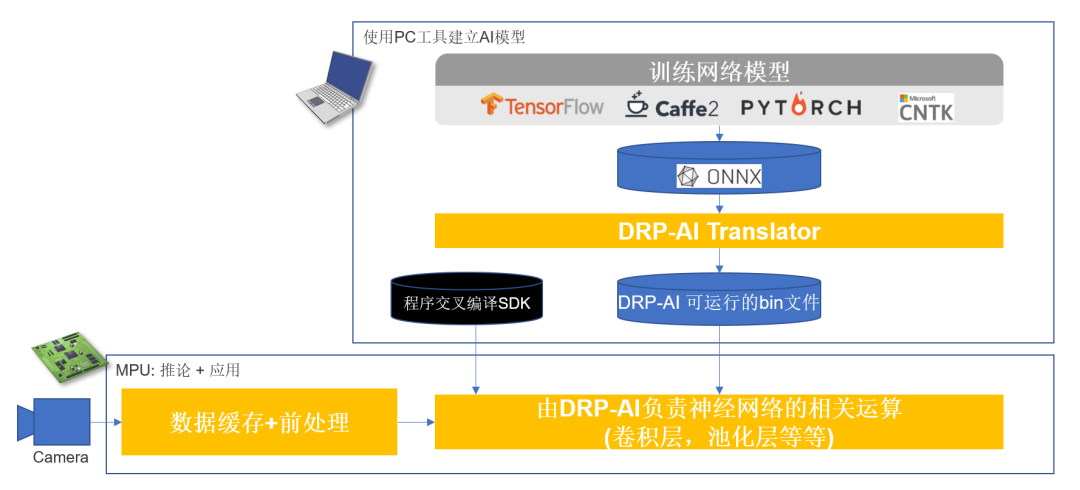

今天结合瑞萨的RZ/V系列MPU,给大家讲讲嵌入式端推理应用的完整流程,如下图所示:

官方EVK会提供算法样例相关的资料,包括如下内容:

● 服务器(电脑)端模型训练程序源代码。

● 模型转换脚本程序(用于把训练的模型转换成onnx格式模型)

● DRP-AI Translator转换工具

● BSP源码文件

● 交叉编译环境SDK

● RZ/V系列EVK推理样例的源代码

具体流程

1、模型训练的程序和模型转换脚本程序,可根据自己的需要在个人电脑或服务器上进行环境搭建和应用。

2、DRP-AI Translator转换工具安装,如下:

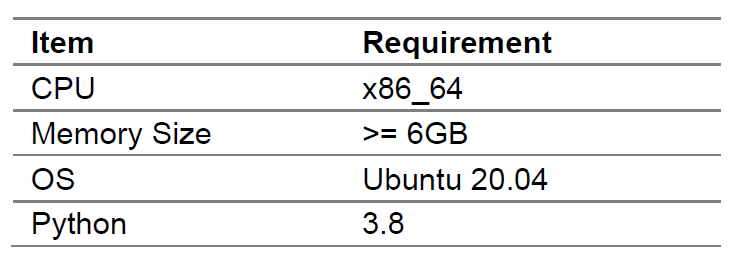

1) DRP-AI Translator安装需要的环境

2) DRP-AI Translator安装步骤

按以下步骤启动DRP-AI Translator包:

$ sudo apt-get update $ sudo apt-get install -y libgl1-mesa-dev wget libopencv-dev $ sudo apt-get install -y python3-pip $ pip3 install -U pip $ chmod +x DRP-AI_Translator-v1.83-Linux-x86_64-Install $ ./DRP-AI_Translator-v1.83-Linux-x86_64-Install

以交互方式继续安装。输入“Enter”或“y”继续。

This installer will guide you through the installation of DRP-AI Translator. Continue? [n/Y] y

显示安装进度条后,会提示安装完成,如下:

Installing DRP-AI_Translator... Installing Program Files... Installation complete.

当前目录下会生成如下目录结构:

$ tree -L 2 drp-ai_translator_release drp-ai_translator_release/ ├── DRP-AI_translator │ ├── api_translator │ ├── availability_checker │ ├── converter │ ├── drp_converter │ ├── drplib │ └── python_api ├── UserConfig │ ├── sample │ └── sample_scripts ├── onnx │ ├── (resnet50v1.onnx) (Can be automatically downloaded) │ ├── tiny_yolov2.onnx │ ├── (vgg16.onnx) (Can be automatically downloaded) │ └── yolov2.onnx ├── output ├── run_DRP-AI_translator_V2L.sh └── run_DRP-AI_translator_V2M.sh

依赖项由安装程序自动安装。

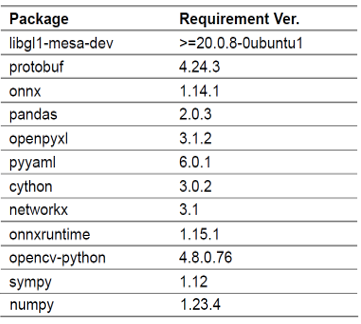

以下是主要依赖项列表:

3) 模型转换所需的文件

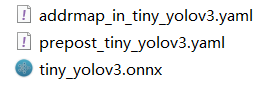

模型转换需要DRP-AI Mac地址配置文件、模型推理前处理后处理配置文件、onnx模型文件,如下图

模型转换所需的配置文件默认路径为./UserConfig。

onnx模型文件默认路径为./onnx

4) 模型转换

可以执行如下指令进行模型转换:

$ cd drp-ai_translator_release $ ./run_DRP-AI_translator_V2M(L).sh test -onnx ./onnx/modelA.onnx

其中test为模型转换后输出的文件名,modelA.onnx为需要转换的模型名称。

审核编辑;黄飞

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

NanoEdge AI的技术原理、应用场景及优势2024-03-12 0

-

防止AI大模型被黑客病毒入侵控制(原创)聆思大模型AI开发套件评测42024-03-19 0

-

手把手教你设计人工智能芯片及系统--(全阶设计教程+AI芯片FPGA实现+开发板)2019-07-19 0

-

AI概论: <TensorFlow + Excel>可操作教案(Part-C:AI(机器)是如何学习呢?)2020-12-02 0

-

在STM32上验证神经网络模型2021-08-03 0

-

介绍在STM32cubeIDE上部署AI模型的系列教程2021-12-14 0

-

迁移学习2022-04-21 0

-

DigiPCBA 库迁移系列 - 前言2022-06-24 0

-

轻松实现一键部署AI模型至RT-Thread系统2022-09-02 0

-

嵌入式边缘AI应用开发指南2022-11-03 0

-

ST MCU边缘AI开发者云 - STM32Cube.AI2023-02-02 0

-

新思科技发布业界首款全栈式AI驱动型EDA解决方案Synopsys.ai2023-04-03 0

-

【KV260视觉入门套件试用体验】Vitis AI 构建开发环境,并使用inspector检查模型2023-10-14 0

-

【KV260视觉入门套件试用体验】Vitis AI 通过迁移学习训练自定义模型2023-10-16 0

-

Cadence 定制/模拟设计迁移流程加速 TSMC 先进制程技术的采用2023-09-27 355

全部0条评论

快来发表一下你的评论吧 !