通用功能安全标准IEC 61508-3中的重要指南

描述

这可能是我最短的博客。人工智能有很多名称,包括机器学习。识别手写字的系统不被称为AI,而是光学字符识别系统。另一方面,深度学习也是一种AI技术。AI可以是许多系统的一部分,但其本身并不是目的。

不管怎么样,下面是通用功能安全标准IEC 61508-3中的重要指南。

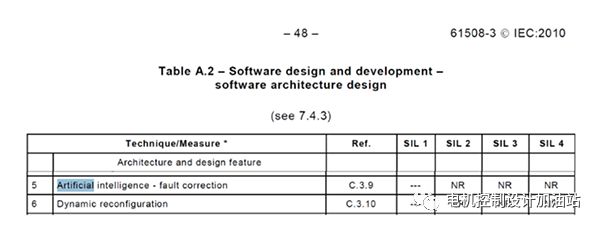

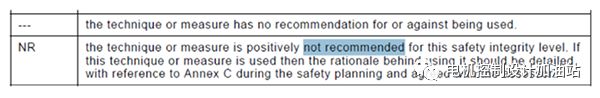

在任何大于SIL 1的SIL级别,不推荐使用AI。对于SIL 1,既不推荐或也不说不推荐。对于指南,不推荐的定义是在 IEC 61508-3:2010 的附录A中给出。

反对AI的一个主要意见是它过于复杂。功能安全喜欢简单。引自《可靠系统的软件》一书。我搜索了这本书,但找不到这句引言。我搜索了一下,在《代码完成》一书中找到了,出自C. A. R. Hoare——“软件设计有两种方法:一种是使其非常简单,因而显然没有缺陷;另一种是使其非常复杂,因而没有明显缺陷”。我明白他们的观点,深度学习算法可能需要让汽车撞树5万次之后,才会发现这是一个坏主意。而骑三轮车的小孩一般只需撞一两次就会得出结论。非确定性对安全性是难以接受的。从上面的书中再引一句话——“开发人员必须熟悉最佳实践,只有理由充分时才能偏离这些实践”。

在汽车功能安全标准ISO 26262中,我没有发现任何地方提到AI,因此理论上关于汽车的指南要回到IEC 61508标准。然而,新的汽车技术中似乎广泛使用AI。我还没有阅读ISO 26262修订版2全文(预计2018年发布),但我必须与ADI公司负责汽车功能安全的同事讨论此问题。也许AI只提供驾驶辅助,而不是用于安全应用。也许它会被新的SOTIF标准(预期功能的安全性)以某种方式覆盖。我认为AI的好处可能变得非常大,上述指南将不得不改变。事实上,IEC 61508-7:2010 C.3.9条款提出了这样的愿望:“在一个系统的不同通道中,监督行动可由基于人工智能(AI)的系统提供非常有效的支持”。

今天的视频选择有很多可能性。在我写这篇文章的那一周,发生了SpaceX重型火箭发射和侧推进器着陆等事件。Elon Musk是积极警告AI存在危险的人之一(通过Google可搜索到一长串相关文章)。我可能应该选择《2001太空漫游》之类的东西,但我选择了《红矮星号》中的对讲机。也许不是Elon所警告的,但谁知道呢,或许他确实看过《红矮星号》呢?毕竟他显然看过《银河系漫游指南》。

-

变速驱动器中的集成电路功能安全2018-10-16 0

-

集成电路的功能安全2018-10-22 0

-

变速驱动器的集成电路功能安全2018-10-23 0

-

功能安全与人工智能2018-10-30 0

-

功能安全与网络2018-10-30 0

-

功能安全标准示例2018-10-30 0

-

IEC 61508深度解析2018-10-31 0

-

基于IEC61508开发功能安全的处理器详细介绍2018-04-16 1004

-

Xilinx将功能安全性扩展至AI级器件 IEC 61508功能安全认证达到3等级2018-11-21 7409

-

中国移动OneOS成功通过IEC 61508功能安全认证2021-11-05 2656

-

利用瑞萨电子的SIL3认证软件加速应用功能安全设计2022-04-24 1324

-

使用于STM32(符合IEC 61508标准)的X-CUBE-STL功能安全包适应其他安全标准2022-11-21 232

-

为 STM32 调整 X-CUBE-STL 功能安全包 (IEC 61508 符合)其他安全标准2022-11-21 241

-

工业应用的IEC 61508标准详解2024-01-22 808

全部0条评论

快来发表一下你的评论吧 !