为什么要用无监督学习?无监督深度学习范例研究

电子说

描述

作为数据科学家,我们平时的工作是使用各种机器学习算法从数据中提取可操作的信息。其中大多数是有监督学习问题,因为你已经知道目标函数是什么。给出的数据有很多细节能帮助你实现最终目标。

虽然无监督学习是一项十分复杂的挑战,但是它有许多优点。它有潜力解决以前无法解决的问题,在机器学习和深度学习领域得到了大量的注意力。

这篇文章的目的是直观地介绍一下无监督学习,以及它在现实生活中的应用。

注意——阅读这篇文章需要读者具有一定深度学习基础,并且了解机器学习的概念。

为什么要用无监督学习?

机器学习项目中的典型方法是以有监督的方式设计的。我们告诉算法该做什么和不该做什么。这是一个解决问题的通用结构,但是它从两个方面限制了算法的潜力:

算法受到监督信息的偏见的约束。没错,算法是自己学会的如何完成这项任务。但是,算法在解决问题时无法去考虑其他可能出现的情况。

由于学习在监督下进行,为算法创建标签需要花费巨大的人力。手动创建的标签越少,算法可以用于训练的数据就越少。

为了以一种智能的方式来解决这一问题,我们可以采用非监督学习算法。非监督学习直接从数据本身得到数据的性质,然后总结数据或对数据分组,让我们可以使用这些性质来进行数据驱动的决策。

让我们用一个例子来更好地理解这个概念。比如说,银行想要对客户进行分组,以便他们能向客户推荐合适的产品。他们可以通过数据驱动的方式来完成这件事——首先通过客户的年龄对客户进行细分,然后从这些分组中得到客户的特性。这将有助于银行向客户提供更好的产品推荐,从而提高客户满意度。

无监督深度学习范例研究

在这篇文章中,我们将介绍一个基于非结构化数据的无监督学习的范例研究。深度学习技术通常在处理非结构化数据时能力最强。因此,我们以深度学习在图像处理领域的应用为例,来理解这个概念。

定义问题——如何整理照片库

现在,我的手机里有2000张照片。如果我是一个自拍狂,照片的数量很可能是这个数字的10倍。挑选这些照片是一场噩梦,因为基本上每三张照片中就有一张对我来说是无用的。我相信大多数人都有同样的问题。

理想情况下,我想要的是一个能够整理照片的应用程序,可以让我随时浏览大部分照片。这样我也可以知道我目前有多少类照片。

为了更清楚地了解这个问题,我尝试自己对照片进行分类。以下是我总结的情况:

首先,我发现我的照片库中有三分之一都是网络趣图(感谢WhatsApp的可爱的朋友们)。

我个人也会收集一些在Reddit上看到的有趣的回答或分享。

至少有200张照片,是我在著名的DataHack Summit会议上,和随后去喀拉拉的旅行

中拍摄的,也有一些是同事分享给我的。

也有一些照片记录了会议期间的白板讨论内容。

还有一些截图记录了代码错误,需要内部团队讨论。使用后必须清除它们。

我还发现了一些“个人隐私”图像,如自拍、合影和几个特殊场景。它们数量不多,但它们是我珍贵的财产。

最后,有无数张“早上好”、“生日快乐”和“幸福的排灯节”的海报,我想方设法把它们从照片库中删除。但是不管我怎么删除它们,它们还是会出现!

在下面的章节中,我们将讨论一些我想出的解决这个问题的方法。

方法一:基于时间分类

最简单的方法是按照时间来整理照片。每一天都可以有不同的文件夹。大多数照片浏览应用程序均使用这种方法(如谷歌照片应用程序)。

这样做的好处是,当天发生的所有事件都会被存储在一起。这种方法的缺点是它太普通了。每一天,我都可能拍摄郊游的照片,同时把有意思的回答截图下来,等等。它们会混在一起,这完全没有达到我的目的。

方法二:基于位置分类

一个相对较好的方法是根据拍摄地点整理照片。例如,每次照相,我们都可以记录照片拍摄的地方。然后,我们可以根据这些位置——无论是国家、城市还是地区,按照我们想要的区域粒度来制作文件夹。这种方法也被许多照片应用程序所使用。

这种方法的缺点在于它的想法过于简单。我们如何定义一张搞笑图片,或者一张卡通图的位置?而它们在我的照片库中占有相当大的份额。所以这种方法也不够巧妙。

方法三:提取照片的语义信息,并用它来定义我的照片库

到目前为止,我们所看到的方法大多依赖于和照片同时获得的元数据。整理照片的一种更好的方法是从图像本身中提取语义信息并智能地使用这些信息。

让我们把这个想法分成几个部分。假设我们有多样性类似(如上所述)的照片。我们的算法应该捕捉哪些趋势?

拍摄的是自然场景图像还是人工生成的图像?

照片里有文字材料吗?如果有的话,我们能识别出它是什么吗?

照片中有什么不同的物体?它们的结合能确定照片的美感吗?

照片里有人吗?我们能认出他们吗?

网络上有相似的图像可以帮助我们识别图像的内容吗?

因此,我们的算法应该能理想地捕捉这个信息,而不需要明显的标记,并用它来整理、分类我们的照片。理想情况下,最终的应用程序界面应该是这样的:

这种方法就是以“无监督的方式”来解决问题。我们没有直接定义我们想要的结果。相反,我们训练一个算法为我们找到这些结果。我们的算法以智能的方式对数据进行了总结,然后在这些推论的基础上尝试解决这个问题。很酷,对吧?

现在你可能想知道,我们该如何利用深度学习来处理无监督的学习问题?

正如我们在上面的案例研究中看到的,通过从图像中提取语义信息,我们可以更好地了解图像的相似性。因此,我们的问题可以表述为:我们该如何降低图像的维度,使我们可以从这些编码表示重建图像。

我们可以利用一个深度学习网络结构——自编码器。

自动编码器的思想是,训练它从学习到的特征来重构输入。亮点在于,它用一个很小的特征表示来重构输入。

例如,一个设置编码维度为10的自动编码器,在猫的图像上训练,每一张图像大小为100×100。所以输入维数是10000,而自动编码器需要用一个大小为10的矢量表示输入所有信息(如下图所示)。

一个自动编码器从逻辑上可以分为两个部分:编码器和解码器。编码器的任务是将输入转化成一个低维表示,而解码器的任务是从低维表示重构输入。

虽然这一领域的研究正在蓬勃发展,但目前最先进的方法也无法轻松解决工业层面的问题,我们的算法想真正“投入工业使用”还需几年时间。

在MNIST数据集上进行无监督深度学习的代码详解

现在我们已经基本了解了如何使用深度学习解决无监督学习问题,下面我们要把学到的知识运用在现实生活的问题中。这里,我们以MNIST数据集为例,MNIST数据集一直是深度学习测试的必选数据集。在解读代码之前,让我们先了解一下问题的定义。

原始问题是确定图像中的数字。数据库会给出图像所含数字的标签。在我们的案例研究中,我们将尝试找出数据库中相似的图片,并将它们聚成一类。我们将通过标签来评估每个类别的纯度。你可以在AV的DataHack平台下载数据——“识别数字”实践问题。

我们会测试三种无监督学习技术,然后评价它们的表现:

直接对图像进行KMeans聚类

KMeans + 自编码器

深度嵌入式聚类算法

在开始实验之前,确保你已经在系统中安装了Keras。(可参考官方安装指南。)我们将用TensorFlow作为后台,所以你要确保配置文件中有这一项。如果没有,按照这里给出的步骤进行操作。

(小编:少侠,手机看代码看不全?用电脑复制代码吧!)

我们需要用到Xifeng Guo实现的DEC算法开源代码。在命令行输入如下命令:

git clone https://github.com/XifengGuo/DEC-keras cd DEC-keras

你可以打开一个Jupyter Notebook,跟着下面的代码一起操作。

首先我们需要导入所有必需的模块。

%pylab inlineimport osimport kerasimport metricsimport numpy as npimport pandas as pdimport keras.backend as Kfrom time import timefrom keras import callbacksfrom keras.models import Modelfrom keras.optimizers import SGDfrom keras.layers import Dense, Inputfrom keras.initializers import VarianceScalingfrom keras.engine.topology import Layer, InputSpecfrom scipy.misc import imreadfrom sklearn.cluster import KMeansfrom sklearn.metrics import accuracy_score, normalized_mutual_info_score

下面我们将种子的值设为一个受限随机数。

# To stop potential randomnessseed = 128rng = np.random.RandomState(seed)

现在设置数据的工作路径,方便后续访问。

root_dir = os.path.abspath('.')data_dir = os.path.join(root_dir, 'data', 'mnist')

读入训练和测试文件。

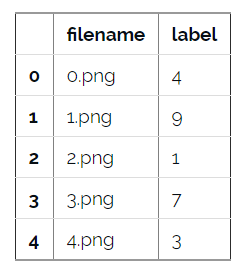

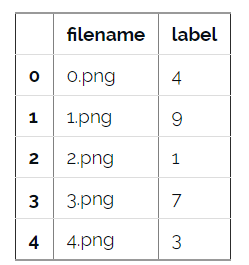

train = pd.read_csv(os.path.join(data_dir, 'train.csv'))test = pd.read_csv(os.path.join(data_dir, 'test.csv'))train.head()

在这个数据库中,每个图片都有类标,这在非监督学习中并不常见,这里,我们用这些类标来评估无监督学习模型的表现。

现在让我们把数据显示成一张图片:

img_name = rng.choice(train.filename)filepath = os.path.join(data_dir, 'train', img_name)img = imread(filepath, flatten=True)pylab.imshow(img, cmap='gray')pylab.axis('off')pylab.show()

随后我们读入所有图片,将它们存储成一个numpy矩阵,创建训练和测试文件。

temp = []for img_name in train.filename: image_path = os.path.join(data_dir, 'train', img_name) img = imread(image_path, flatten=True) img = img.astype('float32') temp.append(img) train_x = np.stack(temp)train_x /= 255.0train_x = train_x.reshape(-1, 784).astype('float32')temp = []for img_name in test.filename: image_path = os.path.join(data_dir, 'test', img_name) img = imread(image_path, flatten=True) img = img.astype('float32') temp.append(img) test_x = np.stack(temp)test_x /= 255.0test_x = test_x.reshape(-1, 784).astype('float32')train_y = train.label.values

我们将训练数据分成训练集和测试集。

split_size = int(train_x.shape[0]*0.7)train_x, val_x = train_x[:split_size], train_x[split_size:]train_y, val_y = train_y[:split_size], train_y[split_size:]

K-Means

我们首先直接对图像使用K-Means聚类,将其聚成10类。

km = KMeans(n_jobs=-1, n_clusters=10, n_init=20)km.fit(train_x)KMeans(algorithm='auto', copy_x=True, init='k-means++', max_iter=300, n_clusters=10, n_init=20, n_jobs=-1, precompute_distances='auto', random_state=None, tol=0.0001, verbose=0)

现在我们已经训练了模型,下面看一下它在验证集上的表现如何。

pred = km.predict(val_x)

我们将使用归一化互信息(NMI)分数来评估我们的模型。

互信息是聚类结果和人工分类之间依赖程度的对称性度量。它基于聚类纯度PI的概念,通过将Ci与M中的所有手动分类进行比较,衡量单个聚类Ci的质量,即Ci与Mj中相同目标的最大数量。因为NMI是归一化的,所以我们可以使用它来比较聚类个数不同的聚类结果。

NMI公式如下:

normalized_mutual_info_score(val_y, pred) 0.4978202013979692

K-Means + AutoEncoder

现在,我们不直接使用K-Means,我们首先用自编码器降低数据维度,提取有用信息,再将这些信息传递给K-Means算法。

# this is our input placeholderinput_img = Input(shape=(784,))# "encoded" is the encoded representation of the inputencoded = Dense(500, activation='relu')(input_img)encoded = Dense(500, activation='relu')(encoded)encoded = Dense(2000, activation='relu')(encoded)encoded = Dense(10, activation='sigmoid')(encoded)# "decoded" is the lossy reconstruction of the inputdecoded = Dense(2000, activation='relu')(encoded)decoded = Dense(500, activation='relu')(decoded)decoded = Dense(500, activation='relu')(decoded)decoded = Dense(784)(decoded)# this model maps an input to its reconstructionautoencoder = Model(input_img, decoded)autoencoder.summary() _________________________________________________________________ Layer (type) Output Shape Param # ================================================================= input_1 (InputLayer) (None, 784) 0 _________________________________________________________________ dense_2 (Dense) (None, 500) 392500 _________________________________________________________________ dense_3 (Dense) (None, 500) 250500 _________________________________________________________________ dense_4 (Dense) (None, 2000) 1002000 _________________________________________________________________ dense_5 (Dense) (None, 10) 20010 _________________________________________________________________ dense_6 (Dense) (None, 2000) 22000 _________________________________________________________________ dense_7 (Dense) (None, 500) 1000500 _________________________________________________________________ dense_8 (Dense) (None, 500) 250500 _________________________________________________________________ dense_9 (Dense) (None, 784) 392784 =================================================================Total params: 3,330,794Trainable params: 3,330,794Non-trainable params: 0_________________________________________________________________# this model maps an input to its encoded representationencoder = Model(input_img, encoded)autoencoder.compile(optimizer='adam', loss='mse')

现在训练自编码器模型:

train_history = autoencoder.fit(train_x,train_x, epochs=500, batch_size=2048, validation_data=(val_x, val_x)) Train on 34300 samples, validate on 14700 samples Epoch 1/50034300/34300 [==============================] - 2s 60us/step - loss: 0.0805 - val_loss: 0.0666...Epoch 494/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0103 - val_loss: 0.0138Epoch 495/50034300/34300 [==============================] - 0s 10us/step - loss: 0.0103 - val_loss: 0.0138Epoch 496/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0103 - val_loss: 0.0138Epoch 497/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0103 - val_loss: 0.0139Epoch 498/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0103 - val_loss: 0.0137Epoch 499/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0103 - val_loss: 0.0139Epoch 500/50034300/34300 [==============================] - 0s 11us/step - loss: 0.0104 - val_loss: 0.0138pred_auto_train = encoder.predict(train_x)pred_auto = encoder.predict(val_x)km.fit(pred_auto_train)pred = km.predict(pred_auto)normalized_mutual_info_score(val_y, pred)0.7435578557037037

从结果可以看到,将自编码器与K-Means结合起来,算法效果比仅使用K-Means的效果要好。

DEC

最后,我们看一下DEC算法的实现。DEC算法将聚类和自编码器放在一起训练以取得更好的效果。(论文:Junyuan Xie, Ross Girshick, and Ali Farhadi. Unsupervised deep embedding for clustering analysis. ICML 2016.)

代码链接:

http://www.infoq.com/cn/articles/trudging-into-unsupervised-deep-learning

DEC算法与上述两种方法相比,效果最好。研究人员发现,进一步训练DEC模型可以达到更高的性能(NMI高达87)。

-

深非监督学习-Hierarchical clustering 层次聚类python的实现2020-04-28 0

-

如何用卷积神经网络方法去解决机器监督学习下面的分类问题?2021-06-16 0

-

基于半监督学习的跌倒检测系统设计_李仲年2017-03-19 765

-

采用无监督学习的方法,用深度摘要网络总结视频2018-01-15 6786

-

基于半监督学习框架的识别算法2018-01-21 720

-

你想要的机器学习课程笔记在这:主要讨论监督学习和无监督学习2018-12-03 419

-

如何用Python进行无监督学习2019-01-21 3954

-

机器学习算法中有监督和无监督学习的区别2020-07-07 5370

-

最基础的半监督学习2020-11-02 2378

-

半监督学习最基础的3个概念2020-11-02 2679

-

为什么半监督学习是机器学习的未来?2020-11-27 3645

-

半监督学习:比监督学习做的更好2020-12-08 1136

-

机器学习中的无监督学习应用在哪些领域2022-01-20 4593

-

自监督学习的一些思考2022-01-26 290

-

融合零样本学习和小样本学习的弱监督学习方法综述2022-02-09 1795

全部0条评论

快来发表一下你的评论吧 !