关于MinBox障碍物边框构建的干货!

电子说

描述

Apollo感知模块具有识别障碍物和交通灯的能力,LiDAR利用点云感知,可以了解障碍物的位置、大小、类别、朝向、轨迹和速度等信息。

Apollo解决的障碍物感知问题有:

· 高精地图ROI过滤器(HDMap ROI Filter)

· 基于卷积神经网络分割(CNNSegmentation)

· MinBox障碍物边框构建(MinBoxBuilder)

· HM对象跟踪(HM Object Tracker)等

Apollo视觉感知输出的第一步是做detection(目标检测)和分割,第二步是要把结果2D-to-3D,同时还有一个tracking(追踪)的过程后,即完成了感知的主要输出步骤。

其中,tracking是做时序,2D和3D结果也会做tracking,这是无人车做感知常有的pipeline(线性模型),有这样的结果以后,就会输出被感知物体的位置和速度等信息。

在障碍物边框构建这一环节,开发者使用CNN Seg DL学习的方法,得到障碍物信息后,可使用MinBox的方法得到物体的2D框(最终边界框),结合tracking结合相机图像进行学习得到的物体边界框,则可得到物体3D的边界框。

以下是Apollo社区开发者朱炎亮在Github-Apollo-Note上分享的《如何构建MinBox障碍物边框》,感谢他为我们在MinBox Builder这一步所做的详细注解和释疑。

面对复杂多变、快速迭代的开发环境,只有开放才会带来进步,Apollo社区正在被开源的力量唤醒。

对象构建器组件为检测到的障碍物建立一个边界框。因为LiDAR传感器的遮挡或距离,形成障碍物的点云可以是稀疏的,并且仅覆盖一部分表面。因此,盒构建器将恢复给定多边形点的完整边界框。即使点云稀疏,边界框的主要目的还是预估障碍物(例如,车辆)的方向。同样地,边框也用于可视化障碍物。

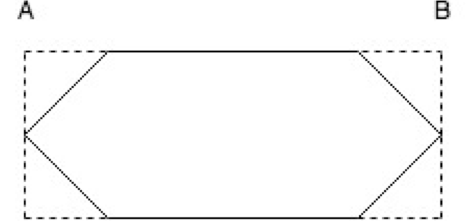

算法背后的想法是找到给定多边形点边缘的所有区域。在以下示例中,如果AB是边缘,则Apollo将其他多边形点投影到AB上,并建立具有最大距离的交点对,这是属于边框的边缘之一。然后直接获得边界框的另一边。通过迭代多边形中的所有边,如下图所示,Apollo确定了一个6边界边框,将选择具有最小面积的方案作为最终的边界框。

我们从代码入手,一步步解析障碍物边框构建的流程。

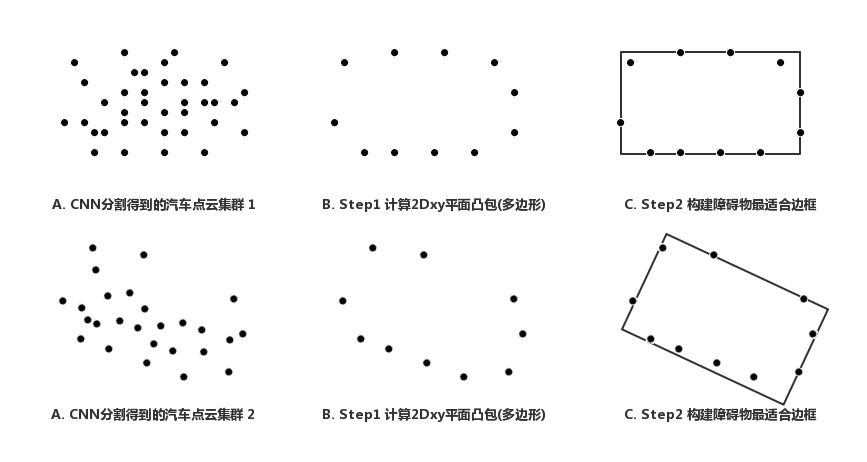

上一步CNN分割与后期处理,可以得到LiDAR一定区域内的障碍物集群。接下来,我们将对这些障碍物集群建立其标定框。标定框的作用除了标识物体,还有一个作用就是标记障碍物的长length、宽width、高height。其中规定长length大于宽width,障碍物方向就是长的方向direction。

MinBox构建过程如下:

·计算障碍物2D投影(高空鸟瞰XY平面)下的多边形polygon(如下图B)。

·根据上述多边形,计算最适边框(如下图C)。

大致的代码框架如下:

1 /// file in apollo/modules/perception/obstacle/onboard/lidar_process_subnode.ccvoid LidarProcessSubnode::OnPointCloud(const sensor_msgs::PointCloud2& message) { /// call hdmap to get ROI 2 ... /// call roi_filter 3 ... /// call segmentor 4 ... /// call object builder 5 if (object_builder_ != nullptr) { 6 ObjectBuilderOptions object_builder_options; if (!object_builder_->Build(object_builder_options, &objects)) { 7 ... 8 } 9 } 10 }/// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccbool MinBoxObjectBuilder::Build(const ObjectBuilderOptions& options, std::vector

以上部分是MinBox障碍物边框构建的主题框架代码,构建的两个过程分别在ComputePolygon2dxy

和ReconstructPolygon函数完成,下面我们就具体深入这两个函数,详细了解一下Apollo对障碍物构建的一个流程,和其中一些令人费解的代码段。

Step 1. MinBox构建--计算2DXY平面投影

这个阶段主要作用是障碍物集群做XY平面下的凸包多边形计算,最终得到这个多边形的一些角点。第一部分相对比较简单,没什么难点,计算凸包是调用plc库的ConvexHull组件(具体请参考pcl::ConvexHull)。

Apollo的凸包计算代码如下:

1 /// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccvoid MinBoxObjectBuilder::ComputePolygon2dxy(ObjectPtr obj) { 2 ... 3 ConvexHull2DXY

从以上代码的注释中,我们可以清楚地了解到这个多边形顶点的求解流程,具体函数由PerformReconstruction2dxy函数完成,这个函数其实跟pcl库自带的很像pcl::ConvexHull::performReconstruction2D/Line76,其实Apollo开发人员几乎将pcl库的performReconstruction2D原封不动地搬了过来,仅去掉了一些冗余的信息。

这个过程主要有:

1. 构建输入数据,将输入的点云复制到coordT *points做处理。

2. 计算障碍物点云的凸包,得到的结果是多边形顶点。调用qh_new_qhull函数。

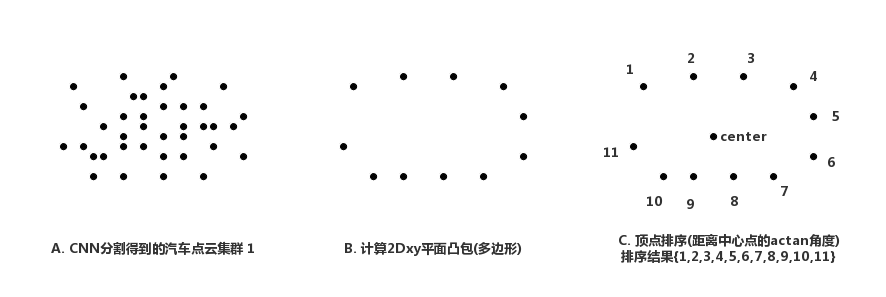

3. 顶点排序,从pcl::comparePoints2D/Line59

可以看到排序是角度越大越靠前,atan2函数的结果是[-pi,pi]。所以就相当于是顺 时针对顶点进行排序。

上图为计算多边形交点的流程示意图

该过程并不繁琐,这里不再深入解释每个模块。

Step 2. MinBox构建--边框构建

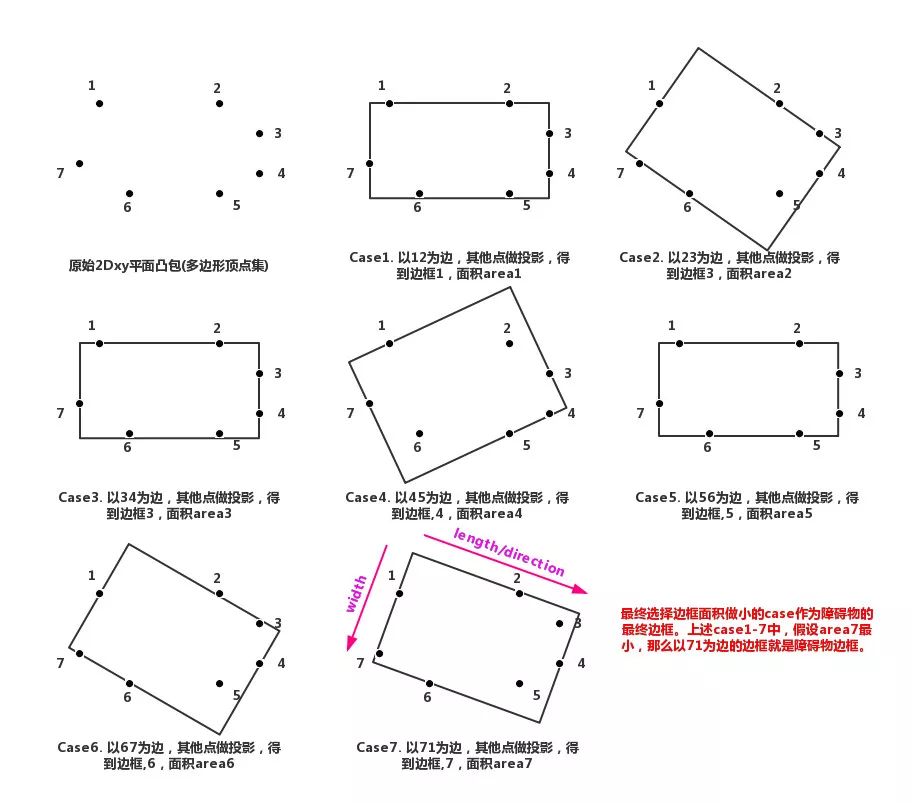

边框构建的逻辑,大致是针对过程中得到的多边形的每一条边。将剩下的所有点都投影到这条边上,就可以计算边框Box的一条边长度(最远的两个投影点距离),同时选择距离该条边最远的点计算Box的高,这样就可以得到一个Box(上图case1-7分别是以这个多边形7条边作投影得到的7个Box),最终选择Box面积最小的边框作为障碍物的边框。

上图中case7得到的Box面积最小,所以case7中的Box就是最终障碍物的边框。当边框确定以后,就可以得到障碍物的长度length(大边长),宽度(小边长),方向(大边上对应的方向),高度(点云的平均高度,CNN分割与后期处理阶段得到)。

但是在此过程中,不得不承认有部分代码块相对难理解,而且出现了很多实际问题来优化这个过程。这里我将对这些问题一一进行解释。

根据代码,先简单地将这个过程归结为2步:

1. 投影边长的选择(为什么要选择?因为背对lidar那一侧的点云是稀疏的,那一侧的多边形顶点是不可靠的,不用来计算Box)。

2. 每个投影边长计算Box。

在进入正式的代码详解以前,这里有几个知识点需要了解。

假设向量a=(x0,y0),向量b=(x1,y1),那么有:

· 两个向量的点乘, a·b = x0x1 + y0y1\。

· 计算向量a在向量b上的投影: v = a·b/(b^2)·b,投影点的坐标就是v+(b.x, b.y)。

· 两个向量的叉乘, axb = |a|·|b|sin(theta) = x0y1 - x1y0,叉乘方向与ab平面垂直,遵循右手法则。叉乘模大小另一层意义是: ab向量构成的平行四边形面积。

如果两个向量a,b共起点,那么axb小于0,那么a to b的逆时针夹角大于180度;等于则共线;大于0,a to b的逆时针方向夹角小于180度。

接下来正式解剖

ReconstructPolygon构建的代码:

(1) Step1:投影边长的选择

1 /// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccvoid MinBoxObjectBuilder::ReconstructPolygon(const Eigen::Vector3d& ref_ct, ObjectPtr obj) { // compute max_point and min_point 2 size_t max_point_index = 0; size_t min_point_index = 0; 3 Eigen::Vector3d p; 4 p[0] = obj->polygon.points[0].x; 5 p[1] = obj->polygon.points[0].y; 6 p[2] = obj->polygon.points[0].z; 7 Eigen::Vector3d max_point = p - ref_ct; 8 Eigen::Vector3d min_point = p - ref_ct; for (size_t i = 1; i < obj->polygon.points.size(); ++i) { 9 Eigen::Vector3d p; 10 p[0] = obj->polygon.points[i].x; 11 p[1] = obj->polygon.points[i].y; 12 p[2] = obj->polygon.points[i].z; 13 Eigen::Vector3d ray = p - ref_ct; // clock direction14 if (max_point[0] * ray[1] - ray[0] * max_point[1] < EPSILON) { 15 max_point = ray; 16 max_point_index = i; 17 } // unclock direction18 if (min_point[0] * ray[1] - ray[0] * min_point[1] > EPSILON) { 19 min_point = ray; 20 min_point_index = i; 21 } 22 } 23 }

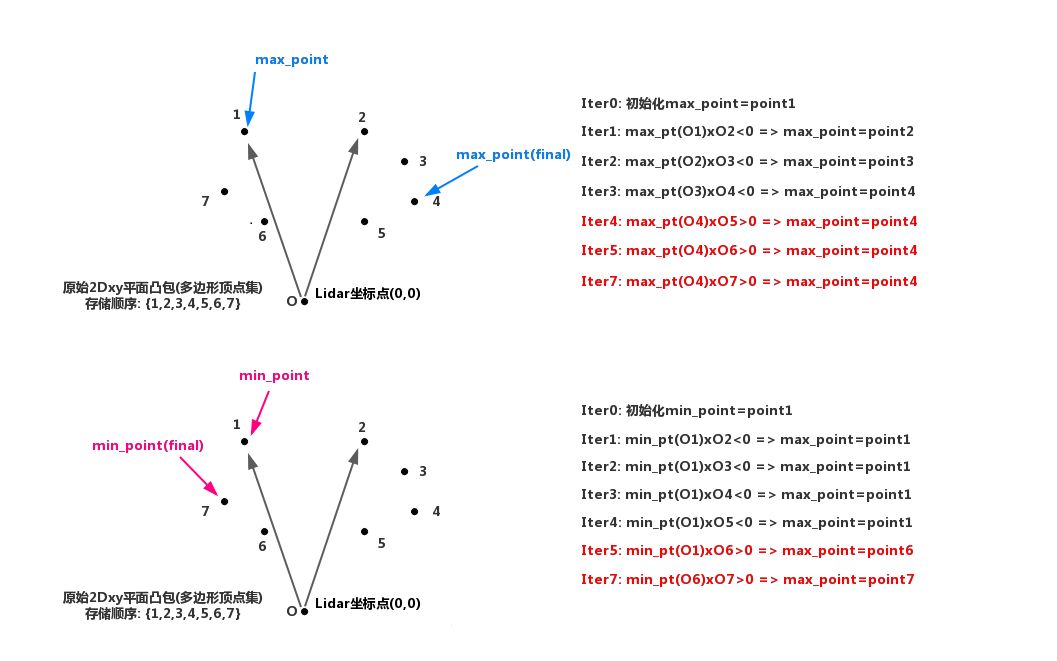

以上代码内容为计算min_point和max_point两个角点,该角点到底是什么?其中关于EPSILON的比较条件到底代表什么?

有一个前提我们已经在polygons多边形角点计算中可知:obj的polygon中所有角点都是顺时针按照arctan角度由大到小排序。

此过程可以通过下图了解其作用:

图中叉乘与0(EPSILON)的大小是根据前面提到的,两个向量的逆时针夹角。从上图中可以清晰地看到:max_point和min_point就代表了LiDAR能检测到障碍物的两个极端点。

1 /// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccvoid MinBoxObjectBuilder::ReconstructPolygon(const Eigen::Vector3d& ref_ct, ObjectPtr obj) { // compute max_point and min_point 2 ... // compute valid edge 3 Eigen::Vector3d line = max_point - min_point; double total_len = 0; double max_dis = 0; bool has_out = false; for (size_t i = min_point_index, count = 0; count < obj->polygon.points.size(); i = (i + 1) % obj->polygon.points.size(), ++count) { //Eigen::Vector3d p_x = obj->polygon.point[i] 4 size_t j = (i + 1) % obj->polygon.points.size(); if (j != min_point_index && j != max_point_index) { // Eigen::Vector3d p = obj->polygon.points[j]; 5 Eigen::Vector3d ray = p - min_point; if (line[0] * ray[1] - ray[0] * line[1] < EPSILON) { 6 ... 7 }else { 8 ... 9 } 10 } else if ((i == min_point_index && j == max_point_index) || (i == max_point_index && j == min_point_index)) { 11 ... 12 } else if (j == min_point_index || j == max_point_index) { // Eigen::Vector3d p = obj->polygon.points[j];13 Eigen::Vector3d ray = p_x - min_point; if (line[0] * ray[1] - ray[0] * line[1] < EPSILON) { 14 ... 15 } else { 16 ... 17 } 18 } 19 } 20 }

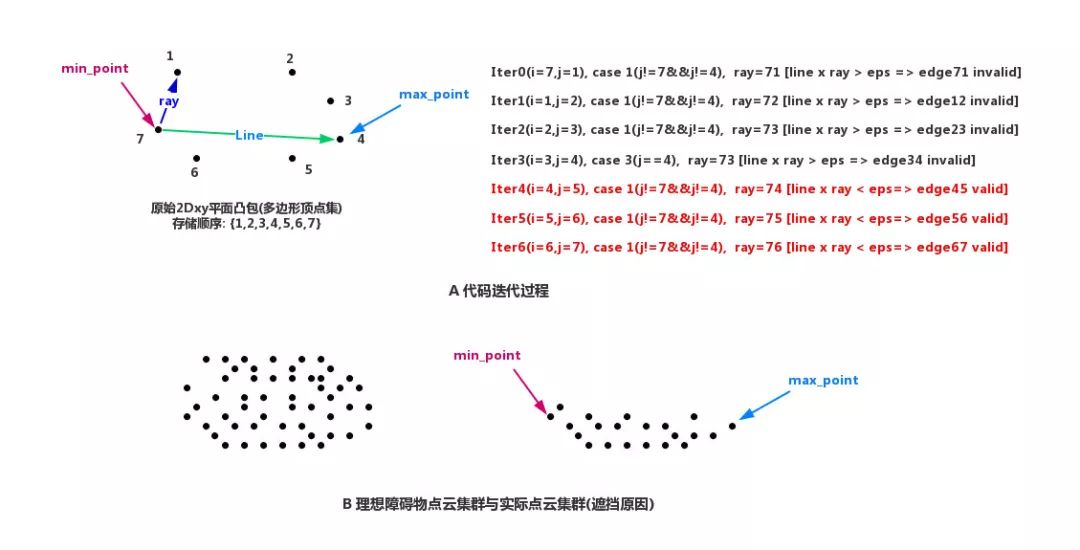

当计算得到max_point和min_point后就需要执行这段代码,这段代码可能令人费解的原因为——为什么需要对每条边做一个条件筛选?

请看下图:

上图中,A演示了这段代码对一个汽车的点云多边形进行处理,最后的处理结果可以看到只有Edge45、Edge56、Edge67是有效的,最终会被计入total_len和max_dist。并且,相对应的边都是在line(max_point-min_point)这条分界线的一侧,同时也是靠近LiDAR这一侧。

这说明靠近LiDAR这一侧点云检测效果好,边稳定;而背离LiDAR那一侧,会因为遮挡原因,往往很难(有时候不可能)得到真正的顶点,如上图B所示。

(2) Step2:投影边长Box计算

投影边长Box计算由ComputeAreaAlongOneEdge函数完成,下面我们分析这个函数的代码:

1 /// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccdouble MinBoxObjectBuilder::ComputeAreaAlongOneEdge( 2 ObjectPtr obj, size_t first_in_point, Eigen::Vector3d* center, double* lenth, double* width, Eigen::Vector3d* dir) { // first for 3 std::vector

从以上部分代码可以看出,ComputeAreaAlongOneEdge函数接受的输入包括多边形顶点集合,起始边first_in_point。代码将以first_in_point和first_in_point+1两个顶点构建一条边,将集合中其他点都投影到这条边上,并计算顶点距离这条边的高——也就是垂直距离。

最终的结果会保存到ns中。代码中,k的计算利用了两个向量点乘来计算投影点的性质;height的计算利用了两个向量叉乘的模等于两个向量组成的四边形面积的性质。

1 /// file in apollo/modules/perception/obstacle/lidar/object_builder/min_box/min_box.ccdouble MinBoxObjectBuilder::ComputeAreaAlongOneEdge( // first for 2 ... // second for 3 size_t point_num1 = 0; size_t point_num2 = 0; // 遍历first_in_point和first_in_point+1两个点以外的,其他点的投影高,选择height最大的点,来一起组成Box 4 // 这两个for循环是寻找ab边上相聚最远的投影点,因为要把所有点都包括到Box中,所以Box沿着ab边的边长就是最远两个点的距离,可以参考边框构建。 5 for (size_t i = 0; i < ns.size() - 1; ++i) { 6 Eigen::Vector3d p1 = ns[i]; for (size_t j = i + 1; j < ns.size(); ++j) { 7 Eigen::Vector3d p2 = ns[j]; double dist = sqrt((p1[0] - p2[0]) * (p1[0] - p2[0]) + (p1[1] - p2[1]) * (p1[1] - p2[1])); if (dist > len) { 8 len = dist; 9 point_num1 = i; 10 point_num2 = j; 11 } 12 } 13 } // vp1和vp2代表了Box的ab边对边的那条边的两个顶点,分别在v的两侧,方向和ab方向一致。14 Eigen::Vector3d vp1 = v + ns[point_num1] - vn; 15 Eigen::Vector3d vp2 = v + ns[point_num2] - vn; // 计算中心点和面积16 (*center) = (vp1 + vp2 + ns[point_num1] + ns[point_num2]) / 4; 17 (*center)[2] = obj->polygon.points[0].z; if (len > wid) { 18 *dir = ns[point_num2] - ns[point_num1]; 19 } else { 20 *dir = vp1 - ns[point_num1]; 21 } 22 *lenth = len > wid ? len : wid; 23 *width = len > wid ? wid : len; return (*lenth) * (*width); 24 }

剩下的代码就是计算Box的四个顶点坐标,以及它的面积Area。

综上所述,Box经过上述(1)(2)两个阶段,可以很清晰地得到每条有效边(靠近lidar一侧,在min_point和max_point之间)对应的Box四个顶点坐标、宽、高。最终选择Box面积最小的作为障碍物预测Box。

整个过程的代码部分相对较难理解,经过本节的学习,相信各位应该对MinBox边框的构建有了一定了解。

自Apollo平台开放已来,我们收到了大量开发者的咨询和反馈,越来越多开发者基于Apollo擦出了更多的火花,并愿意将自己的成果贡献出来,这充分体现了Apollo『贡献越多,获得越多』的开源精神。为此我们开设了『开发者说』板块,希望开发者们能够踊跃投稿,更好地为广大自动驾驶开发者营造一个共享交流的平台!

-

遇到障碍物自动返回?2011-09-10 0

-

设计完PCB后走线不能躲避障碍物时什么情况2012-12-20 0

-

求教 障碍物感应类开关2013-03-07 0

-

基于单片机的道路障碍物系统,新人求教2015-03-10 0

-

谁能分享一下基于51单片机显示屏的飞机避开障碍物的简单游戏资料吗2016-04-24 0

-

遇障碍物时 语音提示 前方危险,请注意。2017-02-24 0

-

基于labview机器视觉的障碍物时别2017-03-14 0

-

单片机超声波避障车,需要多少个超声波能够让小车绕过障碍物。2017-03-21 0

-

用labview设计超级马里奥游戏时如何加障碍物?2017-05-09 0

-

新人求教AD中Pullback(障碍物)到底是一个什么概念或作用?2017-11-04 0

-

请问Infrared Proximity Sensor如何检测前方是否有障碍物?2020-11-06 0

-

检测障碍物有什么什么传感器?2023-11-08 0

-

障碍物检测实验2009-03-23 2407

-

障碍物方位检测实验2009-03-23 1860

-

基于点云的3D障碍物检测介绍2023-06-26 545

全部0条评论

快来发表一下你的评论吧 !