研究人员开发出一个端到端的机器学习系统Audio2Face

电子说

描述

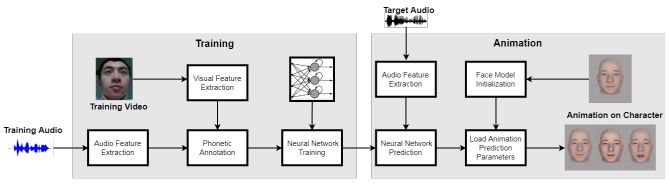

浙江大学和网易伏羲AI实验室的研究人员开发出一个端到端的机器学习系统Audio2Face,可以从音频中单独生成实时面部动画,同时考虑到音高和说话风格。

我们都知道动画里的人物说话声音都是由后期配音演员合成的。

但即使利用CrazyTalk这样的软件,也很难将电脑生成的嘴唇、嘴型等与配音演员进行很好地匹配,尤其是当对话时长在数十甚至数百小时的情况下。

但不要气馁,动画师的福音来了——Audio2Face问世!

Audio2Face是一款端到端的机器学习系统,由浙江大学与网易伏羲AI实验室共同打造。

它可以从音频中单独生成实时的面部动画,更厉害的是,它还能调节音调和说话风格。该成果已经发布至arXiv:

arXiv地址:

https://arxiv.org/pdf/1905.11142.pdf

团队试图构建一个系统,既要逼真又要低延迟

“我们的方法完全是基于音轨设计的,没有任何其他辅助输入(例如图像),这就使得当我们试图从声音序列中回归视觉空间的过程将会越来越具有挑战。”论文共同作者解释道,“另一个挑战是面部活动涉及脸部几何表面上相关区域的多重激活,这使得很难产生逼真且一致的面部变形。”

该团队试图构建一个同时满足“逼真”(生成的动画必须反映可见语音运动中的说话模式)和低延迟(系统必须能够进行近乎实时的动画)要求的系统。他们还尝试将其推广,以便可以将生成的动画重新定位到其他3D角色。

他们的方法包括从原始输入音频中提取手工制作的高级声学特征,特别是梅尔频率倒谱系数(MFC),或声音的短期功率谱的表示。然后深度相机与mocap工具Faceshift一起,捕捉配音演员的面部动作并编制训练集。

深度相机示意图

之后研究人员构建了带有51个参数的3D卡通人脸模型,控制了脸部的不同部位(例如,眉毛,眼睛,嘴唇和下巴)。最后,他们利用上述AI系统将音频上下文映射到参数,产生唇部和面部动作。

1470个音频样本加持,机器学习模型的输出“相当可以”

团队使用一个训练语料库,其中包含两个60分钟、每秒30帧的女性和男性演员逐行阅读剧本中台词的视频,以及每个相应视频帧的1470个音频样本(每帧总共2496个维度)。

团队报告说,与ground truth相比,机器学习模型的输出“相当可以”。它设法在测试音频上重现准确的面部形状,并且它一直“很好地”重新定位到不同的角色。此外,AI系统平均只需0.68毫秒即可从给定的音频窗口中提取特征。

该团队指出,AI无法跟随演员的眨眼模式,主要是因为眨眼与言语的相关性非常弱。不过从广义上讲,该框架可能为适应性强、可扩展的音频到面部动画技术奠定基础,这些技术几乎适用于所有说话人和语言。

“评估结果显示,我们的方法不仅可以从音频中产生准确的唇部运动,还可以成功地消除说话人随时间变化的面部动作,”他们写道。

-

日研究人员新发现:光纤也能变身太阳能电池2009-04-14 0

-

法国研究人员开发出新型智能晶体管2010-01-27 449

-

研究人员开发出新的纳米机器人电驱动技术 此技术比以前方法快10万倍2018-02-02 4026

-

Deezer研究人员成功开发出能识别歌曲中情绪的人工智能2018-09-29 897

-

以色列研究人员开发出了一种能够识别不同刺激的新型传感系统2019-05-21 756

-

哈佛研究人员研发由空气驱动的软体机器人2019-06-07 4105

-

MIT研究人员开发出新型“光子”芯片2019-06-12 3574

-

美研究人员开发出移动传感系统 可持续跟踪员工表现2019-07-04 2832

-

研究人员实现无创早期肺癌筛查,以机器学习为基础2020-03-27 689

-

研究人员开发出深度学习算法用于患者的诊断2020-11-16 1669

-

研究人员开发出用于光子处理器的新方法2021-01-08 1720

-

OpenAI研究人员开发出新的机械臂2021-02-23 1630

-

研究人员开发出可以自我磁疗的小型游泳机器人2021-04-07 1298

-

英伟达GTC:云服务新模型、Omniverse Audio2Face、专业设计卡等亮点迭出2023-03-23 1650

全部0条评论

快来发表一下你的评论吧 !