神经模态芯片发展的方向

电子说

描述

神经模态芯片的发展方向首先是规模化,即扩大神经元的规模,这也是Intel和IBM等大厂主要押注的方向。

如果我们回顾深度学习的发展历程,我们会发现其实神经网络的原理早在上世纪60年代就已初见雏形,但是由于训练数据量不够以及算力不够,因此直到2012年才被人们重新发现,并且发现了众多之前完全没有想到的应用场景和市场。对于神经模态计算,大厂押注的也是类似的情况:神经模态计算的原理看起来是正确的(尤其是今天深度学习已经获得了很大的成功,那么基于相似原理的神经模态计算应该不会很不靠谱),目前或许只要把神经元的数量和神经突触连接数量跨过一个阈值(就像当年AlexNet跨过网络深度的门槛一样),那么神经模态计算就有可能爆发出巨大的能量,甚至远超之前的想象。这次Intel发布的超过八百万神经元的Pohoiki Beach系统显然就是在往规模化的方向大力发展。

根据Intel的官方消息,下一步将继续发布神经元数量更大的Pohoiki Spring计划,可见Intel是在往大规模神经模态计算的方向大力推进。

除了发展规模化之外,另一个方向就是利用神经模态计算低功耗和低延迟的特点并进一步优化芯片设计来开发出高能效比低延迟的芯片。这类芯片或许神经元数量不多,但是可以实现非常低的功耗和非常好的能效比,从而可以部署在传统深度学习无法部署的场景。事实上,目前如何高效训练大规模神经模态神经元的算法还没有找到,因此在现有训练框架的基础下,或许优先把能效比做到极致是比把神经元数量做大更接地气的方向。

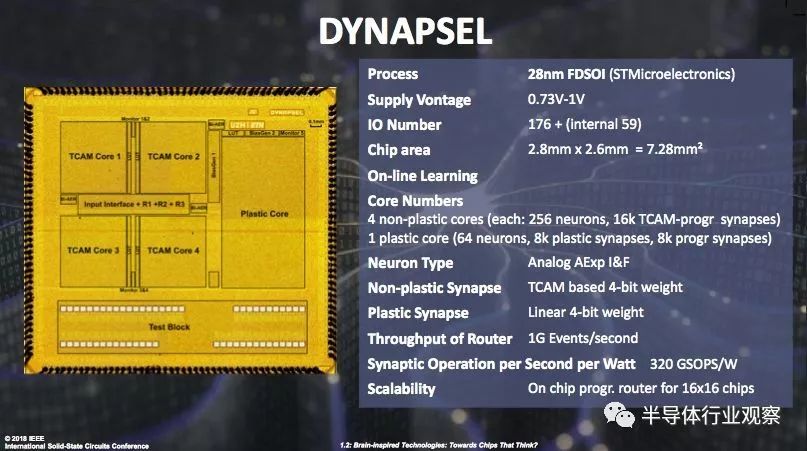

瑞士苏黎世理工大学的Giacomo Indiveri教授就是这个方向的代表性人物,研究组在十数年内已经发表了多篇电路和系统论文,其研发的芯片作为欧洲神经模态计算研究的代表性工作在2018年ISSCC主题演讲中被重点介绍。

-

【「芯片通识课:一本书读懂芯片技术」阅读体验】从deepseek看今天芯片发展2025-04-02 2828

-

【「AI芯片:科技探索与AGI愿景」阅读体验】+神经形态计算、类脑芯片2025-09-17 2889

-

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI芯片到AGI芯片2025-09-18 5947

-

基于FPGA的神经工程设计与应用2012-06-03 3587

-

求基于labview的神经学方向的程序加说明,谢谢哈!!!2012-12-02 4584

-

施工经验--桥梁检测技术的发展趋势2020-10-14 1394

-

卷积神经网络模型发展及应用2022-08-02 13342

-

卷积神经网络的振动信号模态参数识别2017-12-05 2363

-

神经模态芯片发展的方向 神经模态芯片技术解析2020-09-15 1230

-

神经模态芯片如何商业化落地2019-08-09 2759

-

英特尔和IBM积极探索神经模态计算到底是什么?2020-03-08 2388

-

基于注意力神经网络的多模态情感分析方法2021-04-28 1044

-

AI芯片的诞生和发展背景 AI芯片发展的技术方向 AI芯片的发展趋势2023-08-16 5594

-

人工智能领域多模态的概念和应用场景2023-12-15 14071

-

神经网络芯片与传统芯片的区别和联系2024-07-04 2638

全部0条评论

快来发表一下你的评论吧 !