机器学习之特征提取 VS 特征选择

电子说

描述

1. 特征提取 V.S 特征选择

特征提取和特征选择是DimensionalityReduction(降维)的两种方法,针对于the curse of dimensionality(维灾难),都可以达到降维的目的。但是这两个有所不同。

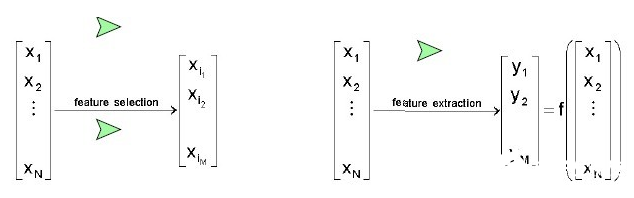

特征提取(Feature Extraction):Creatting a subset of new features by combinations of the exsiting features.也就是说,特征抽取后的新特征是原来特征的一个映射。

特征选择(Feature Selection):choosing a subset of all the features(the ones more informative)。也就是说,特征选择后的特征是原来特征的一个子集。

2. PCA V.S LDA

主成分分析(Principle Components Analysis ,PCA)和线性评判分析(Linear Discriminant Analysis,LDA)是特征提取的两种主要经典方法。

对于特征提取,有两种类别:

(1)Signal representation(信号表示): The goal of the feature extraction mapping is to represent the samples accurately in a low-dimensional space. 也就是说,特征抽取后的特征要能够精确地表示样本信息,使得信息丢失很小。对应的方法是PCA.

(2)Signal classification(信号分类): The goal of the feature extraction mapping is toenhance the class-discriminatory information in a low-dimensional space. 也就是说,特征抽取后的特征,要使得分类后的准确率很高,不能比原来特征进行分类的准确率低。对与线性来说,对应的方法是LDA . 非线性这里暂时不考虑。

可见, PCA和LDA两种方法的目标不一样,因此导致他们的方法也不一样。PCA得到的投影空间是协方差矩阵的特征向量,而LDA则是通过求得一个变换W,使得变换之后的新均值之差最大、方差最大(也就是最大化类间距离和最小化类内距离),变换W就是特征的投影方向。

-

基于卷积神经网络的双重特征提取方法2023-10-16 1944

-

基于局域判别基的音频信号特征提取方法2011-03-04 1910

-

模拟电路故障诊断中的特征提取方法2016-12-09 5428

-

基于已知特征项和环境相关量的特征提取算法2009-04-18 938

-

模式识别中的特征提取研究2009-12-12 839

-

基于小波分析的车辆噪声特征提取方法2010-12-31 746

-

故障特征提取的方法研究2006-03-11 1963

-

基于EMD法的语音信号特征提取2011-10-10 1138

-

基于Gabor的特征提取算法在人脸识别中的应用2013-01-22 1369

-

颜色特征提取方法2017-11-16 4651

-

无监督行为特征提取算法2017-12-26 2150

-

基于HTM架构的时空特征提取方法2018-01-17 1306

-

基于自编码特征的语音声学综合特征提取2021-05-19 1140

-

基于中轴变换的改进骨架特征提取方法2021-06-27 1013

-

计算机视觉中不同的特征提取方法对比2022-07-11 5205

全部0条评论

快来发表一下你的评论吧 !