图像分割技巧资料

描述

一个经历了 39 场 Kaggle 比赛的团队在 reddit 上发帖表示,他们整理了一份结构化的图像分割技巧列表,涵盖数据增强、建模、损失函数、训练技巧等多个方面,不失为一份可以参考的图像分割技巧资料。

图像分割是图像处理和计算机视觉的热点之一,是根据图像内容对指定区域进行标记的计算机视觉任务。它基于某些标准将输入图像划分为多个相同的类别,简言之就是「这张图片里有什么,其在图片中的位置是什么?」以便提取人们感兴趣的区域。图像分割是图像分析和图像特征提取及识别的基础。

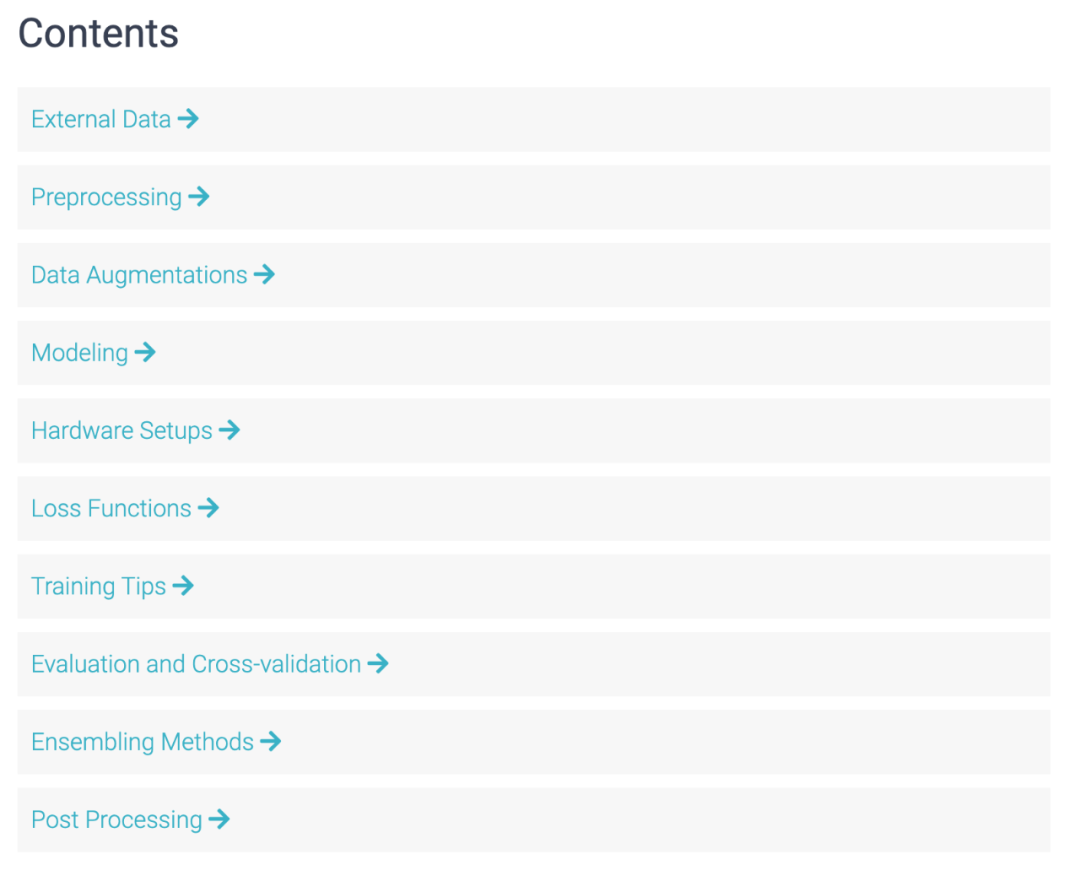

图像分割也是 Kaggle 中的一类常见赛题,比如卫星图像分割与识别、气胸疾病图像分割等。除了密切的团队配合、给力的 GPU 配置等条件,技巧在这类比赛中也发挥了很大的作用。但这些技巧去哪里找呢?Medium、大牛博客、参赛经验帖中都散落着各种技巧分享,但这些资源往往比较零散,于是就有人想到,为什么不把它们集中到一起呢? Derrick Mwiti 就带头做了这么一件事,他和他所在的团队将过去 39 场 Kaggle 比赛中讨论过的图像分割技巧、资料都汇总到了一起,希望可以帮到在图像分割任务中遇到困难的同学。 这份列表分为十大板块,包括外部数据、预处理、数据增强、建模、硬件配置、损失函数、训练技巧、评估和交叉验证、集成方法以及后处理。

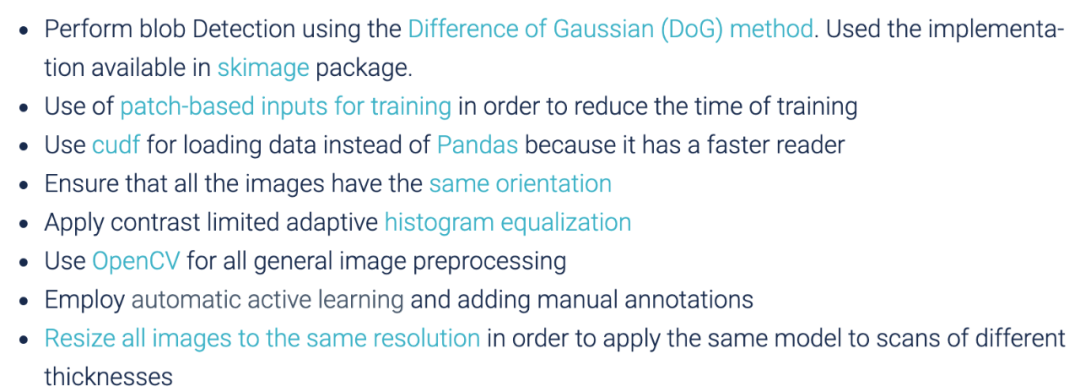

每个版块的具体内容以条目的形式呈现,每个条目又都嵌入了一些链接,点开可以看到一些优秀的 Kaggle 解决方案分享、Medium 博客教程、高赞的 GitHub 项目等,读者可以根据自己的具体问题和需要进行查找。 本文选取了其中一部分内容进行介绍,具体细节及链接请参见原文。 接下来,我们来看每个步骤都有哪些技巧吧。 预处理 这一部分包含众多常见的有效图像预处理方法,例如:

使用高斯差分方法进行斑点检测;

使用基于图像块的输入进行训练,以减少训练时间;

加载数据时,用 cudf 替换 Pandas;

确保所有图像保持相同的方向;

使用 OpenCV 对所有常规图像进行预处理;

采用自主学习并手动添加注释;

将所有图像调整成相同的分辨率,以便将相同的模型用于不同厚度的扫描等。

数据增强 数据增强能够使网络具有更复杂的表征能力,从而减小网络性能在验证集和训练集以及最终测试集上的差距,让网络更好地学习迁移数据集上的数据分布。这部分介绍了一些常用的数据增强方法:

用 albumentations 包进行数据增强;

使用 90 度随机旋转;

使用水平、垂直翻转或这两个方向都做翻转;

尝试进行复杂的几何变换,包括弹性变换、透视变换、分段仿射变换、枕形失真;

应用随机 HSV;

使用损失较小的增强数据进行泛化,以防止有用图像信息丢失;

应用通道 shuffle;

根据类别频率进行数据扩充;

应用高斯噪声等。

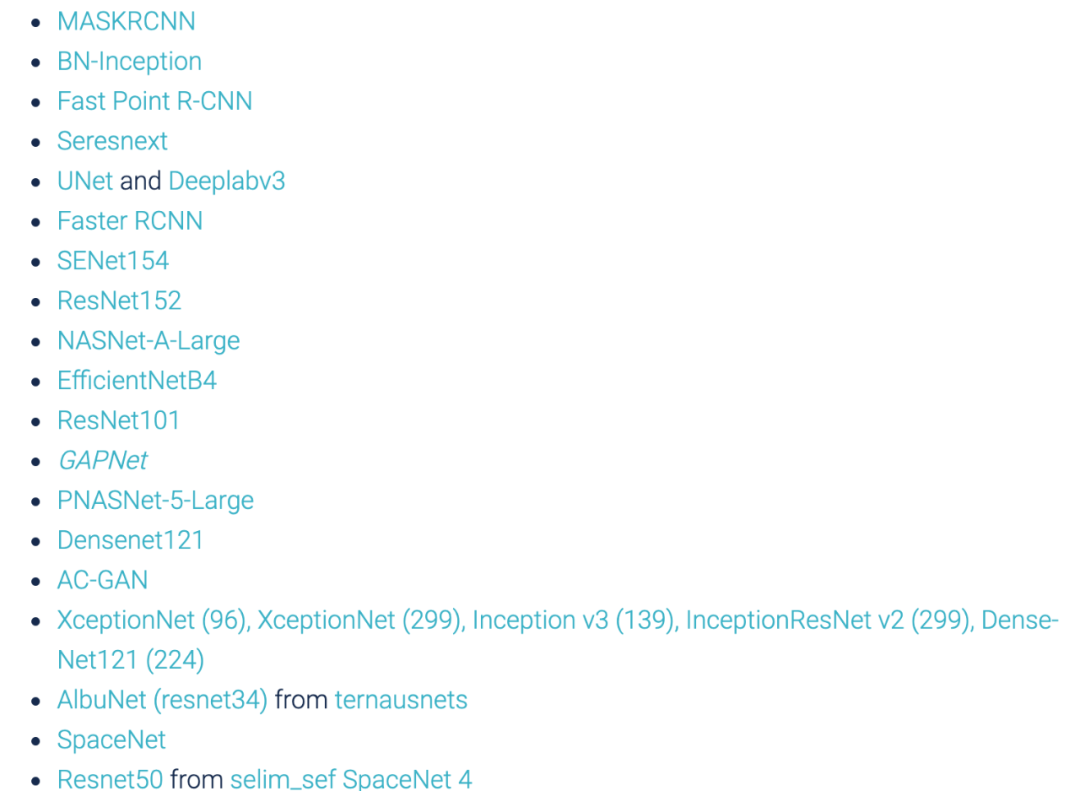

建模 网络架构 这一部分介绍了一些可用在图像分割上的常用网络框架,例如:

使用基于 U-net 的架构;

用 inception-ResNet v2 架构得到具备不同感受野的训练特征;

经过对抗训练的 Siamese 网络;

以密集(FC)层作为最后一层的 ResNet50、Xception、Inception ResNet v2 x 5;

使用全局最大池化层,无论输入尺寸如何,该层都将返回固定长度的输出;

使用堆叠的膨胀卷积;

VoxelNet;

用 concat 和 conv1x1 替换 LinkNet 跳跃连接中的加号;

广义平均池化;

用 3D 卷积网络在图像上滑动;

使用在 Imagenet 数据集上预训练的 ResNet152 作为特征提取器等。

以及下列经典网络框架:

损失函数 损失函数常用来估计模型预测结果与真值之间的差距。选择合适的损失函数,对模型效果很重要。 这部分介绍了一系列损失函数和使用场景,例如:

dice 系数:能够很好地处理不平衡数据;

加权边界损失:减少预测分割与真值之间的距离;

MultiLabelSoftMarginLoss:基于最大熵优化多标签一对多损失的标准;

具备 logit 损失的平衡交叉熵(Balanced cross entropy,BCE):以特定系数权衡正例和负例;

……

此外,作者还介绍了 Arc margin 损失、BCE 和 dice 系数的组合等等,更多详情参见原文。

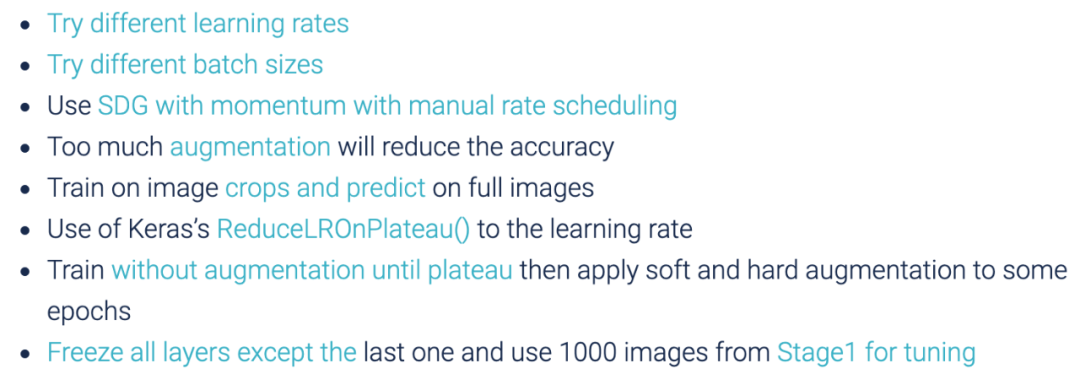

训练技巧 这部分介绍了常用的模型训练技巧,如:

尝试不同的学习率;

尝试不同批大小;

使用带有动量项的 SDG,并且手动设置学习率衰减;

数据增强过多会降低准确率;

使用裁剪后的图像训练,并在完整的图像上做预测;

在学习速率调整上使用 Keras 中的 ReduceLROnPlateau() 方法;

冻结除了最后一层以外所有的网络层,并使用 Stage1 中的 1000 张图片进行模型微调;

开发一个能使标签更加均匀的采样器;

使用类别感知采样(class aware sampling)等。

评估和交叉验证 这部分介绍了 k 折交叉验证、对抗验证和权衡等方法,以及在调整模型最后一层时使用交叉验证方法以有效避免过拟合。

集成方法 许多机器学习竞赛(包括 Kaggle)中最优秀的解决方案所采用的集成方法都建立在一个这样的假设上:将多个模型组合在一起通常可以产生更强大的模型。 这部分介绍了多种集成方法,如多数投票法、XGBoost、LightGBM、CatBoost 等方法,以及集成 ResNet50、InceptionV3 和 InceptionResNetV2 的方法。

后处理 这部分介绍了多种后处理方法:

测试时增强(Test Time Augmentation,TTA):向模型多次展示经过不同随机变换的图像,取预测平均值;

均衡使用测试预测概率,而不是仅使用预测类;

将几何平均数应用于预测;

在推理过程中将图块重叠,使每个边缘像素至少覆盖 3 次,因为 UNET 在边缘区域范围的预测往往较差;

非极大抑制和边界框收缩;

分水岭后处理:在实例分割问题中分离对象。

最后需要注意的是,这份列表给出的某些技巧可能有一定的适用范围,具体能不能用还要视数据而定。

-

图像分割和语义分割的区别与联系2024-07-17 3039

-

图像分割与语义分割中的CNN模型综述2024-07-09 3379

-

使用PyTorch加速图像分割2023-08-31 1664

-

什么是图像分割?图像分割的体系结构和方法2023-08-18 8674

-

人体分割识别图像技术的原理及应用2023-06-15 2111

-

众多常见的有效图像预处理方法2021-05-03 6378

-

基于内容的图像分割方法综述2018-01-02 1288

-

图像分割的基本方法解析2017-12-20 113883

-

图像分割和图像边缘检测2017-12-19 11904

-

图像分割基础算法及实现实例2017-12-18 9795

-

基于Matlab图像分割的研究2016-01-04 979

-

图像分割—基于图的图像分割2015-11-19 934

-

PCB缺陷检测中图像分割算法2011-06-16 1350

全部0条评论

快来发表一下你的评论吧 !