一文知道TinyML的演变

电子说

描述

TinyML是世界上最新的深度学习和人工智能技术。它增强了微控制器中运行机器学习模型的能力。

微控制器是我们几乎每天使用的许多设备的大脑,从电视遥控器到电梯再到智能音箱,它们无处不在。它连接了多个传感器、执行器(如开关和电机)。同时它拥有计算能力,可以执行嵌入式代码,从传感器中获取数据并控制执行器。

TinyML的兴起标志着终端用户享受人工智能方式的重大转变。来自硬件和软件行业的供应商正在合作将人工智能模型引入微控制器。

在电子设备中运行复杂的深度学习模型的能力开辟了许多途径。TinyML不需要边缘、云或互联网连接。它在同一个微控制器上进行本地运行,可以进行传感器和执行器的逻辑管理。

TinyML的演变

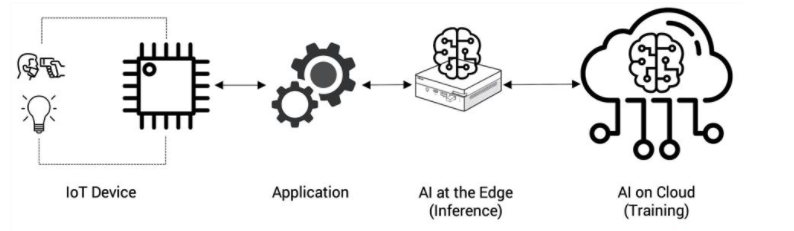

为了看到TinyML的力量,我们需要了解AI在云端和边缘的演变。

第一阶段-云计算中的人工智能

在人工智能早期,机器学习模型是在云中训练和托管的。运行人工智能所需的巨大计算能力使云计算成为理想。开发人员和数据科学家利用高端CPU和GPU来训练模型,然后利用它们进行推理。每一个使用人工智能的应用都与云通信,最终与微控制器通信来管理传感器和执行器。

第二阶段-边缘AI

虽然云仍然是人工智能的主要发源地,但它却同时引入了延迟。想象一下,每次与智能扬声器通话时,都需要云处理。往返通信中的延误扼杀了体验。其他场景,如工业自动化、智能医疗、联网车辆等,都要求人工智能模型在本地运行。

边缘计算是云和本地物联网设备之间的管道,成为本地托管人工智能模型的理想选择。在边缘运行的人工智能不会受到延迟的影响。

但鉴于边缘资源有限,训练和再训练模式仍然需要云。经过训练的模型可以托管在边缘进行推理(即使用机器学习模型的过程),但不能用于训练。因此,在云中训练模型并将其部署到边缘变得很常见。这种方法提供了最好的两个世界-一个强大的用于训练的计算环境(云)和一个用于推理的低延迟托管环境(边缘端)。

第三阶段-微控制器中的人工智能

虽然在边缘运行AI对于许多用例来说是一个完美的解决方案,但是在某些情况下部署边缘计算层是不实际的。例如,将智能音箱和遥控器等消费类设备连接到一个边缘上就太过分了。它增加了设备的总拥有成本和供应商的支持成本。但这些消费设备实实在在是人工智能发展的温床。

在工业场景中,预测性维护正成为设备的重要组成部分。昂贵的机器和设备需要嵌入机器学习模型来实时检测异常情况,以提供预测性维护。通过主动检测故障,客户可以节省数百万美元的维护成本。

将人工智能直接嵌入微控制器成为消费者和工业物联网场景的关键。这种方法不依赖于外部应用程序、边缘计算层或云。人工智能模型运行的同时,将嵌入式代码导入微控制器。它成为整体逻辑的一个组成部分,提供无与伦比的速度。

传统上,机器学习模型总是部署在资源丰富的环境中。由于TinyML模型可以嵌入到微控制器中,所以它们不是资源密集型的。这种方法是将人工智能注入到物联网设备的最有效和最具成本效益的方法。

TinyML的生态系统

虽然TinyML还处于初级阶段,但它的生态系统正在形成。芯片和物联网套件制造商,如Adafruit、联发科、Arduino和ST都在其设备中支持TinyML。微软的Azure Sphere认证的安全微控制器,也可以运行TinyML模型。Tensor Flow Lite是流行的开源深度学习框架的延伸,可以移植到支持的设备上。另一个开源机器学习编译器Apache TVM也可以用来将模型转换成TinyML。

新兴的AutoML和TinyML平台,如Always AI、Cartesiam、EdgeImpulse、OctoML和Queexo正在构建工具和开发环境,以简化微控制器的训练和优化模型过程。

TinyML使人工智能无处不在,并为消费者所接受。它将为我们每天使用的数以百万计的设备带来人工智能元素。

责任编辑人:CC

-

【先楫HPM5361EVK开发板试用体验】:4、TinyML测试(1)2023-12-22 2034

-

什么是TinyML?微型机器学习2022-04-12 12300

-

如何在 MCU 上快速部署 TinyML2022-07-19 2959

-

如何使用TinyML和Edge Impulse构建一个咳嗽检测系统2022-07-21 3920

-

带有tinyML的肩部恢复设备2022-10-26 698

-

使用TinyML来预测与气压系统(APS)故障2022-10-31 1207

-

什么是TinyML?它可以(也不能)用于什么?2022-11-28 9399

-

通过Edge Impulse开始使用TinyML2022-12-15 1522

-

开发TinyML系统必须考虑的四大指标2023-01-11 3680

-

TinyML空中森林火灾探测2023-02-09 836

-

使用TinyML开发私人教练2023-06-12 888

-

使用Esp32和TinyML进行手势分类2023-06-15 1393

-

TinyML课程#7变得更小2023-06-25 931

-

TinyML变得简单:图像分类2023-07-13 1439

-

伴随TinyML一同崛起的边缘AI生态2023-08-28 2705

全部0条评论

快来发表一下你的评论吧 !