如何优雅地使用bert处理长文本

描述

这是今年清华大学及阿里巴巴发表在NIPS 2020上的一篇论文《CogLTX: Applying BERT to Long Texts》,介绍了如何优雅地使用bert处理长文本。作者同时开源了不同NLP任务下使用COGLTX的代码:

论文题目:

CogLTX: Applying BERT to Long Texts

论文链接:

http://keg.cs.tsinghua.edu.cn/jietang/publications/NIPS20-Ding-et-al-CogLTX.pdf

Github:

https://github.com/Sleepychord/CogLTX

bert在长文本处理一般分为三种方法[1]:

截断法;

Pooling法;

压缩法。

该论文就是压缩法的一种,是三种方法中最好的。我们在科研和工作中都会遇到该问题,例如我最近关注的一个文本分类比赛:

面向数据安全治理的数据内容智能发现与分级分类 竞赛 - DataFountain[2].

其文本数据长度就都在3000左右,无法将其完整输入bert,使用COGLTX就可以很好地处理该问题,那么就一起来看看该论文具体是怎么做的吧。

1.背景

基于以下情形:

bert作为目前最优秀的PLM,不用是不可能的;

长文本数据普遍存在,且文本中包含的信息非常分散,难以使用滑动窗口[3]截断。

而由于bert消耗计算资源和时间随着token的长度是平方级别增长的,所以其无法处理太长的token,目前最长只支持512个token,token过长也很容易会内存溢出,所以在使用bert处理长文本时需要设计巧妙的方法来解决这个问题。

2.提出模型

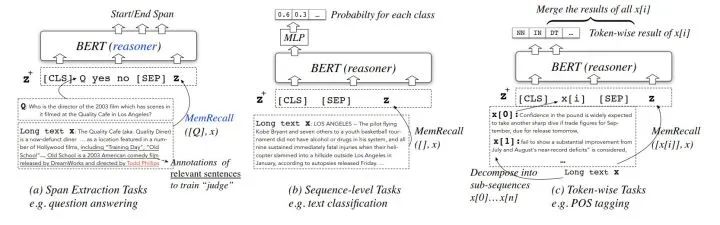

COGLTX模型在三类NLP任务中的结构如下:

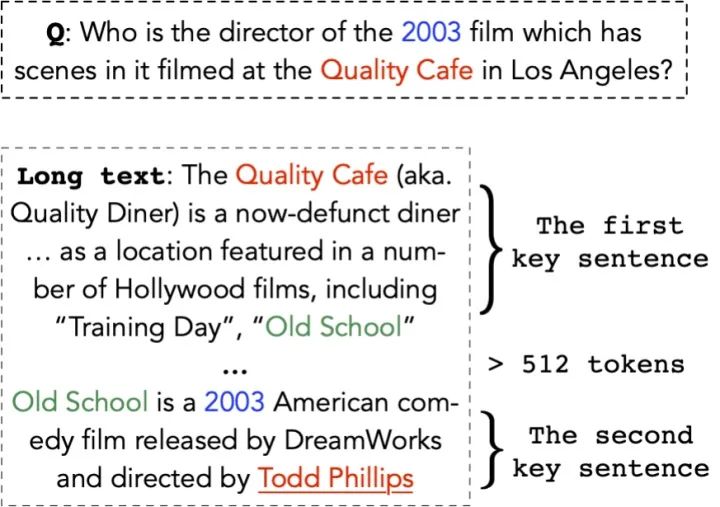

首先假设:存在短文本 可以完全表达原长文本 的语义:

那么令 代替 输入原来的模型即可,那么怎么找到这个 呢

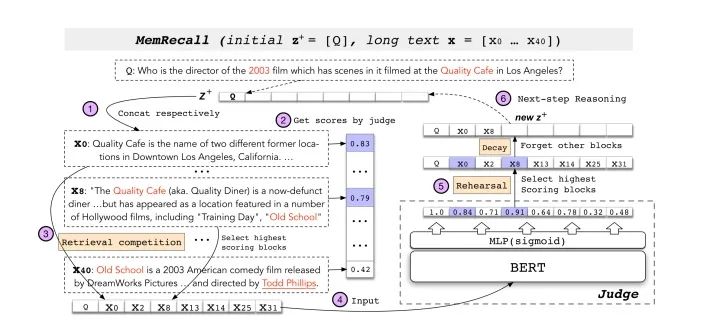

1、使用动态规划算法将长文本 划分为文本块集合 ;

2、使用MemRecall对原长句中的子句进行打分,MemRecall结构如图,而表现如下式:

从而选择出分数最高的子句组成 再进行训练,这样一来的话,COGLTX相当于使用了了两个bert,MemRecall中bert就是负责打分,另一个bert执行原本的NLP任务。

可以发现刚才找到 例子将问题Q放在了初始化 的开头,但是并不是每个NLP任务都可以这么做,分类的时候就没有类似Q的监督,这时候COGLTX采用的策略是将每个子句从原句中移除判断其是否是必不可少的(t是一个阈值):

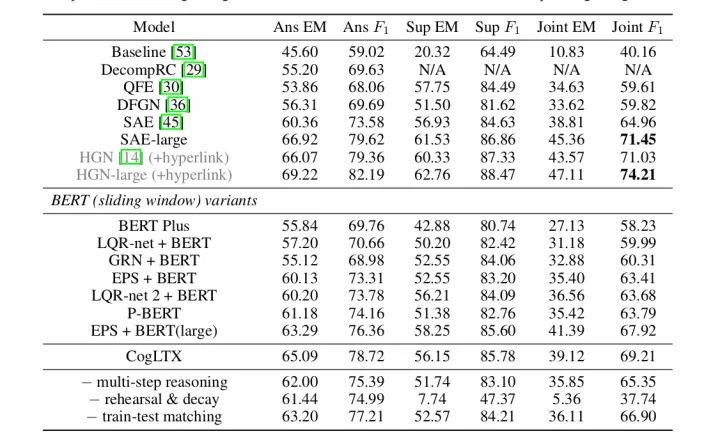

作者通过设计不同任务下的MemRecall实现了在长文本中使用bert并通过实验证明了方法的有效性。

3.实验

通过多维度地对比,证明了本文提出算法的有效性。

参考文献

[1]https://zhuanlan.zhihu.com/p/88944564

[2]https://www.datafountain.cn/competitions/471

[3]Z. Wang, P. Ng, X. Ma, R. Nallapati, and B. Xiang. Multi-passage bert: A globally normalized bert model for open-domain question answering. arXiv preprint arXiv:1908.08167, 2019.

责任编辑:xj

原文标题:【NIPS 2020】通过文本压缩,让BERT支持长文本

文章出处:【微信公众号:深度学习自然语言处理】欢迎添加关注!文章转载请注明出处。

-

阿里云通义开源长文本新模型Qwen2.5-1M2025-02-05 1044

-

讯飞星火长文本功能全新升级2024-05-06 1041

-

科大讯飞创新推出长文本、长图文、长语音大模型,解决落地难题2024-04-28 926

-

Kimi爆火背后的技术奥秘 大模型长文本能力的技术难点2024-04-17 2490

-

单日获客成本超20万,国产大模型开卷200万字以上的长文本处理2024-03-27 4911

-

快速全面了解大模型长文本能力2024-02-22 1678

-

港中文贾佳亚团队联手MIT发布超长文本扩展技术,打破LLM遗忘魔咒2023-10-18 1399

-

KUKA-C4机器人导出/导入长文本2022-07-26 3249

-

基于BERT+Bo-LSTM+Attention的病历短文分类模型2021-04-26 1860

-

一种基于BERT模型的社交电商文本分类算法2021-04-13 1316

-

结合BERT模型的中文文本分类算法2021-03-11 1741

-

给KUKA-C4机器人导入长文本方法2021-02-09 2691

-

KUKA-C4机器人如何导出/导入长文本2020-12-23 5147

全部0条评论

快来发表一下你的评论吧 !