医生在医学影像AI研发中需扮演什么样的角色?

描述

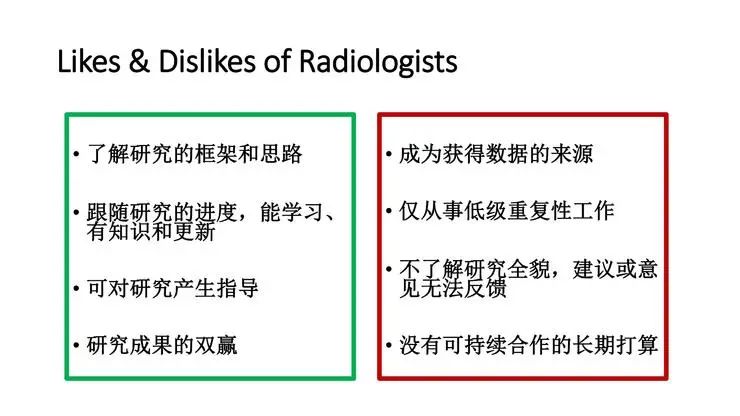

作为一个很好的伙伴,医生要了解研究的框架和思路,跟随研究的进度,能学习、有知识和更新,可以对研究产生指导,从到达到研究成果的双赢。这是我们放射科医生希望参与的事情。

近日,第四届图像计算与数字医学国际研讨会(ISICDM 2020)在辽宁省沈阳市召开。

研讨会围绕图像计算和数字医学中的一些重要的理论、算法与应用问题进行学术讨论,旨在促进电子信息(包括计算机、自动化与生物医学工程)、数学和医学等领域学者的交流与合作。

本次研讨会由国际数字医学会主办,东北大学和中国医科大学联合承办。

在12月5日下午举行的“智能辅助诊疗论坛”专场,北京和睦家医院陆菁菁教授向与会者分享了题为《医学影像人工智能研发之管窥:医生的角色》的精彩专题报告。

作为AI技术的前沿观察者与参与者,陆菁菁教授毕业于北京协和医学院,后进入北京协和医院放射科工作,历经住院医、住院总、主治医、副主任医,现为主任医师、硕士生导师,2010年5月至2011年5月为哈佛医学院麻省总医院访问学者。

目前,陆菁菁教授担任北京和睦家医院放射科主任。

以下为陆菁菁教授的演讲内容,雷锋网《医健AI掘金志》作了不改变原意的编辑:

陆菁菁:感谢大会的邀请,我今天分享的题目是《医学影像人工智能研发之管窥:医生的角色》。

现在医学影像AI的研发方兴未艾,许多产品逐步被打磨以进入临床。同时,一些新的临床问题被提出,亟待进一步研究。

医生在医疗AI产品研发中的角色非常多样,可以做最基础的的数据标注,也可以做临床架构的建议,医生还可以是使用者、建设者,甚至是执行者,同时也可以做PI(principal investigator,主要研究者)。

那么,医生对于目前AI的产品研究有什么样的评价?

作为医生,怎样才能参与到AI的研究中,如何实现双赢的长期合作关系?

医生如何看待医学影像的未来?

首先,我想分享一下对于近5、6年AI研发的进展,医生秉持着什么样的态度。

我觉得医生是有一种微妙的情感变化的。其次,对于医生扮演的角色,我会通过本人以及团队参与的所有AI项目,分享其中的一些体悟。

最后,我想给大家提出一些建议,理工研发人员和医生合作时,怎么样才能成为医生的好朋友,让医生成为对项目更有建设性的人。

医生态度的转变

从这张图,可以很清楚地看到医生态度的转变。

从2016年开始,以AlphaGo为代表的深度学习技术,在一部分领域产生了摧枯拉朽的改变。从机器远不及人,到逐渐完全打败人类的成就来看,一些技术狂人认为深度学习将很快取代放射科医生的工作。

对于此种言论,医生小小不屑的同时,也很好奇正在发生什么。

2018年,由国家神经系统疾病临床医学研究中心宣布举行了全球首场神经影像人工智能人机大赛举行。

人类这边,由25名全球神经影像领域顶尖专家、学者和优秀临床医生组成,在两轮比赛中,BioMind分别以87%、83%的准确率,战胜医生战队66%、63%的准确率,人类完败。

听到这个消息时,我真的感到了一丝恐慌,怀疑医生是否真的不如神经网络。

因为我记不住那么多文献知识,也没有看过神经网络训练那么多的医学图像,也许神经网络真的可以取代我的工作。

在我详细了解了比赛以及评分规则后,发现比赛规则既不成熟,也不透明,更像是一个商业广告的炒作。

在过去的两年里,我们发现人工智能确实能做不少事情,比如对骨龄的测试、小结节的诊断,对血肿大小的判断,还有对糖尿病视网膜病变筛查以及前列腺的分割都可以做得很好。

但是,AI往往在单任务上表现得非常出色,但能做的多任务范畴的工作非常有限,而且有时候会犯一些很低级的错误。

因为人具有抽象和直观的两种判断,看到一个图像感觉不对劲,就会通过仔细研判、结合病史,给出一个有经验的、综合推理后的分析。

这就是经验良好的医生和缺乏经验的医生可能存在的一些区别。我认为,人类智能和机器智能目前仍然存在一定的鸿沟。

到现在2020年了,医生发现自己能从AI技术中受益良多,比如利用影像组学可以发表很多文章,将AI软件应用在临床当中,例如肺小结节的检测、前列腺的勾画,可以帮助我们减少很多的工作量。

我们对于AI秉持着拥抱的态度。

在去年的RSNA上,大家一致的观点就是,掌握AI的医生比不掌握AI的医生更加厉害,这是我们医生态度上的转变。

我和我的团队参与了很多合作项目,从基础的数据标注、审核,到解剖病灶的勾画。

十几年前,我在麻省总医院参加神经影像项目,进行CT图像上的脑血肿勾画,这个项目是想证明血肿扩大速度快的人预后较差。

我的工作就是没日没夜的勾画边界。当时我就认为,这个项目可以通过AI对血肿密度高低的边界加以区别。现在,已经诞生了这样的软件。

此外,我们参与的其他合作还包括对肺叶、肺段的解剖。

第二个,数字人薄层图像,比如2019年重庆的数字人项目。解剖学的老师就希望,建立一个真正的人体断层及其CT图像的关联。

我们要帮助他画出这个结构,在CT图上也画起来,然后做成一个网页,作为教学网站或者是科研的基础。这个事情说起来很有价值,但是做的工作还是相当琐碎。

另外,我们还有一些参与临床实验的工作。比如,病人在接受靶向药或者免疫治疗三个月以后,医生需要观察病人身上的肿瘤变化,包括多范围肿瘤的大小以及淋巴结的变化。

做这些项目时,CRA公司需要招募具有相应资质的医生。比如看妇科肿瘤的医生就只招收妇科肿瘤专业的,而且还要能证明在这个领域具有相当的造诣,发表过相应文章或者在学组担任委员。

而医生的具体的工作就是找肿瘤、画大小,然后象征性地得到一定的劳务费。

稍微高级别的医工合作,包含了3D打印、盆腔核磁结构的自动识别,相对基础的减影图像比较等等,这也是我们医生可以完成的。另外,还有像田捷教授他们所做的影像组学和影像基因组学。

而最高层级合作,就是研究者PI(算法PI和临床PI)的合作。

医工结合的四个小故事

我就以参加的这些项目,跟大家讲四个故事。

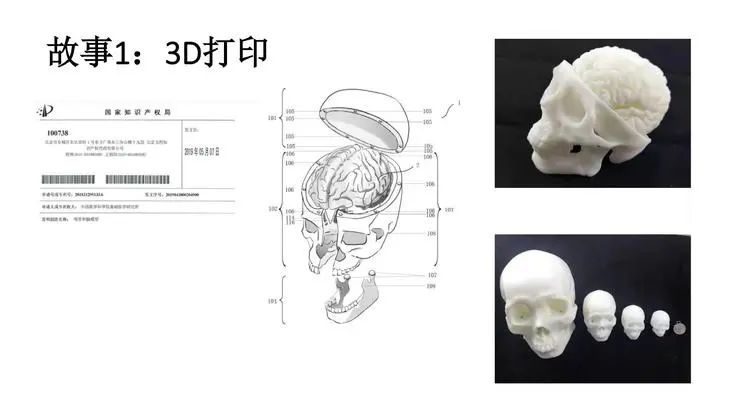

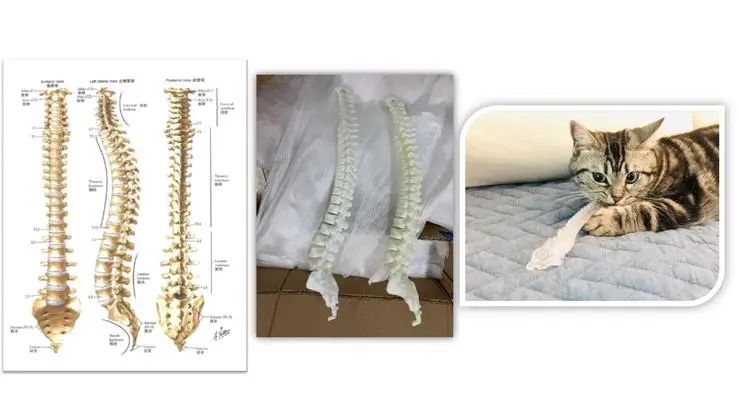

第一个故事:3D打印

现在CT的图像能扫得特别薄,再加上3D打印技术的出现,这使得打印一个颅骨成为一件理论上很容易的事情。

此前,协和医学院解剖学系的主任找到我想做一个3D打印的颅骨模型,给每个学生课余时间进行学习和熟悉。在以前,这样的模型是很难获取的。

当然,我们并不想靠非法手段获取数据。解剖学系主任对自己进行了一次CT扫描,图像处理专家拿到之后进行分割。因为骨骼的密度和周围组织相差很大,所以分割起来比较容易。

但是颅底有很多的血管孔、神经走向,需要人来一点点抠细节。

这个想法很有创意,产品也有一定实用价值,我们很容易的申请了这个专利。

实际上,这个脑壳里面的脑子的三维模型不是从CT图像得出来的,而是同一个人的核磁图像,通过脑分割的方法做了个STL的文件,同时合成起来。

之后,我们就开始做脊柱的3D打印模型,继续申请专利。我觉得合作的这个项目非常简单,且容易上手、有趣。

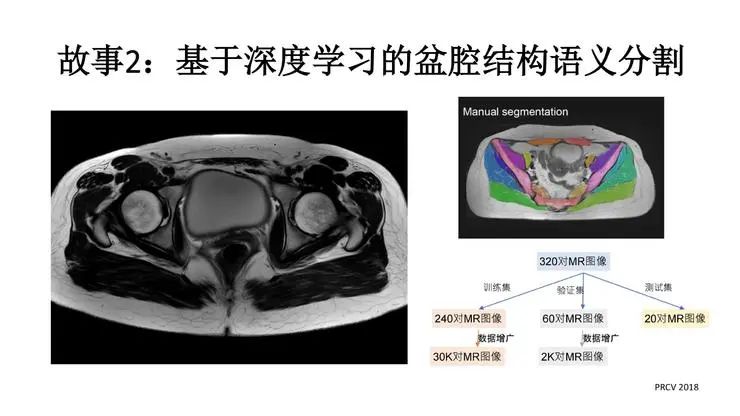

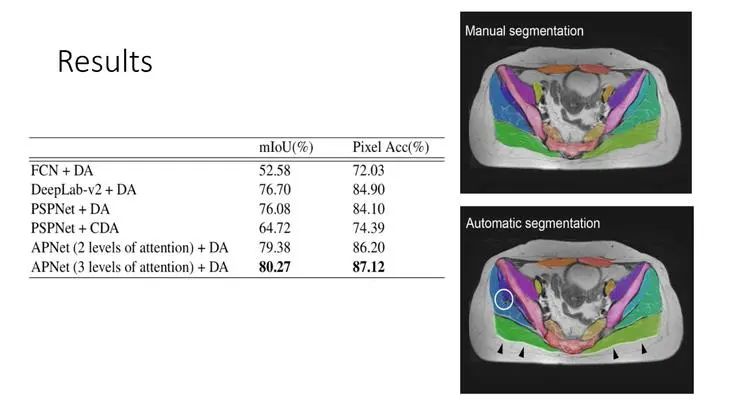

第二个故事:基于深度学习的盆腔结构语义分割。

这是我们源于临床的问题。在协和的时候,我们每天会签100多份CT和核磁的报告,各个专业(头部、胸部、盆腔、骨关节)的都有。

上面这一张是经过双侧股骨头层面的盆腔磁共振图像,里面有膀胱及周围各种骨骼和肌肉。

如果不是经常看肌肉、关节的医生,常常会对这些结构搞不清楚,比如哪些是缝匠肌,哪块是内收肌,还是长收肌、短收肌;臀大肌、臀中肌、臀小肌区别还好记,其他肌肉时间一长就糊涂了。

正常的人体解剖都是一样的,死记硬背就好了。机器学习或者深度学习应该在这些方面发挥相应的作用。

提出这个想法后,我和我的学生一起去勾画结构,这很费时。因为,一个病人有20层图像,每层图像上有五六十个结构。

如果是手动将结构分割出来,每一套图像就要花费一星期的时间。当时,我们的逻辑是数据越多越好,训练出来的神经网络性能就会更好。

最后,我们完成了16个病例,分成了训练集、验证集和测试集,再进行网络训练。

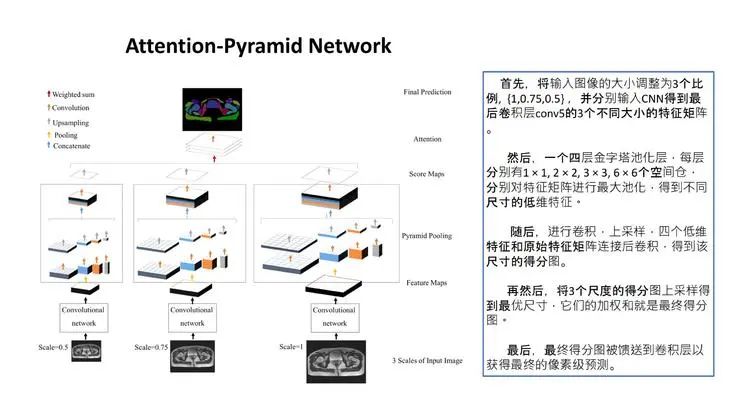

训练采用的是注意力金字塔网络,就是数据增广,然后进行卷积、上采样,之后又引入注意力机制。

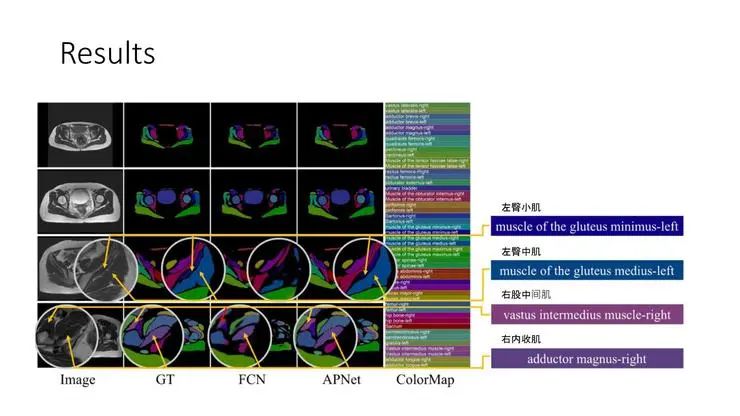

得到的结果还是令人满意的,对比原来的图像,一个是ground truth,一个是对照的FCN的网络,我们所做的APNet网络得到的结构分割,包括臀大肌、臀小肌、股中间肌和内收肌,都比FCN网络要好得多。

在定量的mIoU的参数上,加入三重的注意力机制的分割会达到最好的效果。我们还比较了手动分割ground truth和机器分割出来的差异。

最后,负责算法的老师投递了大会摘要,并且得到了发表。在2018年第二届ISICDM大会上进行了汇报,并且将数据集贡献给第三届大会作为比赛用数据,我们也因此结识了更多的合作伙伴。

但是对我们医生来说,这个研究由于没有后续的算法创新,我们在此基础上做的临床应用的文章比较难发表,这是我们觉得有点儿遗憾的方面。

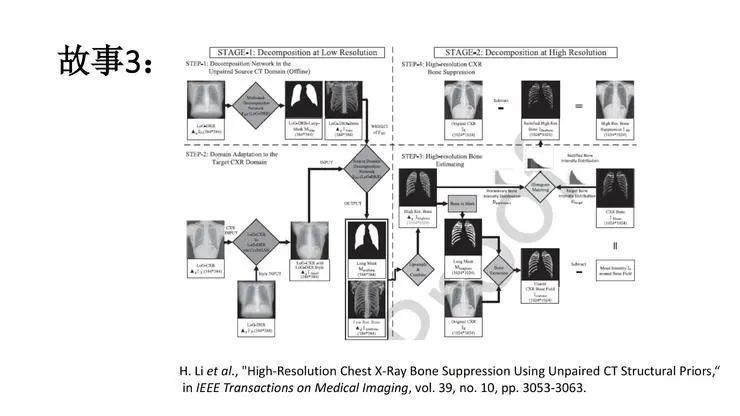

第三个故事:与中科院计算所周少华博士的合作。

在拍胸片时,我们会在图像上看到肋骨和肩胛骨,尤其是肋骨,如果重叠在肺纹理上,将会对病灶进行干扰,影响对病灶的观察。

我们希望在胸片上去掉肋骨,但一般是没有双能量的胸片,如果有双能胸片,通过能量减影将其减掉。

因此,我们用了一个比较巧妙的方法,用非配对的CT结构的prior,算出骨骼的影子,在低分辨率上先做减影,进行上采样以后,在高分辨率上又进行减影,达到一个非常好的效果。

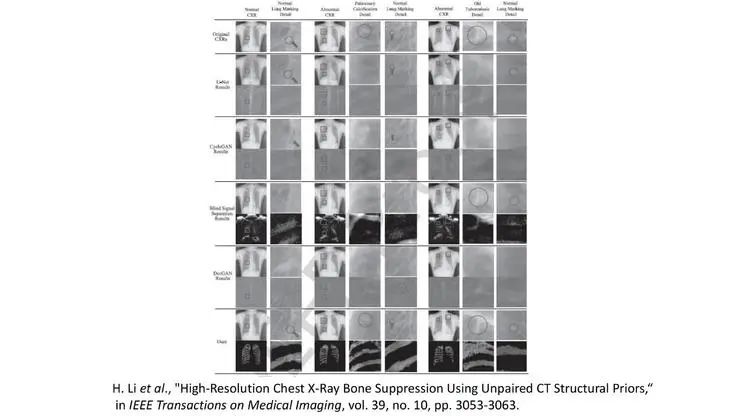

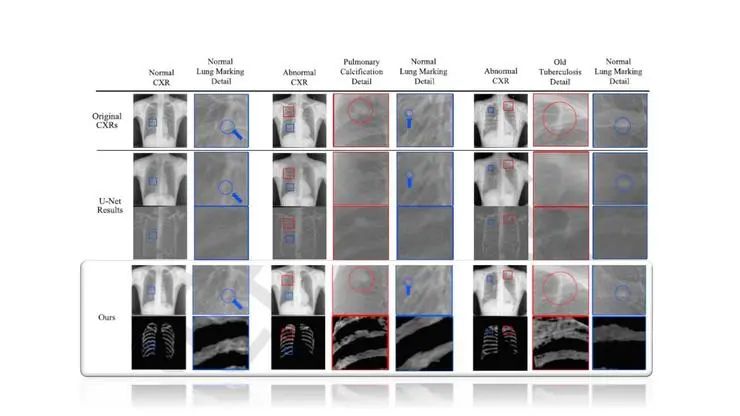

如图所示,上面一行是胸片图像,第二行和第三行是U-Net的结果,最下面是我们算法的结果:

从传统的图像上,可以看见肺纹理和肋骨是重叠在一起的,经过去骨以后,我们只看到了肺纹理。

在钙化的显示上,我们算法的钙化显示就相对清晰,而且骨头抑制的也非常好,但是其他算法的效果就差强人意。

另外,我们还拿结核病灶进行了演示。当胸片有骨头挡着的时候,结核灶是什么样的?经过一些不好的减影之后,结核灶显示不太清楚,但是在我们的算法上,骨头被抑制下去,结核灶显示更清楚。

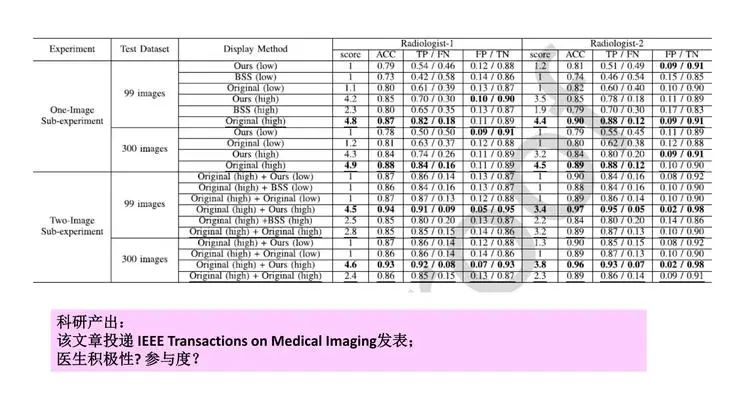

医生的工作就是比较不同的算法,比较低分辨率和高分辨率图像,去骨的图像和不去骨的图像,以及不同算法效果下呈现的图像。

当时,我们找了有两年工作经验的研究生和十二年工作经验的进修生,分别对这些图像进行了判别。虽然看起来只有99幅图和300幅图像,但是通过不同的组合产生了无数的图像,每个片子大概要花4~5秒,让这些医生进行打分。

文章的结果最后发表在IEEE Transactions on Medical Imaging杂志上。

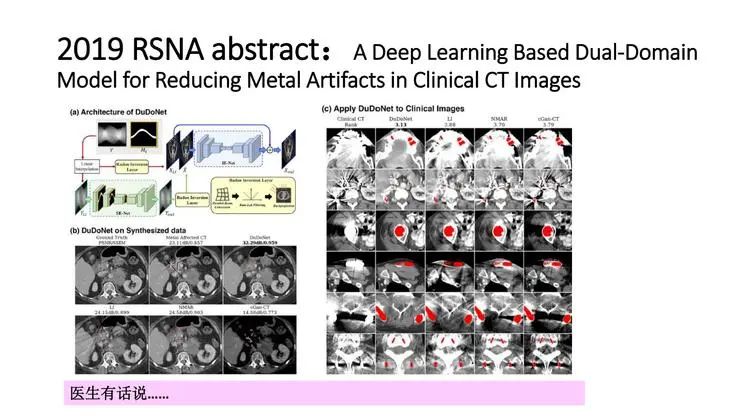

另外一个案例是去伪影的算法。

算法团队请我们比较图像并进行评价,用的是Excel表,双盲的设计非常好,对伪影去得好坏与否进行打分。

在打分时我们发现一些问题:有的算法虽然将伪影去得好,但是把重要的结构也去掉了,比如想看小关节或者想看脊柱里的脊髓,虽然伪影去得很漂亮,但是其中一些重要结构也看不清楚了,但是在我们反馈意见的时候,没有很多人注意到我们的想法和需求。

这是未来医工合作还需要进一步提高的地方。

如果双方能够更好、更深入的交流,并且将医生的建议放在方法设计的过程中,相信会对文章将来的高度有所帮助,更贴近临床的需求。

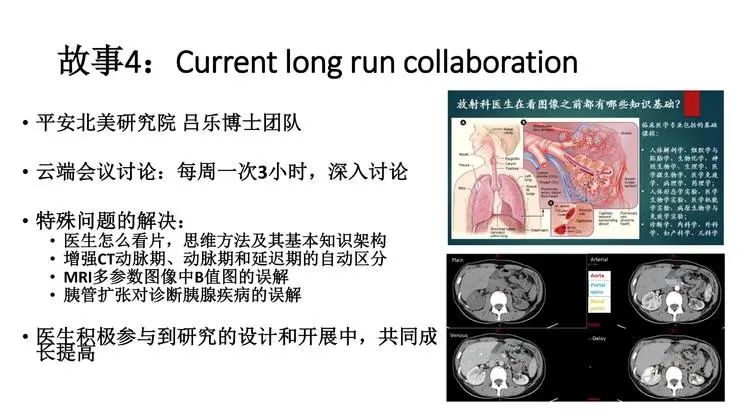

最后一个故事,是与平安北美研究院吕乐博士进行的长期合作。

我们和吕乐博士的团队每周都会花3个小时,在云端会议上讨论目前合作进程中存在的一些问题。比如我会分享放射科医生如何看图像,为什么放射科医生觉得,AI不能像医生一样进行疾病的诊断。

这是因为,疾病当中有很多同病异影。

不同的病种都可以表现成磨玻璃结节,比如COVID-19可以是磨玻璃的病灶,心衰或者肺梗塞时同样是磨玻璃病灶,所以光看图像是不够的。

医生要学习很多基础性的东西,包括解剖、生理、药理、病理等等知识架构,这样才会指导将来的诊断、经验分析以及总结归纳,然后运用于临床。

将来,人工智能的开发更需要人类的逻辑对其进行指导。吕乐博士的团队也认识到,在神经网络的构建时,简单加入一些医生的逻辑,有时候会达到非常好的效果。

比如对一个图像的鉴别,在Deep Lesion数据集里有很多期的图像混在一起,要挖掘里面的病灶是很困难的。

而比如肝癌的特征表现,从动脉期、门脉期到延迟期,是个动脉期会快速增强、门脉期快速廓清的,自有其规律在其中。

如果完全混在一起,深度神经网络就很难发现问题所在。

所以在训练模型的前期,最好能对图像进行分类,例如哪些是动脉期、哪些是门脉期、哪些是延迟期?

我们医生提出的一个非常简单的参考经验就是:看主动脉、门静脉和肾盂里面对比剂的分布,以区分是什么时相。

因此,在医生的提示简单总结一个逻辑,对不同时相的图像进行分类之后,课题的进展非常好。医工合作中,那种共同成长的感觉非常不错。

医生如何在AI研发中成为良师诤友

今年的RSNA2020上,一个叫唐有宝的同学获得了informatics category的最佳论文奖。

在他提出的算法里,在病灶的周围点个小点,算法就能够自动测量病灶的最大径和最短径。

他为什么会得到最佳论文奖?

这是因为,搞研发、药物研究的人都特别认可这件事情。针对药物是否有用的时候,医生经常要做大量、枯燥的测量工作,需要一层层翻图像、一层层测量,以判断肿瘤对药物是否有反应。

有了这个算法,我们就可以节省大量的人力。这也是他能拿到最佳论文的原因。

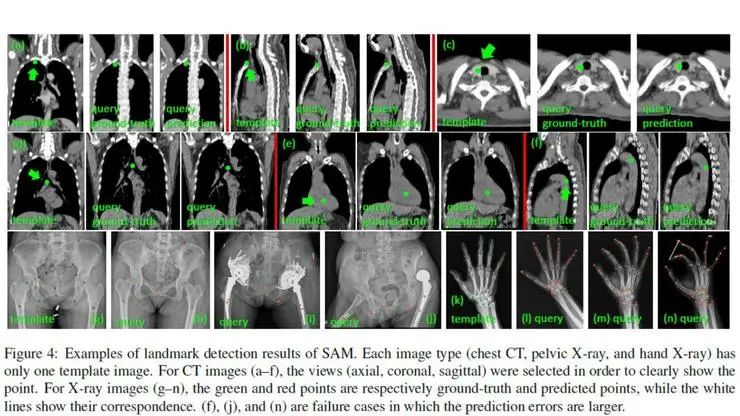

另外,我给大家介绍一个很好的研究——Self-supervised Learning(自监督的学习)。

之前谈到盆腔的时候,我花费了大概好几个星期,才勾画了十几例的图像,训练网络让它知道肌肉长在什么部位。

但是,自监督学习的方法,用一张或者是非常少的图像,就能定位到这个人的肌肉部位。

从理论上来讲,人的头、鼻子这些特征,机器很容易学出来。如果这个点放在左侧锁骨的中间,那么下一个人可以同样点到锁骨的中间,一些内在的、很简单的逻辑存在其中。

在这个算法里还做了一些验证,比如在不同的图像里。在X光里面做,只用到一张标记的图像就达到了更好的效果。

这是一个效果图,有template,然后是ground truth。

这是模板,其中有ground truth,预测也在相同部位。自监督学习做到了用非常小的样本做出解剖学定位的效果。

我觉得,自监督学习跟人的学习逻辑有点类似。人不用学很多的东西,这是因为人脑有一个内在、全局的观念。

利用Deep Lesion做一些病灶匹配的测试。第一次检查、第一次随诊时,AI同样可以定位到相同的位置,这也很有帮助。

从医生的角度而言,在对比老片的时候,我们需要知道病灶原来的位置,现在要找到新的病灶并且进行上下匹配,随后进行测量。如果人工智能可以做到,对我们的帮助是非常大的。

分数比较高的就匹配得比较好,相反就是不太好的。比如在最左下角的三幅图像上,在左边的腮腺旁边绿圈就是ground truth,但是算法预测却匹配到主动脉弓上了,就得出0.64的分数。

在这篇论文中,吕乐博士团队提出的算法既可以找到病灶,也可以匹配病灶。此外,还能测量病灶,我觉得很有帮助。

我们见证了这篇文章的发表,也获得了MICCAI、CVPR、RNSA等顶会的摘要,收获非常大。

在与吕乐博士团队的合作过程中,我们还有很多反馈建议的机会。他们的服务器部署到我们医院后,我们也会补充进更多的数据集,把我们的使用感受或者研究建议及时地进行交流。

最后,我对今天的分享进行一下总结。

医生的角色是多样性的,可以是使用者和建设者,也可以是监督者和引领者。

医生能做的具体帮助也非常多,从基础工作开始,医生可以提供数据、对数据解剖标注,对图像进行真伪判别,还可以帮助改文章,协助回答医学审稿专家的问题,对算法的开发提出建议,共同把握研究的方向,提出临床问题,将来也可能是临床验证的主要实施者。

作为一个很好的伙伴,医生要了解研究的框架和思路,跟随研究的进度,能学习、有知识和更新,可以对研究产生指导,从到达到研究成果的双赢。这是我们放射科医生希望参与的事情。

相反,医生不希望仅仅只是成为工程人员获得数据的来源,或者是从事重复性的工作,不了解研究的全貌,我们的想法无法反馈,或者没有可持续合作的长期打算。这些是我们放射科医生不喜欢的。

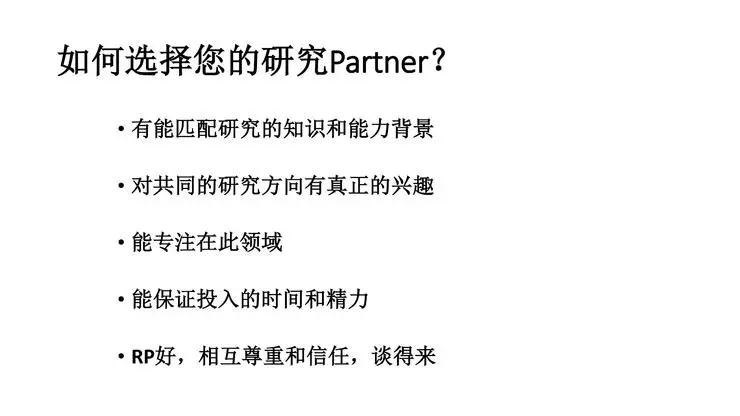

最后,如何选择研究的合作伙伴。理工的PI会选择医生,我们医生做PI在选择对方时也是这样的,要有一些能够匹配研究的知识和能力背景,对共同的研究方向有真正的兴趣。

而且,我们希望理工团队能够专注在这个领域。有的PI会有很多的AI项目,如果他的精力不能专注,就很难在一个方向上保证投入的时间和精力。

当然在选择partner时,相互尊重、谈得来,也都是非常重要的。

用李纯明老师的话来结尾:“‘理工医交叉融合,产学研协同创新’永远是医疗AI领域发展的生命线,只要我们围绕这一根基不断纵深,它所释放出来的能量密度是无穷无尽的。”

原文标题:北京和睦家医院放射科陆菁菁:医生在医学影像AI研发中,需要扮演什么样的角色?

文章出处:【微信公众号:IoT科技评论】欢迎添加关注!文章转载请注明出处。

责任编辑:haq

-

医学影像设备学发展记录2009-11-30 4188

-

医学影像发展历史2017-07-27 5447

-

基于挂片协议的医学影像显示系统架构2012-01-10 943

-

AI医学影像市场竞争激烈,第三方影像中心得到大力发展2018-06-21 7110

-

浅析人工智能在医学影像的应用难题2018-08-16 5864

-

AI在医学影像的应用快速发展 在技术和商业化上成果不断涌现2019-03-29 2052

-

2019年是人工智能医学影像的落地之年2019-08-07 2337

-

人工智能与医学影像的完美结合2019-08-09 7152

-

2019年将成为AI医学影像的落地之年2019-08-28 1824

-

众多医学影像AI企业开发了相关的医学影像AI产品2020-06-15 1044

-

医学影像AI闯入医学界的心路历程2020-09-29 3415

-

基于 U-Net 的医学影像分割算法2021-08-25 6016

-

基于VC + MSSQL实现的县级医院医学影像PACS2023-05-12 1344

-

医学影像设备包括哪些设备 医学影像设备发展历程简单介绍2023-08-10 11560

-

医学影像四大设备是什么 医学影像的作用和存在意义2023-08-29 19837

全部0条评论

快来发表一下你的评论吧 !