如何在3D机器视觉应用中利用DLP?

电子说

描述

TI为机器视觉摄影镜头提供了一些非常不错的参考设计。TI为3D机器视觉提供的一种独特的解决方案,利用了其数字光源处理器(DLP)技术。透过图5中的例子可以看到,如何可在3D机器视觉应用中利用DLP。

图5 针对3D机器视觉的DLP解决方案。

除硬件外,TI还提供DLP结构光软件开发工具包(SDK),以及基于其TIDA-00254的3D机器视觉完整参考设计。

ADI

ADI选择为条形码扫描仪开发解决方案。机器视觉系统设计因为需要辨识和读取大量的各类标签,而无论其大小、形状、颜色或条件如何,所以需要使用这类基于影像的系统。该公司认为条形码扫描仪市场目前正在从基于雷射的系统转向成像解决方案,从而获得更高的扫描分辨率、吞吐量和专一性。为此,嵌入式处理器需要进行边缘检测与分类,腐蚀、膨胀、复位位和感兴趣区域选择,以及扫描算法包含颜色和模板匹配部分。

在机器视觉摄影镜头领域,要求摄影镜头本身就能实时检测缺陷或异常,Blackfin DSP的分析处理功能可以提高效率,并提供更具成本效益的线扫描和故障检测解决方案。

ADI还推出了一款六足蜘蛛机器人,它可以部署在对人类来说过于危险的恶劣环境中,例如地震或其他自然灾害地区。

协作型机器人

机器人将在智慧工厂和太空中与人类一起工作,这类协作型机器人被称为cobot(collaborative robot的简称)。计算机视觉和影像辨识的新技术进步,将帮助这些cobot避免与其人类同事相接触。VEO Robotics是一家为工业cobot开发感知和智慧方案的公司典范。

NASA自动漫游车的机器视觉

现在我们来看看NASA用于自动漫游车的机器视觉技术。最新的火星漫游车是Mars 2020 Rover,它有一个非常独特的”SuperCam”—不像大多数其他机器视觉摄影镜头那样看影像,而是使用红外线和绿色激光束来远程分析土壤和岩石等材料的化学成分。使用的技术是雷射诱导击穿光谱法(LIBS),利用漫游车上的远程RAMAN光谱系统进行矿物分析(图6)。欲了解更多信息,可参阅《”SuperCam” Update: Multi-purpose Instrument Coming Together for 2020 Launch to Mars》一文。

图6 Mars 2020 Rover使用SuperCam。

使用机器人视觉的创新和教育应用

6自由度机械手

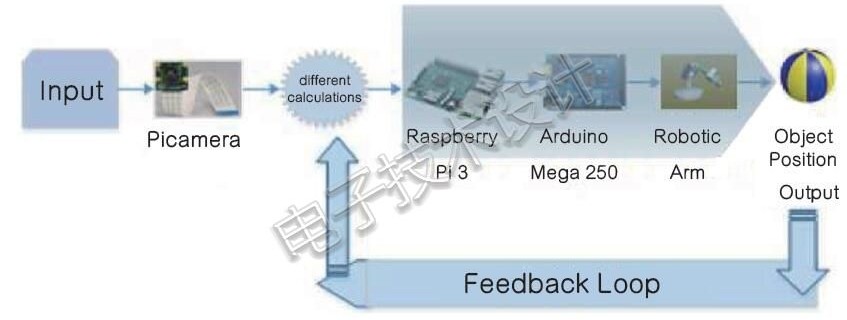

人工智能正在成功地应用于计算机视觉系统,特别是机器人视觉(robotic vision)。计算机视觉可以获取、分析、处理和理解影像,《Computer Vision Based Object Grasping 6DoF RoboticArm Using Picamera》一文中提供了基本的机械手臂设计,它可以在特定位置执行起吊、运输和卸放物体等多种任务。这个机械手臂与基于摄影镜头的3D视觉系统相配合—该系统连接到一台具有视觉算法功能的计算机,能够辨识物体的变形,以及空间协调,从而使机械手臂能够遵循特定程序来完成其任务。

这种机器人设计使用了Picamera—这是一款官方的Raspberry Pi产品,能够拍摄照片、录制视讯,并可将所用影像特效用作输入(图7)。

图7 系统框图。

计算机视觉算法

这个系统设计使用了两种算法:算法1用于辨识红色物体,而算法2可在将物体位置与机械手臂手爪位置进行比较时,与机械手臂一起辨识物体位置。

这是初学者学习机器视觉或计算机视觉和机器人技术的一个相对基础的例子。这个示例利用将机械手臂的所有轴聚焦到所需对象来执行一些不同的基本功能,并可在所需位置对其卸放。

配备机械手臂的轮椅

这个例子比前一个例子复杂一点。该设计将帮助有医疗运动障碍的患者执行日常任务。由于患有上肢肢体疾病(如帕金森氏症)的患者手动控制机械手臂会比较困难,因此这种设计可以使他们受益,将使用计算机视觉的自主手臂安装在轮椅上是基本的思路。

机械手臂具有6自由度,并结合计算机系统和两个视觉传感器安装在电动轮椅上。一个传感器使用计算机视觉算法,检测架子上随机所放有色物体的粗略位置;第二个传感器透过确保物体准确放在手爪前以提供物体的精确位置。手臂将自动抓取有色物体,并将其交给使用者(图8)。

图8 安装在电动轮椅上的机械手臂。

这种机械手臂是由Trossen Robotics开发的PhantomX Reactor机械手臂套件。它使用的Arbotix-M机器人控制器是由Trossen自行开发—这款微控制器与Arduino兼容。为了透过计算机与手臂通信,设计人员使用了python串口访问库PySerial。

视觉传感器

两个USB网络摄影镜头视觉传感器用于物体检测。视觉传感器1是罗技HD c920网络摄影镜头,安装在面向架子的机械手臂上方,这样可以撷取手臂和架子的视讯以便进行实时的粗略定位,利用对视讯讯框进行处理即可定位目标对象的X和Y位置。视觉传感器2是一个机器人VGA网络摄影镜头,使用200mm鹅颈管安装在手爪上方,这一视觉传感器用来撷取目标物体的近距离特写视讯。计算机视觉算法负责寻找并抓住对象物体,并将其拿到使用者面前,交给使用者。

Cartman

澳大利亚机器人视觉中心(ACRV)团队成功设计了一款用于自动仓储的取放机器人Cartman,而赢得了2018年亚马逊机器人挑战赛(Amazon Robotics Challenge)冠军。

对于机器人来说,从杂乱的随机物体堆中选择一件特定物体是比较困难的事。这个项目则更加先进,可以用于家庭清洁,或先进的空间相关样品退还任务,图9显示了Cartman的组成部分。

图9 Cartman设计有两个6自由度机械手臂。其手腕上安装有一个摄影镜头,以及两个效应器工具(抽吸工具和平行夹持机构),框架上安装了第二个摄影镜头,对红色背景幕布区域的物品拾取进行二次拍摄。

摄影镜头

由于要安装在机器人的手腕上,英特尔RealSense SR300 RGB-D摄影镜头因其体积小和重量轻等优点而被选中。这款摄影镜头使用摄影镜头中的红外线投影仪来确定深度;另一个RealSense摄影镜头安装在机器人的框架上,用于对所拾取的物品进行第二次分类检查。

这次比赛中一个有趣的挑战是,机器人要拾取的物品仅在每次竞赛开始前45分钟才提供给参赛团队。这为深度学习带来了挑战。这个获奖团队选择在一组最小的未见物品数据上微调其基础RefineNet网络,该团队开发了一个半自动数据收集流程,而使他们能够收集到每个未见物品七个独特姿势的影像数据,并创建带标记的数据集,从而在7分钟内对网络进行微调。在比赛期间,微调是在Intel Core i5-7600计算机和四片Nvidia GTX1080Ti显卡上进行。

从挑战赛可以看出,该团队意识到,机器人系统的性能仍然有很长的路要走,才能达到人类的水平(人类可以做到大约400次拾取/小时,而Cartman只能执行大约120次/小时)。他们认为以下两个特性对于赢得挑战比赛至关重要,对设计能够在现实世界中使用的自动机器人系统同样重要:

•采用专注于系统级整合和测试的设计方法,可以帮助优化竞赛表现;

•需要设计强健且能处理错误的高阶逻辑。

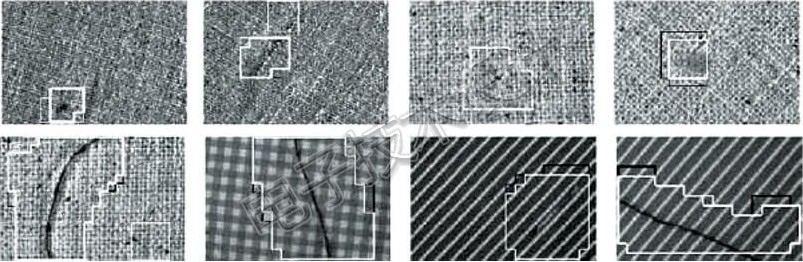

机器视觉在纺织检验中的挑战

Teledyne Dalsa拥有不错的区域扫描、线扫描、TDI线扫描、智能和红外线摄影镜头系列。他们已经接受了在要求苛刻的纺织产业中使用机器视觉的挑战,即要求成品不能有结构性和表面缺陷,这是一项艰巨而复杂的任务。

机器视觉主要用于恶劣工业环境中的工业摄影镜头。在纺织产业,生产线可能每天24小时运作,材料又可能在这样的生产在线以高达120公尺/分钟的速度移动,同时要求保持产品有高度的一致性和质量,这样才能提高效率和利润。

这种工作中所采用的摄影镜头通常是线扫描摄影镜头,其单行画素可用于对快速移动材料创建连续的2D影像。这些摄影镜头特别适用于连续布料成像,同时可以检测出图案、颜色和纹理的变化,以及材料中的缺陷。与面扫描摄影镜头相比,这类摄影镜头在提供高速无污渍影像方面表现出色,具有很好的处理效率和更低的每画素成本。

较新的多线扫描摄影镜头与不同的LED光源相结合,可以检测沿生产线快速移动的纺织品在整个长度和宽度上的一系列缺陷,整个视场角范围内的照明应该是均匀并且具高密度。

《A New Look: How Machine Vision Is Changing Textile Inspection》一文中指出,”线扫描摄影镜头产生的数据通常用于创建2D影像,或自动创建一张图,用来准确显示缺陷位于纺织品表面的位置,质量控制检验员可以查看这张缺陷图来确定其有效性。质量控制检验员所寻找的一些典型缺陷包括水损坏、印刷错误、异物纤维、油斑等,然后,图像处理软件对影像或缺陷图进行分析,来对所检测纺织品构建虚拟切割方案。这个过程可使制造商在实际切割纺织品之前虚拟地构建一个切割方案,从而能够以最小的缺陷达到最大产量。一旦生成了理想的切割方案之后,制造商就可以据此实施,并准备纺织品的出货了。”

图10 检测结构性缺陷。

机器人正与人们一起工作,它们可以看到许多人类无法看到的东西,处理大量数据的速度要比人类大脑快几个数量级。他们有眼睛、耳朵、语音,以及嗅觉和感觉能力,可以走路、交谈、抓取,并执行复杂的功能。我们正在进入人工智能的时代,这是机器人推理的开始,但我们是这项技术的创造者和主人,有责任确保创造用于正当目的,同时需要重新培训可能因先进技术而失去工作的人。技术是好的,但作为技术的监护者,必须保持它们在社会中的地位,同时确保为每个人创造更美好和更成功的世界。

责任编辑:pj

-

DLP160CP DMD是否可以应用于机器视觉应用?2025-02-20 404

-

适用于3D机器视觉的高度可扩展的TI DLP技术2024-08-23 522

-

3D机器视觉基本原理及应用场景2023-06-02 4831

-

为什么要选择3D机器视觉检测2022-12-26 1635

-

面向3D机器视觉应用并采用DLP技术的精确点云生成参考设计2022-09-22 2616

-

面向3D机器视觉应用并采用DLP技术的精确点云生成2022-09-08 766

-

TI DLP技术在3D扫描中的应用介绍2019-03-01 4947

-

采用DLP结构光的3D机器视觉参考设计包括BOM及框图2018-10-15 5376

-

采用DLP技术的3D机器视觉参考设计包括BOM2018-10-12 4165

-

TI DLP®技术在3D机器视觉的应用介绍(1)2018-08-22 4623

-

探讨TI DLP® 3D机器视觉技术应用2018-08-13 5102

-

面向3D机器视觉应用并采用DLP技术的精确点云生成_原理图2016-11-22 1530

-

3D技术的应用探索3D机器视觉库2016-03-22 1120

-

关于3D DLP技术的技术解答2014-07-11 9515

全部0条评论

快来发表一下你的评论吧 !