简述OpenVINO™ + ResNet实现图像分类

描述

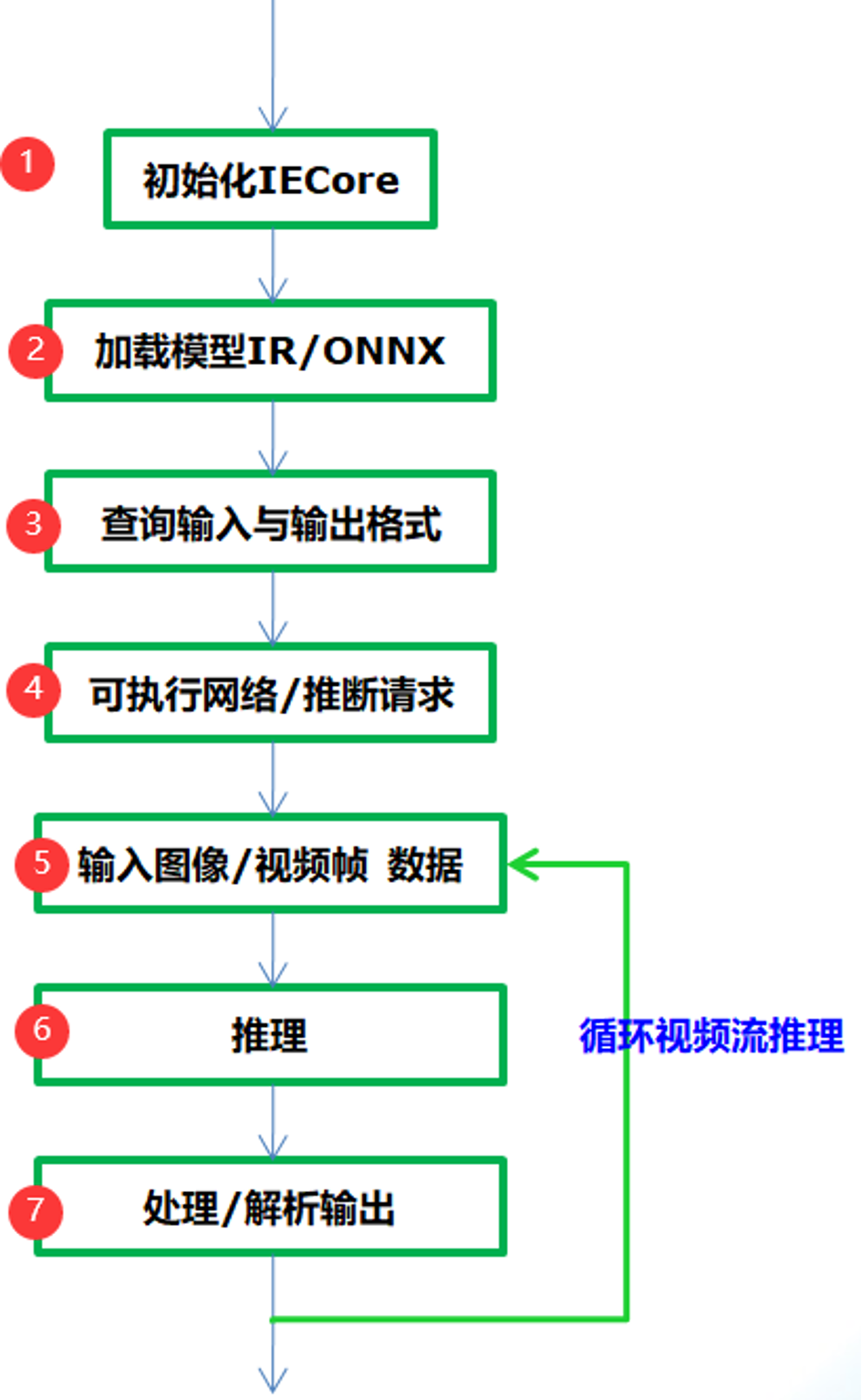

推理引擎(IE)应用开发流程

与相关函数介绍

通过OpenVINO的推理引擎跟相关应用集成相关深度学习模型的应用基本流程如下:

图-1

从图-1可以看到只需要七步就可以完成应用集成,实现深度学习模型的推理预测,各步骤中相关的API函数支持与作用解释如下:

Step 1:

InferenceEngine::Core // IE对象

Step 2:

Core.ReadNetwork(xml/onnx)输入的IR或者onnx格式文件,返回CNNNetwork对象

Step 3:

InferenceEngine::InputsDataMap, InferenceEngine::InputInfo, // 模型输入信息

InferenceEngine::OutputsDataMap // 模型输出信息

使用上述两个相关输入与输出对象就可以设置输入的数据类型与精度,获取输入与输出层的名称。

Step 4:

ExecutableNetwork LoadNetwork (

const CNNNetwork &network,

const std::string &deviceName,

const std::map< std::string, std::string > &config={}

)

通过Core的LoadNetwork方法生成可执行的网络,如果你有多个设备,就可以创建多个可执行的网络。其参数解释如下:

network 参数表示step2加载得到CNNNetwork对象实例

deviceName表示模型计算所依赖的硬件资源,可以为CPU、GPU、 FPGA、 FPGA、MYRIAD

config默认为空

InferRequest InferenceEngine::CreateInferRequest()

表示从可执行网络创建推理请求。

Step 5:

根据输入层的名称获取输入buffer数据缓冲区,然后把输入图像数据填到缓冲区,实现输入设置。其中根据输入层名称获取输入缓冲区的函数为如下:

Blob::Ptr GetBlob (

const std::string &name // 输入层名称

)

注意:返回包含输入层维度信息,支持多个输入层数据设置!

Step 6:

推理预测,直接调用推理请求的InferRequest.infer()方法即可,该方法无参数。

Step 7:

调用InferRequest的GetBlob()方法,使用参数为输出层名称,就会得到网络的输出预测结果,根据输出层维度信息进行解析即可获取输出预测信息与显示。

图像分类与ResNet网络

图像分类是计算机视觉的关键任务之一,关于图像分类最知名的数据集是ImageNet,包含了自然场景下大量各种的图像数据,支持1000个类别的图像分类。OpenVINO在模型库的public中有ResNet模型1000个分类的预训练模型支持,它们主要是:

- resnest-18-pytorch

- resnest-34-pytorch

- resnest-50-pytorch

- resnet-50-tf

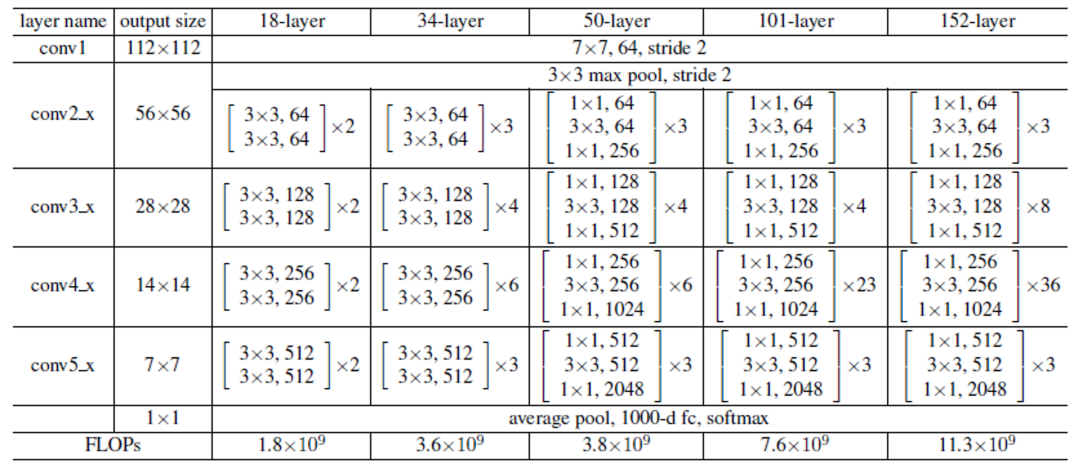

其中18、34、50表示权重层,pytorch表示模型来自pytorch框架训练生成、tf表示tensorflow训练生成。ResNet系列网络的详细说明如下:

图-2(来自《Deep Residual Learning for Image Recognition》论文)

我们以ResNet18-pytorch的模型为例,基于Pytorch框架我们可以很轻松的把它转换为ONNX格式文件。然后使用Netron工具打开,可以看到网络的输入图示如下:

图-3

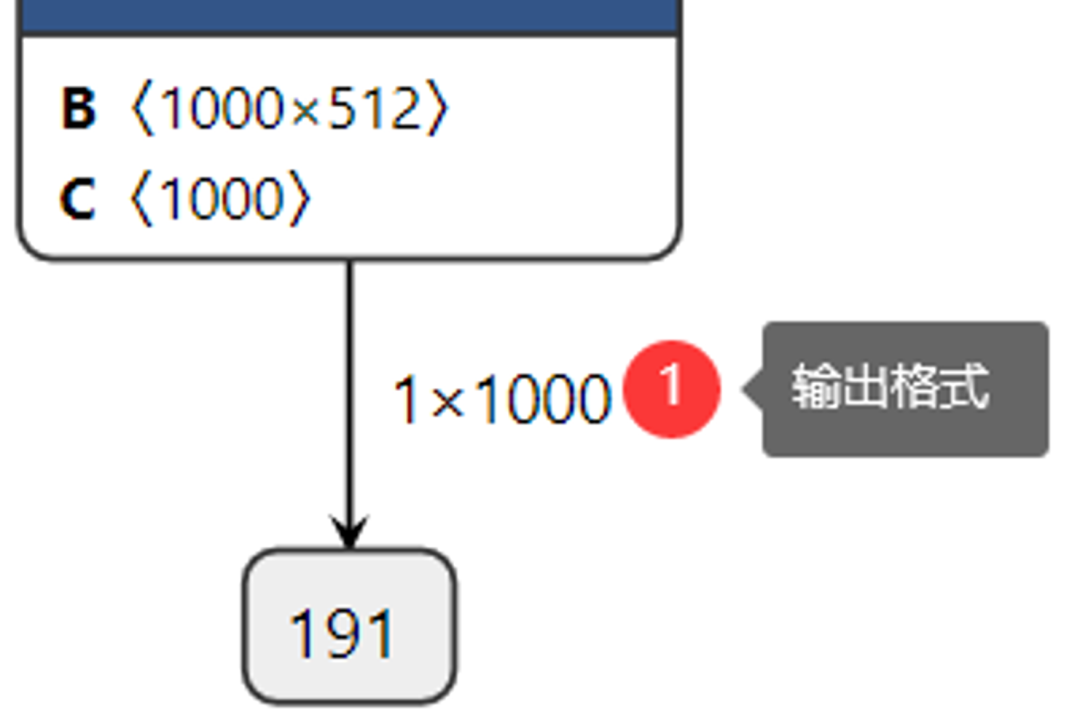

查看网络的输出:

图-4

这样我们很清楚的知道网络的输入与输出层名称,输入数据格式与输出数据格式,其中输入数据格式NCHW中的N表示图像数目,这里是1、C表示图像通道数,这里输入的是彩色图像,通道数为3、H与W分别表示图像的高与宽,均为224。在输出格式中1x1000中1表示图像数目、1000表示预测的1000个分类的置信度数据。

程序实现的基本流程与步骤

前面已经介绍了IE SDK相关函数,图像分类模型ResNet18的输入与输出格式信息。现在我们就可以借助IE SDK来完成一个完整的图像分类模型的应用部署了,根据前面提到的步骤各步的代码实现与解释如下:

1. 初始化IE

InferenceEngine::Core ie;

2. 加载ResNet18网络

InferenceEngine::CNNNetwork network = ie.ReadNetwork(onnx);

InferenceEngine::InputsDataMap inputs = network.getInputsInfo();

InferenceEngine::OutputsDataMap outputs = network.getOutputsInfo();

3. 获取输入与输出名称、设置输入与输出数据格式

std::string input_name = "";

for (auto item : inputs) {

input_name = item.first;

auto input_data = item.second;

input_data->setPrecision(Precision::FP32);

input_data->setLayout(Layout::NCHW);

input_data->getPreProcess().setColorFormat(ColorFormat::RGB);

std::cout << "input name: " << input_name << std::endl;

}

std::string output_name = "";

for (auto item : outputs) {

output_name = item.first;

auto output_data = item.second;

output_data->setPrecision(Precision::FP32);

std::cout << "output name: " << output_name << std::endl;

}

4. 获取推理请求对象实例

auto executable_network = ie.LoadNetwork(network, "CPU");

auto infer_request = executable_network.CreateInferRequest();

5. 输入图像数据设置

auto input = infer_request.GetBlob(input_name);

size_t num_channels = input->getTensorDesc().getDims()[1];

size_t h = input->getTensorDesc().getDims()[2];

size_t w = input->getTensorDesc().getDims()[3];

size_t image_size = h*w;

cv::Mat blob_image;

cv::resize(src, blob_image, cv::Size(w, h));

cv::cvtColor(blob_image, blob_image, cv::COLOR_BGR2RGB);

blob_image.convertTo(blob_image, CV_32F);

blob_image = blob_image / 255.0;

cv::subtract(blob_image, cv::Scalar(0.485, 0.456, 0.406), blob_image);

cv::divide(blob_image, cv::Scalar(0.229, 0.224, 0.225), blob_image);

// HWC =》NCHW

float* data = static_cast

}

}

}

在输入数据部分OpenCV导入的图像三通道顺序是BGR,所以要转换为RGB,resize到224x224大小、像素值归一化为0~1之间、然后要减去均值(0.485, 0.456, 0.406),除以方差(0.229, 0.224, 0.225)完成预处理之后再填充到Blob缓冲区中区。

6. 推理

infer_request.Infer();

7. 解析输出与显示结果

auto output = infer_request.GetBlob(output_name);

const float* probs = static_cast

const SizeVector outputDims = output->getTensorDesc().getDims();

std::cout << outputDims[0] << "x" << outputDims[1] << std::endl;

float max = probs[0];

int max_index = 0;

for (int i = 1; i < outputDims[1]; i++) {

if (max < probs[i]) {

max = probs[i];

max_index = i;

}

}<:fp32>

cv::putText(src, labels[max_index], cv::Point(50, 50), cv::FONT_HERSHEY_SIMPLEX, 1.0, cv::Scalar(0, 0, 255), 2, 8);

cv::imshow("输入图像", src);

cv::waitKey(0);

解析部分代码首先通过输出层名称获取输出数据对象BLOB,然后根据输出格式1x1000,寻找最大值对应的index,根据索引index得到对应的分类标签,然后通过OpenCV图像输出分类结果。

运行结果

图-5(来自ImageNet测试集)

这样我们就使用OpenVINO 的推理引擎相关的SDK函数支持成功部署ResNet18模型,并预测了一张输入图像。你可以能还想知道除了图像分类模型,OpenVINO 推理引擎在对象检测方面都有哪些应用,我们下次继续…….

编辑:jq

-

无法使用OpenVINO™在 GPU 设备上运行稳定扩散文本到图像的原因?2025-06-25 542

-

基于RV1126开发板的resnet50训练部署教程2025-04-18 1332

-

在英特尔开发套件上用OpenVIN实现中文图文检索2023-10-27 1987

-

【KV260视觉入门套件试用体验】四、学习过程梳理&DPU镜像&Resnet502023-09-26 1206

-

如何在使用Inspector运行OpenVINO C++样本时避免内存泄露?2023-08-15 641

-

手把手教你使用LabVIEW OpenCV dnn实现图像分类(含源码)2023-03-09 2625

-

如何搭建VGG网络实现Mnist数据集的图像分类2023-02-14 1460

-

【CANN训练营第三季】基于Caffe ResNet-50网络实现图片分类2022-12-19 26951

-

基于OpenVINO™ 的飞桨版 PGNet 实现案例2022-08-04 1329

-

解析OpenVINO™ + SSD 实时对象检测2021-05-18 2823

-

图像纹理的特征与分类2019-04-30 1794

-

深度学习的典型应用是图像分类问题2018-05-07 9485

-

基于多通道分类合成的SAR图像分类研究2010-04-23 2451

-

一种新的图像定位和分类系统实现方案2009-07-30 836

全部0条评论

快来发表一下你的评论吧 !