识别 AI 安全威胁

电子说

描述

人工智能 (AI) 的进步促进了各种自动化服务和自主系统;与此同时,针对人工智能的安全威胁也在迅速演变。为了帮助开发基于 AI 的安全服务和系统,欧洲电信标准协会 (ETSI) 保护人工智能行业规范组 (ISG SAI) 分析了保护 AI的问题和相应的缓解措施;最近发布了两个小组报告。

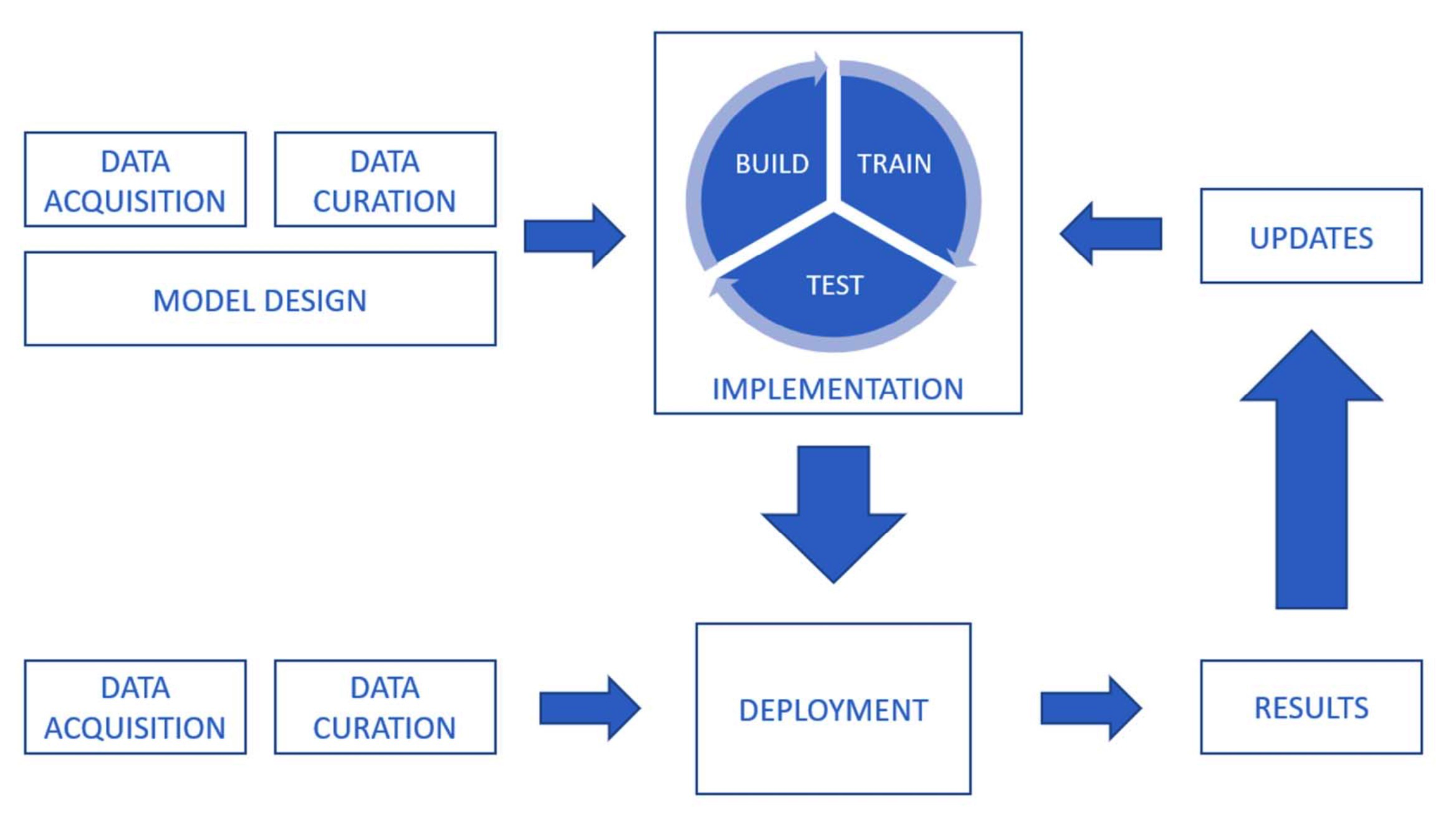

ML 的生命周期在 ETSI ISG SAI GR-004报告中捕获,如图 1 所示。积极研究实施和部署的安全影响。该报告还确定并描述了四种攻击类型,以提高人们对潜在安全威胁的认识。ETSI ISG SAI GR-005报告中也对现有缓解措施进行了分析和总结。根据所解决的 AI 模型是否被部署的缓解措施修改,它们被分类为模型增强和模型无关。因此,服务开发者或系统部署者可以根据具体的应用场景来定义他们的缓解策略。

图 1:典型的机器学习生命周期,ETSI SAI GR-004。(来源:ETSI)

中毒攻击

一种特定类型的已识别攻击称为中毒攻击,它会操纵训练数据以降低基于 AI 的服务的性能。此外,此类攻击可能会降低系统的整体性能或允许某些预期的错误分类。中毒攻击的历史可以追溯到早期的垃圾邮件过滤服务。启用人工智能的反垃圾邮件过滤器不断从电子邮件收件人的反应中学习,以改进过滤功能。电子邮件收件人可以将正常电子邮件标记为垃圾邮件或将错误分类的垃圾邮件恢复正常。

攻击者通过修改电子邮件内容来利用学习过程。例如,在垃圾邮件中小心添加一些精心制作的正常内容会误导反垃圾邮件过滤器将这些正常内容误认为是潜在的垃圾邮件。稍后,带有这些精心制作内容的电子邮件可能会被归类为垃圾邮件。过滤性能会下降到用户禁用反垃圾邮件过滤服务的程度。

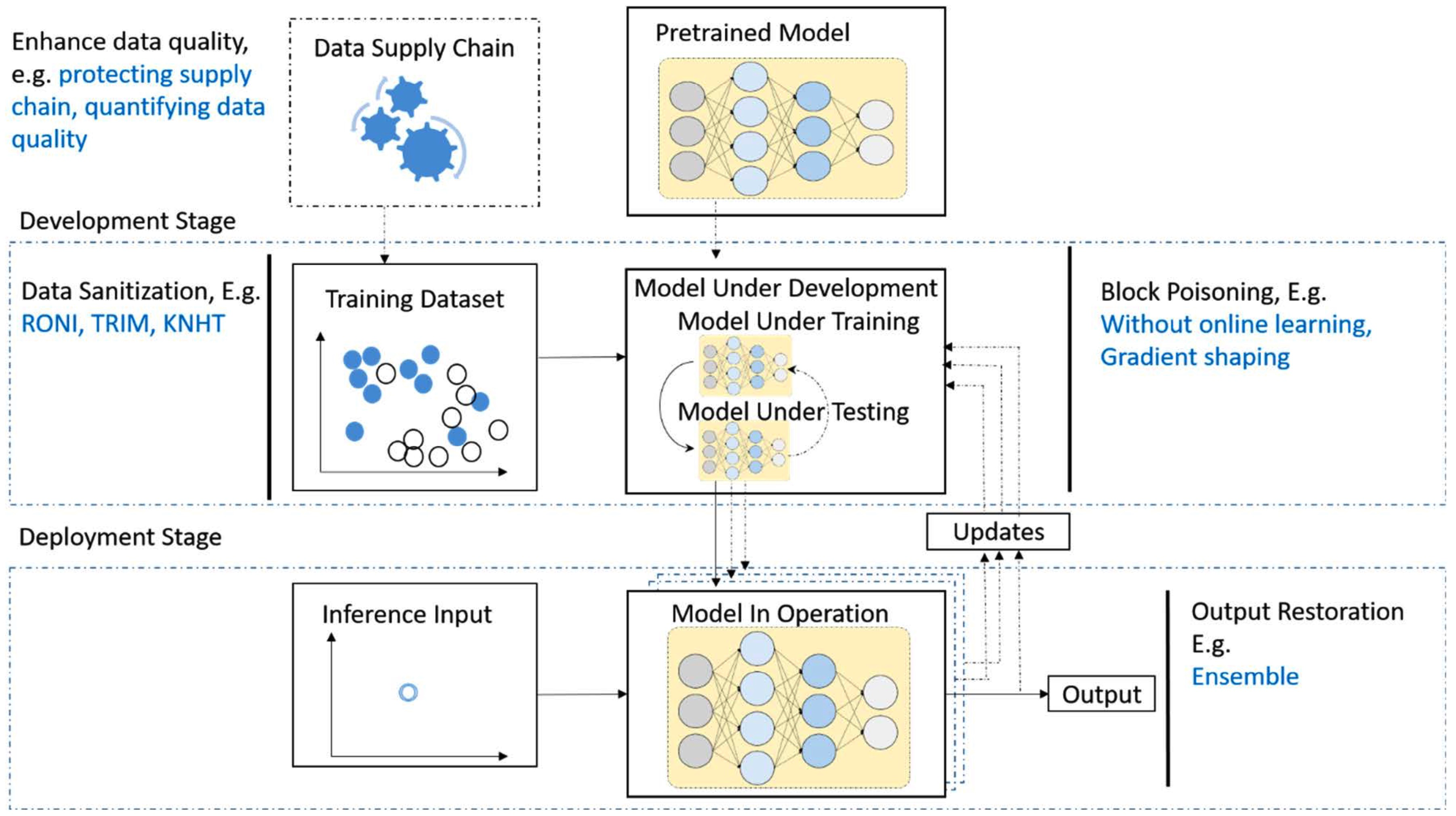

为了减轻这种攻击,数据质量是关键。如图 2 所示(来自 ETSI ISG SAI GR-005报告),针对中毒攻击的可用缓解方法包括提高数据供应链的数据质量、训练数据集的数据清理以及在训练过程中通过使用以下技术阻止中毒作为渐变整形。

点击查看完整大小的图片

图 2:针对中毒攻击的缓解方法,ETSI ISG GR-005。(来源:ETSI)

在垃圾邮件过滤服务的例子中,两种缓解方法,数据清理和块中毒,可以一起应用来缓解中毒攻击。收到的电子邮件和收件人的反应,不是在到达时输入到学习过程中,而是被保存并定期批量输入到学习过程中。它是通过减慢过程来阻止中毒的一种变体。同时,对于每个时期收到的一批邮件,可以采用数据清理技术,将可疑内容从学习中过滤掉。

闪避攻击

在另一种类型的攻击中,逃避攻击,恶意软件混淆是网络安全社区众所周知的。在这种类型的攻击中,对手在推理时使用操纵的输入来逃避部署的模型,从而导致模型产生错误的分类。

多年来,恶意软件作者一直试图通过主要通过使用加密来混淆他们的恶意软件来避免基于签名的病毒引擎的检测。由于基于静态分析的自动恶意软件检测器已经从简单的基于签名的方法发展到使用机器学习的更复杂的启发式技术,因此对检测器的鲁棒性混淆的需求从未如此强烈。

谷歌的 Android 使用统计数据显示,全球每月有超过 20 亿台活跃设备在使用,每年下载 820 亿次应用和游戏。随着其在物联网连接设备和车辆中的使用势头不断增强,Android 实施成为恶意软件攻击的常见目标,并且越来越多。

对于当前的检测系统来说,混淆是一个具有挑战性的问题,Android 恶意软件作者经常使用加密、反射和引用重命名等技术。这些旨在伪装和伪装应用程序中的恶意功能,诱使模型将其归类为良性。例如,混淆几乎普遍用于隐藏 API 的使用,恶意应用程序中加密算法的使用率是良性应用程序的五倍。此外,对 76 个恶意软件家族的分析发现,几乎 80% 的应用程序使用至少一种混淆技术。

许多良性应用程序被混淆以保护知识产权,这一事实进一步加剧了这个问题。最近,越来越多的研究关注使用对抗性学习来创建更复杂的混淆技术,例如变形混淆,其中被混淆的恶意软件的功能与原始恶意软件的功能相同。

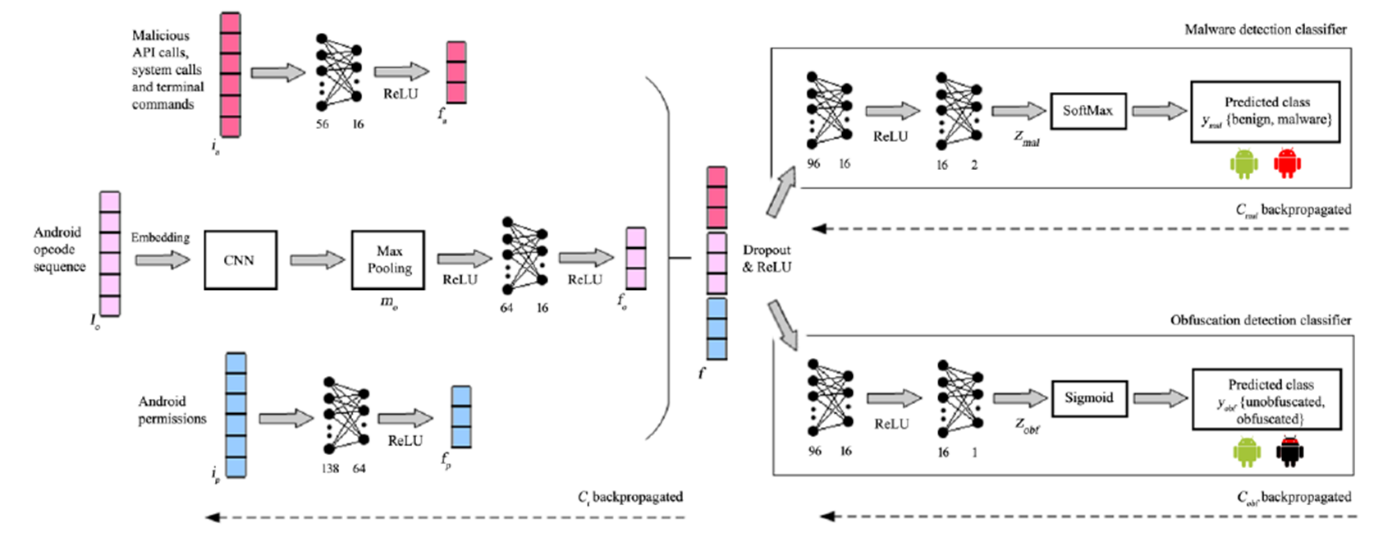

有几种方法可以减轻混淆攻击。首先,可以通过使用相同恶意和良性应用程序的混淆版本来增强原始训练数据,使用两个标签来注释每个样本来进行对抗训练;恶意或良性,混淆或未混淆。对抗性训练的一个问题是模型在部署期间泛化到看不见的未混淆样本的能力降低了。克服这个问题的一种方法是使用包含两个具有不同成本函数的分类分支的判别对抗网络 (DAN),如图 3 所示。

图 3:在上层分类分支上进行常规学习的判别对抗架构,用于恶意软件检测和对抗性学习混淆。(来源:第十届 ACM 数据和应用程序安全和隐私会议论文集,第 353-364 页)。

DAN 采用生成对抗网络 (GAN) 的对抗学习方面,但不是训练生成模型,而是训练两个鉴别器,一个用于恶意软件,另一个用于混淆。使用标准梯度下降算法最小化恶意软件检测的成本函数,以最大限度地提高分类精度。然而,相比之下,混淆分支使用随机梯度上升使成本函数最小化,从而导致分类器的分类准确度是偶然的。这样做的动机是 DAN 确保学习对恶意软件检测固有有用的特征,同时不知道混淆。这样的特征可以导致看不见的未混淆样本的更大泛化。

最后,尽管最近对对抗性攻击和缓解措施进行了大量研究,但实际用例的数量很少,许多人将该领域视为一项学术活动,可以更深入地了解深度学习的工作原理(或休息)。另一方面,机器学习在反病毒引擎、软件和 Web 应用程序漏洞检测以及主机和网络入侵检测等网络安全工具中的使用越来越多,这将网络安全置于人工智能的敌对攻击者和防御者的前线.

由于保护 AI 是确保基于 AI 的服务和系统开发和部署的重要课题,因此需要做更多的研究。作为第一步,ETSI ISG SAI 于 2019 年开始工作,并提交了两份关于保护 AI 问题陈述和缓解策略报告的小组报告。ETSI ISG SAI 有望在不久的将来获得更多结果。

审核编辑 黄昊宇

-

知语云智能科技揭秘:无人机威胁如何破解?国家安全新防线!2024-02-27 8738

-

在物联网设备面临的多种安全威胁中,数据传输安全威胁和设备身份安全威胁有何本质区别?2025-11-18 209

-

【EMC家园】RFID应用的安全与威胁!2015-12-23 2321

-

AI:对物联网安全的影响2019-05-29 3363

-

安全工具全身扫描怎么解决潜在威胁?2019-08-01 1194

-

【HarmonyOS HiSpark AI Camera】边缘计算安全监控系统2020-09-25 1278

-

【HarmonyOS HiSpark AI Camera】基于HiSpark AI Camera的人脸抓拍识别终端的设计2020-11-19 1743

-

【CC3200AI实验教程11】疯壳·AI语音人脸识别-AI语音系统架构2022-08-30 25358

-

RFID技术应用的安全与隐私威胁解析2017-12-13 11068

-

AI技术的潜在安全威胁和相关建议2018-04-07 8195

-

网络安全基础之网络协议与安全威胁的关系2022-10-20 856

-

基于 AI 的网络安全增强企业应变能力2023-12-19 1420

-

Secureworks 威胁评分迎来网络安全 AI 新时代2024-02-04 1133

-

识别IP地址威胁,构筑安全防线2024-09-03 1324

-

景区AI行为识别系统作用2025-05-07 1307

全部0条评论

快来发表一下你的评论吧 !