关于无人机的新型轻型高速视觉系统

军用/航空电子

描述

在无人机视觉系统的常规研究中,用于基于视觉的导航的视觉同步定位和映射(Visual SLAM)和视觉里程计(VO)是主要课题。V-SLAM技术构建无人机经过的周围环境的实时地图,并且无人机相对于该构建的地图进行自身定位。VO使用连续捕获的图像来估计无人机的自我运动,而不是构建无人机的完整环境图。这些研究集中在 3D环境的识别上,并根据识别结果控制无人机。但是V-SLAM的计算成本很高,处理速度不是很高。另一方面,在飞行生物中,实时视觉信息用于避免碰撞并在狭窄空间飞行。在这种情况下,无需获取详细的世界坐标系3D环境地图,即使只获取无人机机身与障碍物之间的相对位置和方位,无人机也可以通过视觉伺服飞行。省略了准确的3D环境识别过程,实现了响应迅速的飞行。

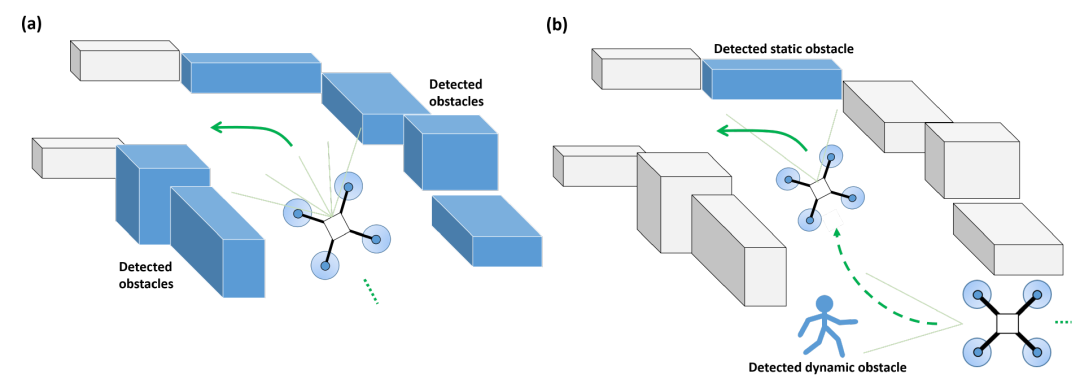

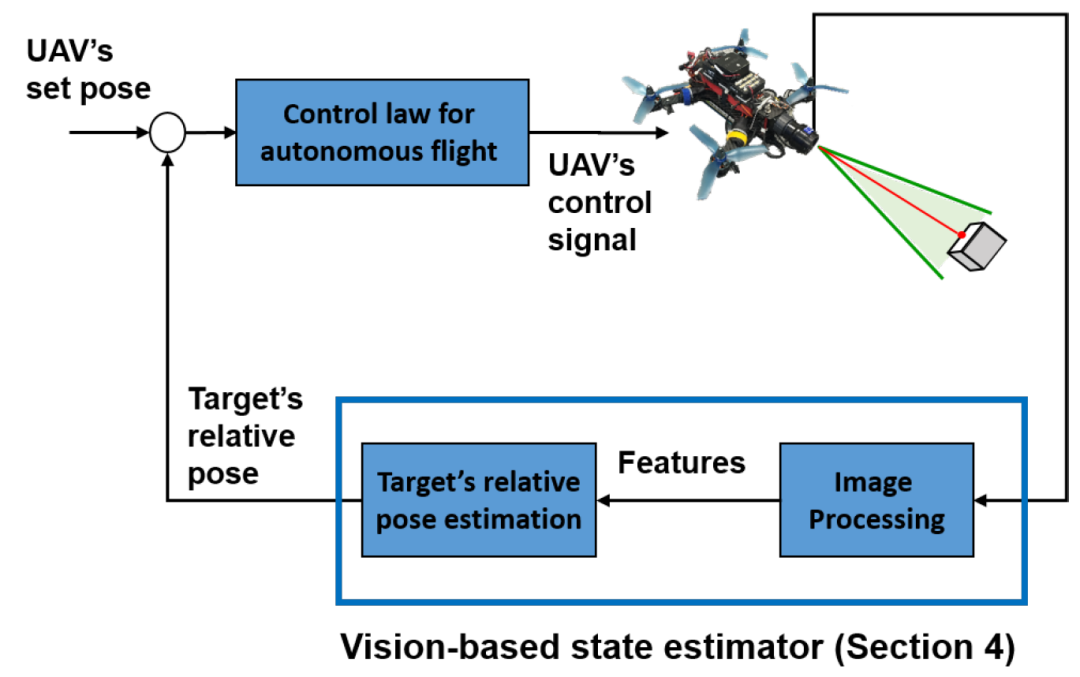

我们认为这种响应式视觉伺服在传统无人机研究中的表现仍然不够高。因此,开发了一种用于无人机的新型轻型高速视觉系统和用于快速目标跟踪的视觉伺服控制。所提出的视觉系统可以在短时间内识别周围环境,并可以立即将控制信号传输到飞行控制器。图1显示了本文中使用的基于相对位置的视觉伺服与传统方法之间的差异。基于相对位置的视觉伺服估计与目标的相对位置和方向以进行视觉伺服,而不是收集完整的环境信息来制定控制策略。

图1 传统方法 ( a ) 和基于相对位置的视觉伺服 ( b ) 的概念

开发用的无人机

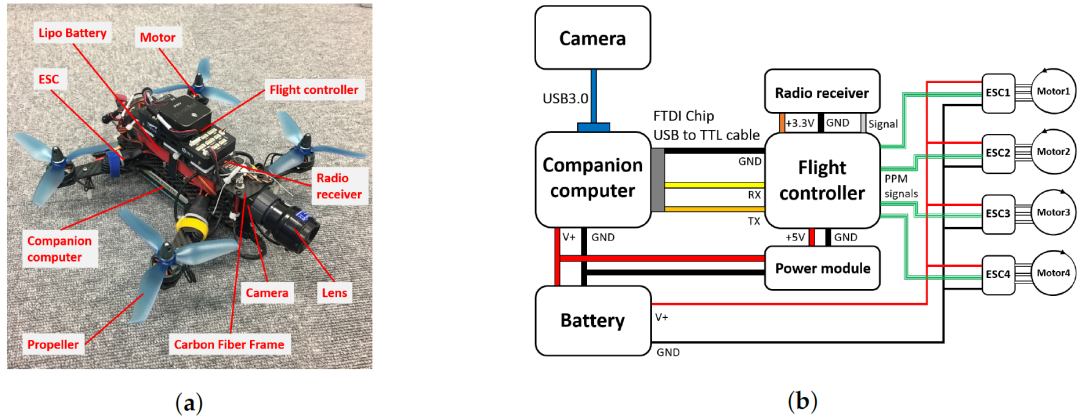

图2a显示了我们在实验中使用的平台。对于快速运动,我们选择了QAV250光纤框架作为飞行平台。对于高速目标识别,我们选择了配备Theia SY110M超广角镜头的XIMEA MQ003CG-CM高速相机。考虑到快速图像处理和姿态估计的需要,我们选择了Jetson TX2,这是NVIDIA推出的低功耗嵌入式平台,包括一个256核的NVIDIA Pascal GPU,一个六核ARMv8 64位CPU复合体,以及带有128位接口的8 GB LPDDR4内存。作为飞控,我们选择了Pixhawk2.1 Cube作为基础硬件来开发自己的飞控。

图2 开发用的无人机:( a ) 平台 ( b ) 接线配置

图2b显示了我们的无人机的接线图。高速相机通过USB3.0 电缆将原始图像传输到配套计算机。在计算出相对位姿后,当前位置和设定点通过FTDI USB到TTL电缆使用mavlink协议传输到飞行控制器。最后,PPM信号被发送到ESC以将它们转换为三相信号以驱动无刷电机。

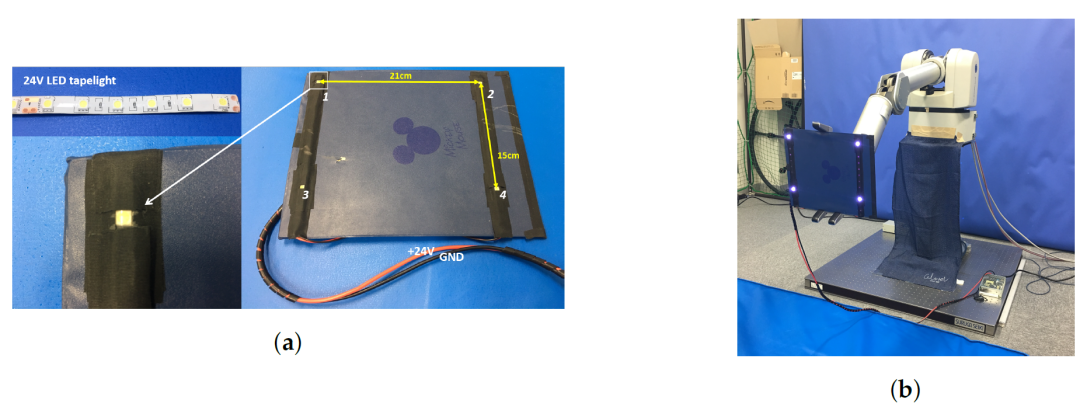

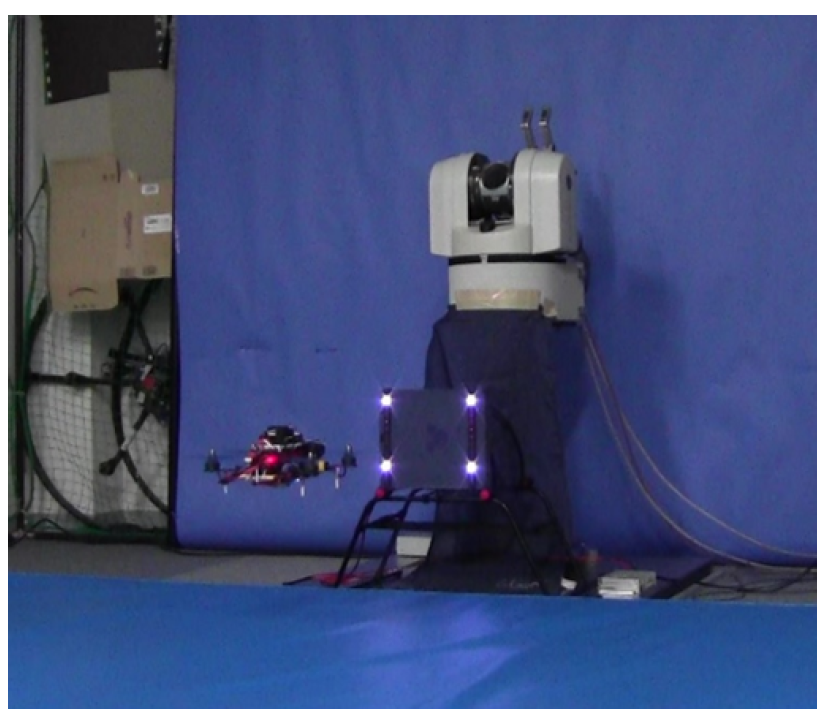

移动目标

在实验中,我们准备了一个样本移动目标作为视觉伺服的参考,以定量验证其性能。为了方便图像处理中的快速特征检测,我们在一块板上安装了四个LED灯作为移动目标,如图3a所示。将每个LED的坐标定义为(0 , 0 , 0 ),(0.21 , 0 , 0 ),(0 , 0.15 , 0 ),(0.21 , 0.15 , 0 )分别从第1点到第4点。为了移动目标板,我们使用了Barrett WAM7-DoF机器人机械手,如图3b所示,并以不同的速度和加速度移动它。

图3 目标对象的配置:( a ) 目标对象 ( b ) 用于移动目标的机械臂

特征检测

我们使用Harris角点算法来检测目标上的特征。这是一种通用的特征检测算法,可以很容易地应用于其他识别任务。此外,由于计算量低,它适用于高速图像处理。在使用高速视觉的情况下,帧之间只观察到目标的微小变化,并且可以假设时间连续性,因此很容易防止误检。

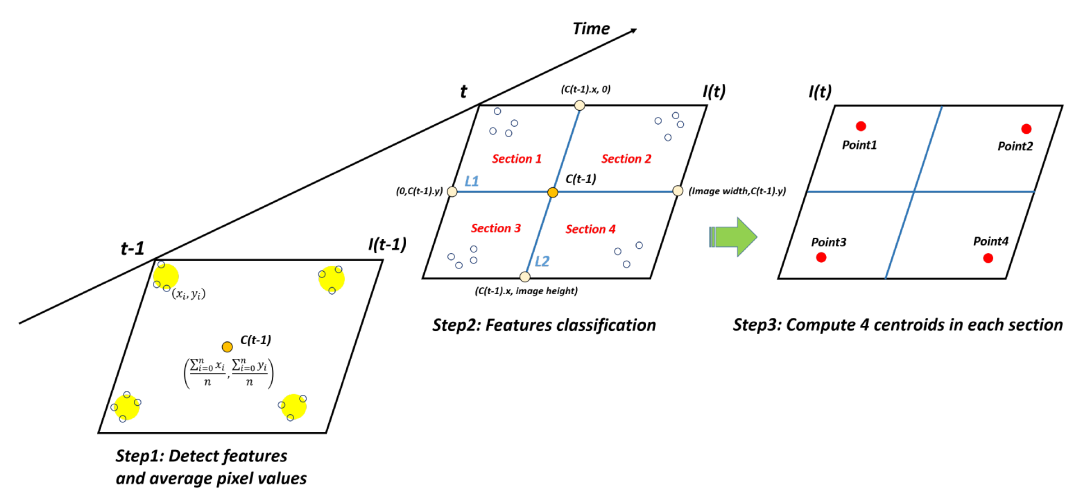

图像质心

在时间t,我们可以使用所有图像特征的中心C将特征分类为一些部分,如图4所示。

图4 为姿势估计选择四个内点的图像处理

基于相对位置的视觉服务

为了实现响应式快速运动,我们提出了基于相对位置的视觉伺服,它只计算无人机相对于目标的位姿。由于我们的控制器只需要相对位置,因此车载伴侣计算机上图像处理的计算量将得到有效降低,我们可以在相同的时间内获得更多可用的视觉信息。图5显示了我们在实验中使用的基于相对位置的视觉伺服方法。

图5 基于相对位置的高速视觉伺服控制回路

坐标变换

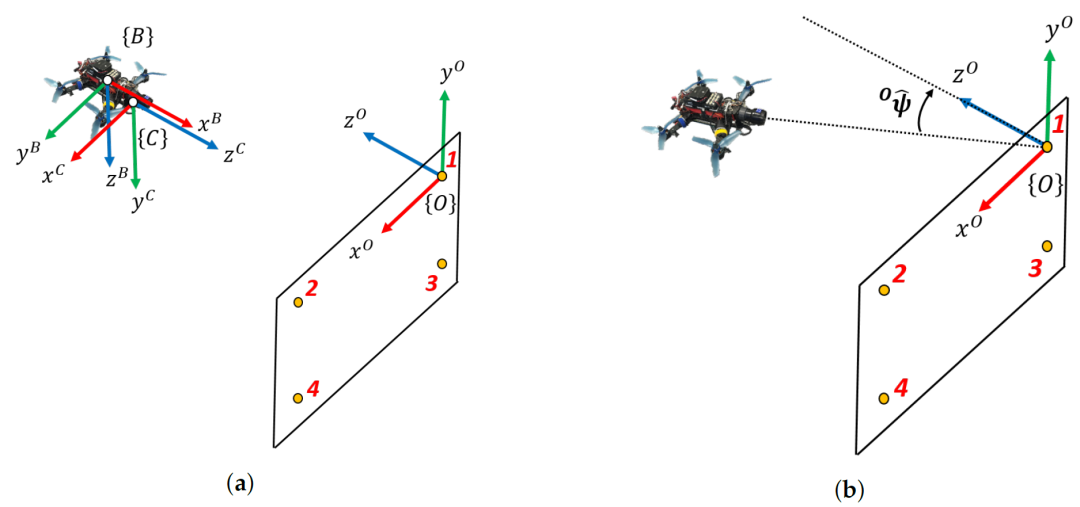

我们的系统中有三个坐标系:目标坐标系O、相机坐标系C和无人机机身坐标系B,如图6a所示。我们可以通过PnP直接获得°x和°R。

图6坐标系和相对姿态:( a ) 各坐标系之间的关系 ( b ) 相对偏航角

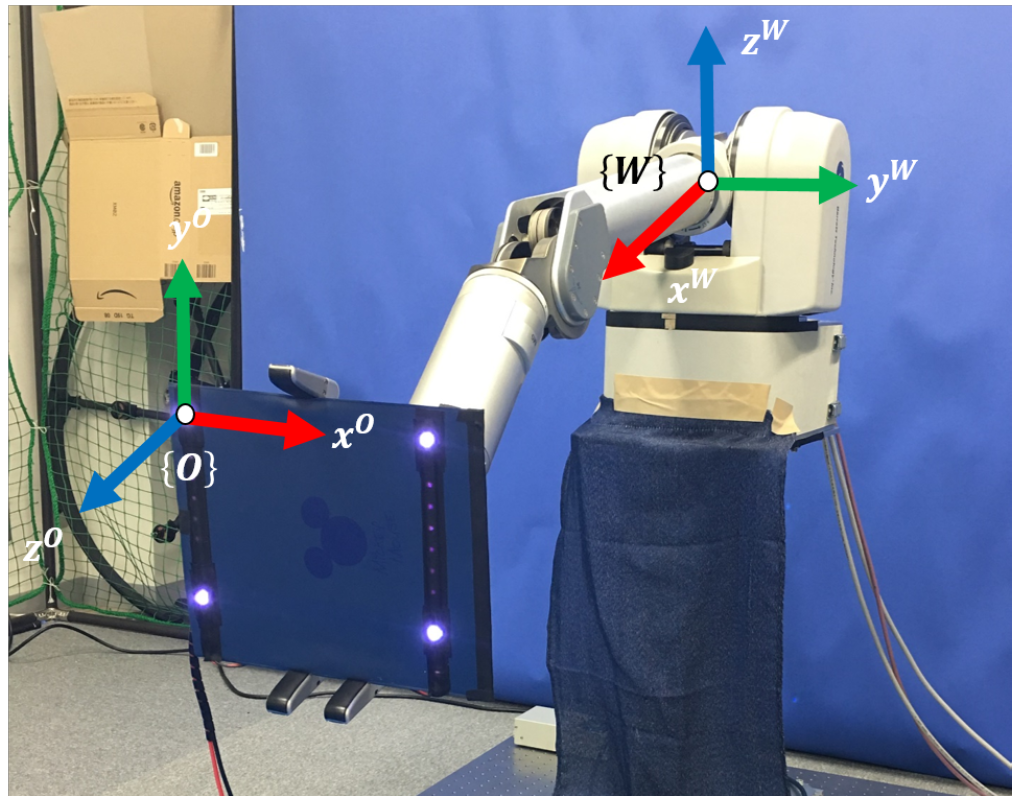

在实验中,首先让四旋翼手动起飞,一旦目标在视野范围内,飞行模式就会自动切换到位置保持模式。四旋翼飞行器将飞行到相对于目标原始点的设定点并保持其位置。由于目标和四旋翼之间的相对位置用于基于位置的视觉伺服,因此四旋翼将在目标移动期间继续飞行到设定点。在进行动态目标跟踪实验之前,我们在一个位置保持实验中测试了直接视觉伺服的性能,实验配置如图7所示。

图7 位置保持飞行的配置

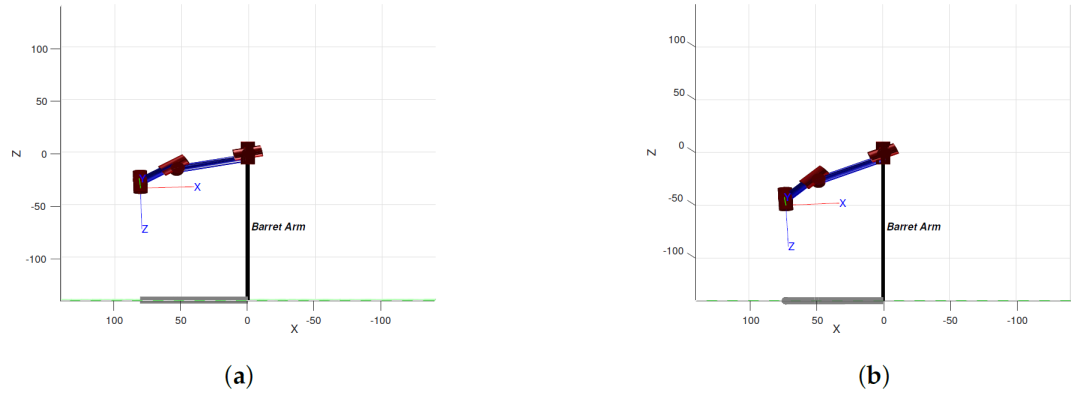

轨迹模拟

对于动态目标跟踪,为了方便设置目标的移动速度,预先设置了目标的轨迹。实验中,目标在不同运动速度的机械臂两个姿态之间前后移动,以验证不同条件下的跟踪结果。图8显示了为跟踪任务设置的位置。

图8 目标轨迹模拟:( a ) 目标的第一个位置 ( b ) 目标的第二个位置

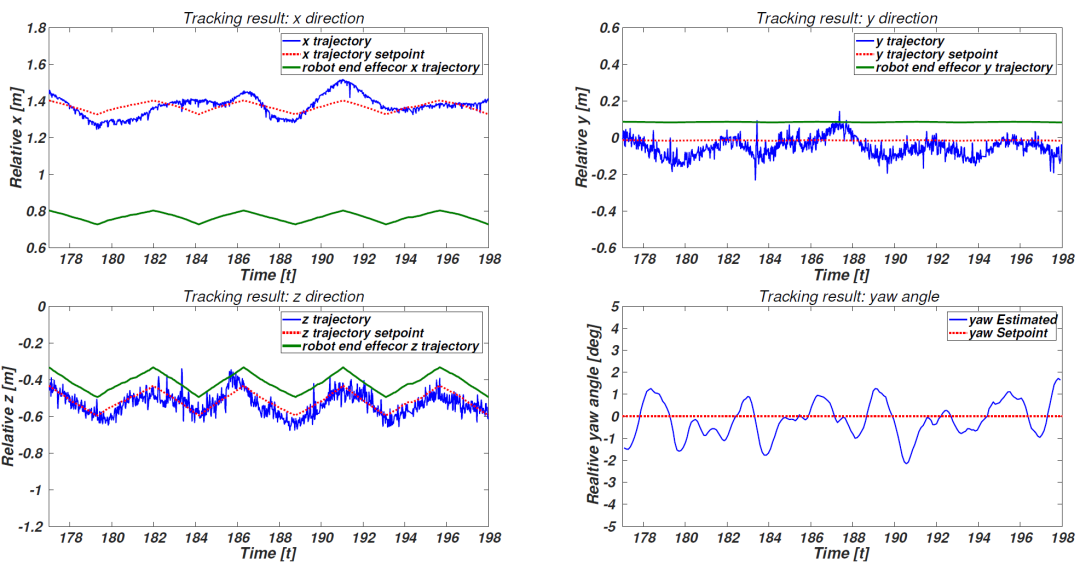

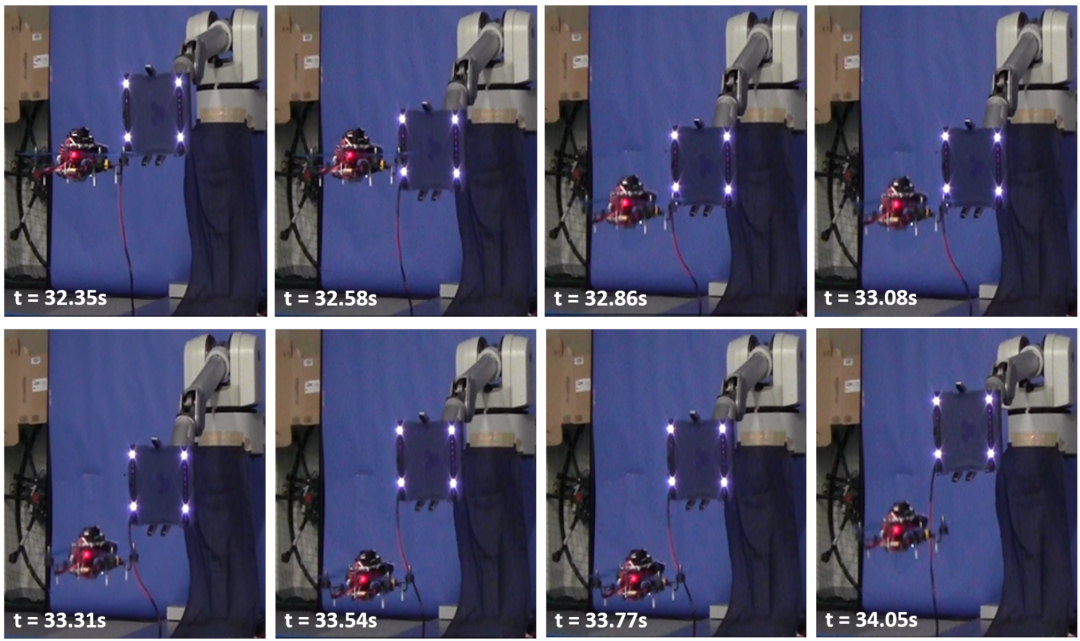

跟踪轨迹被转换到位于机器人手臂上的世界坐标系(图9),如图10所示,目标以0.5[m/s]的线速度和0.1[m/s2]的线加速度移动。图11显示了1.7秒内动态目标跟踪的实验结果。

图9 物体坐标系与世界坐标系的关系

图10 自主目标跟踪轨迹(移动速度:v = 0.5 [m/s],a = 0.1 [m/s2],目标识别率:350 Hz)

图11 自主目标跟踪(移动速度:v = 0.5 [m/s],a = 1.0 [m/s2]

提出了一种基于相对位置的视觉伺服系统,该系统采用高速目标识别方法和新颖的控制器设计。与以往对无人机视觉伺服的研究相比,我们的系统利用视觉位置信息直接对无人机进行高速控制,并在定位飞行中验证了所提出的控制方案的可行性。通过实时目标跟踪实验证明了该方法的优点。实验结果表明,我们提出的方法可以实现比低速目标识别设置更好的跟踪性能。

-

安森美下一代无人机的AI视觉系统2025-07-21 7238

-

一个基于树莓派和Python的无人机视觉跟踪系统 精选资料分享2021-08-09 1532

-

无人机飞控系统2021-07-21 2572

-

MISEL项目旨在为无人机等开发机器视觉系统2021-05-06 2737

-

什么是无人机图传系统?2019-08-09 12804

-

武汉无人机无人机比武演练,普宙O2当裁判2018-08-28 2921

-

无人机技术之视觉系统教学ppt下载2018-01-15 1108

-

无人机侦测和反制系统2017-04-05 8392

-

【LattePanda试用申请】基于LabVIEW的无人机视觉系统2017-03-27 6927

-

英特尔推无人机开发套件 内置视觉系统2017-02-10 1700

-

极飞发布“天目”无人机视觉系统 拥有感知环境的能力2016-11-23 2618

-

极飞抢先发布了“天目”植保无人机视觉系统 大疆vs极飞谁将更胜一筹?2016-11-22 5585

-

无人机你们是知道了,那么反无人机有几个会知道?2016-09-26 5241

-

无人机遥感技术2016-03-11 7756

全部0条评论

快来发表一下你的评论吧 !