为自动驾驶汽车设计计算机视觉系统

电子说

描述

自动驾驶汽车及其计算机视觉系统收到了大量新闻报道,这清楚地表明设计一个在任何环境条件下都表现良好的强大视觉系统是多么困难。在开发这些复杂的汽车视觉系统时,所有设计人员都应考虑几个关键要素。其中包括传感器冗余、低光视觉处理和故障传感器检测。

传感器冗余的重要性对于使用视觉系统进行物体检测的汽车周围的每个位置,都应该有多个摄像头(至少两个)指向视线。即使视觉算法只需要单视觉数据,也应该设置此设置。

传感器多样性允许通过将图像与辅助摄像头进行比较来检测主摄像头的故障。主摄像头将其数据提供给视觉算法。如果系统检测到主摄像头出现故障,它应该能够将其中一个辅助摄像头的数据重新路由到视觉算法。

由于有多个摄像头可用,视觉算法也应该利用立体视觉。以较低的分辨率和较低的帧速率收集深度数据将节省处理能力。即使处理本质上是单相机,深度信息也可以通过根据场景中对象的最小和最大距离减少需要处理的尺度数量来加速对象分类。

例如,德州仪器 (TI) 的 TDAx 汽车处理器系列配备了必要的技术,可处理至少 8 个摄像头输入,并通过 Vision AcceleratorPac 执行最先进的立体视觉处理以满足此类要求。Vision AcceleratorPac 包含多个嵌入式视觉引擎 (EVE),它们在立体视觉系统的对应匹配算法中使用的单指令多数据路径 (SIMD) 操作类型方面表现出色。

微光视觉的重要性、对离线地图的依赖和传感器融合微光视觉处理需要一种不同于白天使用的处理模式。在弱光条件下拍摄的图像信噪比低,边缘等结构化元素被隐藏在噪声之下。在弱光条件下,视觉算法应该更多地依赖斑点或形状而不是边缘。典型的计算机视觉算法,例如基于定向梯度直方图 (HOG) 的对象分类,主要依赖于边缘,因为这些特征在日光下占主导地位。但是配备这种视觉系统的汽车在夜间在光线不足的道路上检测其他车辆或行人时会遇到问题。

如果系统检测到弱光条件,视觉算法应切换到弱光模式。这种模式可以使用仅使用低光图像训练的深度学习网络来实现。低光模式还应该依赖离线地图或离线世界观的数据。低光视觉算法可以提供线索以在地图上找到正确的位置,并根据离线世界观重建场景,这对于静态环境中的导航来说应该足够了。

然而,在动态环境中,对于以前未记录的移动或新物体,需要与其他传感器(激光雷达、雷达、热像仪等)融合,以利用每种传感器模式的各自优势确保最佳性能. 例如,激光雷达在白天或晚上都能正常工作,但无法区分颜色。摄像头在弱光条件下视力不佳,但会为检测红灯和交通标志的算法提供颜色信息。在有雨、雪和雾的情况下,这两种传感器都会表现不佳。雷达可以在恶劣天气下使用,但它们没有足够的空间分辨率来准确检测物体的位置和大小。

您可以看到每个传感器提供的信息,如果单独使用,是不完整或不确定的。为了减少这种不确定性,融合算法结合了从这些不同传感器收集的数据。

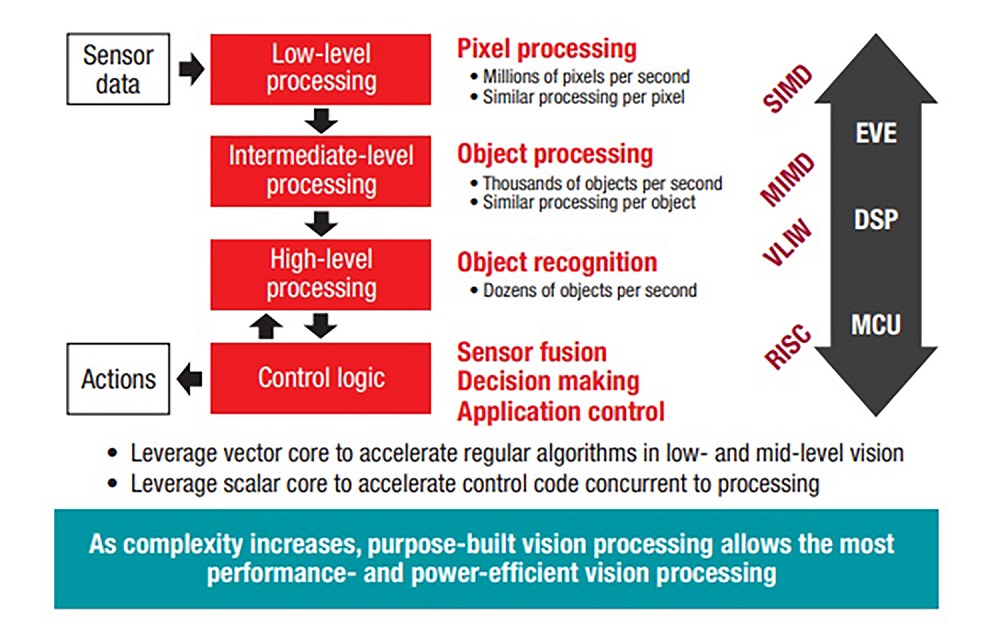

这是使用异构架构设计的好处。例如,TI 的 TDA2x 处理器可以处理传感器数据采集、处理和融合所需的处理多样性,这要归功于具有不同架构的三个不同内核(EVE、数字信号处理器 [DSP] 和微控制器 [MCU])。有关 功能映射的详细信息,请参见图 1 。

图 1:异构片上系统 (SoC) 概念实现了最高的处理性能和功率效率。

弱光条件需要使用高动态范围 (HDR) 传感器。这些 HDR 传感器为同一帧输出具有不同曝光/增益值的多个图像。为了可用,这些图像必须组合/合并为一个。这种合并算法通常是计算密集型的,但 TI 的 TDA2P 和 TDA3x 处理器具有硬件图像信号处理器 (ISP),能够通过由合并、噪声过滤、闪烁缓解、去马赛克和清晰度增强块组成的管道来处理 HDR 图像。

除了减轻图像信号处理任务之外,将 ISP 集成到视觉处理器而不是传感器中还具有限制相机中的功耗和热量产生的优势,这有助于提高图像质量。该 ISP 功能强大,可以处理多达 8 个 1-MP 摄像头,非常适合环视应用。

ISP 的目标是在将图像传递给计算机视觉算法之前尽可能生成最高质量的图像,以便后者可以更优化地执行。但即使图像质量不理想,计算机视觉的最新发展也有助于减轻由恶劣操作环境引起的光学效应。

事实上,在过去十年中,人工智能技术深度学习已经能够解决最具挑战性的计算机视觉问题。但由于对计算能力的巨大需求,深度学习主要局限于云计算和数据中心行业。

研究人员一直专注于开发足够轻的深度学习网络,以在不损失质量的情况下在嵌入式系统上运行。为支持这一革命性技术,TI 创建了 TI 深度学习 (TIDL) 库。TIDL 使用 Vision AcceleratorPac 实施,可以采用使用 Caffe 或 TensorFlow 框架设计的深度学习网络,并在 2.5W 功率范围内实时执行它们。语义分和单次检测器是在 TDA2x 处理器上成功演示的网络之一。

为了补充其视觉技术,TI 一直在加大力度开发针对高级驾驶辅助系统 (ADAS) 和自动驾驶市场量身定制的雷达技术。其中包括:

采用互补金属氧化物半导体 (CMOS) 技术的汽车雷达毫米波 (mmWave) 传感器。用于中远程雷达的 AWR1xx 传感器将射频 (RF) 和具有数字控制能力的模拟功能集成到单个芯片中。在一个芯片中包含这些功能可将典型的雷达系统尺寸缩小 50%。此外,传感器的较小外形尺寸需要较少的功率并且可以承受较高的环境温度。

在 TDAx 处理器上运行的软件开发套件实现了雷达信号处理链,可以处理多达四个雷达信号。雷达信号处理链包括二维快速傅里叶变换 (FFT)、峰值检测和波束成形阶段,可实现物体检测。由于其高可配置性,雷达信号处理链可以支持不同的汽车应用,包括用于自适应巡航控制的长距离和用于停车辅助的短距离。

故障传感器检测和故障安全机制的重要性在朝着自动驾驶发展的世界中,故障传感器甚至污垢可能会产生危及生命的后果,因为嘈杂的图像会欺骗视觉算法并导致错误的分类。可能会更加关注开发可以检测由故障传感器产生的无效场景的算法。该系统可以实施故障安全机制,例如激活应急灯或逐渐停止汽车。

例如,TDAx 设备具有基于学习的算法,该算法使用来自 H3A 引擎的锐度统计数据来检测障碍物。H3A 提供了逐块的清晰度分数,从而为算法提供了精细的统计数据。

结论

为自动驾驶汽车设计汽车视觉系统的工程师面临着许多挑战,因为随着每个级别的自主性对鲁棒性的要求越来越高。幸运的是,可用于解决所有这些问题的工具数量一直在增长,传感器技术、处理器架构和算法的不断进步最终将催生自动驾驶汽车。

TI 提供一系列针对汽车市场的产品,包括其 TDAx 处理器系列、深度学习软件库和雷达传感器。这些产品支持设计强大的前置摄像头、后置摄像头、环视、雷达和融合应用,这些应用是当今 ADAS 技术的基石,也是未来自动驾驶汽车的基础。

审核编辑:郭婷

-

谷歌的自动驾驶汽车是酱紫实现的吗?2011-06-14 4820

-

自动驾驶真的会来吗?2016-07-21 14578

-

细说关于自动驾驶那些事儿2017-05-15 7220

-

真正步入自动驾驶汽车需要多久?2019-08-02 3215

-

自动驾驶汽车的处理能力怎么样?2019-08-07 2920

-

自动驾驶系统要完成哪些计算机视觉任务?2020-07-30 2262

-

联网安全接受度成自动驾驶的关键2020-08-26 3351

-

为什么视觉系统对自动驾驶至关重要看了就知道2020-12-29 1882

-

视觉系统对自动驾驶的重要性2021-01-25 3341

-

边缘计算在自动驾驶汽车的应用2021-07-12 1706

-

基于视觉的slam自动驾驶2021-08-09 3029

-

自动驾驶系统设计及应用的相关资料分享2021-08-30 2473

-

机器视觉在自动驾驶中的应用2014-12-30 2795

-

Blickfeld宣布将为自动驾驶汽车提供视觉系统2018-09-03 897

-

曝优步或收购计算机视觉初创公司以支持自动驾驶2019-06-22 776

全部0条评论

快来发表一下你的评论吧 !