基于结构化建模的矢量高精地图实时在线构建方法—MapTR

描述

摘要: 矢量高精地图能为决策规划、轨迹预测、环境感知提供重要的高层级语义信息,是自动驾驶系统中不可或缺的部分。地平线联合华中科技大学Vision Lab提出基于结构化建模的矢量高精地图实时在线构建方法——MapTR。MapTR仅依靠车载环视相机数据,输出自车周围各类地图要素的结构化表示,能够实现实时的高质量的在线地图构建。MapTR展现了在线建图方案的潜力,具有很高的应用价值,有助于推动自动驾驶技术的发展。

晴天&阴天

雨天

夜晚

蓝色-pedestrian crossing,黄色-lane divider,绿色-road boundary

图1 MapTR在多样而复杂的驾驶场景中都能稳定地构建高质量的矢量地图

背景

矢量高精地图(vectorized high-definition map)是应用于自动驾驶的高精度结构化电子地图,其由驾驶场景各类地图要素(如人行横道、车道线、路沿等)的矢量化表示构成,为决策规划、轨迹预测、环境感知提供重要的高层级语义信息。

以往的高精地图通常以离线的方式构建,即利用地图采集车的车载传感器(激光雷达、相机、惯导等)采集场景数据,并通过自动化和人工相结合的方式对数据进行处理和矢量化语义标注。离线建图的主要挑战在于:1)采集、处理和标注都需要大量的人力和时间成本,且流程繁琐;2)道路信息动态变化,离线构建的地图时效性差,需要高频更新来保证地图的准确性;3)考虑到信息安全,离线地图无法覆盖到保密要求高的区域;4)当拓展到大规模大范围的高精地图应用时,离线建图在人力、时间和维护成本上的问题将更加凸显。

在线建图是指在自动驾驶车辆行驶过程中利用车载传感器实时地感知自车周围的地图要素并生成地图。在线建图无需人工处理、标注和维护,相比离线建图,成本低,可拓展性强,易用性强。然而,目前的在线建图方法在建图质量和建图速度两方面都难以达到自动驾驶实际应用的要求。高质量高效率在线建图成为了业界亟待解决的技术难题。

针对这一问题,地平线联合华中科技大学Vision Lab提出了基于结构化建模的矢量高精地图实时在线构建方法——MapTR。MapTR通过对地图要素的结构化建模消除表示上的歧义性,降低地图要素的复杂度和学习难度,并且采用端到端的结构化框架高效地生成矢量高精地图。MapTR在nuScenes数据集上达到了最好的建图质量和实时的运行速度。丰富的可视化结果表明(如图一),MapTR在多样而复杂的驾驶场景中都能稳定地构建高质量的矢量地图。MapTR展现了在线建图方案的潜力,具有很高的应用价值和落地前景,有助于推动自动驾驶技术的发展。

地图要素结构化建模

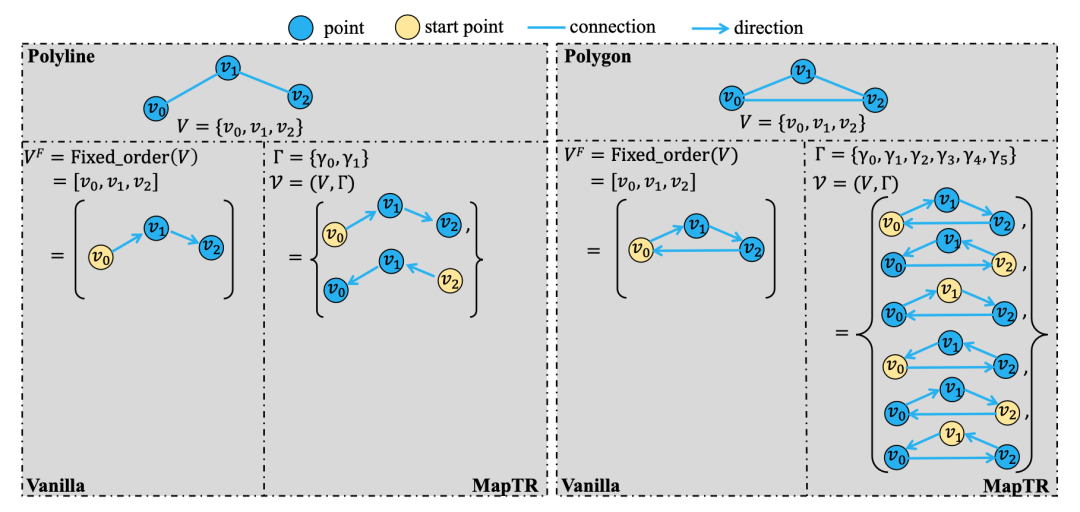

图二 地图要素结构化建模 MapTR提出了新颖的结构化建模方式。基于几何先验,MapTR将开环地图要素(如车道线)离散化为polyline(多段线),将闭环地图要素(如人行横道)离散化为polygon(多边形)。Polyline和polygon都可以用以某种顺序排列的若干节点统一地表示。通过等间隔采样可以确定节点,但节点的排列方式难以明确定义和表示,同一拓扑结构可以对应于多种等效的节点排列方式。 具体而言,对于polyline,如图二(左),存在2种等效的节点排列方式,对应于两种相反的连接节点的顺序。对于polygon,如图二(右),存在 种等效的节点排列方式( 为节点数量),任一节点都可以作为起始点,且存在两种相反的连接顺序。为了消除表示上的歧义性且准确地描述节点之间的排列方式(连接关系),MapTR引入等效排列集合的概念,所有等效的节点排列方式构成的集合作为等效排列集合。 MapTR将地图要素统一地建模为节点点集 和关于节点的等效排列集合 ,节点点集 用于描述地图要素关键点的位置信息,等效排列集合 包含了节点之间所有的等效的连接关系, 用于描述地图要素的拓扑结构。节点点集和等效排列集合 构成了地图要素的结构化表示 。

图二 地图要素结构化建模 MapTR提出了新颖的结构化建模方式。基于几何先验,MapTR将开环地图要素(如车道线)离散化为polyline(多段线),将闭环地图要素(如人行横道)离散化为polygon(多边形)。Polyline和polygon都可以用以某种顺序排列的若干节点统一地表示。通过等间隔采样可以确定节点,但节点的排列方式难以明确定义和表示,同一拓扑结构可以对应于多种等效的节点排列方式。 具体而言,对于polyline,如图二(左),存在2种等效的节点排列方式,对应于两种相反的连接节点的顺序。对于polygon,如图二(右),存在 种等效的节点排列方式( 为节点数量),任一节点都可以作为起始点,且存在两种相反的连接顺序。为了消除表示上的歧义性且准确地描述节点之间的排列方式(连接关系),MapTR引入等效排列集合的概念,所有等效的节点排列方式构成的集合作为等效排列集合。 MapTR将地图要素统一地建模为节点点集 和关于节点的等效排列集合 ,节点点集 用于描述地图要素关键点的位置信息,等效排列集合 包含了节点之间所有的等效的连接关系, 用于描述地图要素的拓扑结构。节点点集和等效排列集合 构成了地图要素的结构化表示 。

端到端训练

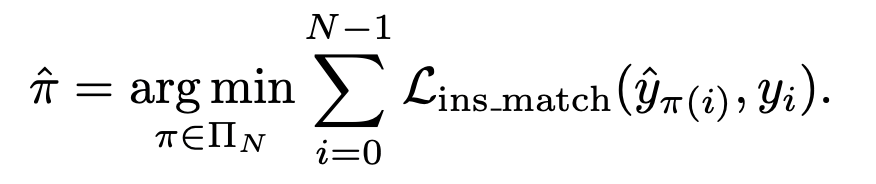

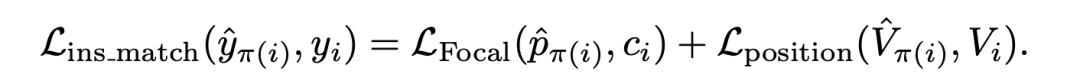

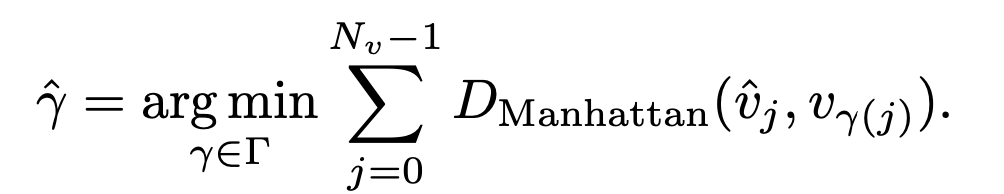

在结构化建模的基础上,MapTR采用了基于DETR[1]的set prediction的方式进行端到端训练。MapTR引入分层级匹配机制进行标签分配,即实例级匹配(instance-level matching)和节点级匹配(point-level matching)。 实例级匹配:在预测的地图要素 和真实的地图要素 之间找到最优的一一对应关系 ,匹配的依据为地图要素之间的类别相关性和位置相关性:

节点级匹配:对于每一个地图要素,从等效排列集合 中找到最优的排列 ,使得预测的节点和真实的节点一一对应且点对之间的距离之和最小:

节点级匹配:对于每一个地图要素,从等效排列集合 中找到最优的排列 ,使得预测的节点和真实的节点一一对应且点对之间的距离之和最小:

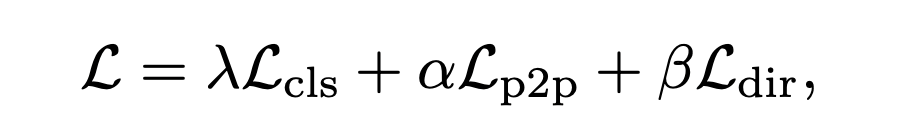

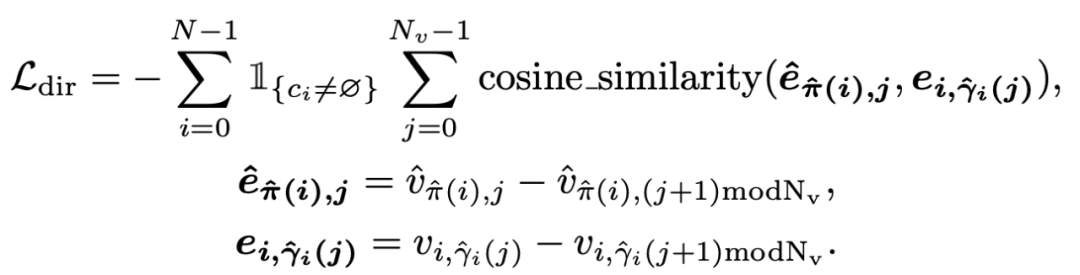

损失函数:根据分层级匹配的结果,损失函数由classification loss,point2point loss和edge direction loss组成:

Classification loss根据实例级匹配的结果对地图要素的类别预测进行约束:

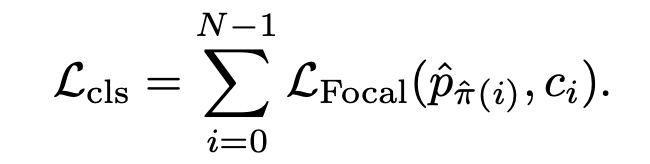

Point2point loss根据节点级匹配的结果,对匹配的点对之间的位置关系进行约束:

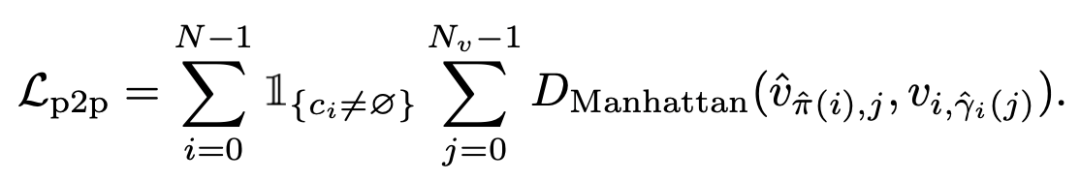

Edge direction loss对预测的edge和真实的edge的方向一致性进行约束:

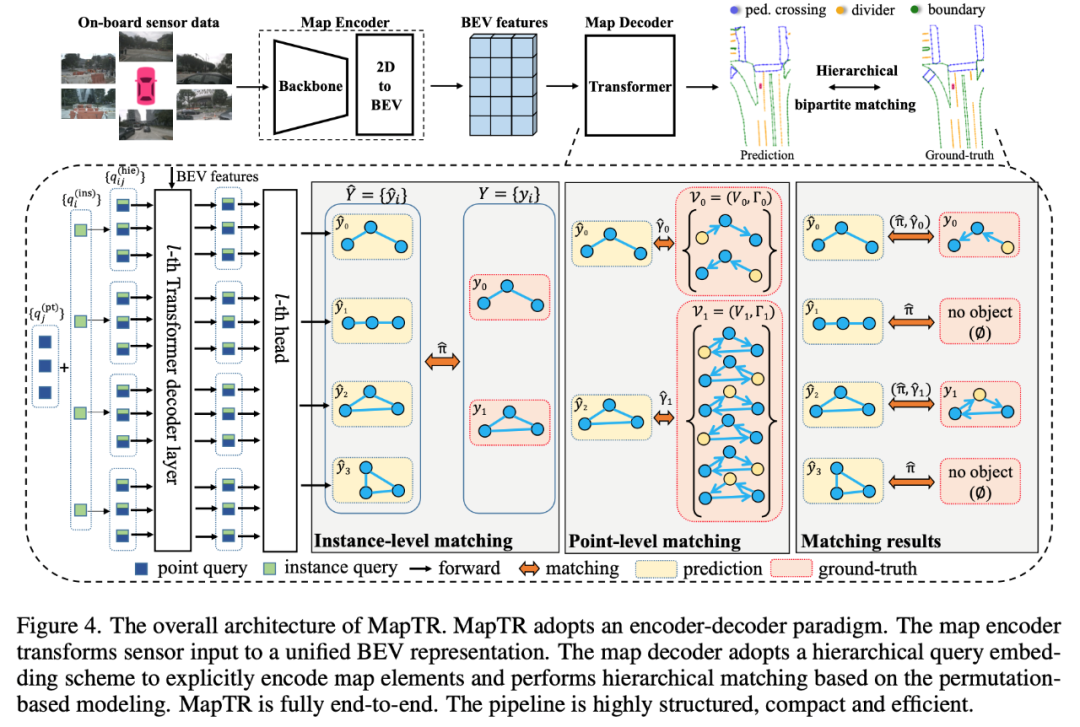

结构化建图框架

在结构化建模的基础上,MapTR采用了结构化框架端到端地输出场景内所有地图要素的结构化表示 ,无需后处理。图三为MapTR的整体框架。MapTR以车载相机组实时采集的图像数据作为输入。Map Encoder对原始图像提取语义特征,并通过2D-to-BEV变换方法(如GKT[2]、IPM[3]、Deformable Attention[4]、LSS[5]),将2D特征图转换为统一的BEV(bird’s eye view)特征图。Map Decoder采用了分层级的query embedding机制结构化地编码地图要素的信息。分层级query和BEV特征图进行交互,并且 query之间进行实例内和实例间的交互。分层级query迭代地更新,最终输出地图要素的语义类别和节点位置。

图三 结构化建图框架

实验

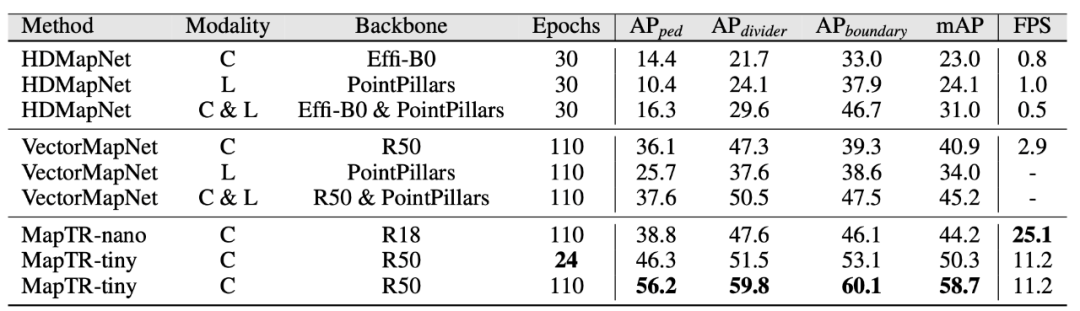

图四展示了在nuScenes数据集上MapTR与其他在线建图方法(HDMapNet[1]和VectorMapNet[2])的对比,MapTR在建图速度和建图质量两方面都有明显的优势。MapTR-nano达到了实时的推理速度(25.1FPS),8倍快于其他视觉方法,并且建图质量更高(+3.3mAP)。MapTR-tiny达到了远好于多模态方法的建图质量(+13.5mAP)并且仍有3倍的速度优势。

图四 与其他在线建图方法的对比

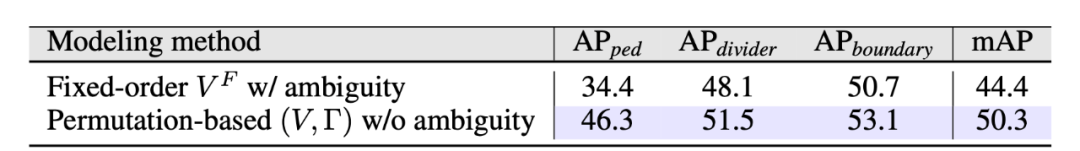

图五是关于建模方式的消融实验。相比于把地图要素建模为排列固定且唯一的序列点集,基于等效排列概念的结构化建模极大地简化了地图要素的学习难度,并且显著提高了建图质量。

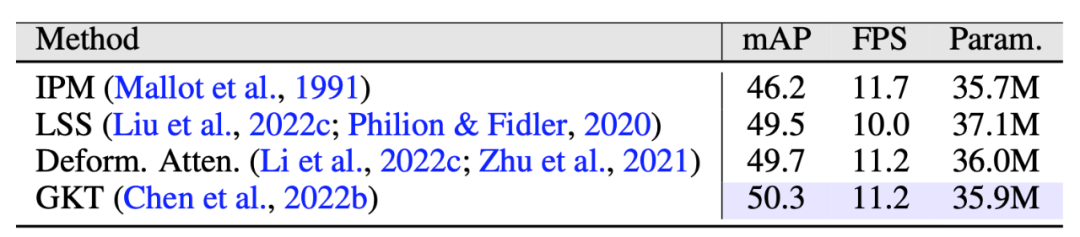

图五 关于建模方式的消融实验 图六是关于2D-to-BEV变换方法的消融实验。MapTR能够兼容各种2D-to-BEV变换方法,并且基于多种方法都能取得稳定的建图速度和质量。

图六 关于2D-to-BEV变换方法的消融实验

-

结构化布线系统有哪些难题2016-05-19 3198

-

TrustZone结构化消息是什么?2019-03-20 2119

-

怎么实现基于结构化方法的无线传感器网络设计?2021-05-31 1256

-

结构化设计分为哪几部分?结构化设计的要求有哪些2021-12-23 2048

-

软件工程中结构化设计方法探究2017-10-19 1611

-

中文商品属性结构化方法2018-01-02 1108

-

高精地图在无人驾驶领域的作用,高精地图与普通导航地图的区别2018-07-24 24761

-

高德和整车厂合作,拿下国内首个高精地图订单2018-07-30 3370

-

高德与吉利在高精地图领域达成全面合作2018-09-19 2844

-

自动驾驶语义高精地图的层级实现2019-05-23 4768

-

高精地图在车路协同中的应用2019-07-09 3509

-

丰田展示一款路面高精地图 将大幅降低高精地图的构建和维护成本2020-03-13 1187

-

为什么需要去除高精地图?2023-06-19 2095

-

一种全新的视角去理解和处理地图矢量化的任务2023-06-27 2082

-

美团取得构建高精地图专利2024-02-26 1329

全部0条评论

快来发表一下你的评论吧 !