弱监督学习解锁医学影像洞察力

电子说

描述

人工智能 (AI) 通过比人类专家更快、更准确地检测和测量异常情况,从图像中进行先进的医学诊断。构建适用于人群的高质量 AI 模型对于改善患者预后和个性化治疗至关重要。然而,人工智能模型最近需要大量数据,以及机器可以从中学习的复杂数据集标签。

今天,被称为弱监督学习的深度学习 (DL) 的一个分支正在帮助医生通过减少对完整、准确和准确数据标签的需求,以更少的努力获得更多的洞察力。弱监督学习通过利用更容易获得的粗略标签(例如在图像级别而不是图像中感兴趣的分割)来工作,并允许使用预先训练的模型和常见的可解释性方法。在下文中,我们将研究管理数据如何在弱监督学习中发挥作用。

标记在医学成像中很困难

标记图像在医疗行业中尤其具有挑战性。首先,标记数据既有限又难以获得,因为医学图像和有关结果/结果的数据通常存储在单独的系统中。例如,来自计算机断层扫描 (CT) 或磁共振成像 (MRI) 的图像可能在医院数据中可用,但活检或肿瘤切除的结果通常存储在病理实验室——通常是医院外的私人诊所。尽管可以协调某些数据的数据和标签,但访问和汇总数据可能会变得非常耗时,尤其是在涉及多个私人诊所时。

此外,在图像中发现和标记疾病及其进展的迹象(称为生物标志物)一直非常耗时且复杂,因为必须逐个像素地标记数据,从而产生数千个标签。在期望算法分割图像区域或产生区域的特定定位(例如病变或手术边界)的应用中尤其如此。这通常成本高昂,因为通常需要专业知识,并且需要三个维度的标签,如 MRI 和 CT 图像体积。将这两个缺点加在一起,为成像数据生成标签就成了一项昂贵的工作。这也限制了能够外包标签过程的可能性。

由于需要专业知识,标签的质量可能会有所不同,并会影响 DL 模型的最终性能。标签的准确性是这里的一个问题。通常,经验不足的放射科医生或住院医师必须对数据进行注释以进行培训。与具有数十年工作经验的临床医生相比,结果并不准确。读者间和读者内的可变性也发挥了作用。前者描述了读者之间的注释将如何略有不同。后者指的是当单个读者要求在两个不同的时间点分割图像时,也会产生略有不同的结果。

最后,人工标记也会限制结果。机器学习的一个好处是该模型可以得出人类永远无法获得的见解,并且将标签限制在人类输入的内容上可能会限制结果。例如,人工智能只会学习复制人类对某些任务的想法,这意味着它们可以无意中复制特定人类的偏见。此外,输入数据的其他区域中的其他特征可以预测但被丢弃,因为它们不直接落在选定的感兴趣区域内。例如,疾病迹象可能在周围组织或附近的不同器官中很明显。

利用弱监督学习

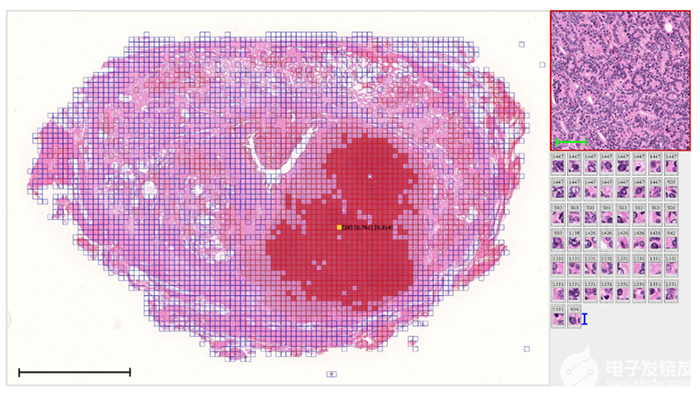

在这些情况下,使用更粗略的标签通常更有益,例如图像是否包含癌症或其他感兴趣的疾病,并允许模型找到最具辨别力的特征(图 1)。这就是弱监督学习的用武之地。

图 1:使用弱监督学习的自动注释示例,其中 AI 发现了病理学家未检测到的预测特征。(来源:病理信息学团队,RIKEN 高级智能项目中心)

弱监督学习描述了 DL 的一个分支,旨在减少生成性能良好的 DL 模型所需的标签数量或详细程度。这种方法可以大致分为三大类:不完整、不准确和不准确的标签。此处使用“大致”一词是因为可以在单个数据集中使用多种标记方法,并且弱监督标记旨在帮助根据需要进行任何组合:

当数据集的一部分被标记时,通常会出现不完整的标签,而其余部分则没有。

不精确的标签包括使用图像的整体结果而不需要分割特定的感兴趣区域。

不准确的标签,源于人类缺乏专业知识以及某些疾病指标之间的模糊或不确定性。

有趣的是,如果可以使用更粗略、更容易获得的标签来产生良好的结果,那么不精确的标签可能比不完整或不准确的标签更有用。不精确的标签更容易正确,因为它们不需要与其他标签相同的详细程度,而且它们通常更容易获得,例如从报告中提取癌症阶段作为标签,以指示扫描中有癌症作为与手动突出显示 3D 成像上的癌变区域相反。对于不精确的标签,数据集可能会有更多可用的标签,并且准确度更高。特别是,这减少了对高水平专业知识的需求来突出所有相关像素。

在最常见的医学成像用例(例如检测和定位感兴趣区域)中利用此类不精确标签的流行方法使用两步过程:

主干,例如训练 DL 模型以预测由不精确标签描述的类。

一旦开发用于预测特定扫描,使用像素归因方法(也称为显着性或可解释性方法)来突出模型决策的最相关区域。

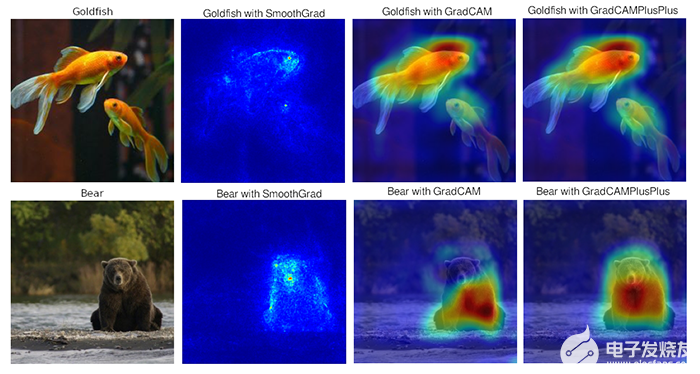

图 2说明了不同的基于梯度的像素归因方法的示例。

图 2:两个输入图像(金鱼和熊)以及可用于在弱监督学习期间执行分割的基于梯度的像素归因方法示例。(来源:Github 上的 TF Keras Vis)

卷积神经网络作为主干

由于医疗用例经常使用成像数据,因此卷积神经网络 (CNN) 是用作弱监督学习基础的主要 DL 框架也就不足为奇了。CNN 通过学习减少医学扫描中的数百万像素来工作——通常将 3D 体积减少为低维表示——然后将其映射到类标签。

在弱监督学习中,可以组合方法。例如,可以在您的数据集上训练一个新网络(这提供了其他类似数据源的好处)。预训练的网络可用于对新任务执行迁移学习。例如,ResNet50 和 VGG16 是在日常生活中发现的数百万张图像上训练的两种 CNN 架构。尽管它们没有在医学图像上进行过训练,但它们仍然很有用,因为在模型的早期层中学习到的卷积滤波器往往是通用特征,例如线条、形状和纹理,这对医学成像很有用。

使用这些模型之一进行迁移学习就像移除最终的类预测层并使用代表新医学成像任务的类的层重新初始化它一样简单。尽管最终目标是获得突出图像中相关对象和感兴趣区域的输出,但第一步只是首先预测图像中是否存在这些感兴趣区域。

弱监督本地化的 AI 可解释性

一旦 DL 主干经过训练并且可以准确地预测感兴趣的类别,下一步将是使用众多 AI 可解释性方法中的一种来生成感兴趣区域的分割。开发这些可解释性方法(也称为像素归因方法)是为了深入了解深度学习模型在做出特定预测时在图像中查看的内容。输出是某种形式的可视化——通常称为显着性图——可以根据最终目标以几种不同的方式计算。

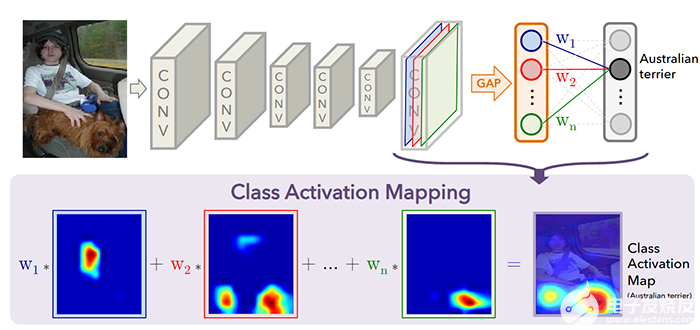

最流行的方法之一是使用基于梯度的显着图。在其核心,这涉及进行输出预测并检查构成该输出的所有神经元。根据方法的不同,这种检查可以一直追溯到第一个输入层——Vanilla Gradients。或者它可以停止在稍后的某个层,例如神经网络架构中的最后一个卷积层——GradCAM(图 3)。其他变体做不同的事情,例如产生更平滑的感兴趣区域,改善简单变体的限制,或者围绕所需特征生成更紧密的分割。

图 3:GradCAM 是一种 ML 可解释性方法,可用于在弱监督学习中分割特征,它采用与最后一个卷积层有关的输出类的梯度。(来源:麻省理工学院计算机科学与人工智能实验室的 Zhou 等人)

结论

直到最近,识别医学图像中的生物标志物还需要大量复杂标记的成像数据。然而,弱监督学习等技术减少了对完整、准确和准确的数据标签的需求,并减少了在时间和专业知识方面成本太高而无法获得的洞察力。弱监督学习通过利用更容易获得的粗标签来工作——例如在图像级别而不是图像中感兴趣的分割。它允许重复使用预训练的 CNN 模型,然后使用常见的可解释性方法根据预测的类突出显示感兴趣的区域。这两点允许在没有广泛的像素级注释的情况下为各种应用程序对医学成像数据进行训练的模型。

编辑6.20

审核编辑 黄昊宇

-

使用MATLAB进行无监督学习2025-05-16 1743

-

医学影像四大设备是什么 医学影像的作用和存在意义2023-08-29 19841

-

通过弱监督学习揭示医学影像中的秘密2023-05-18 1657

-

融合零样本学习和小样本学习的弱监督学习方法综述2022-02-09 3270

-

机器学习中的无监督学习应用在哪些领域2022-01-20 5644

-

基于 U-Net 的医学影像分割算法2021-08-25 6034

-

深度学习:基于语境的文本分类弱监督学习2021-01-18 3866

-

最基础的半监督学习2020-11-02 3516

-

机器学习算法中有监督和无监督学习的区别2020-07-07 6816

-

众多医学影像AI企业开发了相关的医学影像AI产品2020-06-15 1049

-

人工智能与医学影像的完美结合2019-08-09 7157

-

医学影像发展历史2017-07-27 5456

-

医学影像设备学发展记录2009-11-30 4204

-

CBIR技术在医学影像数据库的设计与研究2009-06-23 695

全部0条评论

快来发表一下你的评论吧 !