什么是图神经网络 谁在使用图神经网络

描述

图神经网络将深度学习的预测能力应用于丰富的数据结构中,这些数据结构将物体及其对应关系描述为图中用线连成的点。

当两种技术相融合,就可以创造出一些新的和奇妙的事物,比如手机和浏览器融合成了智能手机。

当今,开发者正在将 AI 发现规律的能力应用于大型图数据库,这些数据库存储着包含各数据点之间关系的信息。两者组合成被称为图神经网络(GNN)的强大新工具。

什么是图神经网络

图神经网络将深度学习的预测能力应用于丰富的数据结构中,这些数据结构将物体及其对应关系描述为图中用线连成的点。

在图神经网络中,被称为“节点”的数据点通过被称为“边”的线连接,各种元素均以数学形式表达,这使机器学习算法可以在节点、边或整个图的层面做出有用的预测。

图神经网络能做什么

越来越多的公司正在使用 GNN 改进药物研发、欺诈检测和推荐系统。这些以及更多其他应用都依赖于寻找数据点之间的关系规律。

研究人员正在探索 GNN 在计算机图形学、网络安全、基因组学和材料科学中的用例。近期的一篇论文描述了 GNN 如何利用图形式的交通地图改进对到达时间的预测。

许多科学和工业领域已在图数据库中储存了有价值的数据。通过深度学习,他们可以训练预测模型,从图中挖掘出新颖的洞察。

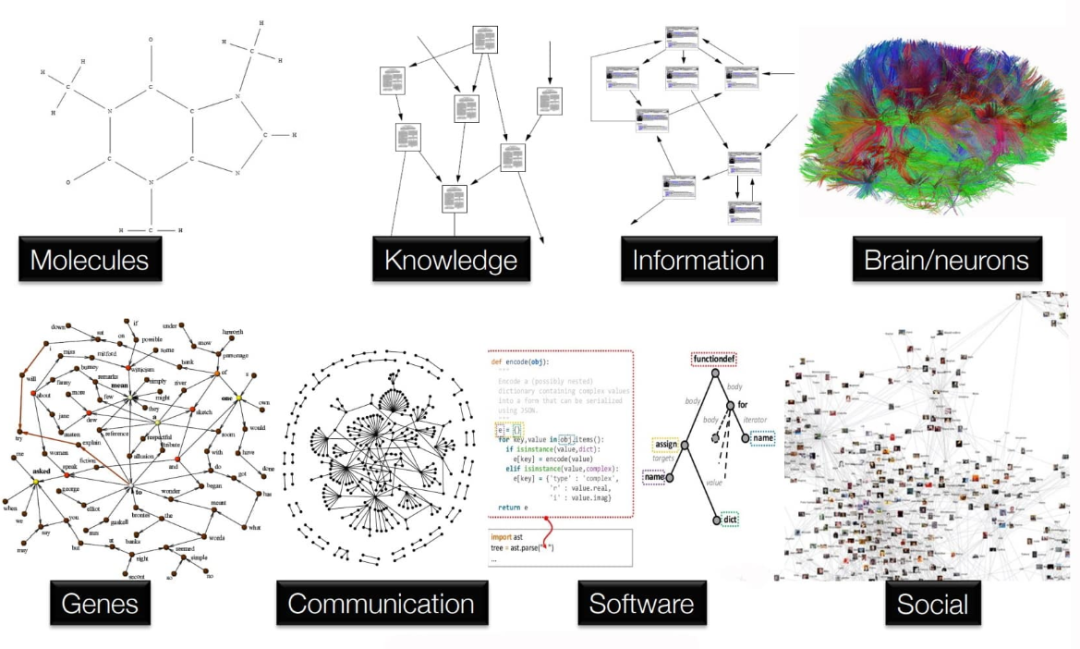

许多科学和工业领域的知识都可以用图来表达

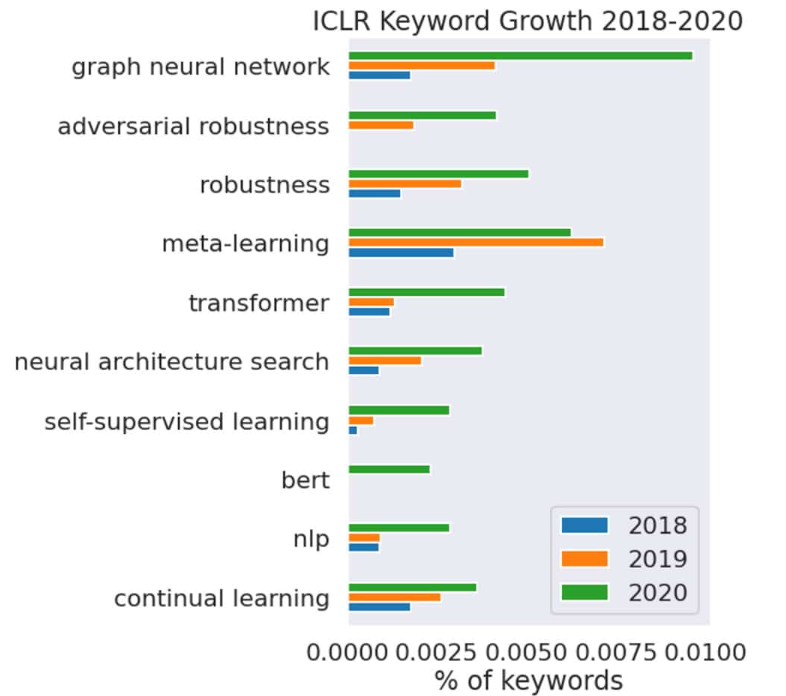

亚马逊云科技(AWS)高级首席科学家 George Karypis 在今年早些时候的讲座中表示:“GNN 是深度学习研究中最热门的领域。越来越多的应用正在使用 GNN 来提高其性能。”

很多人都深表赞同。斯坦福大学副教授 Jure Leskovec 表示:“GNN 正在引得越来越多的关注,它们可以灵活地建立复杂关系的模型,而这是传统神经网络所做不到的。”他在演讲中展示了下面的这张 AI 论文图表,里面提到了 GNN。

谁在使用图神经网络?

亚马逊在 2017 年表示正在使用 GNN 来检测欺诈。2020 年,亚马逊推出了供外部用户用于欺诈检测、推荐系统等应用的公共 GNN 服务。

为了维持客户的高度信任,亚马逊搜索引擎采用 GNN 来检测恶意卖家、买家和产品。借助 NVIDIA GPU,该搜索引擎能够探索具有数千万个节点和数亿条边的图,并同时将训练时间从 24 小时缩短到 5 小时。

葛兰素史克 AI 全球负责人 Kim Branson 在 GNN 研讨会的某场小组讨论会上表示,生物制药公司葛兰素史克维护着拥有近 5000 亿个节点的知识图谱,该图谱被用于该公司的许多机器语言模型中。

LinkedIn 高级软件工程师 Jaewon Yang 在该研讨会的另一场座谈会上表示,LinkedIn 使用 GNN 提供社交推荐,并了解人的技能与其工作职位之间的关系

NVIDIA 杰出工程师 Joe Eaton 表示:“GNN 是通用工具,我们每年都会开发一些新的 GNN 应用。”目前 Joe Eaton 正在领导将加速计算应用于 GNN 的团队。他表示“我们甚至都还没有触及到 GNN 的表层功能。”

另一个迹象也表明了人们对 GNN 的兴趣——Leskovec 在斯坦福大学教授 GNN 的课程视频已突破 70 万次浏览量。

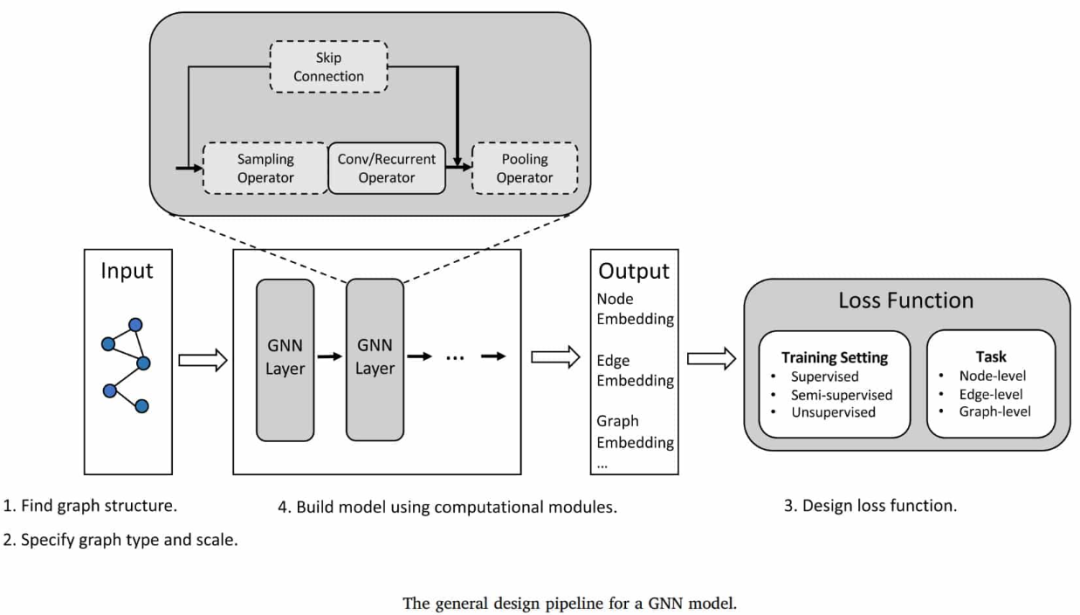

GNN 如何工作?

到目前为止,深度学习主要集中在图像和文本上。这两种结构化数据可以被描述为单词序列或像素网格。相比之下,图是非结构化的,因此可以是任何形状或尺寸,并包含图像、文本等任何类型的数据。

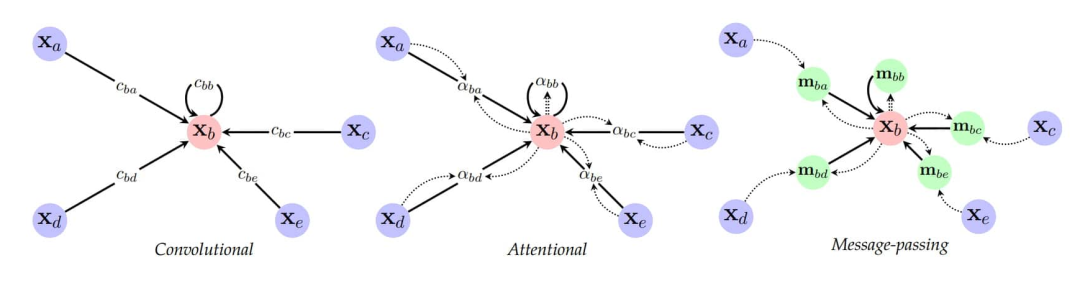

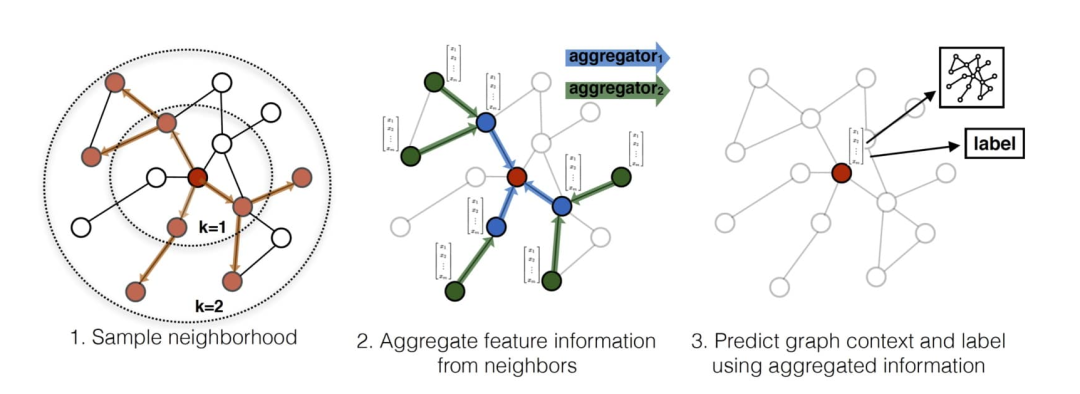

GNN 使用被称为信息传递的流程将图组织起来,以便机器学习算法的使用。

信息传递将关于邻近节点的信息嵌入到每个节点中。AI 模型利用嵌入的信息来寻找规律并进行预测。

三类 GNN 中的数据流示例

例如,推荐系统使用将节点嵌入 GNN 的方式来匹配客户和产品;欺诈检测系统使用边缘嵌入来发现可疑交易;药物发现模型通过比较整个分子图来找出它们之间的反应。

GNN 还有两个独特之处:它们使用稀疏数学,而且模型通常只有两到三层。其他 AI 模型通常使用密集数学并且有数百个神经网络层。

GNN 流程在输入图后输出预测

GNN 的发展史

意大利研究人员在 2009 年发表的论文中首次将这种神经网络命名为“图神经网络”。但直到八年之后,阿姆斯特丹的两位研究人员才使用被称为“图卷积网络”(GCN)的图神经网络变体展示了这种神经网络的力量。GCN 也是当今最流行的 GNN 之一。

GCN 启发了 Leskovec 和他的两个斯坦福大学研究生创造出 GraphSage——一个展示信息传递功能新工作方式的 GNN。2017 年夏天,担任 Pinterest 首席科学家的 Leskovec 对此 GNN 进行了测试。

GraphSage 开创了在 GNN 中传递信息的强大聚合技术

他们所创建的 PinSage 是包含 30 亿节点和 180 亿边的推荐系统,这超过了当时的其他 AI 模型。

如今,Pinterest 将 PinSage 应用于整个公司的 100 多个用例。该公司高级机器学习工程师 Andrew Zhai 于在线座谈会上表示:“没有 GNN,Pinterest 就不会有今天的吸引力。”

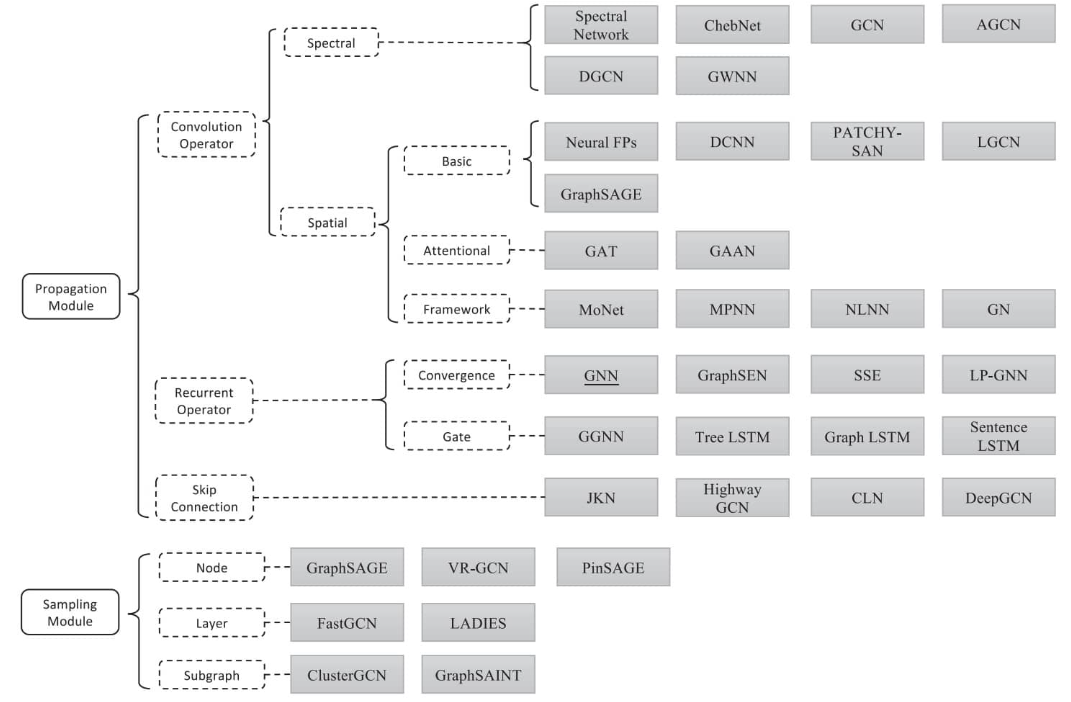

与此同时,其他变体和混合体也纷纷出现,包括图循环网络、图注意力网络等。GAT 借用 Transformer 模型中定义的注意力机制,帮助 GNN 专注于数据集中最相关的部分。

GNN 变体家族树概览图

扩展图神经网络

展望未来,GNN 需要进行全方位的扩展。

还未维护图数据库的企业机构需要使用工具来减轻创建这些复杂数据结构的工作负担。

使用图数据库的人都知道在某些情况下这些数据库会不断扩大,单个节点或边缘会被嵌入成千上万个特征。这为通过网络将存储于子系统中的海量数据集高效加载到处理器中带来了挑战。

Eaton 表示:“我们正在提供各种产品来最大程度地提高加速系统的内存、计算带宽与吞吐量,以便解决此类数据加载和扩展问题。”

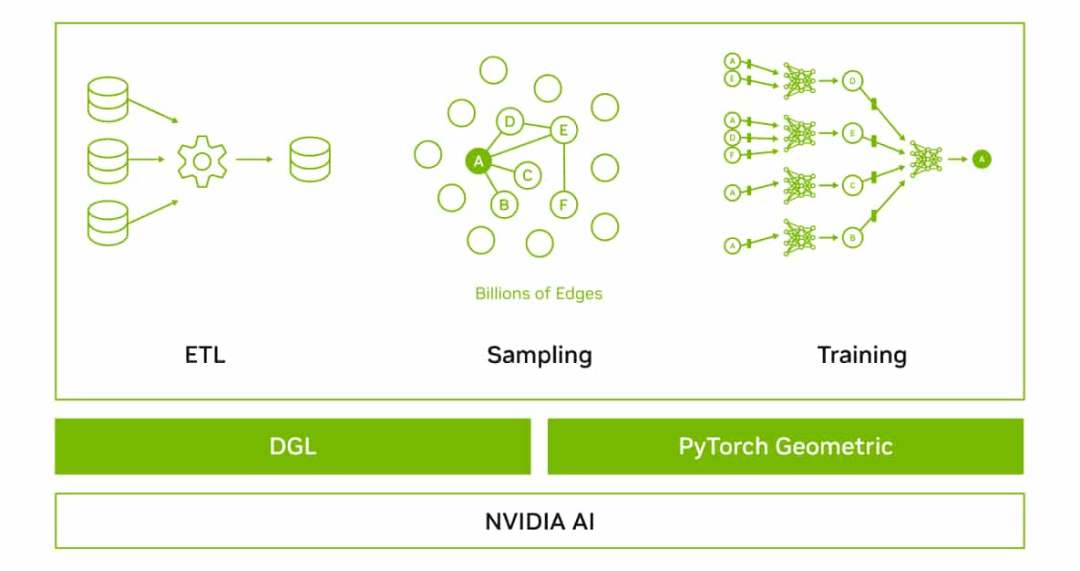

作为这项工作的内容之一,NVIDIA 在 GTC 上宣布,除了深度图库(DGL)之外,公司现在还支持 PyTorch Geometric(PyG)。这是当下最流行的两个 GNN 软件框架。

NVIDIA 提供多种工具加快 GNN 的构建

经过 NVIDIA 优化的 DGL 和 PyG 容器针对 NVIDIA GPU 进行了性能调整和测试。它们为开始使用 GNN 开发应用的人提供了方便的平台。

审核编辑:郭婷

-

神经网络教程(李亚非)2012-03-20 58285

-

神经网络简介2012-08-05 3577

-

MATLAB神经网络2013-07-08 12173

-

神经网络基本介绍2018-01-04 1997

-

【PYNQ-Z2试用体验】神经网络基础知识2019-03-03 3978

-

全连接神经网络和卷积神经网络有什么区别2019-06-06 6021

-

卷积神经网络如何使用2019-07-17 2885

-

【案例分享】ART神经网络与SOM神经网络2019-07-21 3313

-

什么是LSTM神经网络2021-01-28 2976

-

如何构建神经网络?2021-07-12 2011

-

基于BP神经网络的PID控制2021-09-07 2734

-

神经网络移植到STM32的方法2022-01-11 3265

-

卷积神经网络模型发展及应用2022-08-02 13379

-

MindSpore图神经网络BGCF2022-01-25 885

-

什么是神经网络?什么是卷积神经网络?2023-02-23 5313

全部0条评论

快来发表一下你的评论吧 !