聊聊VR技术背后的原理

vr|ar|虚拟现实

描述

有幸拿到了Pico 3 企业版本和L同学的Oculus Quest 2,在体验之余不妨写一篇杂文来聊聊VR这个看着不新但是又很新的东西。

我想在具体的聊使用体验这些东西之前,先来看看设备的参数,如果有可能的话还想写一些原理的东西。

我觉得对于VR来说,我们想到的,最直观的也就是镜头了,所以先写镜头:

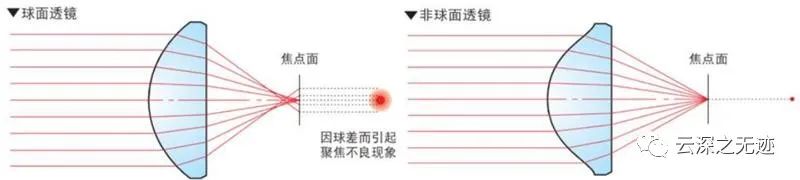

非球面透镜可有效解决球差问题,在早期VR头显应用较多

传统透镜在 VR 应用以非球面透镜为主,体积/重量较大,应用逐渐减少。

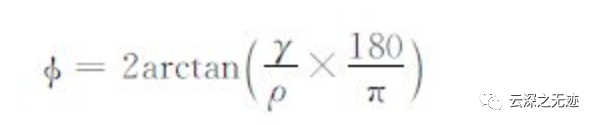

透过菲涅尔透镜形成更大视觉范围,呈现出近似于 120° 的视角,接近于我们观看世界的角度。瞳距有三档可调,掰动其中一边便可调节双瞳距离。

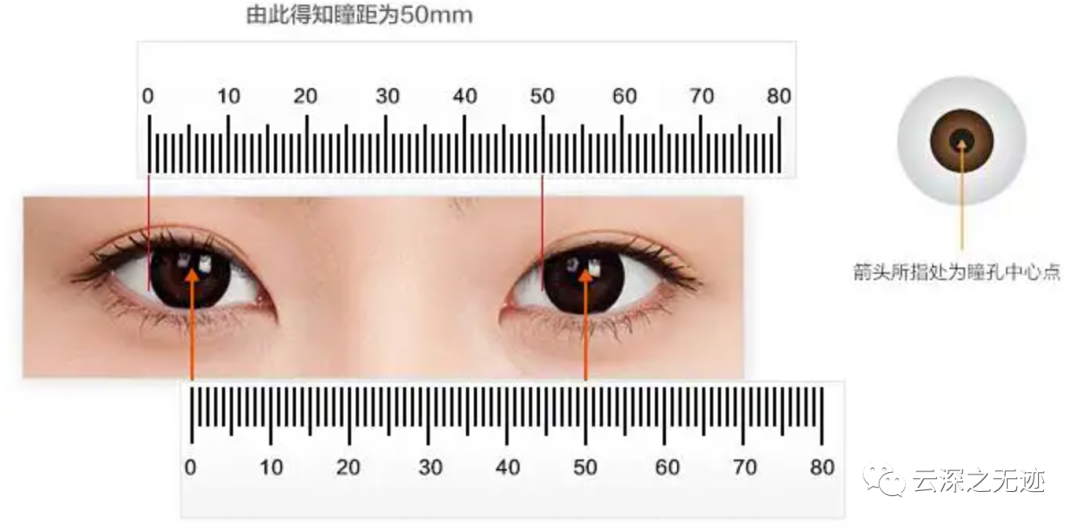

“瞳孔距离简称瞳距,正常值范围在58-64mm之间,本身是个人的遗传和发育决定的。瞳孔距离指的是双眼瞳孔正中心之间的长度,

百度百科

自己量下?

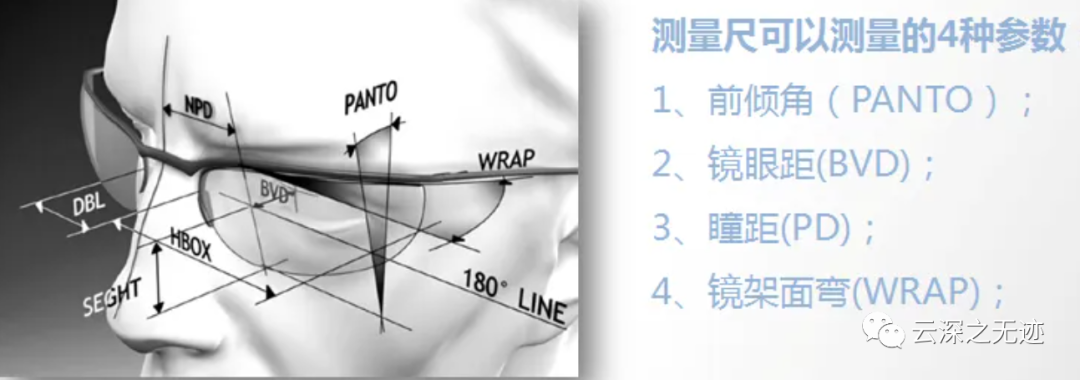

对于这个眼参数也需要这些参数

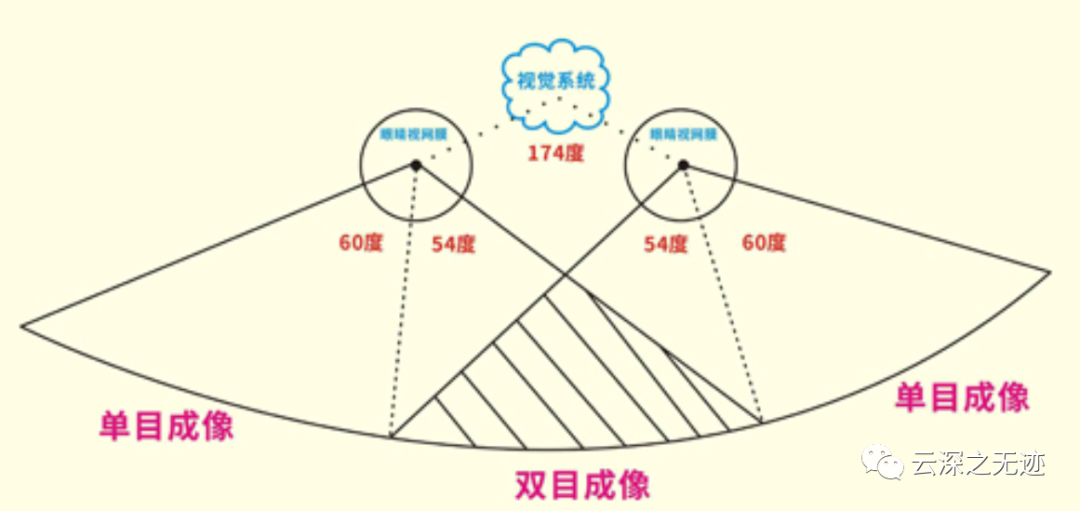

瞳距就是瞳孔的距离,正常人的双眼注视同一物体,物体分别在两眼视网膜处成像,并在大脑视中枢重叠起来,成为一个完整的、具有立体感的单一物体,这个功能叫双眼单视。但是,婴幼儿在双眼单视形成过程中,很容易受外界因素影响,致使一眼注视目标,另一眼偏斜而不能往同一目标上看,于是就产生了斜视。医学上将眼球注视物体时向内侧斜视,称为内斜,也就是人们俗称的“斗鸡眼”。

配戴眼镜时需要测量瞳距,瞳距分为:远用瞳距,近用瞳距,常用瞳距。测定时,是按一定的距离测出这三种瞳距的。

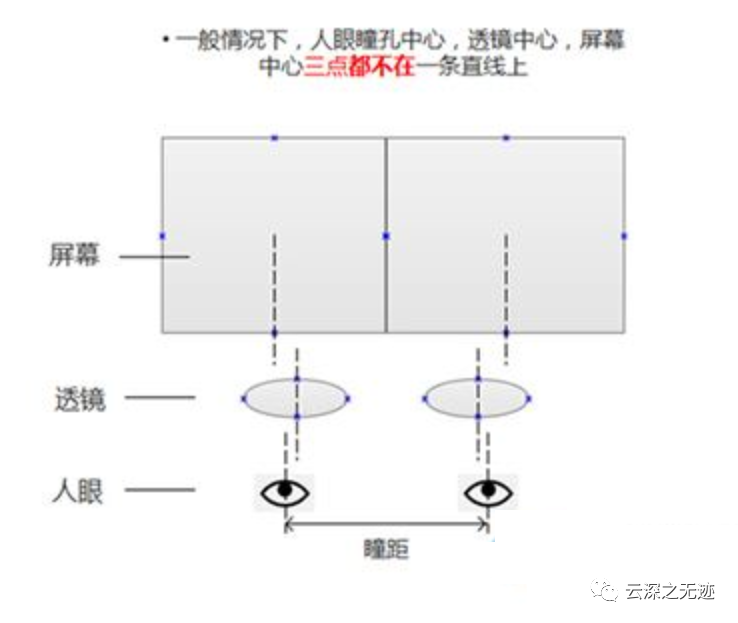

虚拟现实眼镜一般都是将内容分屏,切成两半,通过镜片实现叠加成像。往往情况就像下图一样,眼镜的瞳距和我们的眼睛不一样。

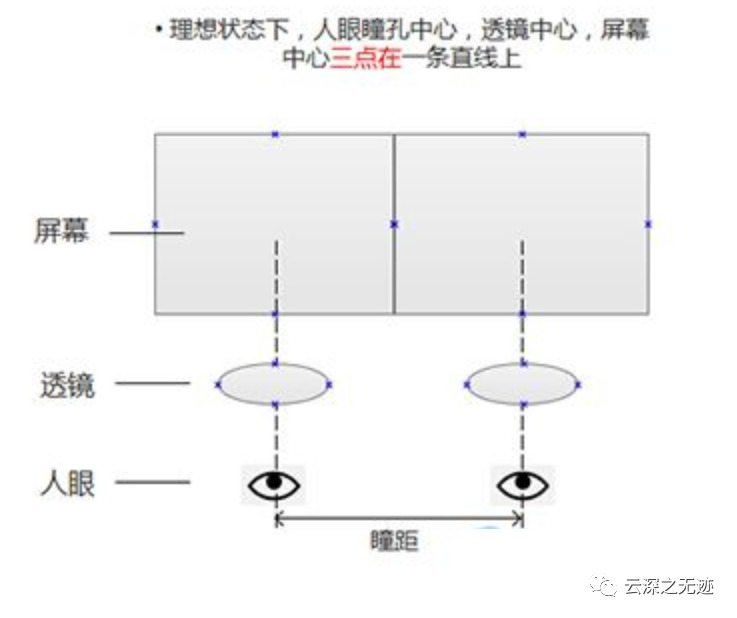

最理想的瞳距应该是这样的,如下图:

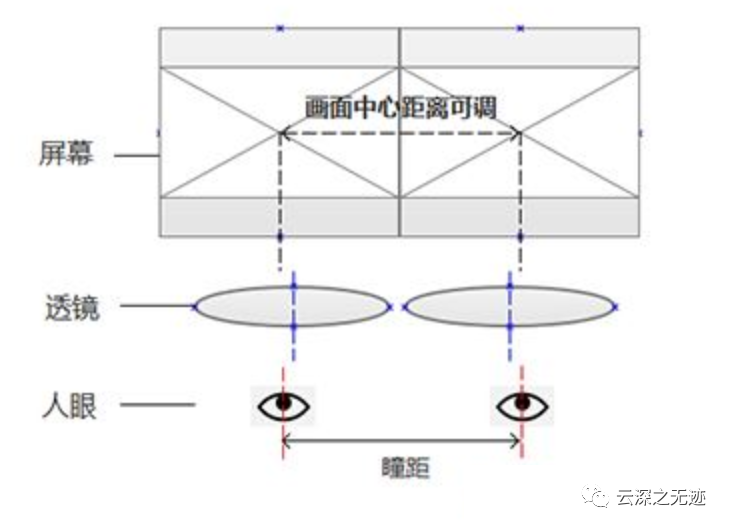

可以用透镜覆盖人眼瞳距范围,然后使用软件调节画面中心和人眼对齐来保证3点一线:

这就是调节瞳距的基本原理

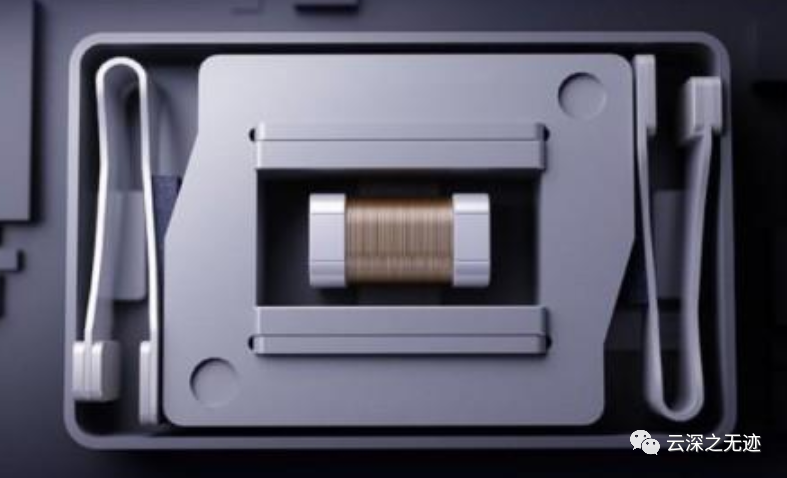

在不久的将来,眼动技术的使用,这个调节的过程是集成到眼镜内部的,就像pico4给出的电动调节一样:

就是这样

基于凸透镜基本原理,如果想使其焦距变短,满足近眼成像模组体积缩小的需求,主要有两种路径:

1)增加透镜厚度:通过增加透镜中央与边缘厚度差,增强透镜对光线的折射能力;

2)多组透镜叠加:缩短整体透镜模组焦距。

但是,无论采用哪种方式,短焦距与轻薄化的设计诉求在传统透镜上必然存在严重冲突。

菲涅尔透镜本质是扁平版凸透镜,因体积较小且工艺成熟被目前市场上多数 VR 头显采用。

光传播的方向在介质中不会改变(除非是散射光),而是在介质的表面偏离。因此,透镜中心的大部分材料只会增加系统内的重量和吸收量。基于此原理,菲涅尔透镜在传统透镜的基础上去掉直线传播的部分,而保留发生折射的曲面,从而达到省下大量材料同时又达到相同的聚光效果。

很明显就是光路的变短

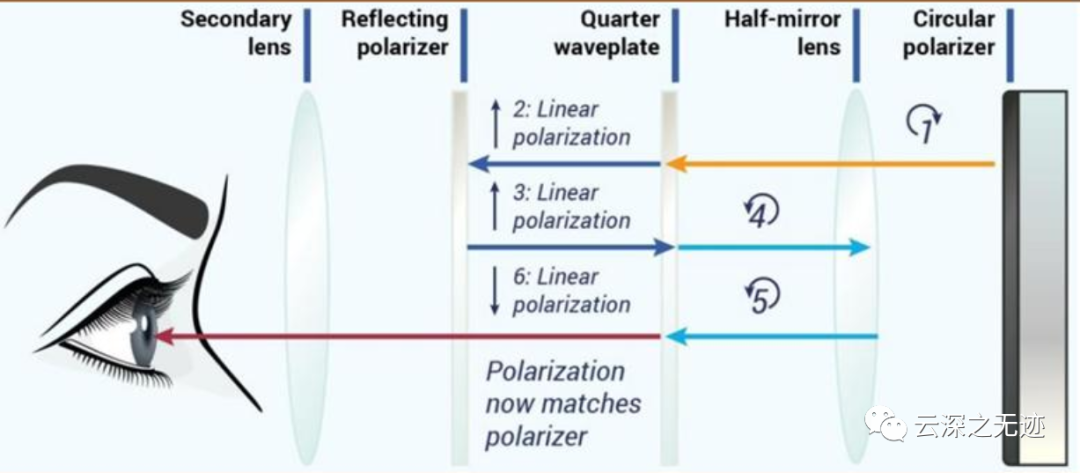

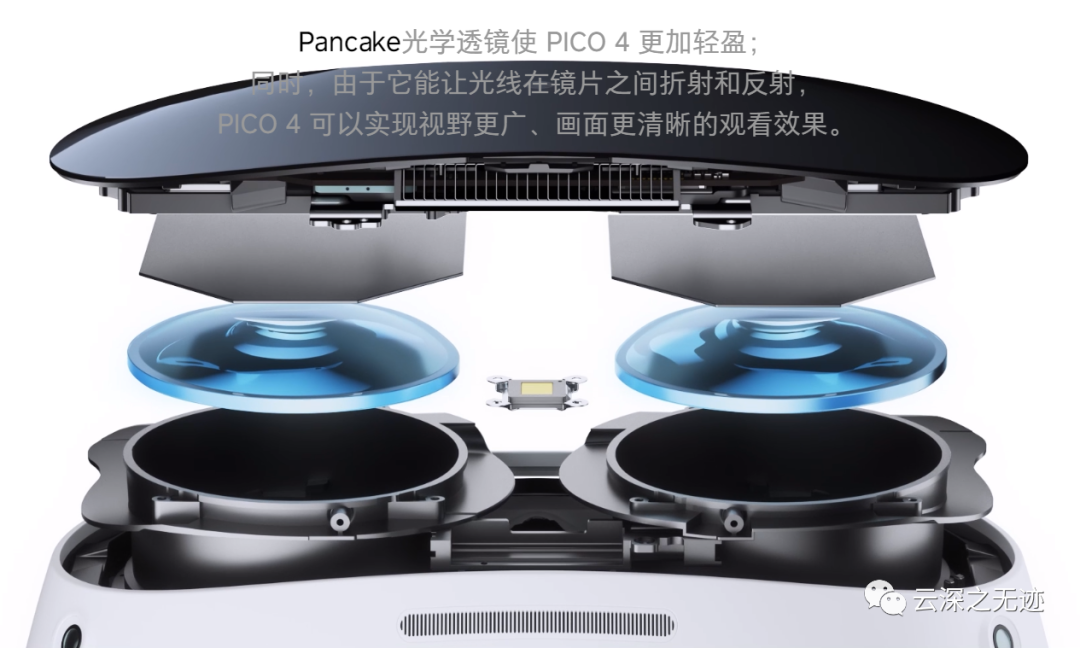

Pancake 光学方案设计以偏振光原理为基础,利用反射偏光片(Reflecting polarizer)对于不同偏振光选择性反射和投射的特性,配合 1/4 相位延时片(Quarter waveplate)调整偏振光形态,实现光线在半透半反镜(Half-mirrorlens)和反射偏光片之间的来回反射,并最终从反射偏光片透射出去。方案进一步压缩了模组厚度,提升了用户的舒适度和沉浸感。

以下图为例,圆偏振光在通过 1/4 相位延时片后变为线偏振光到达反射偏光片并被反射,接着第二次通过 1/4 相位延时片变回圆偏振光被半透半反镜反射并第三次通过 1/4 相位延时片,再次变为线偏振光,因为本次相比第一次光线旋转 90°,得以通过反射偏光片完成成像。

多次的反射过程

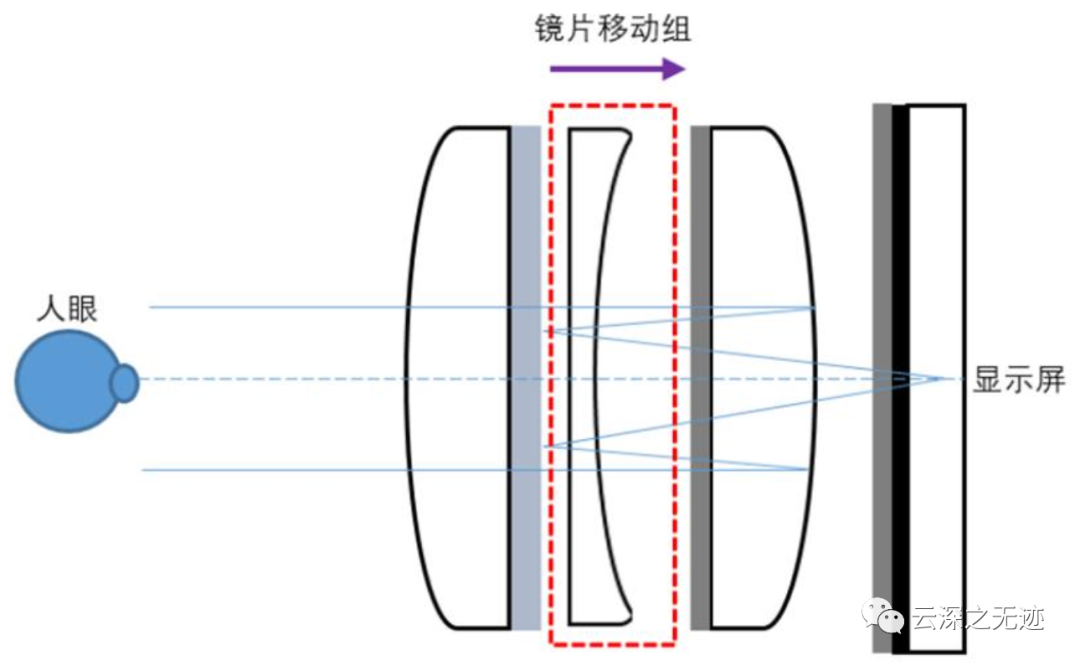

Pancake 方案为组合透镜,通常可通过控制其中一片透镜位置进行屈光度调节。对于近视用户而言,过往佩戴 VR 头显进行屈光调节更多采用的是更换镜片的方式,试戴过程麻烦且调档选择较为有限。

而当光学方案升级到 Pancake 技术时,屈光度调节方式有了更多更便利的选择。因为 Pancake 方案一般为多组透镜的组合,可以通过移动其中一组镜片调整整个光学模组的折射率,从而满足调焦需求,这种方式对于传统单片非球面透镜和菲涅尔透镜方案就无法实现。当然,VR 头显也可通过移动屏幕来调整屈光度,但是外调焦方式会改变整个模组总长,头显设计时需要预留体积空间,轻薄性较差。

当设备使用时候,人眼焦点调节与成像纵深感不匹配,由此产生视觉辐辏调节冲突(VAC 现象),使得用户在佩戴VR 头显一段时间后会感到头晕或疲劳。可变焦显示技术(机械式)通过电机+齿轮传统系统对透镜位置进行移动,并与眼动追踪技术相结合,基于眼部细微特征变化校订模组焦距,模拟人眼自然成像,从而解决 VAC 眩晕问题。

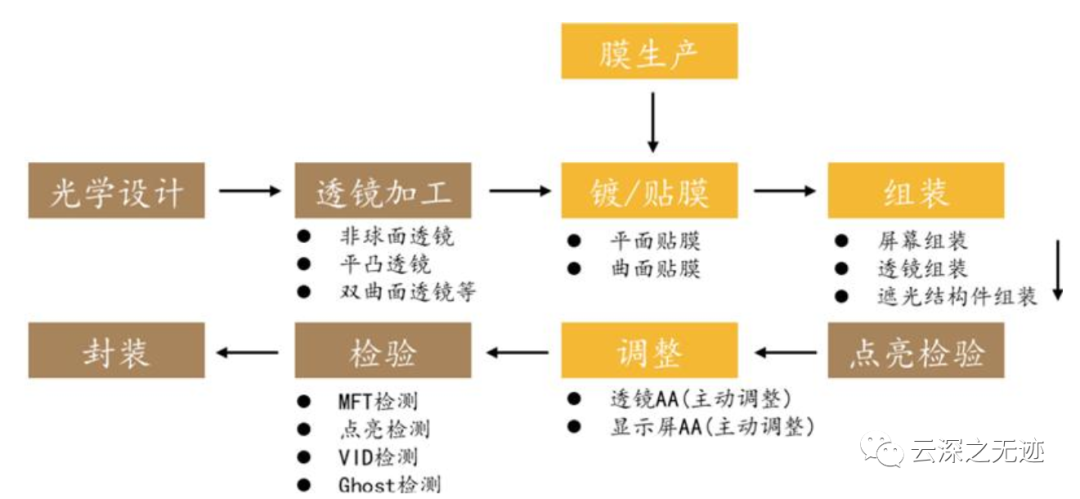

最大的问题就是这个光学镀膜上面

目前市面上的 Pancake 方案也存在几个明显问题:一是光利用率低,理论上只有25%,光效较低,通常仅约 10%。受光学原理限制,光线在 Pancake 模组中每次经过偏振/半反射环节,光效损失 50%。以两片式 Pancake 简易模组为例,光线从屏幕发出后至少经过一次圆偏振镜,两次半透半反镜,光效折损已到 12.5%,考虑光线传播中不可避免的其他损失,通常 Pancake 模组光效仅约 10%。因此,Pancake 光学方案通常对屏幕亮度要求更高,光学与显示方案需配套迭,代厂商在打造头显时要搭配高亮度屏幕,此举一定会提高成本和功耗;

第二,Pancake 如果光路精度不够,就容易在画面里出现鬼影;第三,由于 Pancake 的核心是光学膜,所以造价本相对菲涅尔透镜高了接近10倍,成本上升明显。

几种传统的方案对比

Pancake+可变焦+眼球追踪有望成为未来 VR 新头显的主流装机趋势。相较于人眼自然成像,VR 头显屏幕发出的光线没有深度信息,光学模组焦距固定。

一块1.3inch的OLED显示器,分辨率为2560x2560,120FPS,10bit+HDR,是的,VR里面的显示器的素质是极高的。

但是使用Pancake以后使用偏振光将图像多次反射,那么这个效率就很低了,这样说,如果你想保持和以前的显示效果的亮度输出,那么就需要更多的显示器能量输出,也就是说,在功率,散热,以及系统供电上面又是一个大挑战,而且Pico4现在就是出现这个问题。

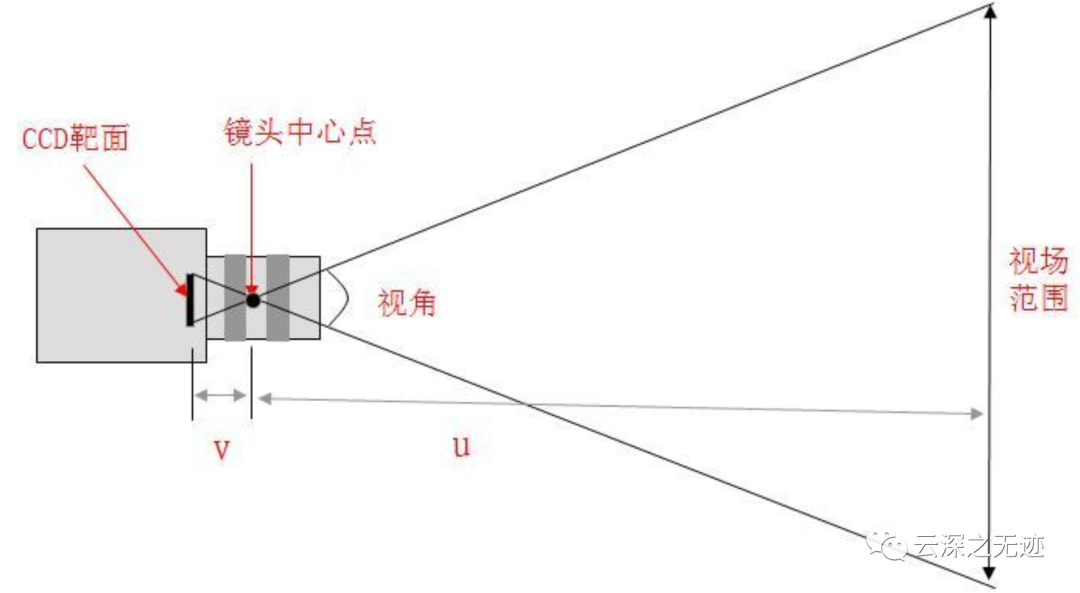

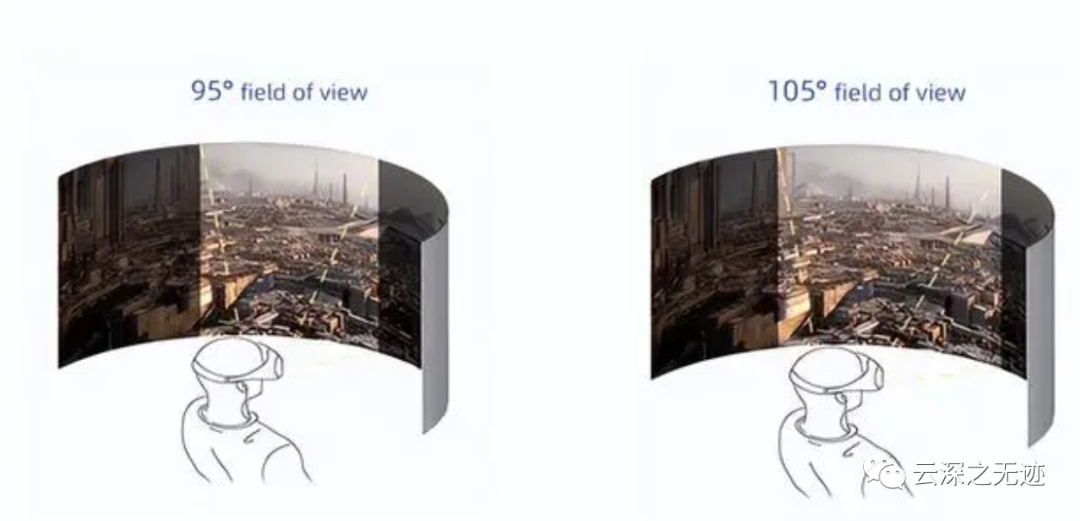

这些厂子明的暗的会说一个参数叫视场角,这里也写一下。

视场角在光学工程中又称视场,视场角的大小决定了光学仪器的视野范围。视场角又可用FOV表示,其与焦距的关系如下:像高 = EFL*tan (半FOV);EFL为焦距;FOV为视场角。那这个概念很容易的就也放到了人眼里面,毕竟这些机器都是模拟人眼的咩~

先看摄像头系统里面的视场角的定义

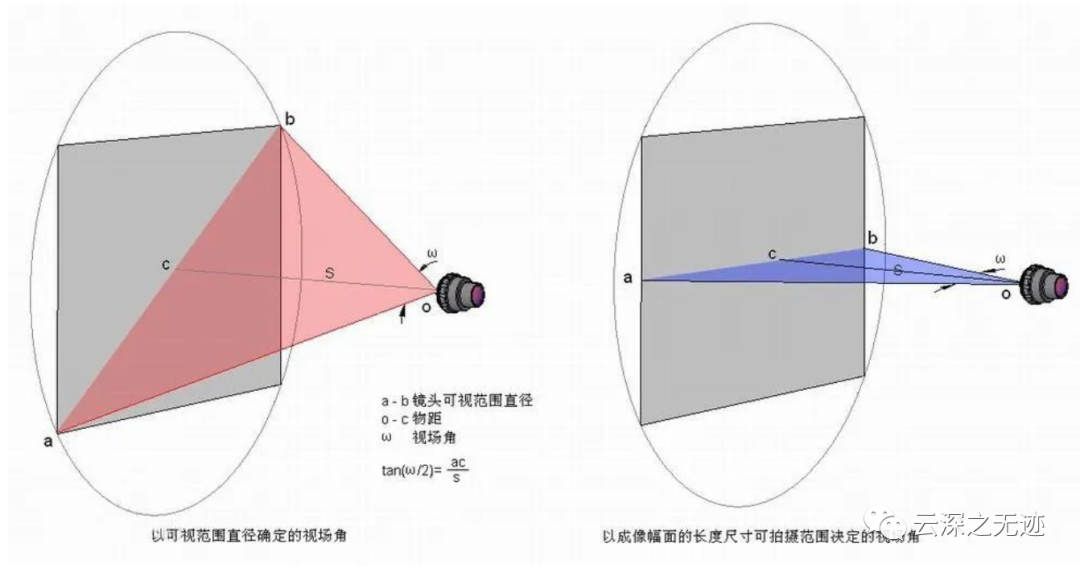

以及现在说的两种视场角的定义方式

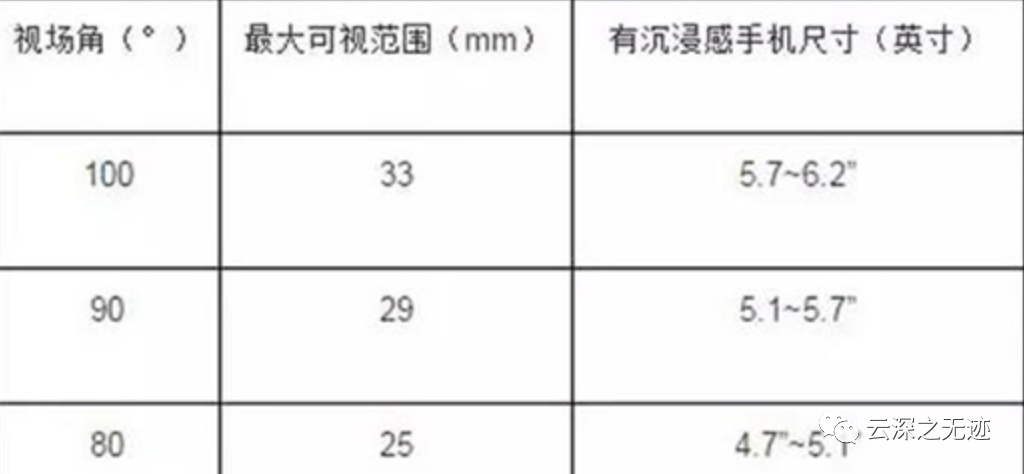

这里有个文献是给出了手机尺寸和可视角的关系,看这个就知道有写推广的文案写什么大屏幕,有什么沉浸感,一看就是狗屎,笔给我我写,手机这个东西就没有沉浸感这个东西。

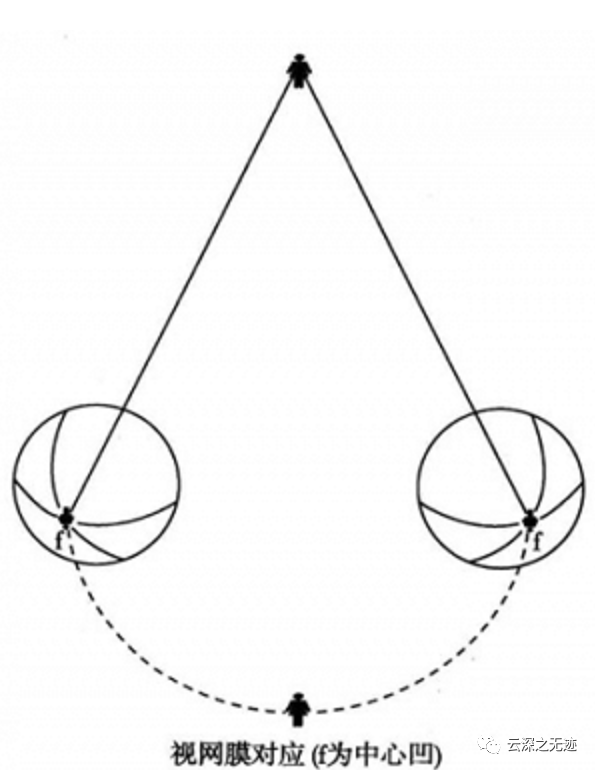

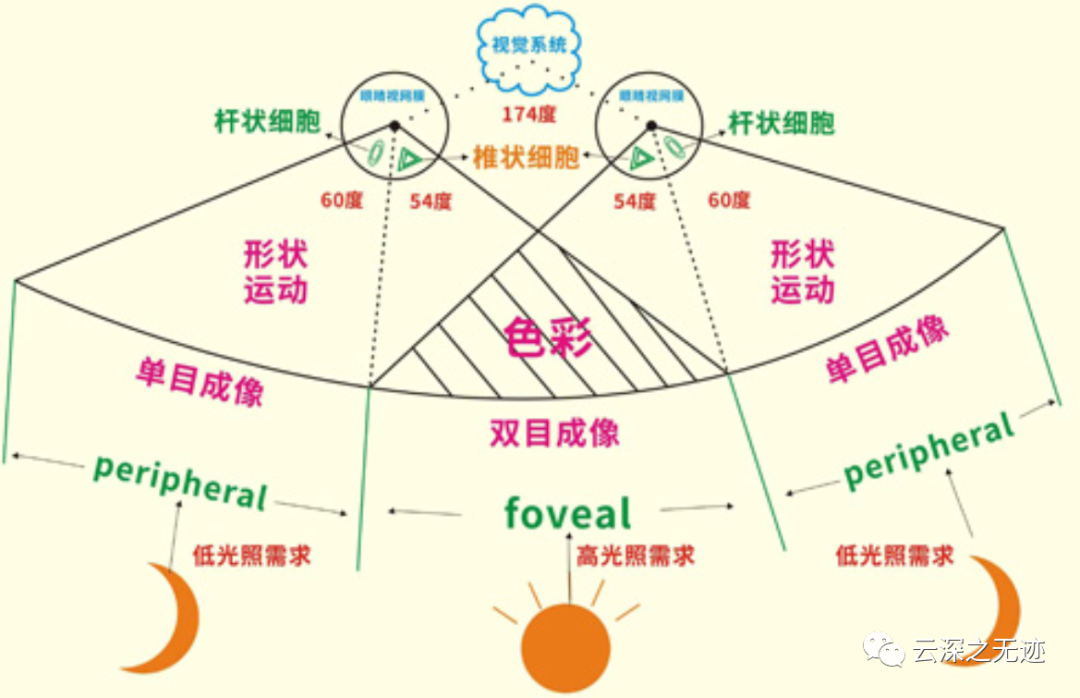

其实说视场角就不得不提一下这个关于中心凹的问题:

视网膜对应关系

中心凹是眼睛的一个关键区域,它使人们能够以非常清晰和精确的方式看到东西。大概就是视野中心30°,也就是视场角为30度。

光场显示器支持人类视觉系统的两种聚焦机制,医学上称聚散(Vergence)和调节(Accommodation)。

聚散即双眼相互向内或向外运动,让影像能投影到两眼视网膜的中心;调节即调整眼睛晶状体收缩使外界物像位于视网膜上,从而看清物体。眼睛就像一部照相机,需要通过调整自身镜头(晶状体收缩)的长短来看清晰近处与远处的物体。

目前市场上的大多数VR/AR头显只支持聚散,但不支持调节,这意味着图像在技术上被固定在一个固定焦深(焦点深度)。 有了光场显示器,用户可以在VR/AR头显场景中任何深度聚焦,就像看现实世界场景一样。其实只要支持可支持任意深度对焦就可以,其实只要有这个能力都可以称之为光场显示器。

正常人的视力范围比视野要小,因为视力范围是要求能迅速、清晰地看清目标细节的范围,只能是视野的一部分。

那到底能不能给出一个立体的可视范围呢?

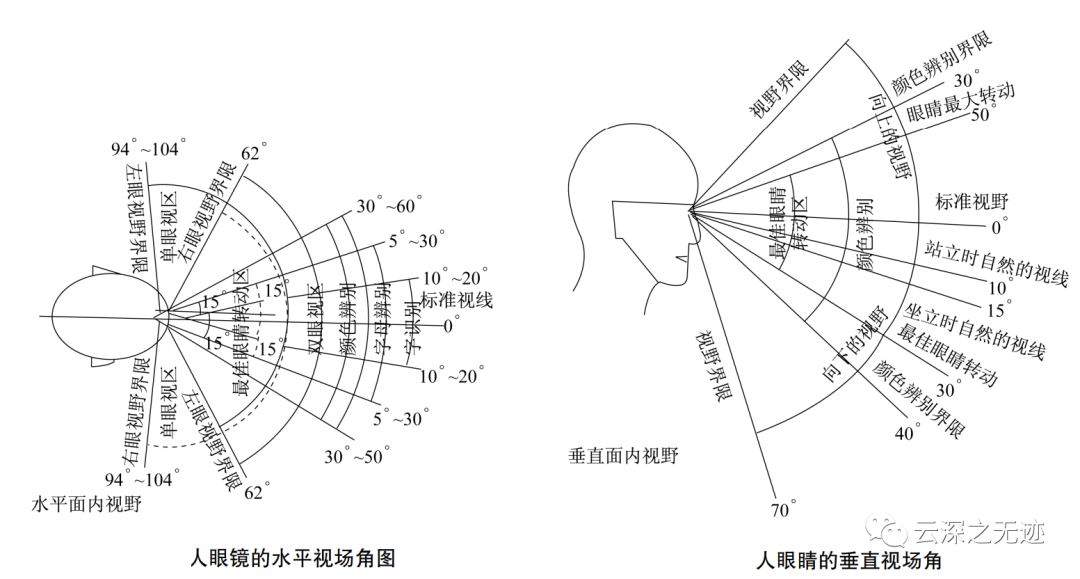

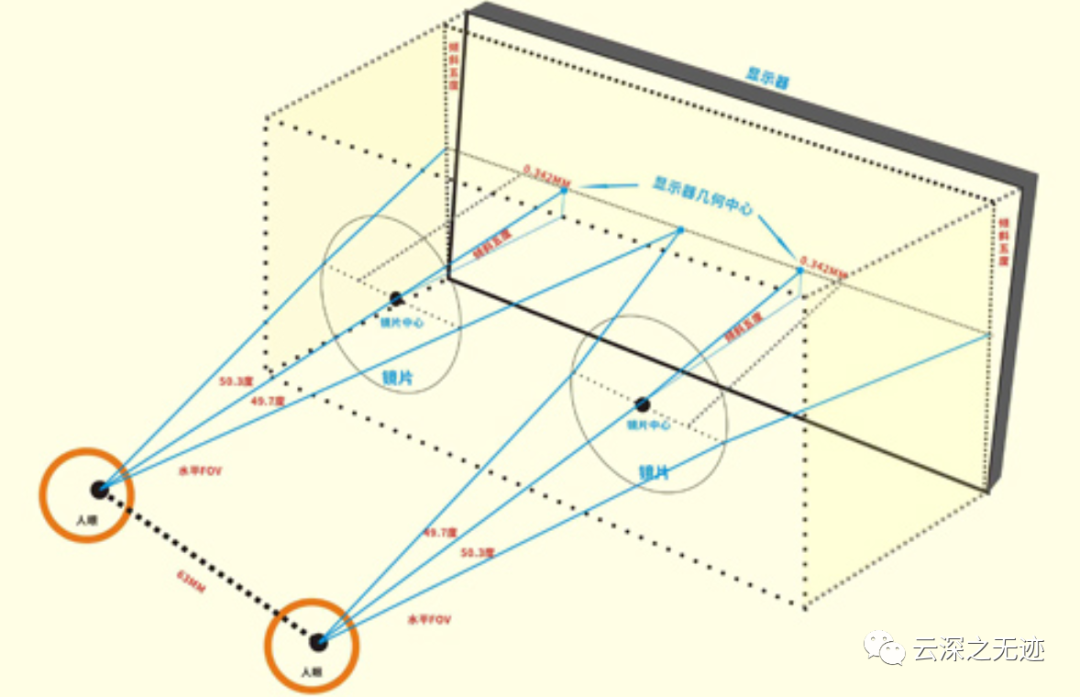

在垂直方向的视野中,立姿时视线方向在视轴以下10°;坐姿时视线方向在视轴以下15°;而当视角为30°~40°时,可以迅速而有效地扫视,称其为有效视力范围。人眼的水平视场角和垂直视场角如下所示:

水平与垂直的视场角

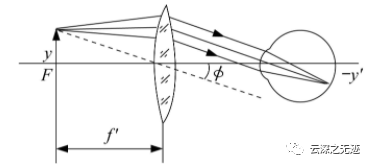

接下来是一个简单的视场角推导过程,有兴趣的可以与我索要相关文献:

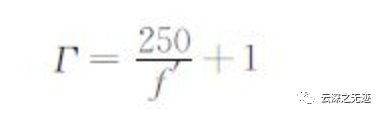

将物象放在透镜的焦距附近时,人眼睛可以看到放大的像。放大倍数为:

式中f′为透镜的焦距。人眼镜看到的视场角为:

式中:γ为透镜的半径;ρ为出瞳距离。

有个文献说,最佳的可视角场应该是120,我没有找到更多的证明过程

但是我们可以明确一点的是:视场角是决定VR全景沉浸体验的因素之一,一般来说角度越大,沉浸角度越好。

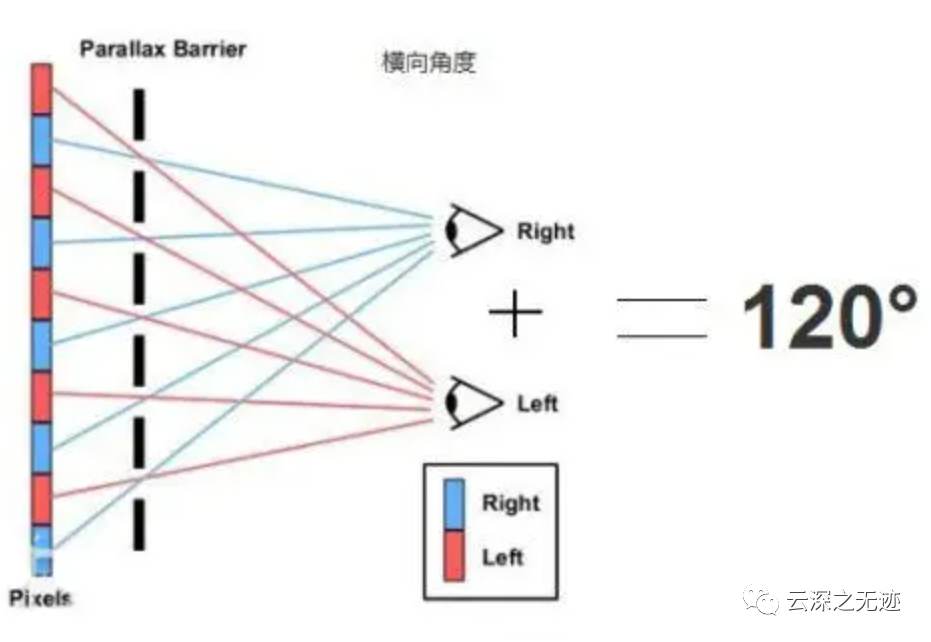

以上都是单纯的解释了一个概念,现在让我们放在显示系统里面看一下:

在显示系统定义中,视场角是指显示器边缘与眼睛连线的夹角。在视力正常的情况下,人类获取视觉感知都是通过双眼来进行的,而两眼视网膜对同一被视物体的成像并不完全相同,人类大脑视觉高级中枢对来自两眼的图像信息进行处理后,形成的视差可以辅助产生精细的深度知觉,进而产生立体视觉。在VR头显的定义中,头显的视场角越接近人眼的自然视场角,就越有利于产生更好的沉浸感和临场感。

现有的技术条件,要获得更大的视场角,只有一个解决方向,那就是人眼缩短与透镜镜片间的距离或增加透镜镜片的大小。缩短与透镜间的距离,由于透镜与眼睛的距离过近,会导致看不清画面、纱门效应严重或者伤害眼睛。而采取直径较大的透镜增加视场的方案,会带来光学畸变等像差的问题是无法解决的。

以这样的显示区域看,其实可以考虑使用上面的显示器方案更加的模拟人眼对这个世界的感知。4倍超采样抗锯齿

而pico4也是和pico3相比提升了10°的FOV

其实大家都只是在关注VR的显示器是怎么样的,其实对于这个东西,带来的是一种全新的交互方式,就像下面,我一直不理解这是什么鬼设计???圆圈,在内部又是一个棍子的样子,其实是红外线,使用外部的摄像头来捕捉。

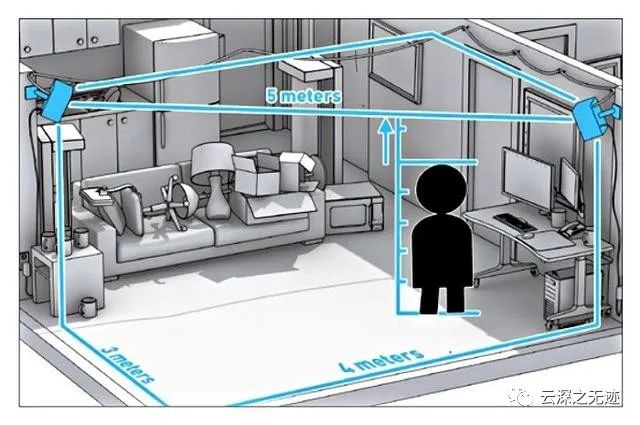

目前VR主流空间定位方式有两种: (1)Outside-in(由外而内的定位):顾名思义,需要在环境中布置定位器,实现从外到内的位置计算。

(2)Inside-out(由内而外的定位):由内向外的空间定位不需要额外布置空间定位设备,借助VR设备自身的传感器进行环境的感知与事实位置计算。

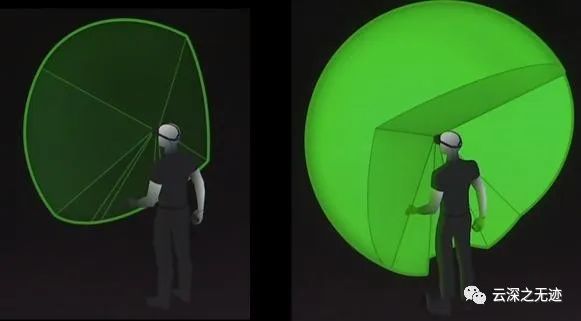

这个就是捕捉的空间范围

这里可以侧面看一下这个捕捉的工作空间 在捕捉啦~

正面

侧面

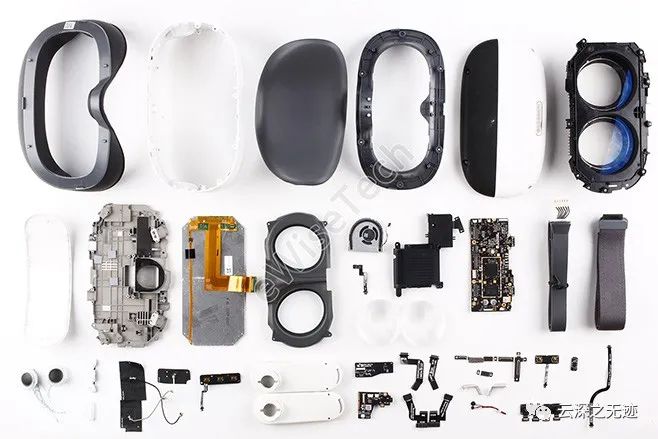

因为是体验,我就不能拆了,这里就是找了拆机图

可以看到确实是有这个红外的发射器,然后有读者朋友有坏的VR设备有可以给我研究一下。

厂家注意,我没有拆,网上拿的图,Neo3的拆机图

手柄里面还有一颗超宽频X轴线性马达,这个是啥呢? 每一款型号的线性马达都天生拥有一个固定的硬件参数:F0。 它描述的是马达内部弹簧的谐振频率,业界原始马达的谐振频率F0 为235 Hz,这个依据的理论是手部对外界信号在 235 Hz感知最为敏感,但这并不意味着这是人体感觉最舒适的频率,通过业界不断的测试和验证,现在触觉反馈行业普遍认为,将F0设定为130Hz可以让整体体验最为舒适。

简单的来说就是更加的贴合自然的响应,放大的样子

理论大概就是这样了,看机器吧~

先出场的是Quest2,背景杂乱,别喷,东西太多了。

有个盒子,真不错

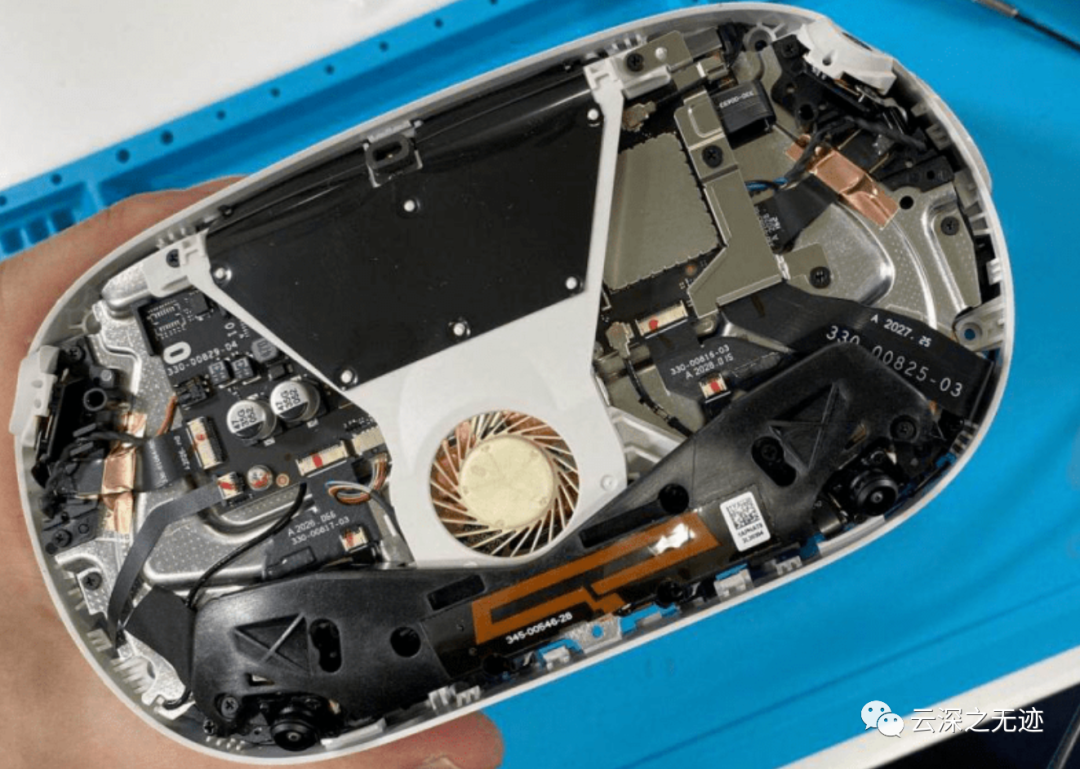

这个是拿到的一代的拆机图,还是比较复杂的

装有风扇进行一个散热处理

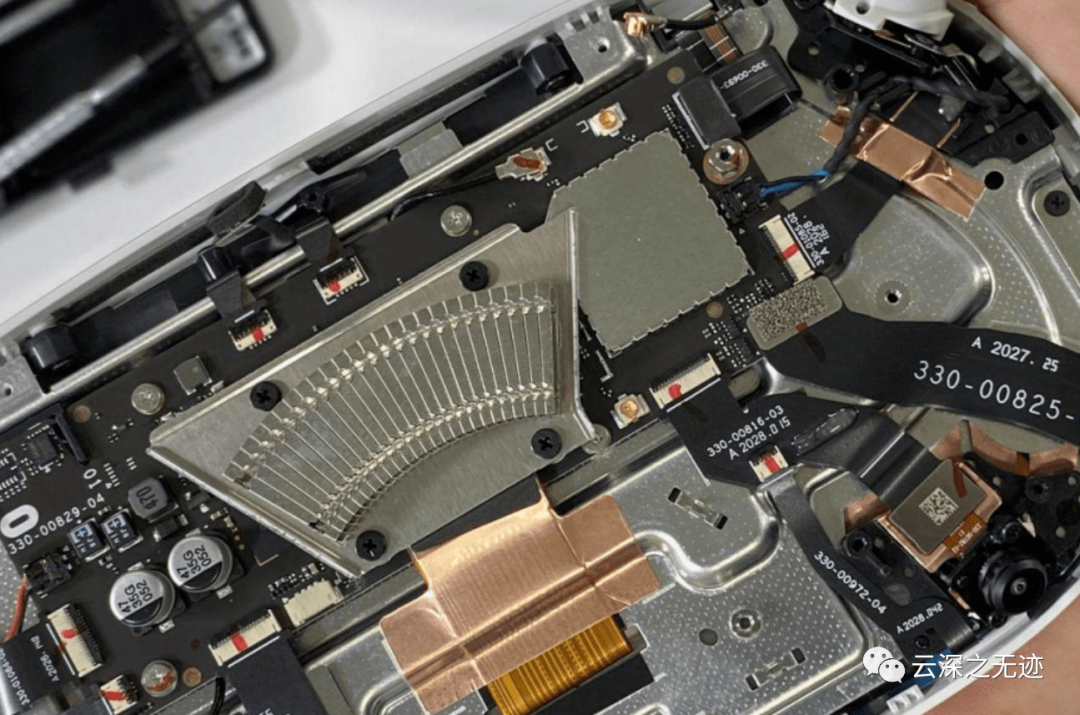

扇状的散热器

Snapdragon XR2芯片上涂满了导热化合物,以确保芯片和散热器之间有着良好的热量传递。

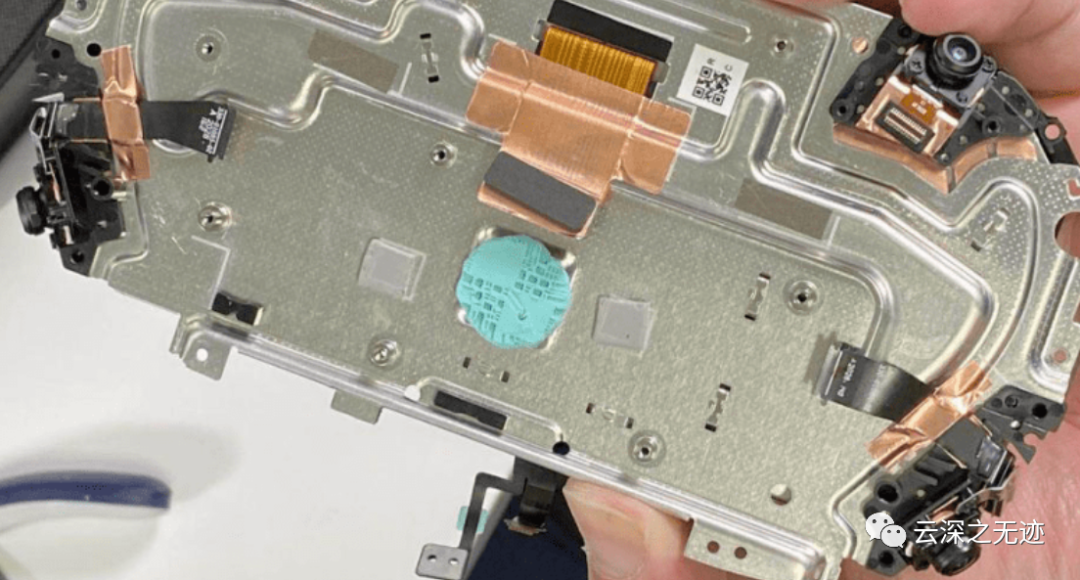

几个inside-out相机,捕捉使用

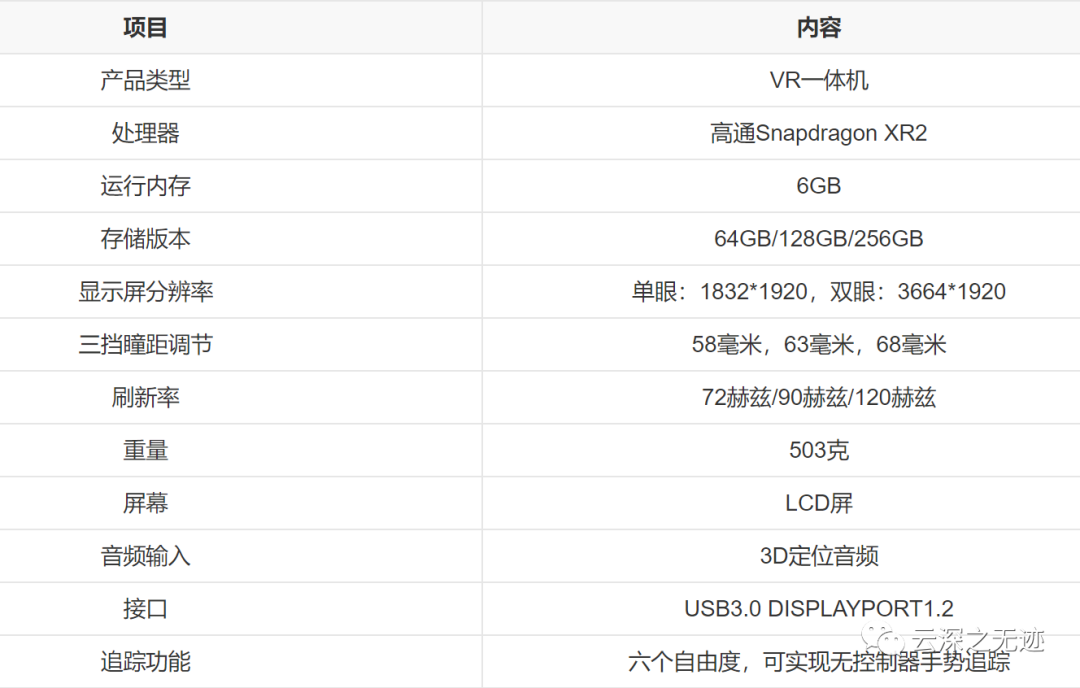

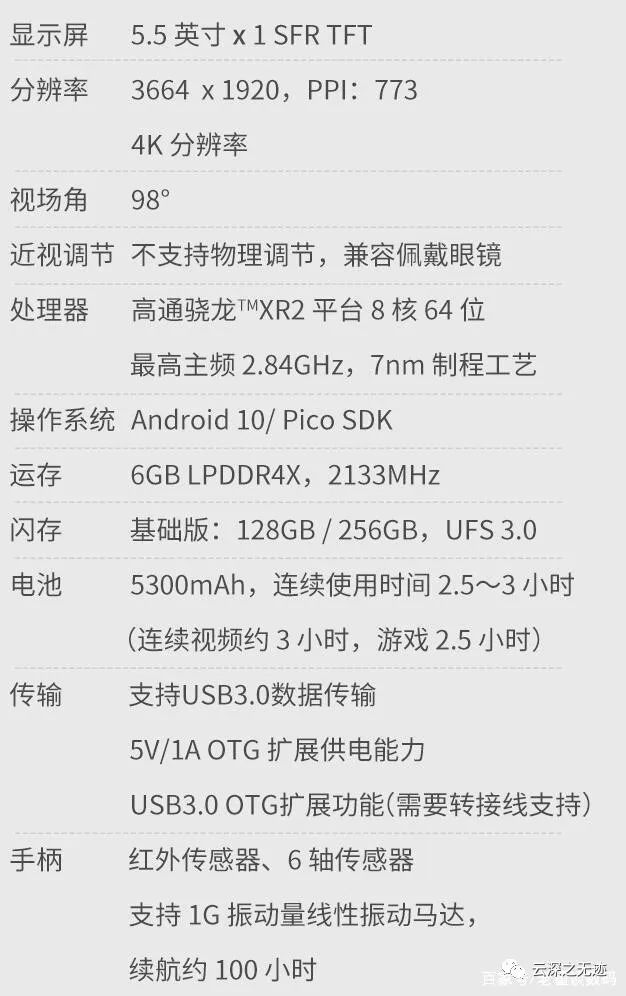

先看一下简单的参数

Oculus Quest 2具备5G接入的能力。不仅可以独立运行,还可以通过Oculus Link电缆连接到PC,跟PC端进行串流,通过连接到游戏端PC,就可以获得PC端的VR游戏库和较为流畅的游戏体验。并且还可以同时运行Oculus自带的应用商店以及SteamVR游戏库。 其实这个功能你觉得就是一个数据联通的功能,但是对于VR本身来讲,视频源的质量越好,效果是越好的,那么在串流的时候,这个高速的联通功能就锦上添花了,你可以这样认为,它是锦上添花的。 Oculus Quest 2采用屏幕侧滑三档调节(58毫米、63毫米和68毫米)的方式来调节瞳距。,这个就是相当于手动的调节了。 Oculus Quest 2续航为两至三个小时,用户可以一边使用Oculus Quest 2,一边连接到电源插头使用,因为设备的续航随着你使用的次数增多,是变差的,但是加上这种一边充电一边使用的模式,就会缓解一些续航的焦虑,其实这个虚拟的环境你融入进去,由于电量的原因再脱出来,其实是痛苦的一件事情,就好像你睡的很舒服的时候,有人把你捅咕起来,然后再告诉你,没事了,二狗睡吧! 睡nmp睡,不睡了,就是现实和虚拟这种的切换,我觉得也是一个要关注的事情。 Oculus Quest 2有两种使用模式,分别是房间缩放和固定。房间缩放可以允许用户随便走动,具备防碰撞功能,当用户即将要碰撞到墙面的时候,游戏中的边界会自动弹出,用来防止用户受伤。

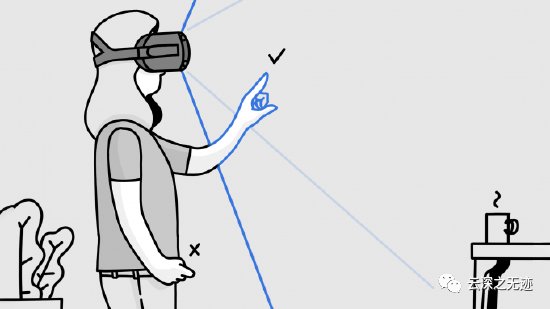

Oculus Quest 2具备Passthrough透视背景功能,用户可以戴着头显看到外面的画面,用户连续拍两下头显就可以选择关闭或者打开Passthrough视图,感觉是大家的标配 Oculus Quest 2追踪功能 Oculus Quest 2追踪方面采用的是由内而外的追踪,可以在不需要外部传感器的情况下跟踪用户的运动,并且追踪技术比较准确。在追踪方式上,Oculus Quest 2不仅配套了手柄控制器,还支持手部追踪,它的手部追踪功能可以让用户无需控制器去玩特定的游戏。 其实我使用vr的时候就每次都在想,我为什么老是使用就像一根棍子一样的东西来和这个世界交互。我们在现实的生活中,手眼配合是标配了,那么使用手势确实一个很好的点。Pico4也加了,所以,一些交互的方式,其实这么多代产品迭代后,是可以找到最优解的。

这个游戏有Quest2的不陌生吧?

这个其实就在玩这个了 VR眼镜带给你的是震撼,一种无法和旁人表达的感官感觉。因为你无法使用语言描述,你现在离地球大概3k公里的地方在俯视着这颗蔚蓝色的星球。而且还在越来越想,几分钟后,太阳系8大星系在你的手边旋转。你随时拨动一颗星系,整个星系系统的运动速率被你干预。某种程度你就好像是上帝一样,你就是这个世界的主宰。 其实VR不好推的一点,也就是这样的,因为这种视觉的体验,你一定是要有一个硬件才可以体验到的,不像手机,电脑这样东西的体验。 以下是Pico3的一个简单的参数:

使用pico3的时候是打开了观影模式,就是去电影院的感觉。。。是真的,而且它鼻翼部分不透光做的非常好,就是在电影院的感觉。就我上一秒还在办公室聊天,下一秒就在巨幅影院内观影,这种现实和虚拟的交融,很新奇的感官体验。 Quest2鼻子部分漏光严重,而且头戴部分设计的不合理,第一次戴都不会很容易的戴好,只有细微调节才可以。

需要向下抠进来才可以

但是Pico就没有这个毛病,很容易一次戴好。但是两者的毛病都是不透气,闷热,我时时刻刻都能知道我脑袋上面戴着这样的东西。而且用完以后上面都是汗液,比较难搞的事情。

pico3使用了一种简单的工业设计带来了比Quest2好的佩戴体验,加分

其实VR里面有一个问题,就是这个东西的大小其实是会影响到用户的心理问题的。我玩黑色玛丽的时候,一个2米5的人偶???就直挺挺的走向我,和我要文件,其实这个过程是很恐怖的体验,而且里面的东西都是比我大了不止一圈。游戏里面的怪物冲向我的时候,我也是很害怕的。可能这个问题就是编程模型里面的一个简单的参数控制,我也不是很理解这个,可能大型才明显?

其他感觉就是,观影类的app是天然合适VR的,比如浏览器。有个朋友体验完以后和我说,这个浏览器真好看,我看了半天,以及一些电影,直播类的。因为巨幅的屏幕播放这个的感官真的爽!

2-3年内,VR如果在应用上面丰富,可能会出现一个不小的爆点,和内部人士聊是,这个东西大家在缓慢的接受,没有以前那么抗拒了。

对于我们个人创业者来说,其实最好入局的点还是上层的应用开发,进入这种大的行业体系里面深耕,因为这也是蓝海的市场。但是就像这种注释点渲染,图像边缘像素提升。其实是需要厂家集成的,也就是说,小团队的这种技术的创业者最终可能是被这些大厂收购,或者是这个成本太高,大厂自己就会做相应的技术集成。就像pico3或者pico4这些机器,单台的研发费用都超过2亿,而且pico在被字节收购以后,团队从几百人现在到3k人的研发团队,根本不是个人玩明白的。

其中也看到一个有趣的调研:

这个东西里面隐含着巨大的市场,欢迎挖掘 如同之前很多热门的概念一样,元宇宙目前还只是一个无法自成体系的行业,这种行业虽然短期内会引得资本疯狂涌入,但巨额的投入与长期无法获得回报,会逐渐拖垮资本对于行业的信心。

编辑:黄飞

-

VR技术的展望——无线头盔2016-02-22 9119

-

VR技术完善的地方还有很多2016-06-23 1962

-

2017,VR技术将重新定义未来2017-03-14 4413

-

VR一体机技术的关键技术2018-09-21 5117

-

VR一体机技术的生态内容2018-09-25 2166

-

GRID Test Drive背后的技术是什么?2018-10-09 1932

-

VR技术带你领略动物眼中的奇妙世界2018-11-09 2873

-

VR医疗技术新手段2018-12-06 3367

-

5G的背后技术揭秘2019-07-16 2599

-

Facebook后台背后的技术2019-07-17 4115

-

5G改变世界的背后有哪些创新技术?2020-12-29 1987

-

云计算背后采用的具体技术有哪些?2021-05-20 1931

-

分享下载算法设计背后的奥秘2021-12-21 1335

-

【直播预告】今晚7点,来HarmonyOS极客松直播间与技术专家聊聊新技术!2023-06-20 3180

-

聊聊苹果不用曲面屏背后的原因2023-07-17 1625

全部0条评论

快来发表一下你的评论吧 !