虚拟现实和增强现实(ARVR)技术之3D技术原理

vr|ar|虚拟现实

描述

虚拟现实和增强现实(ARVR)技术发展到今天时,市面上已经涌现出各种类型的设备,最新元宇宙大厂Meta的Quest也在上个月发售,其拥有突破性高分辨率的混合现实技术,采用了较上一代更先进的PanCake光学透镜方案,为了给用户最完美的3D视觉呈现。那元宇宙都如此火爆,你知道3D显示技术究竟是什么吗,让我们来一探究竟吧。

3D技术的原理和起源

3D显示技术目前概念十分宽泛,目前广泛定义为一种可以向观看者传递景深的设备,通过一系列光学方法使人在脑海里成像具有3个维度。目前较新的全息显示器和光场显示器通过对于要显示的内容进行立体视觉化和成像焦距的精确把控可以产生更逼真的视觉效果,同时也极大程度的减少视觉疲劳。

3D显示器的基本原理是利用人的双眼成像,通过不同眼球分别传输不同的图像,然后本来2D(只有X和Y的图像)在大脑中自动组合,最终形成具有景深的3D图像。通俗来说,目前我们用到的3D显示例如ARVR设备,都是利用Pulfrich effect原理,这是一种心理物理学感知,由于人的两只眼睛在看到图像时有差异,所以视场中物体的运动(或者不同角度)被视觉皮层解释为具有深度分量。

有个不太为人知的知识,早先患有眼部疾病的例如:白内障、视神经炎或者多发硬化症的病患,在马路上难以判断迎面而来的汽车,当时大家还不理解这究竟是为什么。后来海德堡天文台的创始人马克斯沃尔夫在对于恒星的研究中发表了一个立体视觉具有局限性的问题论文,而本来就是一只眼睛失明的德国物理学家Carl Pulfrich的注意到,论文中同一颗恒星在不同照相底片上的亮度变化会产生一种错觉运动的现象,然后设计了一个投影设备,然后向同样是一只眼睛的人进行了很好的展示,并于1922年首次公开描述了这种现象。

而真正追溯到第一个3D显示器是由英国科学家惠斯通发明的镜面立体镜, 1840 年,他因对双眼视觉的解释而获得皇家学会皇家奖章,这项研究促使他绘制立体图并构建立体镜。

查尔斯·惠斯通镜面立体镜(图源:WIKI)

3D显示技术的发展

通过立体视觉原理,人们制作的丰富的电影图像和照片,给观看者两只眼睛不同的图像,这两种图像具有刚好在人眼位置拍照样的微小偏差,就能在大脑里创建3D的图形。想要让观看者舒适的观看就要借助光学的一些工具。

早期红蓝透镜

在3D电影或者摄影的早期,通常用两幅图像(一个红色和一个蓝色)叠加在荧幕或者照片纸上,两个图像稍稍错位距离基本上就是人眼的观看错位,然后观看者佩戴不同的蓝红滤色片眼镜就能在两只眼分别看到红色和蓝色的像,进而在大脑自动合成成3D的形状。

早期的红蓝3D滤光片眼镜(图源:网络)

这种色分法成像就是利用不同的滤光片将图像上的某种特定颜色的光滤掉,到达人眼就是左右两幅图像,然后大脑会根据红蓝两副图像自动合成看到的物体的位置和色彩,这样就形成3D景象。

色分法成像示意图(图源:网络)

偏振光成像原理

红蓝成像会让人很容易视觉疲劳,并且时间长了还会有视觉受损的情况,其实成像效果也并不理想,所以科学家们又发明出了偏振光的方法。利用偏光片(栅格排列的硅晶体涂料薄膜)来滤掉不同偏振方向的光。

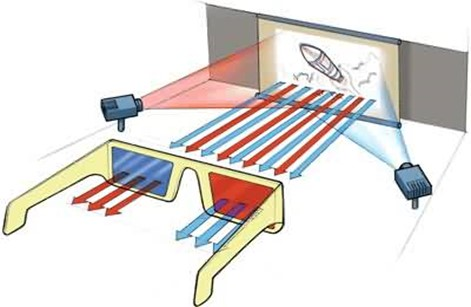

偏振光分法成像原理(图源:大大通)

这种成像方法需要投影两种不同的偏振光,观看者佩戴不同偏振片的眼睛,来让两个方向的光进入眼睛,通过大脑在合成3D图像,这种方案没有色差,对人眼损害较小,所以目前主流的3D影院基本都是偏振光的3D方案。

交替快门、视线遮挡和阵列透镜法

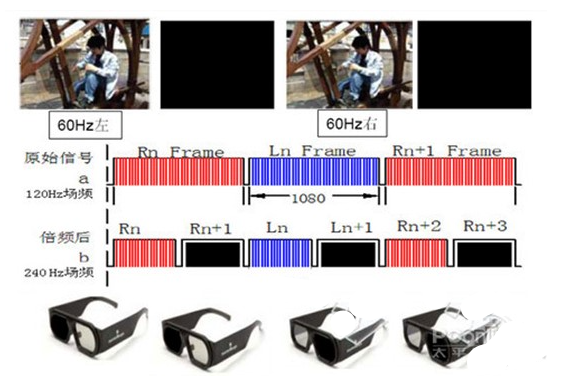

在了解只要让两只人眼看到的两幅画面不一样,大脑在处理同时到达的这张图时就会自动合成3D效果这个原理后,各家开始开发各种显示设备,通过显示器和3D快门眼睛配合可以在高场频刷新两张图,并且分别进入左眼和右眼,来达到3D效果。

快门法3D显示装置原理(图源:太平洋)

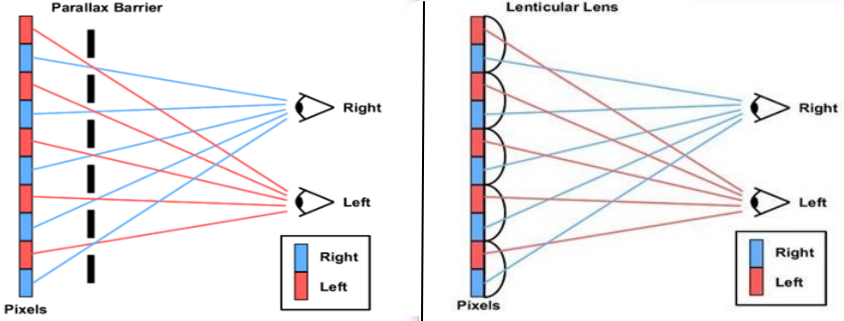

视线遮挡的思路是在显示屏上做出类似栅栏的装置,在特定位置的人眼可以看到从缝隙透过来的不同光线,进而达到3D视觉。

透镜阵列是在显示屏上做一组微型透镜阵列,让不同排列的LED发出的光分别聚焦在人的左眼和右眼上。

不同裸眼3D技术(左:视线遮挡,右:透镜阵列)

VR虚拟现实

现在市面上大火的VR头显则是利用两块显示屏,通过CPU控制显示不同画面,然后用摄像头捕捉人的眼球聚焦点来显示眼前不同的画面,达到大脑成像时的3D效果。像是Meta的Quest,字节的Pico都是复杂的光学设备来在近距离成像,这种设备需要强大的CPU和GPU来计算需要显示的图像,现在还处在刚刚兴起的阶段。

全息成像

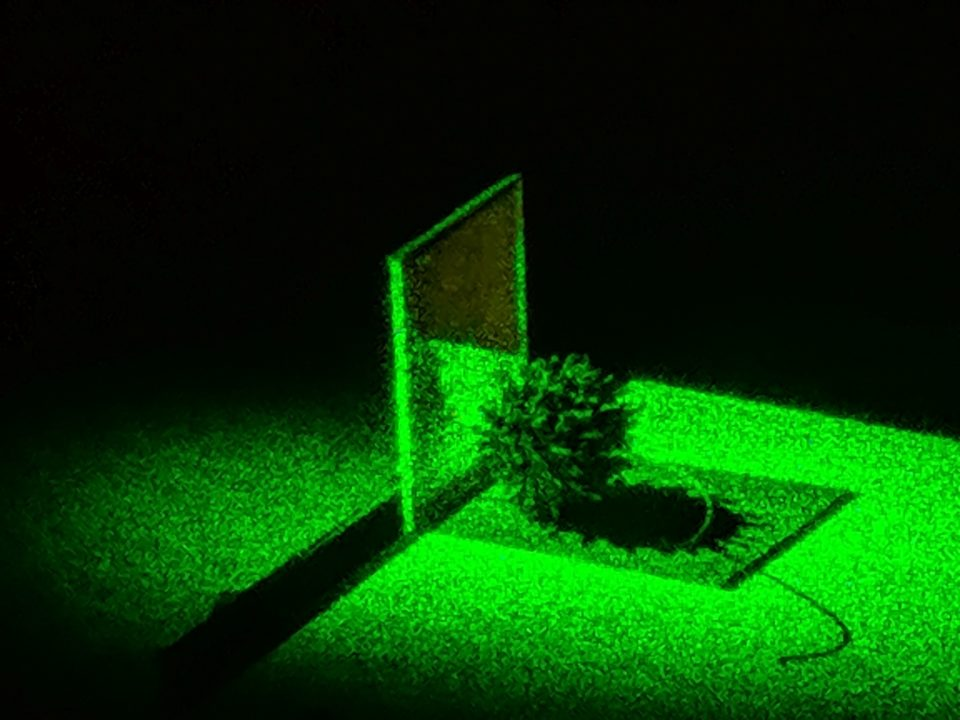

近来最火也是目前看起来最炫酷的3D技术当属全息投影技术,其摄制时利用光的干涉原理来记录物体的光波信息,被摄物体在激光辐照下形成漫射式的物光束;另一部分激光作为参考光束射到全息底片上,和物光束叠加产生干涉,把物体光波上各点的位相和振幅转换成在空间上变化的强度,从而利用干涉条纹间的反差和间隔将物体光波的全部信息记录下来,记录着干涉条纹的底片经过显影、定影等处理程序后,便成为一张全息图。

下一步再利用衍射原理再现物体光波信息,利用相干激光照射,通过衍射光波可以生产两个像,即原始像和共轭像,生成的图像立体感强,近乎真实的视觉效应。因为拍摄的全息图记录了完整的物体光学信息,所以理论上再现起图像便能得到原始物体的信息。

现在市面上主流的方案是3D全息透明屏,该种屏幕透明,不受光线的影响,只显示某一特定角度的图像,通过调节透明度来让荧幕只留下要显示的图像,达到全息投影成像的目的。

初音未来全息投影演唱会(图源:Google)

但是这种其实并不是真正的全息投影,还是在荧幕上2.5D播放近乎全息的图像的。真正全息图需要利用脉冲激光,高分辨率光敏材料,通过相干光的干涉图案对空间信息进行编码来记录物体信息。

反射全息图(图源:HoloCenter)

从早期红蓝到现在全息投影,技术的发展日新月异,人们对于视觉的追求也在不断进步,强大的硬件和复杂的软件完美组合定能带来全新的视觉体验。元宇宙的到来就在不远的前方。

编辑:黄飞

-

虚拟现实技术和增强现实技术区别与联系2024-07-04 4753

-

虚拟现实与增强现实含义是什么2023-12-30 11724

-

虚拟现实和增强现实区别2023-08-12 3763

-

增强现实和虚拟现实的区别 增强现实和虚拟现实的工作原理2023-08-02 3075

-

[1.2]--1.2虚拟现实与增强现实的应用jf_75936199 2023-02-23

-

西藏首个虚拟现实和增强现实技术应用协会揭牌2021-01-15 4921

-

增强现实和虚拟现实改变工厂车间面貌2019-08-19 2875

-

虚拟现实技术分类2019-01-06 15952

-

恒茂创远虚拟现实仿真技术的发展及应用特点2017-08-11 4672

-

老子云如何摆脱虚拟现实带来的“虚拟”感?2017-05-24 3592

-

虚拟现实产品大全201001期2010-01-12 3082

-

虚拟现实产品大全2009072009-07-14 4203

-

发布软件--虚拟现实产品大全--2009062009-06-09 4084

全部0条评论

快来发表一下你的评论吧 !