GPU加速成为共识,CAE和仿真模拟的未来将走向何方?

描述

CAE(Computer Aided Engineering,计算机辅助工程)始于50年代,由数学家、科学家和工程师共同开发,可用于求解分析复杂工程和产品。起先,CAE旨在改善航空和汽车行业的设计,例如,模拟飞机周遭的冲击波、气流、温度数据,计算汽车模型表面的压力系数等。

随着半导体工艺对摩尔定律的进一步推动、内存的每一次进步以及CPU和GPU并行处理能力的倍增,CAE性能随之扩展,其应用范围也逐渐延展至制造业的方方面面,并有势头成为 “数字孪生”、“工业互联网”、“智能制造”,乃至“工业元宇宙”的引擎。

1/CAE转型:从CPU走向GPU,这头巨兽已迈出两个十年

作为一种资源密集型技术,即便历经大半个世纪的发展,CAE领域仍然充满挑战,始终向新技术与新解决方案敞开大门。

·精益求精的工程师们提出需求:更真实!更复杂!更大规模!

Altair、Ansys、Autodesk、Dassault Systèmes (Simulia)、Hexagon MSC和Siemens等主要工程仿真软件提供商长期依赖将CPU作为驱动计算的主要引擎时开发出的技术。最初,模型已经过简化,可适应计算系统,但制造业对仿真度有着孜孜不倦的追求。

然而,如若以基于CPU的工作流程来处理这些问题,则必须考虑到CPU的功能——必须缩小模型的大小、简化设计并管理网格大小,因此,最终评估的实体可能与要分析的真实事物大相径庭。显然,这又将我们带回了原点。1999年,NVIDIA发明了GPU (图形处理器),这为CAE实现重大转型创造了舞台。就像许多受益于并行处理的领域一样,CAE的主要任务是执行大规模并行进程。CAE通过在模型上创建节点网格来评估模型,然后对节点应用力和条件,评估设计是否适合其用途。网格越密集,仿真就越可靠。对于GPU来说,这是一个显而易见的应用领域,软件供应商和硬件开发者在GPU出现的初期就已经认识到了这一点。

·半导体巨头推动GPU加速的普及

GPU的优势在于单个芯片上的处理单元数量远超CPU,从处理器的角度上来比较,GPU的成本远低于CPU,但GPU和CPU的工作方式各不相同,需要针对两者采用特定的编程方法,因而,为GPU调整这些程序却并非易事。 这时,GPU的发明者NVIDIA做出表率,于2006年发布NVIDIA CUDA (Compute Unified Device Architecture)——一种并行计算平台和编程模型,并于2008年之后,与业内领先的公司合作推进OpenCL (Open Computing Language,开放设计语言)——专为异构平台(CPU/GPU/DSP/FPGA等)编程设计的框架。这些编程工具让开发者能够更轻松地利用GPU来大幅提升计算性能。

NVIDIA一直与CAE开发者合作,创建为仿真分析可视化常见任务量身打造的工具。公司独树一帜,专注于GPU,推动其进入专用工具开发领域。2023年,随着NVIDIA的Grace CPU的推出,其将在GPU+CPU的道路上发展得更加深远。

2/软件生态向GPU算力靠拢

半导体发展趋势、GPU在并行计算方面的独特优势,以及NVIDIA等GPU厂商为CAE搭建的开发工具,让入局以GPU为基础的CAE变得更加容易。

·CAE不断迭代:提高自动化水平,注入AI

除了对更复杂、更逼真、更大规模的CAE应用的需求外,21世纪初,计算机辅助设计 (CAD) 软件供应商也开始获取CAE技术以添加到设计工作流。集成到CAD流程中的分析工具具有更高的自动化水平,这让设计师能够在工作时执行简单分析。

要实现上述两个愿景,需要构建插件和附加组件来实现GPU加速,并进一步添加云资源、推进高性能计算 (HPC) 的应用。同时,人们也越来越关注使用机器学习 (ML) 和人工智能 (AI) 来预处理和识别模型中值得关注的领域。

·软件厂商争先“吃螃蟹”

自2014年以来,各个主要CAE供应商都在某种程度上利用了GPU加速。

Ansys和Hexagon专门针对GPU设计并编写了应用程序。

Ansys针对GPU从头开始设计了应用Discovery,这一互动实时仿真解决方案允许在流体、热力学、结构和模态应用中进行迭代设计探索。此后,PTC与Ansys在2018年的LiveWorx 18数字化转型会议上宣布,PTC的Creo 3D CAD软件中将实现Ansys Discovery Live实时模拟功能,这消除了CAD与模拟活动之间的界限。

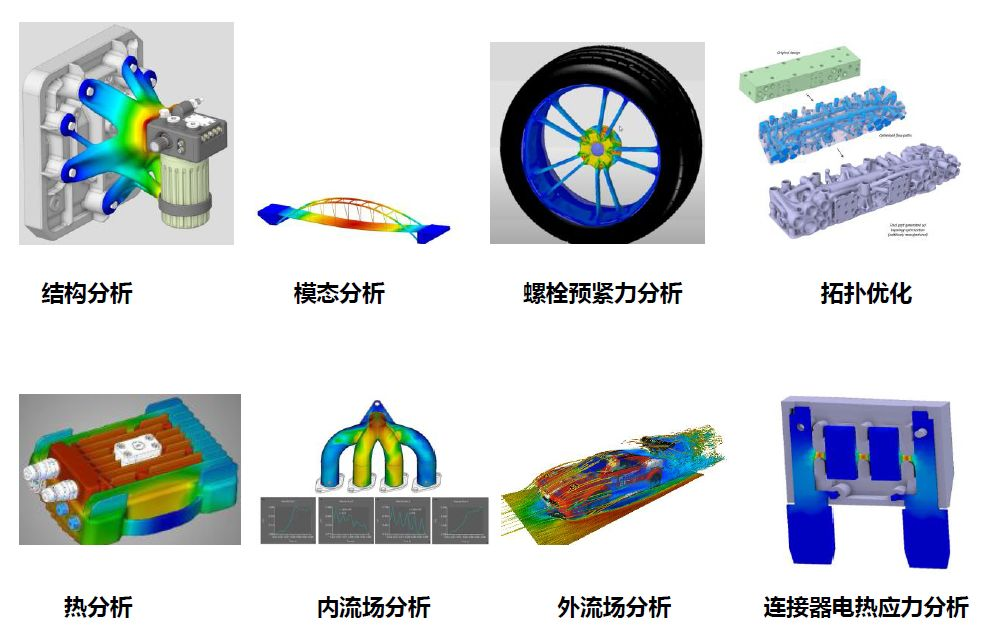

Ansys Discovery典型应用(图片来源:Ansys)

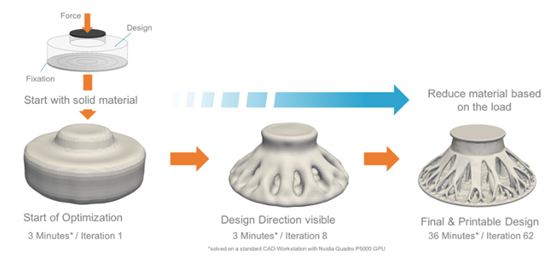

同样,Hexagon也决定从一开始就为GPU编写其新产品MSC Apex Generative Design,NVIDIA的CUDA框架为Hexagon的开发者提供了一个轻松的切入点,他们能够立即开始编码,不仅能够更快生成产品,而且将设计、网格化和分析功能融于一体。

MSC Apex Generative Design的工作流程

西门子则是致力于让其CFD软件可以在CPU与GPU之间无缝切换。2022年初,西门子发布了首个GPU版本的Simcenter STAR-CCM+,这一版本在一开始专注于车辆外部空气动力学应用,随后,Siemens工程师投入巨资,移植所有可在未来数年从GPU中受益的物理、求解器和相关软件部件。

达索系统(Dassault Systèmes)和Altair选择将GPU加速逐渐应用于原有产品中。

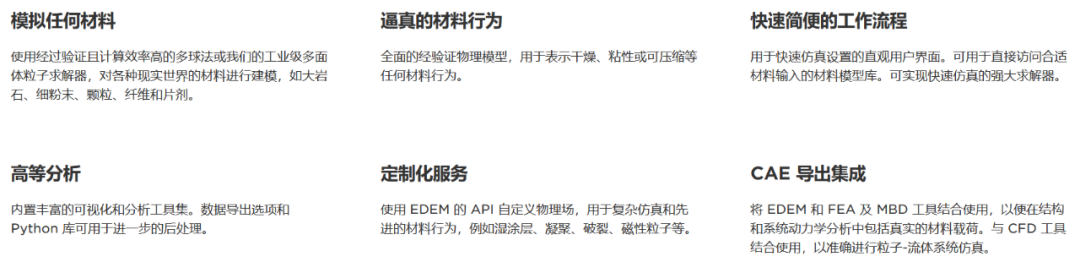

达索发现,GPU的架构非常适合基于有限差时域仿真算法的CST Studio Suite电磁仿真和分析,且从工作站GPU到数据中心计算GPU的扩展效果非常出色。而Altair在实践过程中得出,与用来处理类似工作负载的12个CPU相比,添加GPU可将AltairEDEM的性能提升20倍。

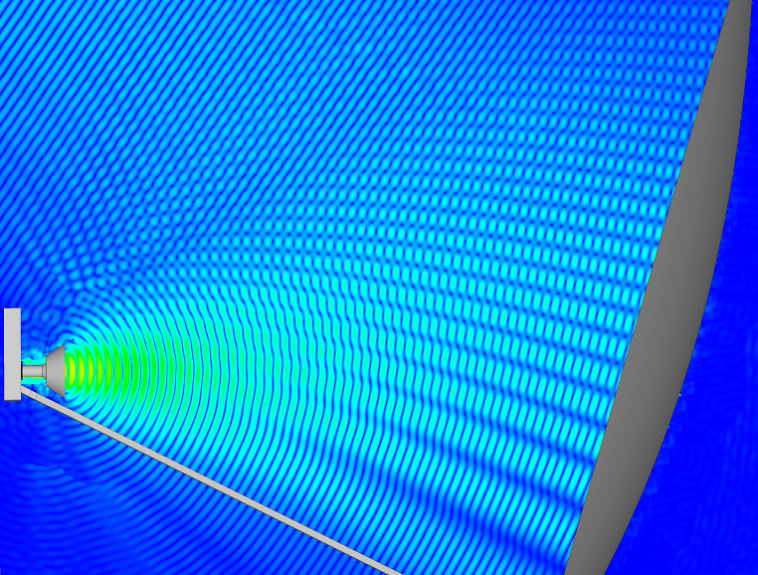

CST Studio Suite允许客户访问多种电磁仿真解算器

Altair EDEM的主要功能

迄今为止,已有来自10多个ISV的120多个CAE应用通过GPU进行加速。结果令人印象深刻,根据应用和工作负载不同,结果的交付速度最高可提升100倍。此外,随着GPU的添加,性能提升会进一步飞跃。随着越来越多的求解器移植到GPU上,可以预见性能会取得更大的突破。

·GPU自身的升级将为前期软件投资带来持续红利

以NVIDIA为例,在今年9月的GTC大会上,其推出了基于全新Ada Lovelace架构的NVIDIA RTX 6000工作站GPU,具有最先进的NVIDIA RTX技术,特点包括:

1)第三代RT Core:吞吐量是上一代的2倍,能够同时运行具有着色或去噪功能的光线追踪技术。

2)第四代Tensor Core:相比上一代AI训练性能提升近2倍,扩展支持FP8数据格式。

3)CUDA core:单精度浮点吞吐量最高达到上一代的2倍。

4)GPU显存:具有48GB GDDR6显存,可处理大规模的3D模型、图像渲染、模拟和AI数据集。

5)虚拟化:将支持用于多个高性能虚拟工作站实例的NVIDIA虚拟GPU(vGPU)软件,使远程用户能够共享资源并驱动高端设计、AI和计算工作负载。

6)XR(扩展现实):视频编码性能相比上一代产品提升近3倍,可使用NVIDIA CloudXR流式传输实现多个XR会话同步。

NVIDIA RTX 6000 Ada架构GPU提供了实时渲染、图形和AI功能,可以帮助设计师和工程师推动基于仿真的尖端工作流程,以构建和验证更复杂的设计。

凭借更大的二级缓存、更多的新一代核心和更高的内存带宽,Ansys Discovery和Ansys Fluent的用户可以通过释放NVIDIA RTX 6000的48GB GPU显存的全部威力,进行互动式仿真驱动的设计研究和高保真CFD仿真。NVIDIA针对这一应用发布了演示视频:

3/制造业利用GPU加速的CAE向工业元宇宙延伸

在CAE借助GPU过程中,没有一家软件公司采取相同的路线来实施GPU:他们都有自己的方法,对分析和仿真的作用有自己的理念,并有自身特别感兴趣的领域。但我们确实看到,随着GPU的出现,CAE及制造业产品设计流程正在迅速变化。

同时,在元宇宙概念席卷各行各业的背景下,GPU加速CAE的结果呈现方式将百花齐放。通过与XR相结合,设计师和审查人员可开启沉浸式工作;采用虚拟GPU技术,将让工作流程在不局限于本地算力的同时,保障数据安全性;将其置于协作平台(例如NVIDIA Omniverse)中,则能打通制造业产品设计链路,大幅缩短正式投产前的准备时间。

审核编辑 :李倩

-

网格为王,仿真破界——Altair HyperMesh 重塑CAE工程设计新范式?2026-04-23 732

-

GPU加速matlab程序2019-03-30 3111

-

速成Cadence Allegro的方法概述2019-10-08 1618

-

CAE技术的发展趋势如何?2020-03-13 1706

-

OpenStack重组敢问未来路在何方?2020-05-14 1699

-

CAE有限元仿真技术面临的挑战有哪些2020-07-07 2643

-

磁共振将加速成为无线充电主流技术2014-06-18 2317

-

历经6年的超融合,未来将走向何方?2019-01-24 5068

-

剖析流体仿真为什么要选择GPU?2021-03-30 6379

-

GPU加速的SPICE仿真提升了模拟IC设计2022-07-27 5326

-

云数据库时代,DBA将走向何方?-v42022-11-24 1308

-

NVIDIA GPU 持续加速并推进 CAE 发展2022-12-09 2041

-

Cadence收购BETA CAE Systems,加速智能系统设计战略2024-03-08 1628

-

借助NVIDIA GPU提升鲁班系统CAE软件计算效率2024-12-27 1447

-

工业增材制造将走向何方2025-02-07 1147

全部0条评论

快来发表一下你的评论吧 !