基于NeRF的三维场景重建和理解

描述

如果从方法出发的话,两张图就能看懂:

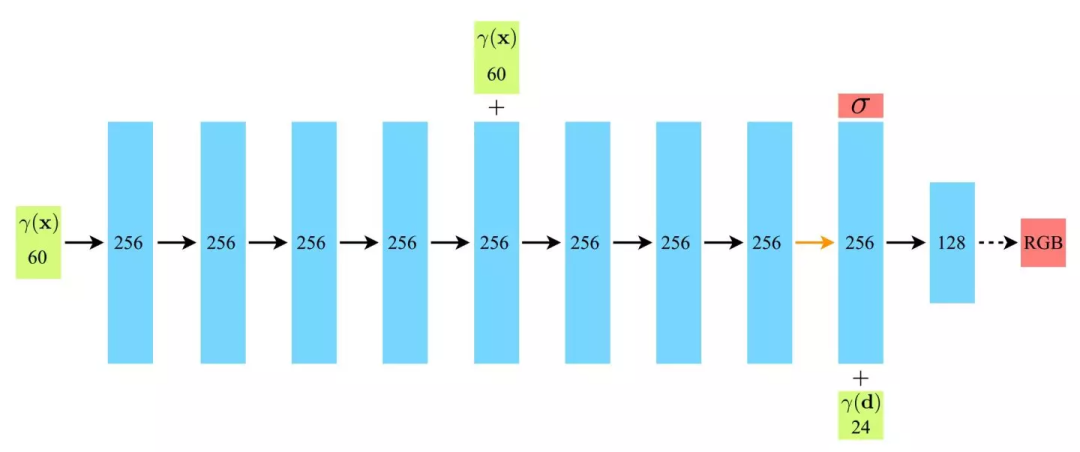

图 1

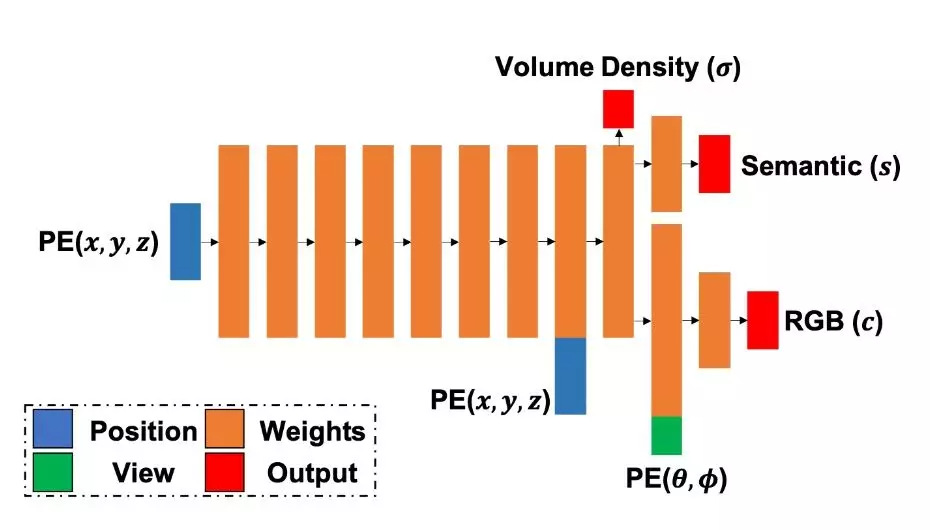

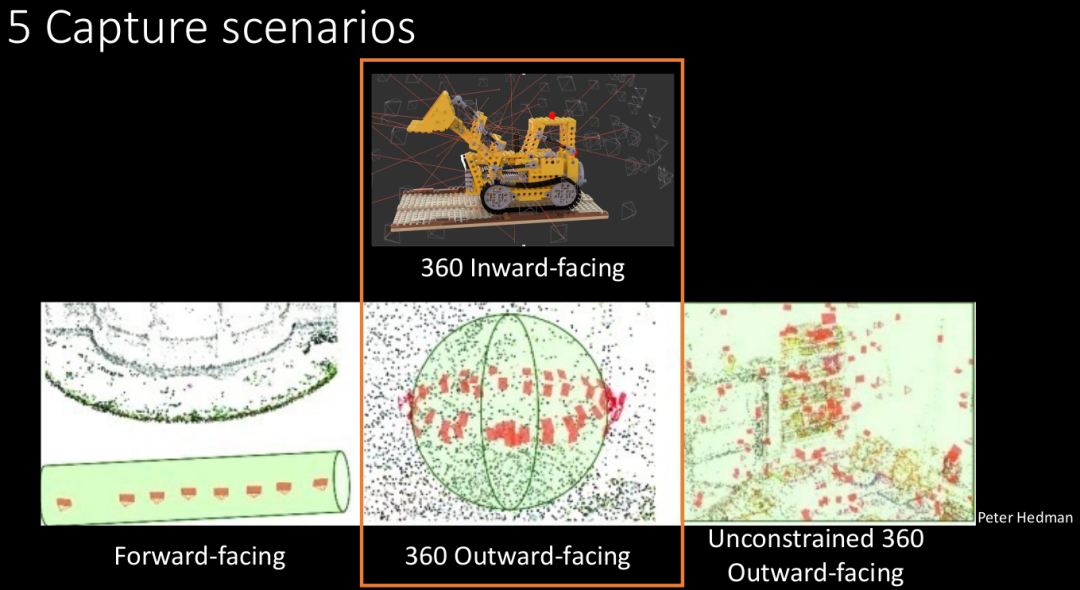

图 2 上面是 NeRF 的网络结构,下面是 Semantic-NeRF 的网络结构,就是在 NeRF 的网络中加了一个分支,输出到语义。和 NeRF 一样,Semantic-NeRF 能够连续的表达空间信息,因此你可以看到 Semantic-NeRF 主页里的各种酷炫的 demo. 这是 ICCV 2021 的 oral 工作。 如果有留意上一讲的讲座,从 Semantic-NeRF 的demo中你应该能推测出,这应该是第四种拍摄方式:

图 3 这种拍摄方式在SLAM或者SFM中更多见,而传统三维重建或者RGBD重建是很难做出 NeRF 或者 Semantic-NeRF 这种效果的。所以方法可能很简单,但是这个工作很有意义。 应用的话,大家可以参考视频。

Semantic-NeRF应用

稀疏监督下的新视角语义生成(Semantic View Synthesis with Sparse Labels

语义标签去噪(LabelDenoising

语义标签超分辨(Super-Resolution)

稀疏语义标签传播(LabelPropagation)

多视角语义融合(Multi-view Semantic Fusion)

稠密的语义三维重建

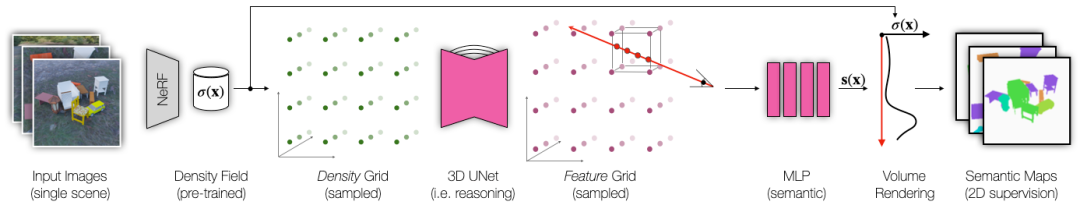

在这篇工作之后智博又做了 iLabel 的工作,将 imap 和 semantic-NeRF 结合,这里我们就不细讲了,感兴趣的同学欢迎去看原文。 需要提到的另一篇工作是 NeSF 这篇文章。 智博在讲解 NeSF 的时候提到,训练的sample是场景,而不是图片,这是对这篇文章的一个高度概况。NeSF 首先会训练许多场景,比如100个场景,那我们就会得到100个 NeRF 的模型,我们对这 100 个 NeRF 的模型做 Grid query,从而获取一个 Density Grid,其实就是一堆规则的点,可以使用 3D 卷积,从而转换为 Feature Grid. 对 Feature Grid 做 volume rendering 就能渲染出各个视角的语义图像了。下面是 NeSF 的流程图。

图 4 NeSF流程图 NeSF 的泛化性从 demo 来看还是不错的,但是这样的工作显然不是我们可以玩的 (训练 100 个 NeRF), 你几乎不用猜都知道是哪里出的工作。 这也就引出了 NeRF 的许多痛点,印象里第四讲嘉宾在讲 NeRF in the wild 和 Ha-NeRF 的时候说,每次实验要 4 张V100 跑2天。因此不论是推理还是训练,加速工作都显得尤为重要,对语义 NeRF 相关的工作更是如此,因为目前的加速工作大都倾向于摆脱神经网络。 动态场景的 NeRF 也有一些工作,但是是否一样能像 Semantic NeRF 一样,很轻松地 work 呢?其实能引发的问题还是挺多的。 评估一项工作的 novelty 的其中一项指标就是看这篇工作挖了多少坑,能启发多少后续工作,Semantic NeRF 就是这样的一篇工作。如果你看懂这个系列的工作,推荐大家立刻去看 panoptic NeRF 相关的工作。

审核编辑 :李倩

-

怎样去设计一种基于RGB-D相机的三维重建无序抓取系统?2021-07-02 2096

-

如何去开发一款基于RGB-D相机与机械臂的三维重建无序抓取系统2021-09-08 2237

-

无人机三维建模的信息2021-09-16 2214

-

基于FPGA的医学图像三维重建系统设计与实现2011-03-15 1310

-

基于非量测相片的三维模型重建2018-02-23 1043

-

如何使用单目视觉进行高精度三维场景重建技术研究2018-12-24 1883

-

深度学习背景下的图像三维重建技术进展综述2023-01-09 4159

-

NerfingMVS:引导优化神经辐射场实现室内多视角三维重建2023-02-13 4559

-

从多视角图像做三维场景重建 (CVPR'22 Oral)2023-02-20 4265

-

三维重建:从入门到入土2023-03-03 2316

-

三维场景点云理解与重建技术2023-08-08 2688

-

如何实现整个三维重建过程2023-09-01 2804

-

基于光学成像的物体三维重建技术研究2023-09-15 1966

-

全面总结动态NeRF2024-11-14 1947

-

航天宏图全栈式3DGS实景三维重建系统解决方案2025-06-27 2108

全部0条评论

快来发表一下你的评论吧 !