通过卷积神经网络实现MNIST数据集分类

电子说

描述

问题

对比单个全连接网络,在卷积神经网络层的加持下,初始时,整个神经网络模型的性能是否会更好。

方法

模型设计

两层卷积神经网络(包含池化层),一层全连接网络。

-

选择 5 x 5 的卷积核,输入通道为 1,输出通道为 10:

此时图像矩阵经过 5 x 5 的卷积核后会小两圈,也就是4个数位,变成 24 x 24,输出通道为10;

-

选择 2 x 2 的最大池化层:

此时图像大小缩短一半,变成 12 x 12,通道数不变;

-

再次经过5 x 5的卷积核,输入通道为 10,输出通道为 20:

此时图像再小两圈,变成 8*8,输出通道为20;

-

再次经过2 x 2的最大池化层:

此时图像大小缩短一半,变成 4 x 4,通道数不变;

-

最后将图像整型变换成向量,输入到全连接层中:

输入一共有 4 x 4 x 20 = 320个元素,输出为 10.

代码

准备数据集

准备数据集

batch_size = 64

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))

])

train_dataset = datasets.MNIST(root='data’,

train=True,

download=True,

transform=transform)

train_loader = DataLoader(train_dataset,

shuffle=True,

batch_size=batch_size)

test_dataset = datasets.MNIST(root='data',

train=False,

download=True,

transform=transform)

test_loader = DataLoader(test_dataset,

shuffle=False,

batch_size=batch_size)

建立模型

class Net(torch.nn.Module):

def init (self):

super(Net, self).__init__()

self.conv1 = torch.nn.Conv2d(1, 10, kernel_size=5)

self.conv2 = torch.nn.Conv2d(10, 20, kernel_size=5)

self.pooling = torch.nn.MaxPool2d(2)

self.fc = torch.nn.Linear(320, 10)

def forward(self, x):

batch_size = x.size(0)

x = F.relu(self.pooling(self.conv1(x)))

x = F.relu(self.pooling(self.conv2(x)))

x = x.view(batch_size, -1)

x = self.fc(x)

return x

model = Net()

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

model.to(device)

构造损失函数+优化器

criterion = torch.nn.CrossEntropyLoss()

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.5)

训练+测试

def train(epoch):

running_loss = 0.0

for batch_idx, data in enumerate(train_loader, 0):

inputs, target = data

inputs,target=inputs.to(device),target.to(device)

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, target)

loss.backward()

optimizer.step()

running_loss += loss.item()

if batch_idx % 300 == 299:

print('[%d,%.5d] loss:%.3f' % (epoch + 1, batch_idx + 1, running_loss / 2000))

running_loss = 0.0

def test():

correct=0

total=0

with torch.no_grad():

for data in test_loader:

inputs,target=data

inputs,target=inputs.to(device),target.to(device)

outputs=model(inputs)

_,predicted=torch.max(outputs.data,dim=1)

total+=target.size(0)

correct+=(predicted==target).sum().item()

print('Accuracy on test set:%d %% [%d%d]' %(100*correct/total,correct,total))

if name ==' main ':

for epoch in range(10):

train(epoch)

test()

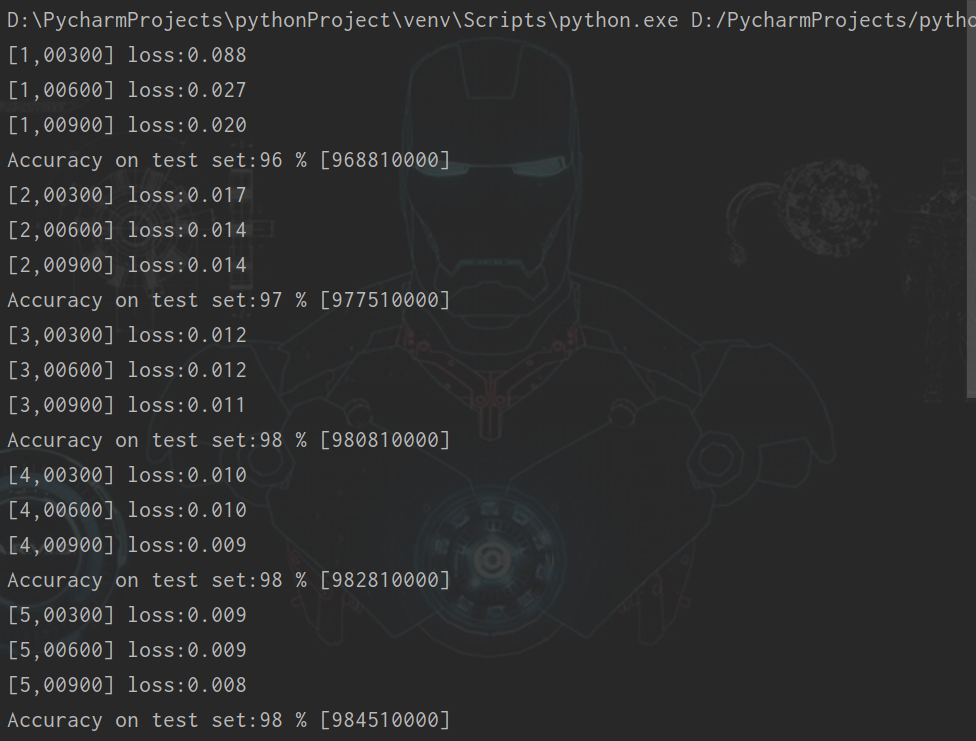

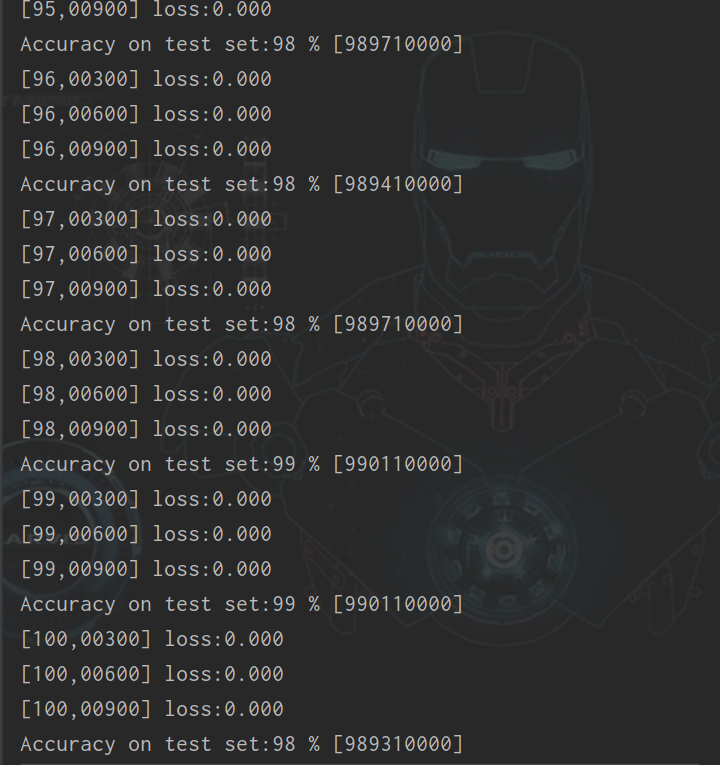

运行结果

(1)batch_size:64,训练次数:10

(2)batch_size:128,训练次数:10

(3)batch_size:128,训练次数:10

结语

对比单个全连接网络,在卷积神经网络层的加持下,初始时,整个神经网络模型的性能显著提升,准确率最低为96%。在batch_size:64,训练次数:100情况下,准确率达到99%。下一阶在平均池化,3*3卷积核,以及不同通道数的情况下,探索对模型性能的影响。

-

在Ubuntu20.04系统中训练神经网络模型的一些经验2025-10-22 305

-

卷积神经网络训练的是什么2024-07-03 1901

-

卷积神经网络的原理与实现2024-07-02 2056

-

卷积神经网络的应用 卷积神经网络通常用来处理什么2023-08-21 6662

-

卷积神经网络简介:什么是机器学习?2023-02-23 25532

-

卷积神经网络模型发展及应用2022-08-02 13370

-

卷积神经网络一维卷积的处理过程2021-12-23 2067

-

基于赛灵思FPGA的卷积神经网络实现设计2019-06-19 4245

全部0条评论

快来发表一下你的评论吧 !