聊一聊现阶段ChatGPT的缺点与局限

描述

导语:常识性的问题,它将会具备优势,然而非常识性创作型的问题,它将有非常奇怪的表现。

先前被狂炒,所谓会改变世界的元宇宙被证伪,大量的投资以及热钱现已从这个极其泡沫化的行业中撤出。

当时我就指出元宇宙这个行业纯扯淡。

如今由于美联储加息缩表,许多行业越发艰难,许多VC也在寻求更多机会(忽悠)更多的韭菜入场,他们就能够赚到预期的收益(后面韭菜高估值入坑的资本)。

如今我看ChatGPT 这个chat bot,也有类似的巨大问题。

通过这篇文章,我会总结现阶段ChatGPT为何尚不足以成为一样成熟的商用技术,以及这类技术现阶段的限制以及缺陷,以及最后聊聊为何这项技术远不如自媒体或是某些创投口中的“拥抱未来,改变世界”(拥抱韭菜,财富自由)。

许多VC或是甲方远远不如外界想象中专业,他们更多的是思考,如何以更高的市场估值让更大的商业巨头接盘。

先聊聊ChatGPT的优点。

首先微软作为软件行业的巨头,一直在寻找切入移动端或是切入下一个互联网更新换代的赛道。

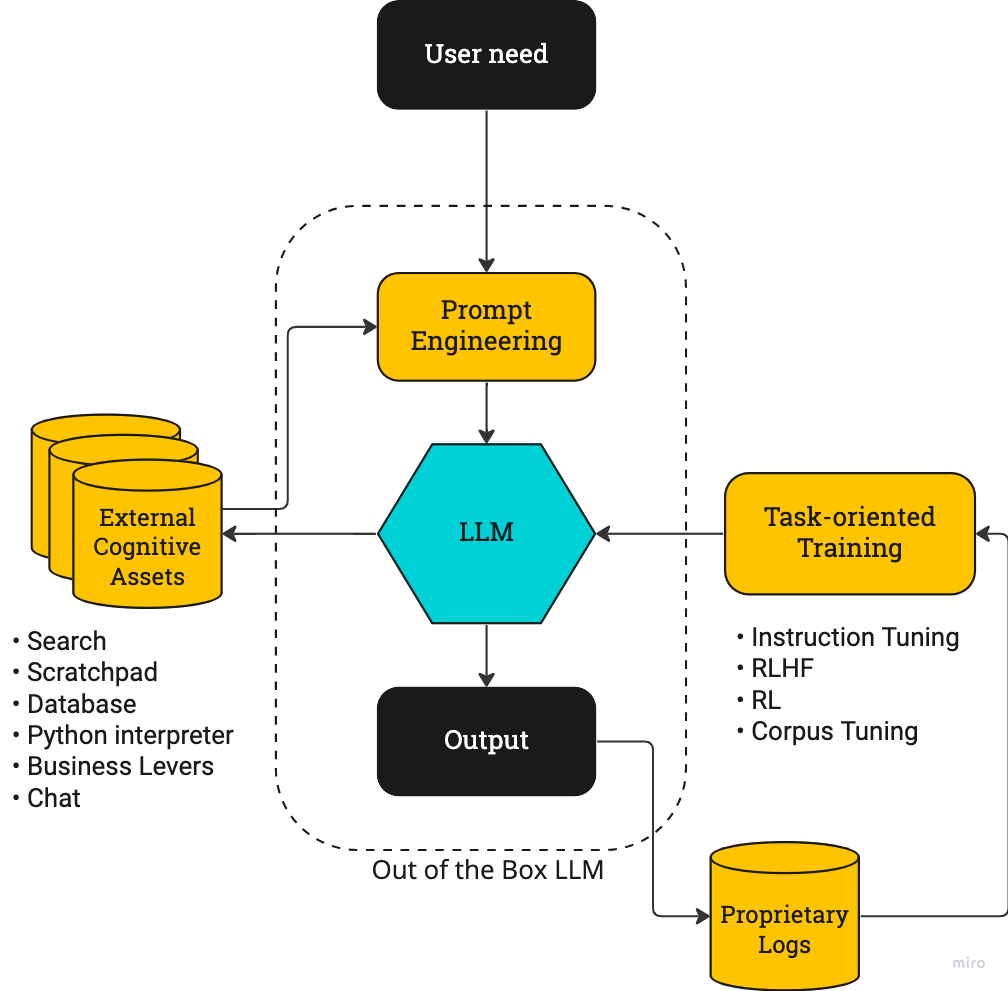

为何微软愿意在这项自然语义模型(LLM-large language model based,需要大量的语义和参数作为基础)砸下巨资,因为它无疑看到这个技术的巨大潜力。

1. 巨大的用户粘性。

如果这项技术能克服现有缺陷并(弱AI)成形,那么潜在用户极易对其形成巨大的依赖度。它非常可能成为下一代的搜索引擎,有机会改变用户的搜索习惯。如今全球用户通过一个巨大的搜索引擎接入互联网,并决定自己下一步会“进入”哪一个网站。

人们或将和这样的弱AI(智能助理)互动,并将许多的基础繁杂工作(比如论文出处,写作业,或是找图片,做表格等),交予这个能够理解用户诉求的人工智能进行处理。

2. 高度的拓展性

在足够巨大的样本数训练以及参数和标签下,这样的工具能够实现自我学习。

能够进一步对某些特定需求进行强化,比如说对于金融数据的分类整理,或是对于某些交易策略的代码进行审计或是改bug之类的功能进行强化。

3. 巨大的效率提升

未来人工智能将成为类似搜索引擎,或是手机应用一样无处不在的重要软件基础设施。这也意味着大量重复性的工作(文案,设计类等工作)将被语义模型所训练的人工智能所替代。

这也意味着我们能够专心转向软件端的框架搭建,创作者也能将旋律,歌词,作画等细枝末节或是其他的作业完全交给这样的智能助理chatbot来一键式生成。

然而,现阶段的ChatGPT更多是一个半完成品,它并不理解我们的需求,或者说这个AI本身并不理解何为”需求“。

更多是根据我们所输入的变量和词语进行反应,或是根据过去大量的训练结果进行的回答。

它存在着以下缺点和限制:

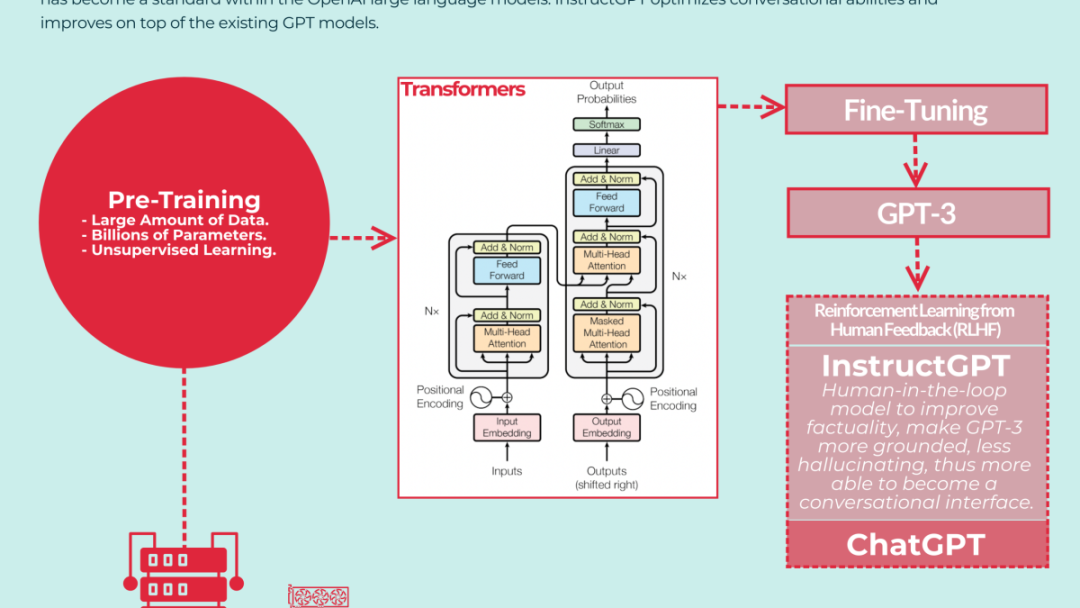

1. 现阶段ChatGPT的本质更多是一个基于语义模型和预训练的chat bot.

从GPT1到GPT3,AI的训练数量甚至到了1750亿参数量之多,这也意味着天价的AI训练费用(1200万美金)以及更加巨大的工作量(这也意味着训练AI将是大量资本交火的主战场。没有这么庞大的算力和资本的支持,要开发这样的AI简直不可能。

这同样也意味着现阶段的AI技术仍然在一个成熟商业化之前的阶段。

对于现阶段的用户而言,这个升级成Premium的费用20刀每月的费用更像是我们用户付费公测参与训练这个AI bot,然而它是否能创造高于这个费用的价值,现阶段我表示怀疑。

2. 预训练意味着过时的数据,以及过去的参数,这个AI并不主动吸收新的资讯。

现阶段的AI更擅长回答一些非量化并且答案较为固定的一些常识类问题和简单任务和请求。而且它所具备的参数和数据都是过去的数据,这些数据难以被更新,意味着我们无法通过AI获得新闻或是最新的数据。

或是一些主观感受型的创作类题目:

比如写一首押韵的诗歌,有着简单动人旋律的曲子(大众流行乐的创作难度远远小于你的想象力,作为古典音乐迷可以向你保证)

然而这个AI最具商业价值的地方,数据分析和归纳能力,现阶段只是初级的。

其中一个原因在于,这个AI并没有数据处理分析的能力,它仅仅具备的是多语言和语义的分析能力。

对于庞大的如医疗数据,或是公共数据,如果让这个AI来参与复杂的数据整合和决策流程,现阶段将是不可能的事。

3. ChatGPT并不具备“记忆功能”,这意味着你先前所询问的一些问题,GPT无法记住,同时当你重复询问同样一个问题,你甚至会获得截然不同的,甚至是随机的答案,因为他不‘理解’你的问题。

换而言之,它并不回答你的问题,它只是‘生成答案’。当它回答了一个问题,它同样也不记得,或是明白自己回答了什么,它只是按照大量的参数不断生成你的语义对应的答案。

常识性的问题,它将会具备优势,然而非常识性创作型的问题,它将有非常奇怪的表现。

就像是过去我们玩CS一样,当游戏程序出现bug,机器人有时候会在一些奇怪的场景里面spawn出来(生成)。

这些答案是大量参数训练的结果,其本质是生成的答案。如果有一天我们要在决策领域容纳AI作为参考依据,那么这些强AI必须具备理解我们问题的能力。

4. ChatGPT现阶段会生成,甚至是伪造许多的reference以及不存在的网址或者生成大量‘不负责任’或是极其随机的回答。

随着全球的用户参与训练,这也意味着有许多奇奇怪怪的东西将混进来,比如说种族主义的词汇或者是一些奇怪的异国概念,当这些对话被作为参数参与训练AI很可能得到完全无法理解或是预料的结果。

从这个角度来看,如何判断一个AI究竟是强AI还是弱AI有一个简单办法,就是看这个AI会不会问用户问题。

这才是CHAT的本质,如今的chat bot都是基于用户的单回馈模型。也就是说用户问,程序回答,然而真正的CHAT,聊天的过程应该是双向的,意思是,这个过程也应该包含AI做出反应,甚至提问用户的行为。

真正的深度的强AI包含了许多其他的参数,比如说提问,情绪,语气,性格等。

甚至有一天AI能够理解印度或是东欧的英语口音,然后make fun of it,现阶段的载体更多只是文字类的,未来GPT-4的时代,AI将可以对图片,视频,语音等不同载体做出反馈。

总的来说,语义模型,预训练,这些深度学习在内的科技将会给人类带来巨大转变。现阶段这些技术能够让我们让AI更加像人,或是生成和人相似的行为模式。

在这点上GPT之所以更加像人的原因在于,作为AI,它并不追求答案的正确性,这个角度来看,甚至有些哲学性。

因为经过全球人口,大量交互训练数据所获得的一个AI,那么想必更像是全球当下的‘用户画像’。它将反应一些更加有趣的事实,那就是全球的用户的意识形态,倾向以及爱好等。

这也是GPT巨大商业价值的来源,它几乎是免费的获取这些用户的兴趣,爱好,以及所有用户所对应的标签。

用户出于自愿将这些带有个人隐私的数据源源不绝地提供给这些chatbot,从这个角度来说,它有机会颠覆tiktok或是FB。现阶段它的商用价值更多限于订阅制。

CHATGPT所提供的服务非常有限,甚至无法被称为一种服务。作为订阅方案,我订阅了两个月,它所提供的价值不明。但是感觉这笔钱更像是捐献给OPEN AI基金会,用以改善这个技术。

因为人性,本来就是充满偏见,或是谬误的,人和机器的最大区别,在于变化性和适应性。机器是被创造于满足一个特定的用途,人工智能是介于机器和人之间的产物。

作为一个‘犯错’并学习不再犯错的AI,和一个从不犯错的AI对比,前者无疑更具备“人”的特征。

但有意思的是,与其说我们看到了一个“像人”的AI,倒不如说我们只是尝试让这个程序更像我们自己而已,我们只是通过这个程序反馈出了自己心中的渴望,困惑,以及更多的自己而已。

审核编辑 :李倩

全部0条评论

快来发表一下你的评论吧 !