紧跟AI步伐, Gitee已支持AI模型托管

描述

AI 时代已经来了!

现在,越来越多的企业和个人开始使用 AI 技术来解决各种问题。想要了解 AI,那么就一定要了解 AI 模型,作为 AI 的核心技术之一,AI 模型为各种进阶的人工智能应用奠定了基础,从 ChatGPT 、文心一言、通义千问这种语言模型,到 Stable Diffusion、Midjourney 这种文本到图像生成模型,很难不让开发者们开始对 AI 模型的开发产生关注。

目前已经有许多开源的 AI 模型供开发者们学习,但开发者们接触后才发现,AI 模型大多体积庞大,对其进行版本控制和共享下载都十分困难。比如 stable-diffusion-v1-5 模型总共要占用近 24GB 的空间,清华大学开源的 ChatGLM-6B 也需要超过 13GB 的空间,如此巨大的空间占用,对于个人开发者来说是一个巨大的挑战。

AI 模型也能用 Gitee 托管

为了帮助开发者们更高效的学习和开发 AI 模型,Gitee 现已经支持了 AI 模型托管功能,为广大 AI 开发者提供高速稳定的托管服务,现在除了代码之外,你也可以在 Gitee 托管自己的 AI 模型了。

查看 AI 模型

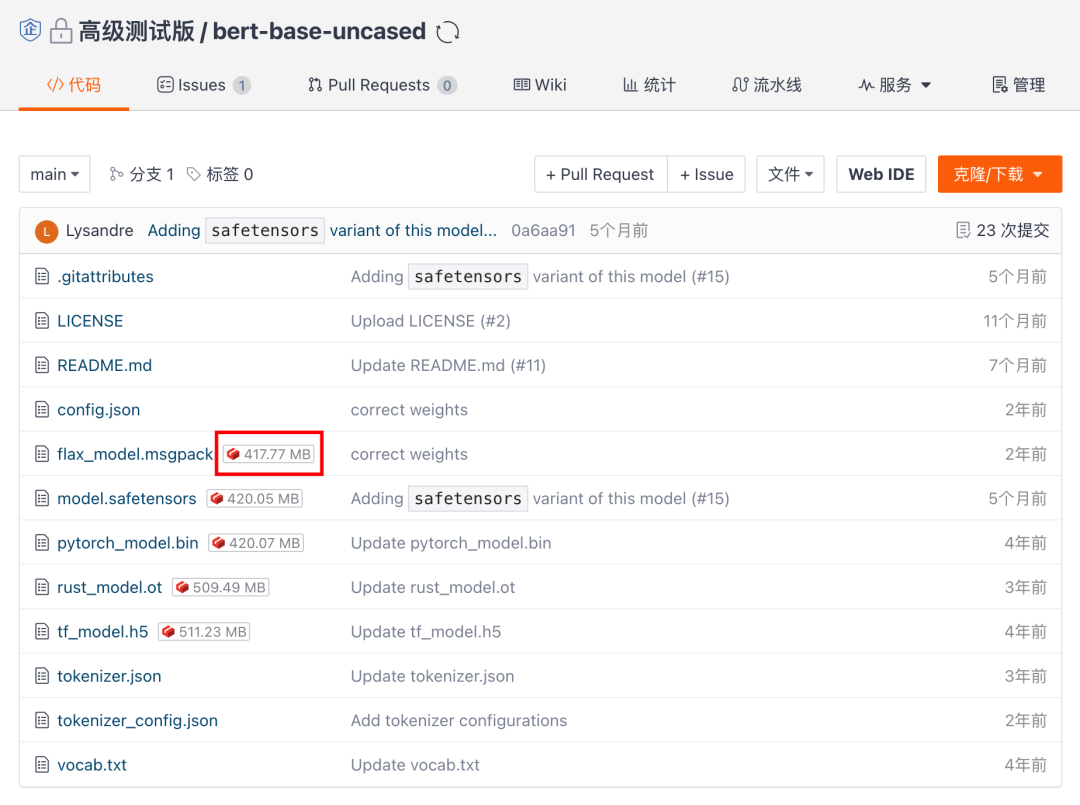

AI 模型的管理界面和代码的管理界面风格统一,比较明显的区别在于在大文件(如 AI 模型文件)后会对其进行 LFS 文件的标注,并注明其所占空间大小,这样就能很方便地定位到 AI 模型文件。

下载 AI 模型

- 通过网页下载如果你想要下载仓库中的某个 AI 模型,就像下载代码仓库中的某个文件一样,点击其文件名并点击下载即可。

- 通过命令行下载除网页外,你也可以通过命令行下载模型文件:

# 克隆仓库

git clone https://gitee.com/

cd

# 若已全局启动lfs,AI模型已全部自动下载完成

# 若未全局启动lfs,可手动下载指定模型

git lfs install

# 执行完成后,的模型文件就可以直接使用了

git lfs pull -I

通过 Git LFS 管理模型

你还可以使用 Git LFS 的方式对模型进行管理。在仓库标签页中的「管理」进入「Git LFS」选项,就可以查看该仓库内所有的 LFS 文件,包含其文件类型、大小等信息,并可以对它们进行下载和删除的操作。

怎么把 AI 模型上传到 Gitee

那么,如果想在 Gitee 上托管 AI 模型该如何操作呢?流程和代码托管一样吗?

与代码托管类似,目前 Gitee 支持从 Hugging Face 导入和从本地推送两种方式进行 AI 模型的上传:

从 Hugging Face 导入

Hugging Face 是一家非常活跃的人工智能创业公司。它拥有一个活跃的人工智能社区。有超过5000多家机构都在 Hugging Face 的社区发布内容,包括 Google AI、Facebook AI、微软等,这也让它成为了目前开发者们最熟悉的人工智能技术社区。

现在你可以直接使用 Hugging Face 的模型地址来将其导入至 Gitee 中,其操作与代码仓库的导入是相同的:

- 点击右上角头像旁的「+」,选择从外部仓库导入;

- 在 Git 仓库 URL 中输入你想要导入的 Hugging Face 地址,Gitee 会为其自动设置名称及路径;

- 点击「导入」,等待几分钟即可完成,同时后台开始同步 LFS 文件(速度取决于文件大小)。

从本地推送

除了从 Hugging Face 导入外,由于 Gitee 全面支持 Git LFS 功能,所以 Gitee 同样支持从本地推送 AI 模型,其流程与代码推送略有不同的是,推送 AI 模型时需要加入git lfs相关命令。

- 推送 Hugging Face 的模型仓库

# 克隆仓库至本地

git clone https://huggingface.co/bert-base-uncased.git

cd bert-base-uncased

# 同步模型数据

git lfs fetch --all

# 推送到Gitee仓库

git lfs push https://gitee.com/ --all

- 推送自己的 AI 模型仓库

cd ai-models-project

# 初始化仓库

git init

# 添加remote

git remote add origin https://gitee.com/

// ...

// 创建ai模型,如:xxx.msgpack

// ...

# 追踪模型文件

git lfs track "*.msgpack"

# 提交追踪变更

git add .gitattributes

git commit -m "track *.msgpack"

# 提交模型

git add .

git commit -m "append ...."

# 推送模型

git lfs push origin --all

git push

想要获得更大的存储空间?

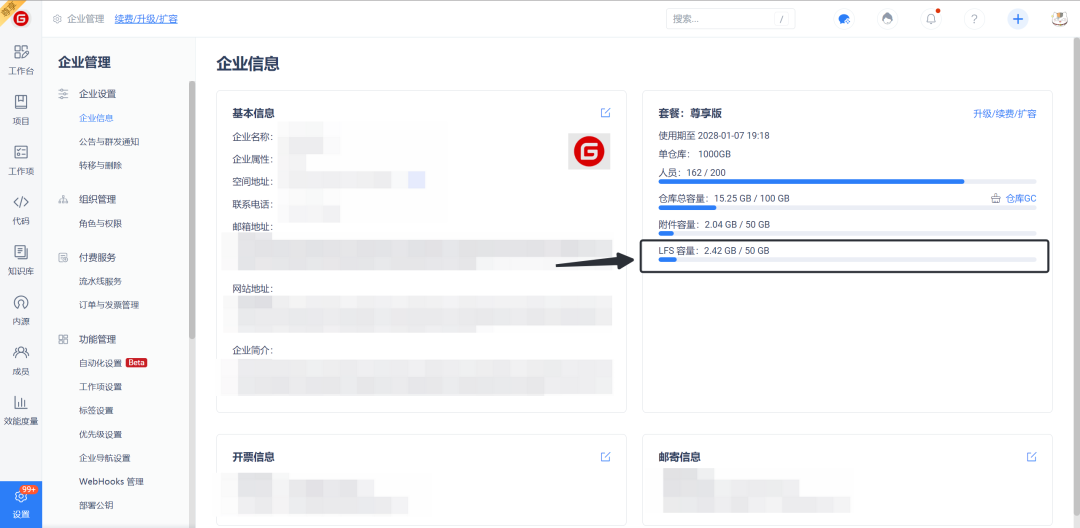

目前该功能已经对所有付费企业开放,由于 AI 模型体积庞大,存储和流量成本较高,付费企业可以通过扩容 LFS 容量以存储更多的 AI 模型,在企业控制台中,点击左下角的设置即可查看 Git LFS 配额使用情况,并可按需进行扩容操作。

如果你想要获取更多关于 LFS 扩容的信息,欢迎扫描下方二维码联系专属顾问,或前往 Gitee 企业版官网了解更多详情:https://gitee.com/enterprises。

AI 时代已来,Gitee 已经做好准备帮助你搭上这趟快车,快来和我们同行吧!

审核编辑 :李倩

-

航天仿真试验大模型系统已融合人工智能AI模型北京华盛恒辉科技 2026-05-11

-

AI模型的配置AI模型该怎么做?2025-10-14 392

-

首创开源架构,天玑AI开发套件让端侧AI模型接入得心应手2025-04-13 1079

-

利用RAKsmart服务器托管AI模型训练的优势2025-03-18 847

-

AI算法托管平台是什么2025-03-06 1315

-

AI模型托管原理2025-02-26 1225

-

DeepSeek-R1全尺寸版本上线Gitee AI2025-02-07 2367

-

企业AI模型托管怎么做的2025-01-15 1054

-

Gitee:玩转代码托管与协作的高效指南2024-12-24 3175

-

AI模型托管原理分析2024-11-07 1469

-

紧跟AI步伐 海信扛起智能电视大旗2018-01-04 1192

全部0条评论

快来发表一下你的评论吧 !