一文读懂Stable Diffusion教程,搭载高性能PC集群,实现生成式AI应用

电子说

描述

图生图 | PC集群 | PC Farm | Stable

文生图 | 生成式AI | Stable Diffusion

在当今计算领域中,PC集群和Stable Diffusion技术的应用已经成为不可或缺的一部分。这些技术在深度学习、AI绘画、高性能计算、人工智能、大数据、ChatGPT、AIGC等领域中都具有重要的应用价值。特别是在AI生成式内容创作方面,使用PC集群和Stable Diffusion技术可以有效解决大型计算任务所带来的挑战,并实现高质量的生成式AI内容。

通过结合这些技术的创新应用,我们可以更好地利用大规模的训练数据来调整和训练生成式AI模型,以提高其生成质量和准确性。同时,借助创新的加速技术和稳定扩散模型,可以提高AI生成式内容的生成速度和质量。比如,使用PC集群和Stable Diffusion技术配合AI生成式技术可以快速地生成高品质的图像、视频、音乐等内容,节约用户时间和精力,提高生产效率和创作效果。

另外,在企业和办公室环境中,PC集群也是一种非常有效的计算资源管理方法。该方法将任务分解成小的子任务,并分配给不同的计算节点进行处理,提高了计算效率和速度。通过使用PC集群,企业可以降低硬件和维护成本,并实现更高的计算性能和吞吐量,以满足不同任务的需求。同时,PC集群还具有容错机制和易于管理的优点,使得企业能够保持高效的生产和数据访问,减少停机时间和数据丢失风险。

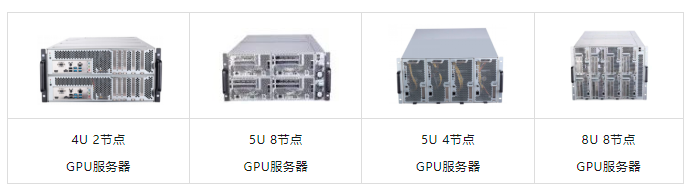

蓝海大脑PC集群解决方案是为了满足用户在进行高性能计算和人工智能相关任务时,基于高效、稳定、易于管理的部署方式而设计的。它采用4U机架式设计,每个机架可插拔4个PC节点,兼具服务器的稳定性和PC的高主频、高性价比的特点,使得用户既可以享受到高性能的计算能力,同时也能够控制相关成本开支。

此外,还集成了Stable Diffusion AI模型,该模型可以帮助用户快速生成高品质的创作内容。相较于传统的人工创作方式,Stable Diffusion Al模型具有更快的产出速度和更高的品质保证,这对于那些需要不断地生产创意和创作内容的用户来说是非常有益的。并且,由于该模型将AI技术应用到了创意生产领域,它对于优化创意生产流程,为企业降低创意生产成本等方面也具有重要意义。

同时在设计上也充分体现了可维护性与升级性。该解决方案采用了模块化可插拔设计,使得维护和升级变得更加容易。这不仅可以为用户节省时间和精力,同时也可以降低因为硬件故障或者设备升级等因素带来的生产中断和数据丢失的风险。

在本文中,我们将介绍生成式AI技术以及Stable Diffusion的原理和应用。同时,我们还将介绍如何使用PC Farm来加速模型的训练,以及如何优化模型的性能。我们希望通过本文的介绍,能够帮助读者更好地理解生成式AI技术,并且能够在实际应用中取得更好的效果。

Stable Diffusion教程

一、背景

Stable Diffusion是2022年发布的深度学习文本到图像生成模型,可根据文本描述生成详细图像。尽管官方项目不适合新手直接使用,但一些基于Stable Diffusion封装的WebUI开源项目已经出现,使得通过交互式界面使用Stable Diffusion变得更加容易。以下是几个比较热门的WebUI项目:github.com/AUTOMATIC11…和github.com/Sygil-Dev/s…。其中,AUTOMATIC1111的Stable Diffusion WebUI拥有最多的功能和最好的易用性,强烈推荐使用。

二、配置要求

要顺利运行stable-diffusion-webui和模型, 需要足够大的显存,最低配置4GB显存,基本配置6GB显存,推荐配置12GB显存。

三、安装Stable Diffusion模型

关于Stable Diffusion的安装方式,小编在之前的文章中已经有了详细介绍。这里小编就不多做介绍,大家如果感兴趣,可以加小助手微信发送安装教程。

四、启动项目

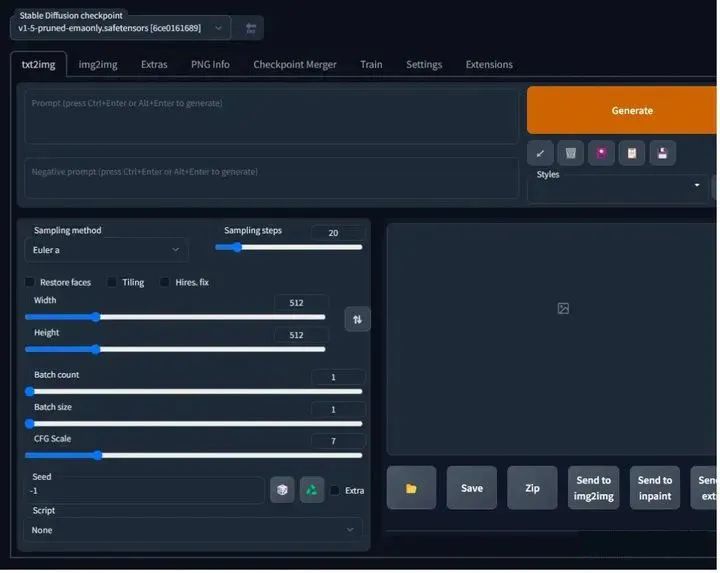

完成安装配置后,只需直接运行工程下的webui-user.bat文件(或在类Unix系统中运行webui-user.sh),即可开始使用。可以通过执行命令.webui.bat --theme dark来启动WebUI,并设置主题为dark。

1、启动的是夜间模式(不加theme参数就是日间模式)

首次启动时,系统将自动下载项目所需的Python依赖库(具体哪些库请见工程下的requirements.txt),以及相应的配置和模型文件(例如v1-5-pruned-emaonly.safetensors,约4GB大小)。这个过程可能需要一些时间。完成初始化后,下次启动就会更快了。如果输出中显示Launching Web UI with arguments: ... Running on local URL: http://127.0.0.1:7860,则表示启动成功。可以打开指定的网址来使用程序的运行界面。要创建公共链接,请在launch()函数中设置参数share=True。

2、tips:如何安装webUI简体中文语言包

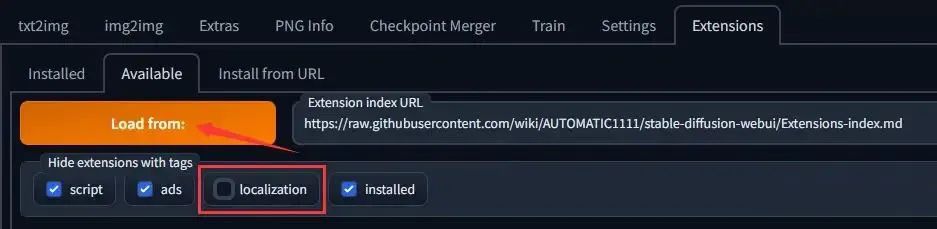

此扩展可以在 Extension 选项卡里面通过加载官方插件列表直接安装

3、官方下载

点击 Extension 选项卡,点击 Avaliable 子选项卡

取消勾选localization,再把其他勾上,然后点击 橙色按钮,如下图

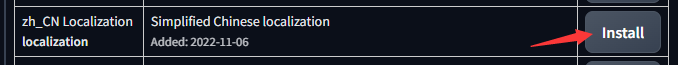

在 zh_CN Localization 这一项的右边点击 install

4、通过网址安装

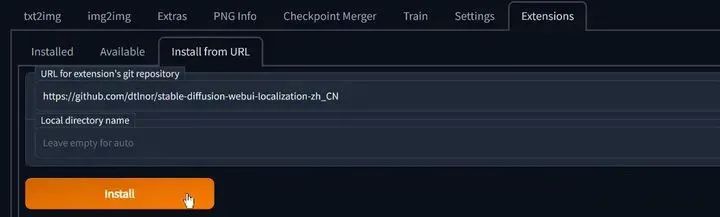

点击 Extension 选项卡,点击 Install from URL 子选项卡

复制本 git 仓库网址:

https://github.com/dtlnor/stable-diffusion-webui-localization-zh_CN

粘贴进 URL 栏,点击 Install,如图

5、配置

重启webUI以确保扩展已经加载了

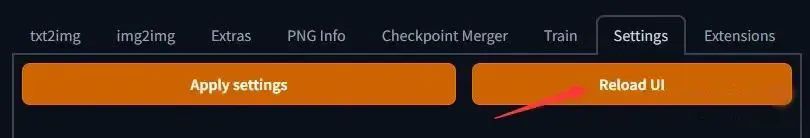

在 Settings 选项卡,点击 页面右上角的 橙色Reload UI按钮 刷新扩展列表

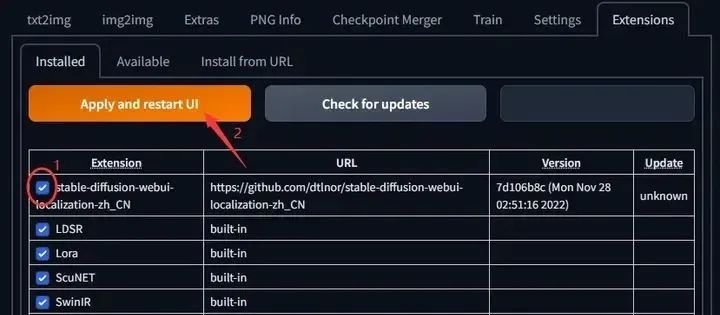

在 Extensions 选项卡,确定已勾选本扩展☑️;如未勾选,勾选后点击橙色按钮启用本扩展。

选择简体中文语言包(zh_CN)

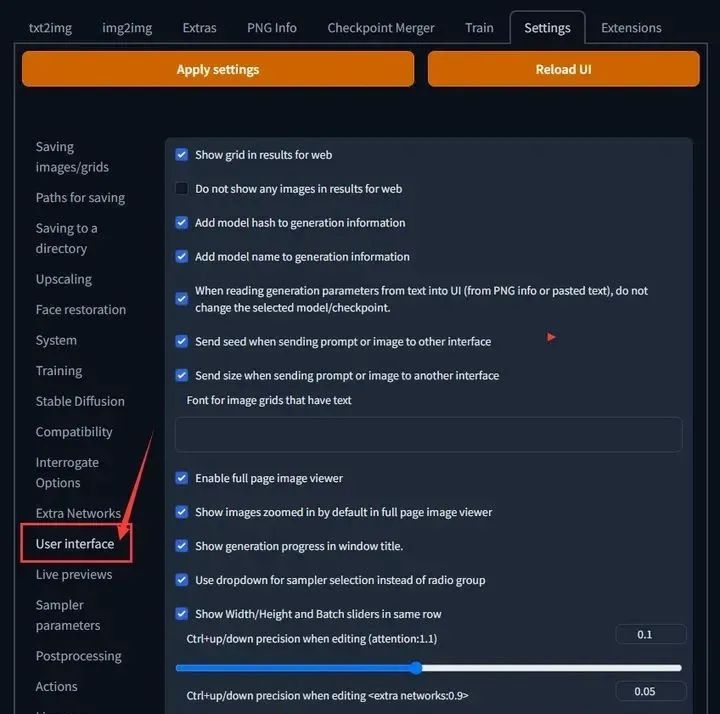

在 Settings 选项卡中,找到 User interface 子选项

然后去页面最底部,找到 Localization (requires restart) 小项,找到在下拉选单中选中 zh_CN (如果没有就按一下 按钮),如图

然后按一下 页面顶部左边的 橙色Apply settings按钮 保存设置,再按 右边的 橙色Reload UI按钮 重启webUI

五、开始使用

stable-diffusion-webui 的功能很多,主要有如下 2 个:

文生图(text2img):根据提示词(Prompt)的描述生成相应的图片。

图生图(img2img):将一张图片根据提示词(Prompt)描述的特点生成另一张新的图片。

1、文生图(text2img)

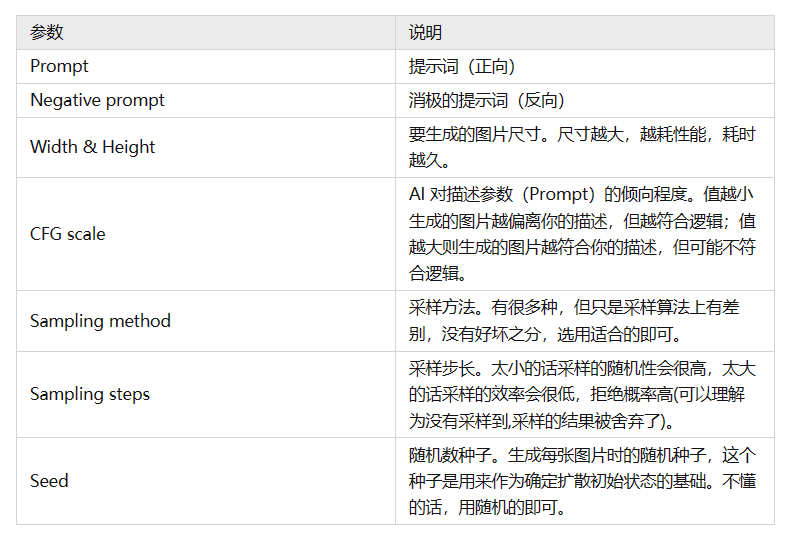

在开始使用文生图之前,有必要了解以下几个参数的含义:

接下来我们来生成一张赛博朋克风格的猫咪图片,配置以下参数后,

点击 "生成" 即可:

Prompt:a cute cat, cyberpunk art, by Adam Marczyński, cyber steampunk 8 k 3 d, kerem beyit, very cute robot zen, beeple | Negative prompt:(deformed, distorted, disfigured:1.3), poorly drawn, bad anatomy, wrong anatomy, extra limb, missing limb, floating limbs, (mutated hands and fingers:1.4), disconnected limbs, mutation, mutated, ugly, disgusting, blurry, amputation, flowers, human, man, woman CFG scale:6.5 Sampling method:Euler a Sampling steps:26 Seed:1791574510

注:提示词(Prompt)越多,AI 绘图结果会更加精准,另外,目前中文提示词的效果不好,还得使用英文提示词。

2、模型文件

上面截图里左上角 Stable Diffusion checkpoint 的值怎么跟之前截图里的不一样?这是因为我换了一个模型文件,还记得前面提到那个将近 4 个 G 大小的模型文件(v1-5-pruned-emaonly.safetensors)吗?那是 stable-diffusion-webui 的默认模型文件,用这个模型文件生成出来的图片比较丑,因此我换了另一个模型文件。模型文件下载的网站几个,比较出名的就是 civitai,这上面共享的都是别人训练好的模型。

模型文件下载地址:

civitai:civitai.com/

默认的 v1-5-pruned-emaonly:huggingface.co/runwayml/st…

模型库

根据你要生成的图片风格(比如:动漫、风景),挑选合适的模型查看,前面那个文生图的例子,使用的就是这个 Deliberate 模型,直接点击 "Download Latest" 即可下载该模型文件。

注:模型文件有 2 种格式,分别是 .ckpt(Model PickleTensor) 和 .safetensors(Model SafeTensor),据说 .safetensors 更安全,这两种格式 stable-diffusion-webui 都支持,随意下载一种即可。

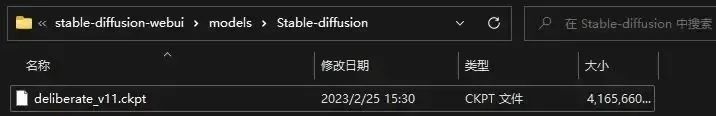

将下载好的模型文件放到 stable-diffusion-webuimodelsStable-diffusion 目录下:

放置好模型文件之后,需要重启一下 stable-diffusion-webui(执行 webui-user.bat)才能识别到。

这些模型文件一般会附带一组效果图,点击任意一张,就可以看到生成该效果图的一些参数配置:

将某些参数配置到"stable-diffusion-webui"中,然后点击"生成"按钮就可以生成类似的图片。需要注意的是,由于AI绘图具有随机性,因此生成的图片可能与效果图略有不同。文生图功能可以用来生成独一无二的图片,但要使用它,必须掌握提示词(Prompt)的语法规则。推荐参考两篇详细说明Prompt的文章:"全网Stable Diffusion Prompt运用技巧"和"Prompt工具网站"。更深入的图生图及模型训练方面攻略将在下期讲解。

游戏引擎加入生成式AI技术

生成式AI技术以ChatGPT为代表,全球爆火,引发了科技生产力上的巨大冲击。现阶段,生成式AI技术的发展对创作领域的影响逐渐提升。无论现阶段是否采用、多大程度采用生成式AI技术,游戏开发者、游戏厂商已难以回避生成式AI是否、以及多久可能从根本上游戏开发的问题。这不会一夜之间发生,但已经促使很多人思考结合AI后的游戏开发与游戏设计。

作为具有较强创作工具属性的游戏引擎,背后的技术人员与相关公司,已开始探索通过结合AI,提升工具易用性、简化创作过程。在现阶段,较为务实的落地方向包括帮助开发者优化创作流程,批量生产、处理、放置资产;同时也能降低开发门槛,使开发者更专注于创意本身。

一些游戏公司也开始储备相关人才,寻求有丰富AI经验的人才,调整、优化自身引擎和系统,顺应了新一轮AI能力引入游戏引擎的趋势。这些公司也在探索如何将生成式AI技术应用于游戏中,以提高游戏的可玩性和创新性。

一、与生成式AI技术结合,强化游戏引擎创作工具能力

最近在GDC 2023上,Unity推出了生成式AI工具,进一步推动了AIGC(人工智能游戏创作)的发展。除此之外,育碧与Roblox也加入了AI阵容,推出了新的AI工具。同时,不少第三方开发者也为引擎开发插件,增强引擎的AI能力。总之,随着AI技术能力的提升,游戏引擎越来越多地投资并扩展其人工智能领域,为游戏开发者提供更全面、更完整的解决方案。

二、游戏引擎结合AI,渗透游戏制作多个环节

1、美术、3D资产及场景生成

近年来,AI生成2D图像的技术已成熟,主流产品如Stable Diffusion、DALLE-2等多以扩散模型为技术路线。游戏引擎本身也有推出相关功能,例如Unity的Unity ArtEngine,可以通过API连接外部的AI图片生成工具,帮助角色立绘制作、材质和贴图生成等。而3D资产生成是生成式AI的热门方向之一,许多技术大厂和创业公司都积极投入研发,推出了Magic3D、Point E等产品。虽然各家公司的技术路线不尽相同,但目前都处于探索阶段。在游戏中,场景资源的需求量巨大,难以单纯依靠人工进行地编。一些游戏引擎已经引入了AI驱动的场景生成技术,例如Unity的Unity World Generation,通过机器学习技术自动生成并放置植被等资产,可以更有效地提高开发效率。

2、动画

游戏中的角色动画制作通常先在Maya等建模软件中进行模型制作和骨骼绑定,然后将模型导入游戏引擎中制作动画。近年来,游戏引擎开始引入AI能力来优化绑定和动作制作等流程。例如Unity的Deep Pose功能可以通过控制某个关节,自动模拟出该动作下其他关节的正确反应;Kinematica则免去了开发者安排角色在两个动作之间切换的Blend Tree或状态机步骤,只需给定骨骼姿势和所需轨迹运动,即可自动生成相应动作。虚幻引擎5还推出了机器学习变形器(ML Deformer)功能,用于创建高保真模型,同时显著减少GPU内存占用。这些技术的引入可以有效提高动画制作效率并改善角色变形效果。

3、对话、语音

游戏引擎在AI生成对话方面的进展得益于预训练大语言模型技术的迭代。育碧最近公布了AI写作工具Ghostwriter,用于NPC台词的生成。开发者可以输入基础台词或发言动机,就能自动生成多个版本可用台词。此外,该工具采用强化学习技术,并结合人类反馈,使其越来越有效和准确。

国内市场的Cocos则通过与百度文心一言合作,把智能对话技术应用在3D实时创作领域。角色的台词不仅限于文字,语音也很重要。近年来AI语音生成技术逐渐成熟,包括语音识别、自然语言处理、语言生成和语音合成等多项技术。越来越多公司和个人为游戏引擎开放SDK和插件,例如百度的语音识别SDK和IBM Watson Unity SDK等。此外,语音驱动嘴型与面部动画生成是近期一个热门技术方向,包括英伟达、网易、声网等多家公司。这些技术路线包括神经辐射场、生成对抗网络、扩散模型等。

4、AI NPC

NPC是大多数游戏都不可或缺的要素之一,创建AI驱动的NPC也是游戏引擎最早引入的功能之一。在游戏中创建一个高逼真的AI NPC时,需要涉及到AI行为树、环境查询和AI感知等多个环节。例如,在虚幻引擎4中,AI NPC的控制是通过行为树(UBehaviorTree)实现的,行为树中的各节点不断做出检测和判断,从而驱动AI NPC做出预设的行为。场景查询系统(EQS)使AI能够从周围环境中收集数据,并将这些信息用于行为树的操作决策中,例如寻找附近的弹药等。此外,虚幻引擎4的AI架构还包括AI感知系统(AI Perception System),通过AI感知组件来获取环境中的刺激源,如噪音、AI受到伤害或AI看到了什么。

三、生成式AI技术在人工智能创作中的应用

生成式AI技术已经被广泛应用于人工创作、游戏、图像和视频生成、医疗、垃圾信息识别等领域,并取得了显著的成果和收益。随着技术的不断发展和完善,我们相信其在更多领域中的应用会变得更加广泛和深入。

1、生成式AI技术在人工创作领域的应用

生成式AI技术已经在人工创作领域得到广泛的应用,如诗歌、小说、绘画等方面。通过对大量数据的训练,神经网络可以学习并模仿人类的创作方式和样式,实现自动生成具有创意和美感的作品。这种方法被称为“生成式对抗网络”(GAN),它通过两个神经网络竞争的方式来不断改进生成效果。

例如,OpenAI的GPT-3可以自动生成独特而富有表现力的文本内容,包括新闻、博客、散文、诗歌等,且在语言理解、逻辑推论等方面表现出色。此外,一些公司正在探索使用GAN生成艺术品,并将其应用于数字媒体和虚拟现实项目上。

这种技术的应用可以极大地提高人们的创作效率和质量,同时也激发了更多非专业人士的兴趣和热情。

2、生成式AI技术在游戏领域的应用

生成式AI技术在游戏领域的应用主要是以增强游戏场景、角色和任务设计的效率和效果。通过GAN和强化学习技术,生成式AI可以自动生成具有情感、特征、能力等方面的角色,并生成复杂而富有变化的游戏任务和场景。

例如,《失落的深渊》是一款利用GAN生成各种可爱精灵形象的手机游戏,玩家可以收集、养成和对战这些精灵。此外,一些公司正在使用生成式AI来设计游戏关卡和障碍,以增加游戏的挑战性和趣味性,同时缩短游戏开发周期。

3、生成式AI技术在图像和视频生成领域的应用

生成式AI技术在图像和视频生成领域的应用涉及到图像处理、图像生成和视频合成等方面。通过对大量数据进行训练和优化,生成式AI可以通过输入关键词或语音命令,自动生成符合需求的图片和视频,从而为企业和个人提供更高效、更创新、更独特的视觉内容。

例如,Nvidia公司推出了StyleGAN技术,可以生成具有艺术性的头像、场景等静态图像,展现出比较好的真实感和多样性。同时,也有一些公司在探索使用GAN生成虚拟演员或优化视频剪辑过程,以改善视觉效果并提高生产效率。

4、生成式AI技术在医疗领域的应用

生成式AI技术在医疗领域的应用主要包括医学图像分析、疾病诊断、基因编辑等方面。通过将数据输入到神经网络中进行训练和调整,生成式AI可以提高医学图像分析的准确度和速度,并且能够自动发现疾病的特征和规律,大大缩短诊断时间和提高治疗效率。

例如,谷歌公司的DeepMind团队与英国国家健康服务系统(NHS)合作研究使用GAN来优化眼科诊断,结果证明该方法能够在短时间内为患者提供准确的眼部放射图像,从而加速诊断和治疗过程。此外,一些公司正在探索生成式AI在药物研究和基因编辑方面的应用,以提高医学领域的创新和效率。

这种技术的应用可以极大地改变医疗领域的现状,让患者受益于更快、更准确、更个性化的医疗服务。

5、生成式AI技术在垃圾信息识别领域的应用

随着数字时代的到来,人们越来越依赖自动化系统来管理、筛选和分类数据,但是同样存在越来越多的垃圾信息,给用户带来麻烦。通过使用生成式AI技术,可以帮助识别垃圾邮件、广告、欺诈信息等,从而让用户受益于更干净、更安全的互联网环境。

例如,谷歌公司使用深度学习技术创建的“垃圾肉类识别器”(Spam Filter)可以对电子邮件进行分类,并将垃圾邮件过滤出去。此外,许多社交媒体平台和在线商店也都使用生成式AI技术来识别不良信息、网络攻击行为等,以确保网络环境的安全性和可靠性。这种技术的应用可以极大地提高数据管理的效率和准确度,并节省用户处理垃圾信息的时间和精力。

如何利用PC Farm

训练生成式AI模型

PC Farm(PC农场)是一个基于GPU集群的高性能计算平台,可以为科学家、工程师和研究人员提供强大的计算能力,以便他们能够更快地进行模拟、分析和优化。PC Farm平台支持多种深度学习框架,包括TensorFlow、PyTorch和MXNet等,可以训练各种类型的神经网络模型,包括生成式模型和稳定扩散模型。

生成式模型是一种能够生成新数据的神经网络模型,它可以从训练数据中学习到数据的分布规律,然后利用这些规律生成新的数据。生成式模型在图像生成、自然语言处理和音乐生成等领域有着广泛的应用。PC Farm平台可以为科学家和工程师提供高性能的GPU计算能力,以便他们能够更快地训练生成式模型,并且可以在训练过程中进行超参数调整和模型优化,以获得更好的生成效果。

Stable Diffusion是一种能够模拟物理系统的神经网络模型,它可以模拟分子动力学、流体力学和热力学等领域的物理现象。Stable Diffusion在材料科学、化学工程和生物医学等领域有着广泛的应用。PC Farm平台可以为科学家和工程师提供高性能的GPU计算能力,以便他们能够更快地训练稳定扩散模型,并且可以在训练过程中进行超参数调整和模型优化,以获得更准确的模拟结果。

一、什么是PC Farm (PC农场)

PC Farm是一种堆叠式设备形态,通过对多个插入标准机柜中的PC进行集约管理,实现更强大的云端处理性能。相比传统PC部署方案,PC Farm具有高性能、高效率和高回报的特点。PC Farm能够支持市场上所有主流CPU和全系列显卡,在一个标准机柜中最高可以部署144个算力节点,能够胜任大量专业应用。PC Farm配备远程带外管理技术和容器、虚拟化产品技术,可以真正实现算力资源共享,提升客户投资回报率。

PC Farm自2018年公布以来,经过了多次迭代和升级。先后增加了对独立显卡的支持和IPMI带外管理系统,升级了即插即用功能,进一步扩大和完善了合作伙伴生态圈,覆盖了通信服务提供商。2022年发布了最新的PC Farm4.0版,新增支持第12代、13代酷睿和至强W处理器,以及英特尔Arc显卡的支持。

PC Farm主要应用于云游戏、云电竞、云网吧、云VR、云渲染、测绘建模等场景。客户对PC Farm提出了多方面的需求,英特尔对PC Farm(PC农场)进行了更加精准的设计,包括通用组件支持、IPMI协议开放和模块化插拔设计。现在已经有几千家网吧和电竞酒店在使用PC Farm的方案,并且国内通信服务提供商也在进行相关布局。

PC Farm(PC农场)的商业应用情况很广泛,如在云游戏方面实现了高性能的云游戏服务,让玩家无需在本地安装游戏,可以随时随地跨平台畅玩高品质游戏;在网吧和电竞酒店方面降低了部署难度和成本;在VR领域通过PC Farm(PC农场)将算力部署在云端,通过串流技术就能够连接到前端的VR设备,能够让消费端用户享受到更加轻便快捷的VR游戏娱乐体验。

二、PC Farm平台的优势主要体现在以下几个方面

1、高性能计算能力

PC Farm平台可以为科学家和工程师提供高性能的GPU计算能力,以便他们能够更快地进行模拟、分析和优化。PC Farm平台采用了分布式计算的方式,可以将计算任务分配到多个GPU上并行计算,从而大大缩短了计算时间。

2、多种深度学习框架支持

PC Farm平台支持多种深度学习框架,包括TensorFlow、PyTorch和MXNet等,可以训练各种类型的神经网络模型,包括生成式模型和稳定扩散模型。科学家和工程师可以根据自己的需求选择最适合自己的深度学习框架。

3、超参数调整和模型优化

PC Farm平台可以在训练过程中进行超参数调整和模型优化,以获得更好的生成效果和更准确的模拟结果。科学家和工程师可以根据自己的需求进行超参数调整和模型优化,从而获得最佳的模型性能。

4、灵活的计算资源配置

PC Farm平台提供了灵活的计算资源配置方式,科学家和工程师可以根据自己的需求选择最适合自己的计算资源配置方式。PC Farm平台支持按需分配计算资源,可以根据任务的需求动态调整计算资源的配置。

5、安全可靠的计算环境

PC Farm平台提供安全可靠的计算环境,可以保障科学家和工程师的计算任务不受干扰和攻击。PC Farm平台采用了多层安全机制,包括网络安全、数据安全和身份认证等,可以保障计算任务的安全性和可靠性。

PC Farm、生成式AI和Stable Diffusion模型都是非常有用的工具和技术,可以帮助用户快速构建和管理计算机集群,生成高质量的数据和图像,提高模型的泛化能力和鲁棒性。它们在不同领域有广泛的应用,可以帮助用户解决各种实际问题。

审核编辑 黄宇

-

本地部署Stable Diffusion实现AI文字生成高质量矢量图片应用于电子商务2025-11-28 1009

-

Diffusion生成式动作引擎技术解析2025-03-17 3303

-

如何开启Stable Diffusion WebUI模型推理部署2024-12-11 1483

-

Stability AI试图通过新的图像生成人工智能模型保持领先地位2024-02-19 1922

-

利用 NVIDIA Jetson 实现生成式 AI2023-11-07 2595

-

Stable Diffusion的完整指南:核心基础知识、制作AI数字人视频和本地部署要求2023-09-07 4969

-

树莓派能跑Stable Diffusion了?2023-07-26 2590

-

基于一种移动端高性能 Stable Diffusion 模型2023-06-12 2152

-

优化 Stable Diffusion 在 GKE 上的启动体验2023-06-03 1814

-

NVIDIA 为 1 亿台 Windows RTX PC 和工作站提供全新生成式 AI 功能与突破性性能2023-05-31 1081

-

NVIDIA 携手微软,在生成式 AI 的新时代推动 Windows PC 创新2023-05-25 1518

-

使用OpenVINO™在算力魔方上加速stable diffusion模型2023-05-12 2533

-

高性能计算HPC照亮AIGC未来:PC集群+Stable Diffusion 打造极致游戏体验2023-04-20 1497

-

Stability AI开源图像生成模型Stable Diffusion2022-09-21 3887

全部0条评论

快来发表一下你的评论吧 !