使用OpenVINO工具套件洞察顾客心情

描述

了解消费者情绪是产品、服务等反馈流程中的重要一环。近年来,情绪分析(也称为意见挖掘)已被证明是提供顾客反馈的有用工具。情绪分析就是对社交媒体语境中的文字和自然语言进行分析和处理,其基本原理是根据某种形式的交流(如社交平台或网站上的评论)来了解顾客对某一主题的看法。

情绪分析的一种演变是检测顾客在货架前看到产品时的心情。这种类型的情绪分析不仅可以统计顾客对产品的看法,而且还可以支持直接互动—例如,如果顾客表现出对产品感兴趣,就通知销售人员。在本文中,我们将探讨如何利用英特尔® OpenVINO™工具套件中的Shopper Mood应用程序,根据顾客面部表情的视频输入,自动推断他们在看到商品时的心情。

Shopper Mood的数据管道

(图1)显示了Shopper Mood应用程序的数据管道。我们来更深入地了解一下这个深度学习应用程序的工作流程。

图1 : Shopper Mood的推理管道图展示了OpenVINO™工具套件的这个应用程序如何处理捕获的图像,以识别在顾客脸上检测到的心情。(资料来源:作者)

这个过程首先通过安装在货架上的摄像头捕捉图像,然后将该图像传递到基于卷积神经网络(CNN)的两个深层神经网络中的第一个。CNN是用于处理图像的最流行深度学习网络架构之一。它们由许多层组成,这些层在前端将图像分成多个小窗口来处理,并在后端生成一个或多个分类分数。第一个CNN决定是否能在捕获的图像中检测到人脸。如果第一个网络发现图像中存在人脸的概率超过可配置的概率阈值,则每张脸都被归类为“顾客”,并传递给第二个网络。第二个网络按以下五个类别对面部表情归类:

| ● | 开心 |

| ● | 难过 |

| ● | 惊讶 |

| ● | 愤怒 |

| ● | 无表情 |

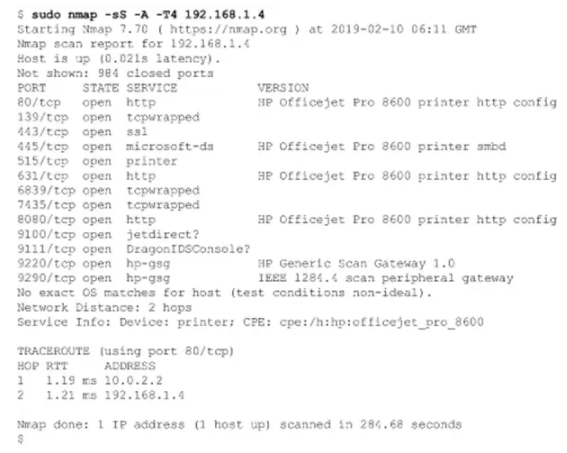

如果CNN无法确定所检测人脸的情绪(高于可配置的阈值),就会简单地将其标记为“未知”。在 (图2)中,可以看到覆盖在原始图像上的处理结果。

图2 : Shopper Mood Monitor输出屏幕显示了Shopper Mood推理通道的结果示例,这些结果就叠加在所捕获的原始图像上(资料来源:英特尔)

从(图2)可以看出,检测图像中人脸所需的时间是136ms,而情绪分析则需要13ms。这种快速处理使得此项分析可以实时执行,并快速响应,如通知销售人员协助顾客。

该示例应用程序还可以用于非实时统计,可以选择通过消息队列遥测传输(MQTT)协议将分析出的情绪结果发送到数据分析系统进行累积和脱机分析。

为什么说这个工具很酷

使用英特尔®的OpenVINO™分发版和大约600行Go代码,就可以实现十年前需要非常专业的硬件和软件才能实现的面部表情检测。很多复杂的工作内嵌到了被预先训练用于面部和表情检测的深度学习模型中。然后,通过“胶水代码”来加载这些模型,并将捕获的帧提供给模型进行处理和分类。当与功能强大的硬件(如基于第6th代英特尔® 酷睿™处理器的硬件或由英特尔Movidius™ X VPU驱动的英特尔经计算棒2)搭配使用时,可以获得出色的推理速度,从而实现实时分析。

改写示例应用程序

面部表情的实时检测有着广泛应用,有很多都是商业应用。比如了解顾客的情绪,但是也可以用来帮助患有某种面部识别障碍的人。据估计,2%的普通人群患有发育性面容失认症。这种病症会影响人们识别面部或面部表情的能力(表达性失认症)。Shopper Mood应用程序可以识别患有发育性面容失认症的个体的面部和面部表情。

此外,还可以考虑将此技术应用于增强虚拟现实。随着越来越多的嵌入式设备开始支持深度学习,可能的增强虚拟现实用例也在不断增加。例如,可以在眼镜上集成摄像头和实时面部检测功能。在你戴着眼镜时,如果有人从你身边经过,就会在眼镜捕获的图像上呈现一个虚拟覆盖层,描述这个人被推理出的面部表情。

这很容易让人想到其他应用。使用工具套件自带的示例代码,您只需要利用Shopper Mood应用程序的输出分类即可。

审核编辑:郭婷

-

请问OpenVINO™工具套件中的验证应用程序是什么?2025-03-06 282

-

如何下载 OpenVINO™ 工具套件?2025-03-05 292

-

无法在OpenVINO工具套件中使用ENetwork.层怎么解决?2023-08-15 479

-

为什么无法通过Heroku部署OpenVINO™工具套件?2023-08-14 538

-

使用 OpenVINO™ 工具套件进行限制区域监控2023-01-03 1420

全部0条评论

快来发表一下你的评论吧 !