Google: 时尚与人工智能相遇

电子说

描述

如果您看不到或想象自己穿着一件衣服,就很难知道它是否适合您。有多少次你在网上买了一件东西,当它送到你家门口时兴奋地打开盒子,冲上去试穿,然后……困惑地盯着镜子?它可能以您意想不到的方式垂坠。或者在您身上看起来与在在线模型上看起来完全不同。

本周,google将在 Google.com 上发布一项新的购物功能,旨在为人们提供更有用的在线购物体验。虚拟试穿 (VTO) 在具有不同体型和尺寸的真实模特身上生成栩栩如生的服装写照。这些图像包括那些微妙但至关重要的细节,例如某些东西如何悬垂、折叠、紧贴、拉伸和皱纹——所有这些都具有为 VTO 开发的新生成 AI 模型的强大功能。

购物者只需选择一件他们感兴趣的服装,然后选择一个款式,瞧,他们已经看到试穿了。

“VTO 是在线购物向前迈出的激动人心的一步,尤其是在显然需要更多代表性的服装领域,”购物产品经理 Shyam Sunder 说。“服装是谷歌搜索最多的购物类别之一,因此对人们和品牌的帮助潜力巨大。统计数据显示了一个明确的需求:42% 的在线购物者觉得模特图片无法代表他们,59% 的人对他们在网上购买的商品感到不满意,因为它看起来与他们预期的不一样。”

从一开始,该团队就想为购物者提供一系列可以解决这个问题的模型。“当我们在网络上搜索服装时,当涉及到穿着这些衣服的模特时,我们会发现结果差异很小,”Shyam 说。“我记得一个例子,50 张图片中只有四张是有色人种。所以问题是,即使我们想在购物中显示不同的图像,我们也做不到,因为网络上没有足够的图像。这是我热切想要解决的问题。”

因此,该团队创建了他们自己的资料库,其中包含 80 个代表多种尺寸、肤色、身高、年龄和性别的模特,以便在 Google 上购物的人可以选择他们最感兴趣的模特,并查看衣服穿在身上的效果。

“一个关键问题是如何在每个模型上自动生成任何服装,”购物研究科学家 Ira Kemelmacher-Shlizerman 说。“人们研究类似技术已经有一段时间了,但最终的图像从来没有完全达到目标——它们存在视觉缺陷,比如错位的褶皱,使衣服看起来畸形和不自然。所以我们给自己设定了一个挑战:创造一种方法,可以为任何体型和体形的人合成逼真的高质量图像。这就是生成人工智能的用武之地。”

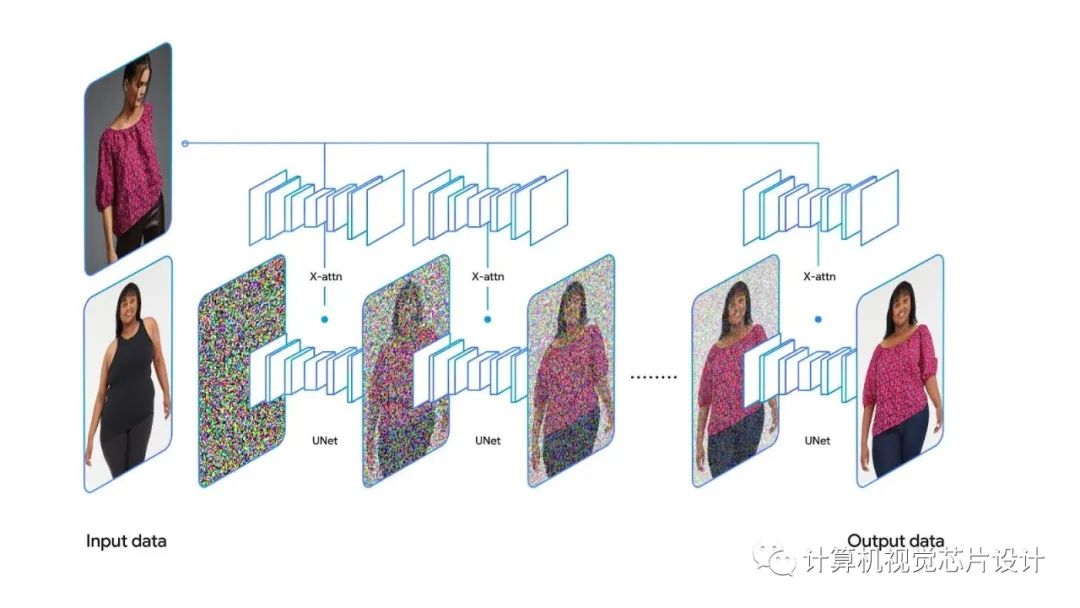

该团队转向了 VTO 的文本到图像模型,该模型能够从文本输入创建高度逼真的图像。尤其重要的是一种称为扩散的技术,该技术会逐渐将噪声添加到照片中,并训练神经网络去除这些噪声像素。

对于 VTO,该团队没有使用单一的扩散网络和大型语言模型(如在文本到图像中使用的那样),而是创建了一种称为并行 U-net 的新架构,它接受两幅图像:人物图像和服装图像。每张图片都通过自己的神经网络——U-net——同时通过称为“交叉注意力”的过程进一步相互交流。“结果是惊人的,”艾拉说。“我们的用户研究表明,我们的方法比最先进的方法有很大的优势——超过 95% 的时间。”

该团队使用 Google 的 Shopping Graph 对新的 AI 模型进行严格训练,这是世界上最全面的产品、卖家、品牌、评论和库存数据集。他们使用数百万对图像来训练模型,每对图像都包括一个穿着衣服的人以两种不同的姿势。人工智能模型学习将一个姿势的衬衫形状与另一个姿势的人相匹配,反之亦然,直到它可以从各个角度生成该人穿着衬衫的逼真图像。

在一个例子中,试穿结果似乎比原来的衣服颜色更亮。该团队对这些类型的示例进行了数天的审议,但最终决定在发布时谨慎行事,当出现任何此类错误时,删除在模型上虚拟试穿服装的选项。随着他们从用户和品牌那里得到反馈,他们将继续做出调整。“为生成图像发明全自动评估仍然是一个悬而未决的问题,我们正在积极努力,”艾拉说。

如今,Google Shopping Graph 上数百个品牌和零售商的女装上衣均可试穿,包括 Anthropologie、LOFT、H&M 和 Everlane。随着时间的推移,该工具将变得更加精确并扩展到更多品牌。到目前为止,品牌反响非常积极。

“当我们让他们了解这项技术时,我们收到了一些很好的反馈,并且也非常渴望参与,”Shyam 说。“他们中的一些人非常喜欢它,他们要求使用这项技术来支持他们自己的网站。”

-

《通用人工智能:初心与未来》-试读报告2023-09-18 1280

-

《移动终端人工智能技术与应用开发》人工智能的发展与AI技术的进步2023-02-17 2378

-

嵌入式与人工智能关系是什么?2021-12-27 4767

-

什么叫嵌入式,以及与人工智能的关系2021-11-08 2217

-

嵌入式与人工智能关系是什么2021-10-27 3438

-

人工智能芯片是人工智能发展的2021-07-27 6706

-

智能机器人与人工智能综合应用与创新2021-07-01 1770

-

RPA与人工智能的相连2020-04-13 2221

-

5G与人工智能的关系2019-11-22 4841

-

人工智能医生未来或上线,人工智能医疗市场规模持续增长2019-02-24 5895

-

解读人工智能的未来2018-11-14 4928

-

功能安全与人工智能2018-10-30 2948

-

人类与人工智能机器人合作的前景2018-04-16 3928

-

人工智能是什么?2015-09-16 6439

全部0条评论

快来发表一下你的评论吧 !