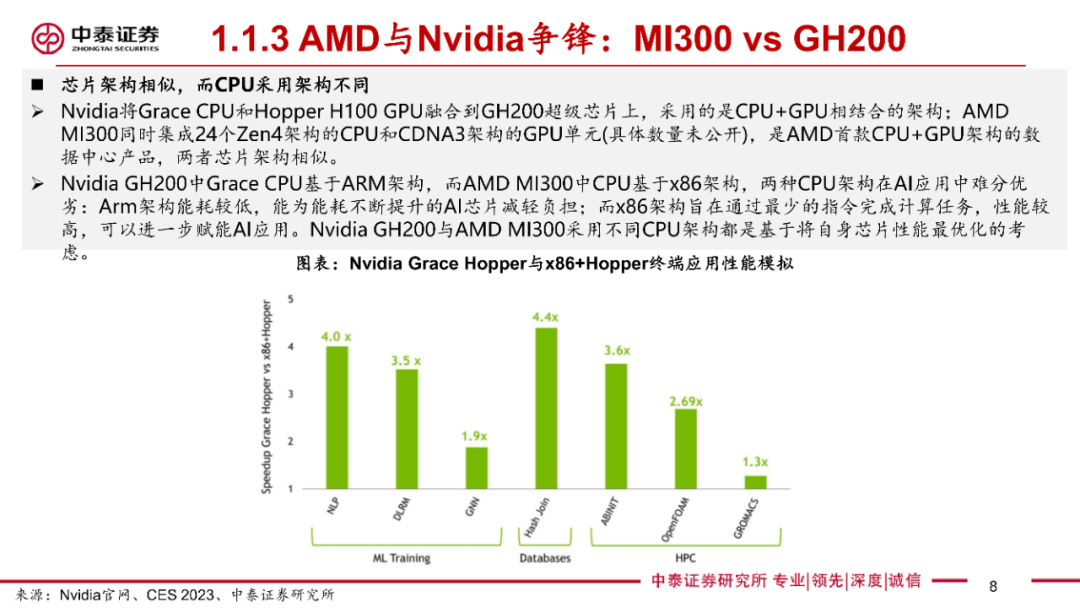

AMD与Nvidia争锋: MI300 Vs GH200

人工智能

描述

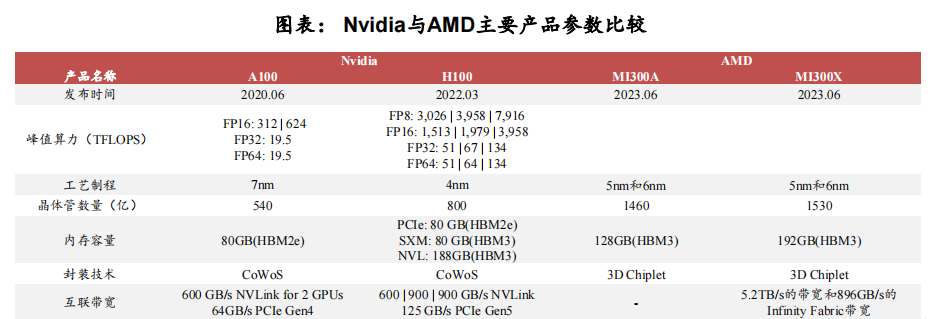

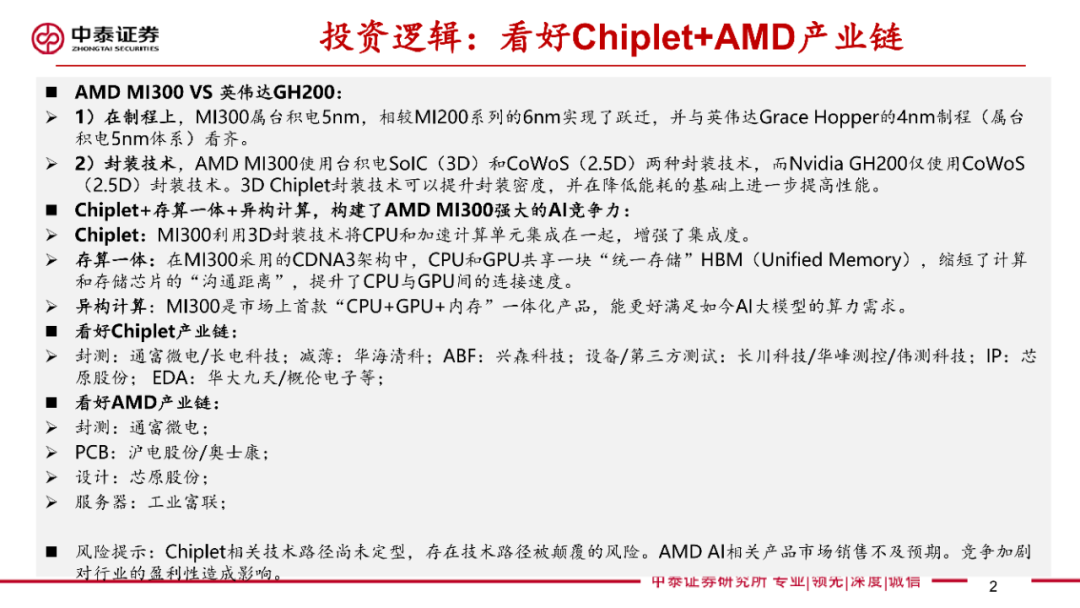

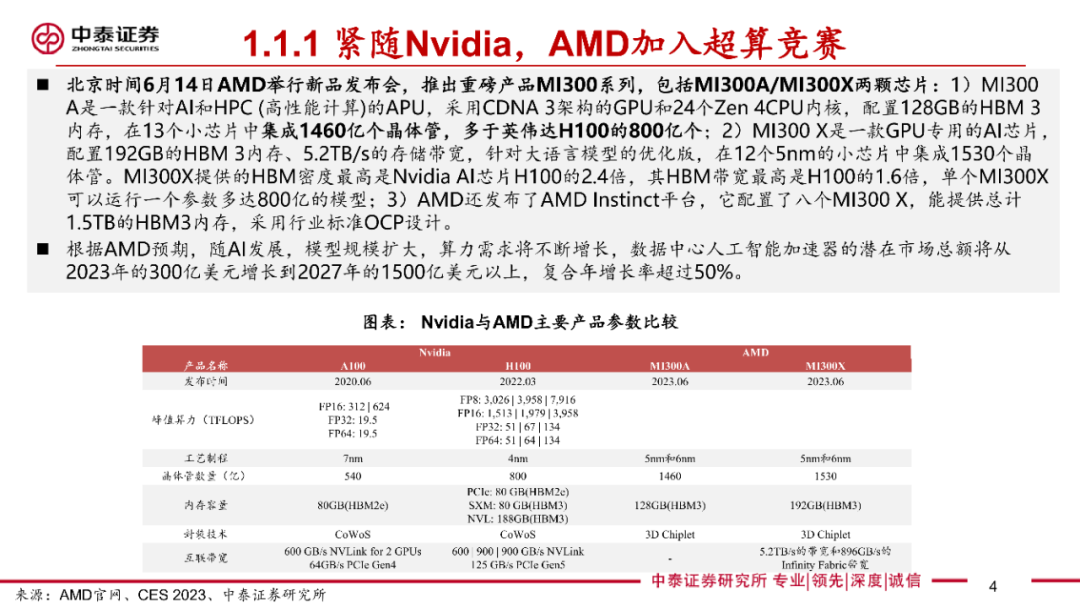

6月14日AMD举行新品发布会,推出重磅产品MI300系列,包括MI300A/MI300X两颗芯片:

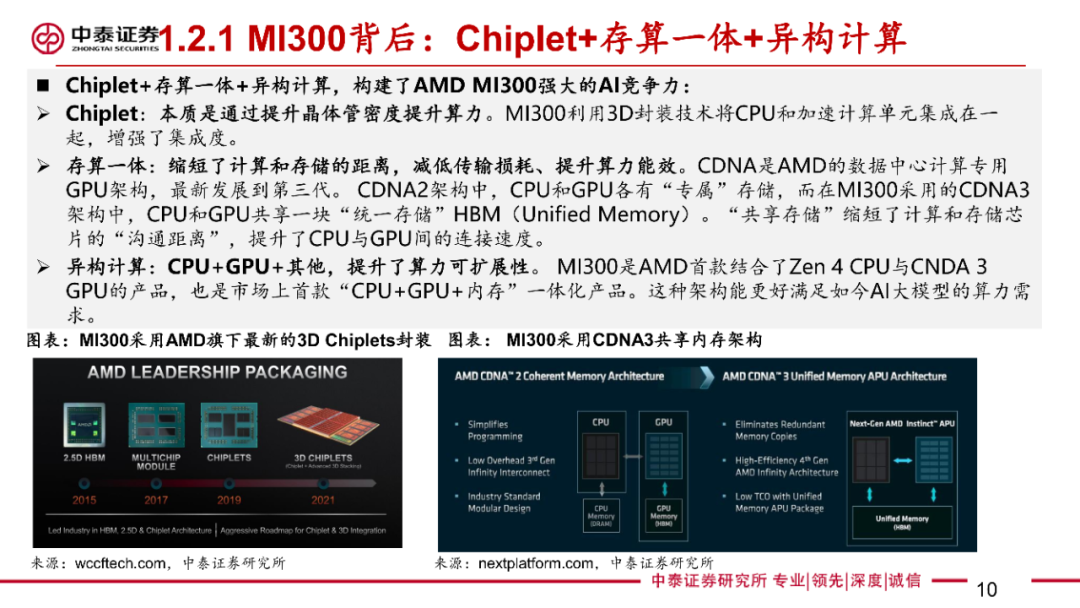

1)MI300A是一款针对AI和HPC (高性能计算)的APU,采用CDNA 3架构的GPU和24个Zen 4CPU内核,配置128GB的HBM 3内存,在13个小芯片中集成1460亿个晶体管,多于英伟达H100的800亿个;

2)MI300 X是一款GPU专用的AI芯片,配置192GB的HBM 3内存、5.2TB/s的存储带宽,针对大语言模型的优化版,在12个5nm的小芯片中集成1530个晶体管。MI300X提供的HBM密度最高是Nvidia AI芯片H100的2.4倍,其HBM带宽最高是H100的1.6倍,单个MI300X可以运行一个参数多达800亿的模型;

3)AMD还发布了AMD Instinct平台,它配置了八个MI300 X,能提供总计1.5TB的HBM3内存,采用行业标准OCP设计。

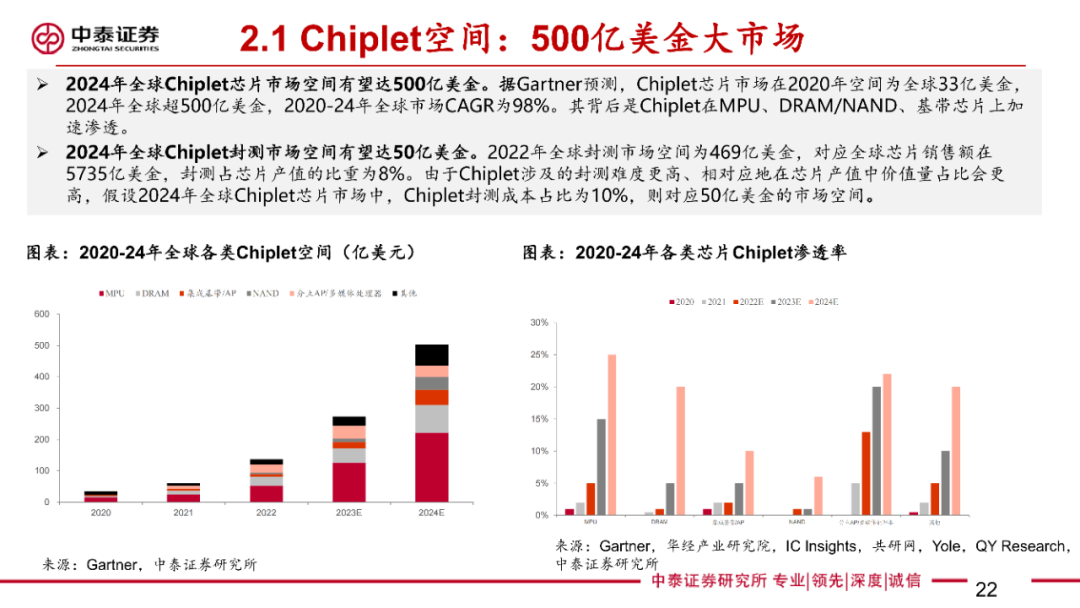

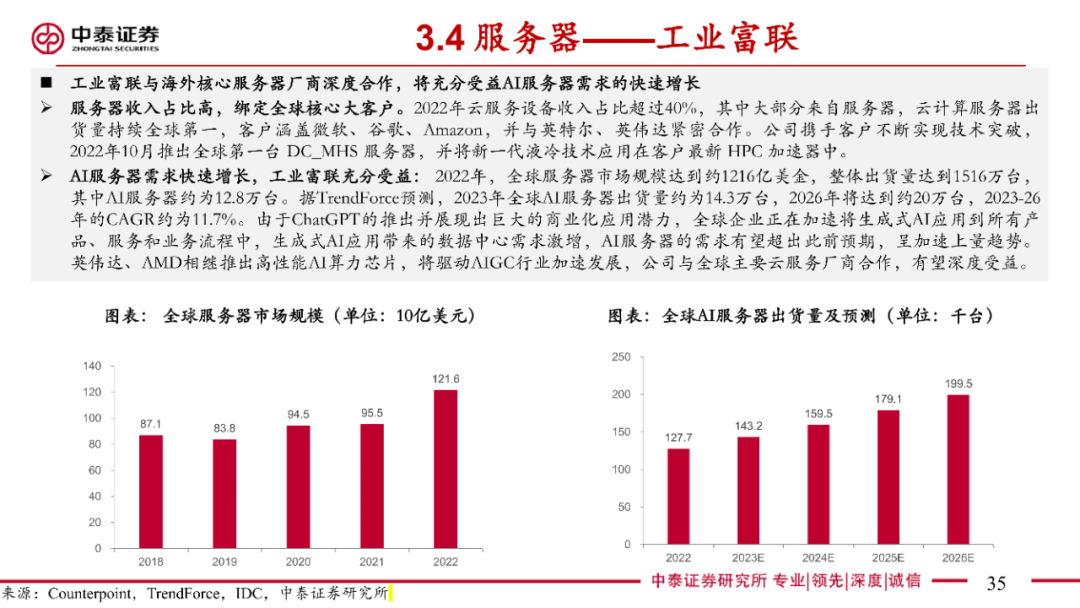

根据AMD预期,随AI发展,模型规模扩大,算力需求将不断增长,数据中心人工智能加速器的潜在市场总额将从2023年的300亿美元增长到2027年的1500亿美元以上,复合年增长率超过50%。

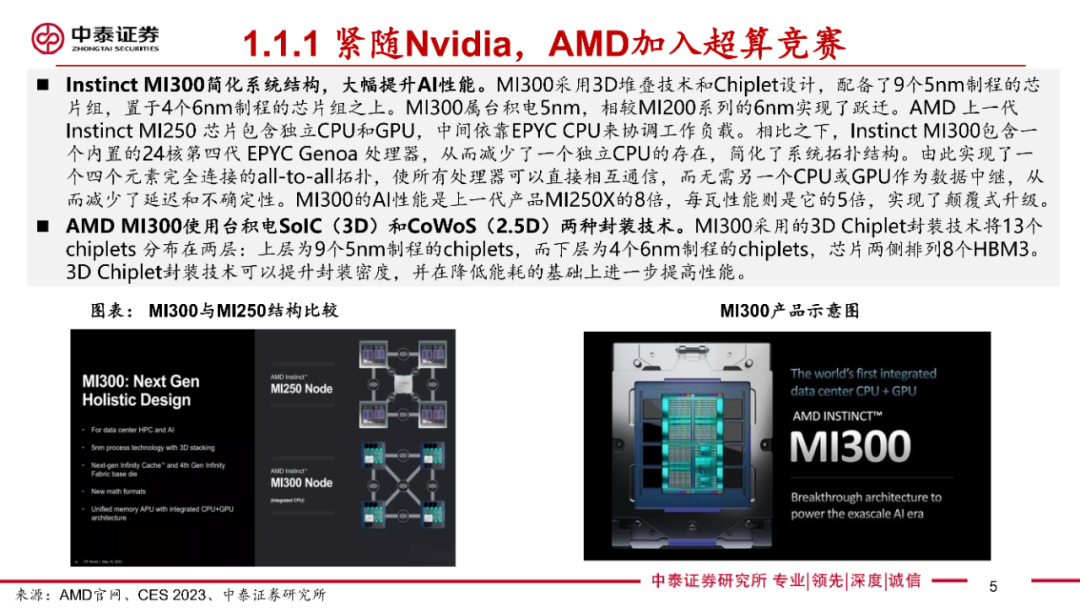

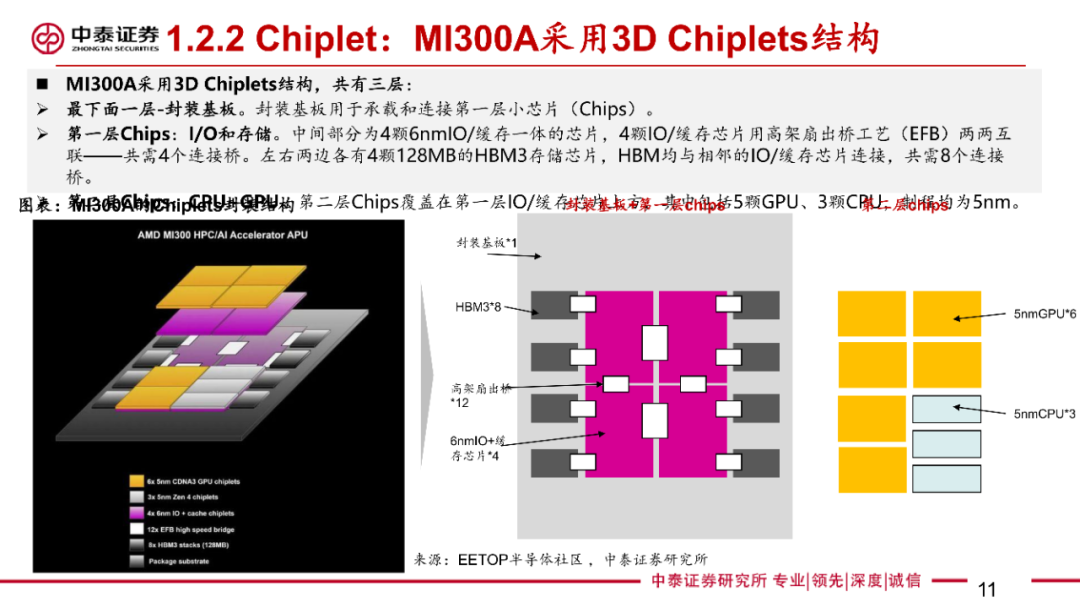

Instinct MI300简化系统结构,大幅提升AI性能。MI300采用3D堆叠技术和Chiplet设计,配备了9个5nm制程的芯片组,置于4个6nm制程的芯片组之上。MI300属台积电5nm,相较MI200系列的6nm实现了跃迁。AMD 上一代Instinct MI250 芯片包含独立CPU和GPU,中间依靠EPYC CPU来协调工作负载。相比之下,Instinct MI300包含一个内置的24核第四代 EPYC Genoa 处理器,从而减少了一个独立CPU的存在,简化了系统拓扑结构。由此实现了一个四个元素完全连接的all-to-all拓扑,使所有处理器可以直接相互通信,而无需另一个CPU或GPU作为数据中继,从而减少了延迟和不确定性。MI300的AI性能是上一代产品MI250X的8倍,每瓦性能则是它的5倍,实现了颠覆式升级。

AMD MI300使用台积电SoIC(3D)和CoWoS(2.5D)两种封装技术。MI300采用的3D Chiplet封装技术将13个chiplets 分布在两层:上层为9个5nm制程的chiplets,而下层为4个6nm制程的chiplets,芯片两侧排列8个HBM3。3D Chiplet封装技术可以提升封装密度,并在降低能耗的基础上进一步提高性能。

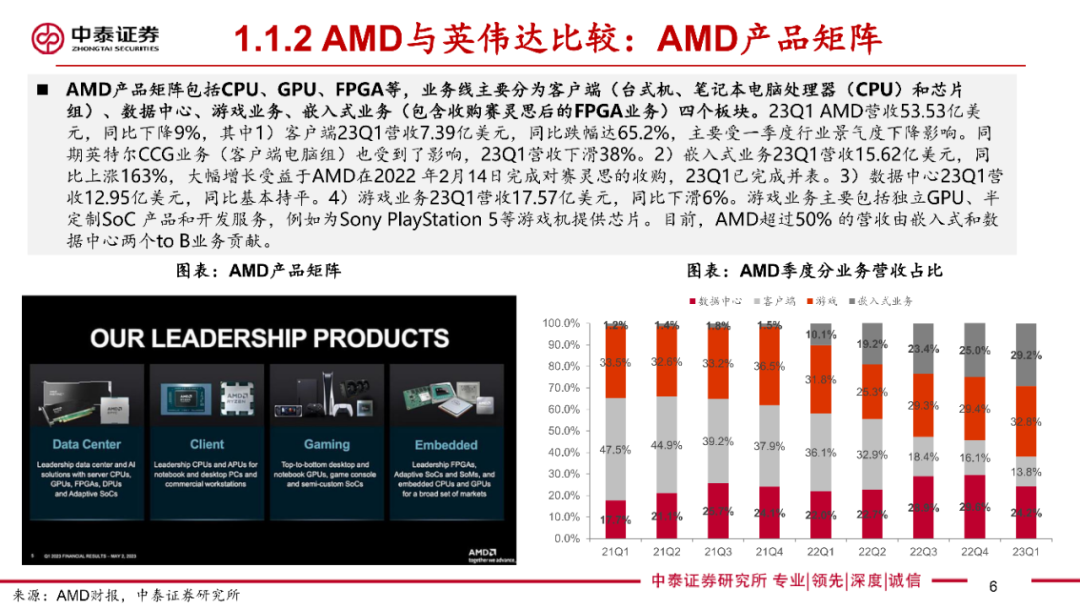

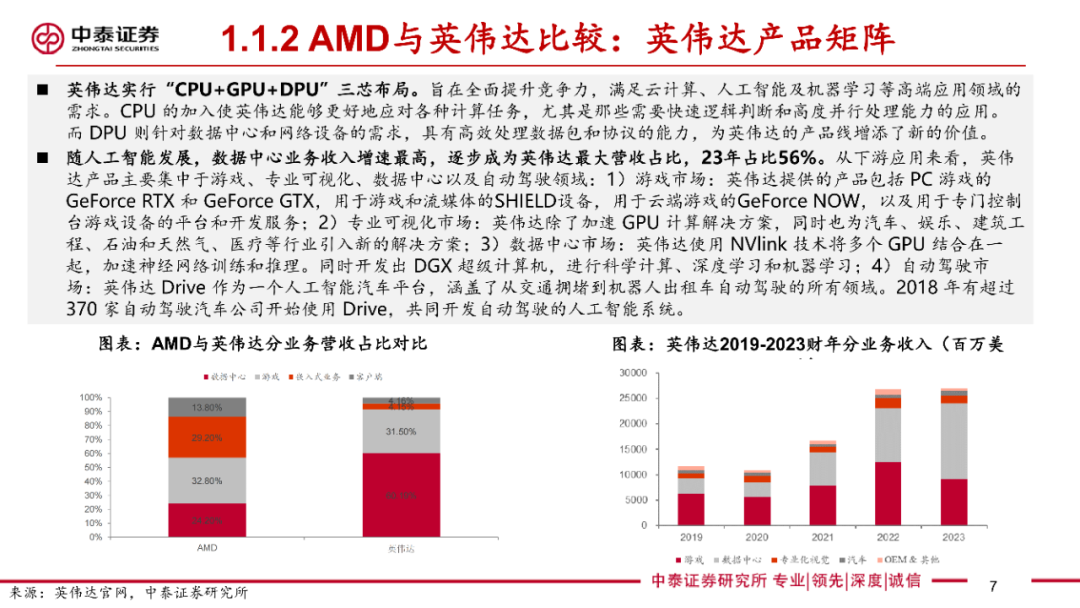

组)、数据中心、游戏业务、嵌入式业务(包含收购赛灵思后的FPGA业务)四个板块。23Q1 AMD营收53.53亿美元,同比下降9%,其中

1)客户端23Q1营收7.39亿美元,同比跌幅达65.2%,主要受一季度行业景气度下降影响。同期英特尔CCG业务(客户端电脑组)也受到了影响,23Q1营收下滑38%。

2)嵌入式业务23Q1营收15.62亿美元,同比上涨163%,大幅增长受益于AMD在2022 年2月14日完成对赛灵思的收购,23Q1已完成并表。

3)数据中心23Q1营收12.95亿美元,同比基本持平。

4)游戏业务23Q1营收17.57亿美元,同比下滑6%。游戏业务主要包括独立GPU、半定制SoC 产品和开发服务,例如为Sony PlayStation 5等游戏机提供芯片。目前,AMD超过50% 的营收由嵌入式和数据中心两个to B业务贡献。

编辑:黄飞

-

AMD Instinct MI300新版将采用HBM3e内存,竞争英伟达B1002024-02-23 2044

-

英伟达、AMD AI芯片今年将生产150万颗,先进封装设备商受惠2024-01-08 1380

-

AWS成为第一个提供NVIDIA GH200 Grace Hopper超级芯片的提供商2023-11-30 2024

-

AMD MI300系列新品下月问世,锁定AI服务器市场2023-11-17 1501

-

gh200芯片参数介绍2023-08-16 1903

-

AMD考虑将MI300和旧版MI250芯片产品调整性能参数以维持出口2023-08-02 1946

-

AMD硬刚英伟达,推出Instinct MI300,单芯片可运行800亿参数2023-06-14 3558

全部0条评论

快来发表一下你的评论吧 !