NeurIPS 2023 | AI Agents先行者CAMEL:首个基于大模型的多智能体框架

描述

AI Agents 是当下大模型领域备受关注的话题,用户可以引入多个扮演不同角色的 LLM Agents 参与到实际的任务中,Agents 之间会进行竞争和协作等多种形式的动态交互,进而产生惊人的群体智能效果。本文介绍了来自 KAUST 研究团队的大模型心智交互 CAMEL 框架(“骆驼”),CAMEL 框架是最早基于 ChatGPT 的 autonomous agents 知名项目,目前已被顶级人工智能会议 NeurIPS 2023 录用。

论文题目:

CAMEL: Communicative Agents for “Mind” Exploration of Large Scale Language Model Society论文链接:https://ghli.org/camel.pdf代码链接:

https://github.com/camel-ai/camel项目主页:https://www.camel-ai.org/“什么神奇的技巧让我们变得智能?窍门就是没有窍门。智慧的力量源于我们巨大的多样性,而不是任何单一的、完美的原则。”

——人工智能先驱 马文·明斯基(Marvin Minsky)[1]

目前来看,在机器通向高级智能的道路上,以 ChatGPT 为代表的大模型(LLMs)应该是必须经过的里程碑之一,它们以聊天对话的人机交互方式在多个领域的复杂任务解决方面取得了非常耀眼的成就。

随着 LLMs 的发展,AI Agents(AI 智能体)之间的交互框架也逐渐兴起,尤其是在一些复杂的专业领域,以角色扮演等模式预置的智能体完全有能力代替人类用户在任务中扮演的角色,同时,智能体之间通过以协作和竞争形式的动态交互往往能够带来意想不到的效果,这就是被 OpenAI 人工智能专家 Andrej Karpathy 等人看作是“通向 AGI 最重要的前沿研究方向”的 AI Agents。该领域发展的时间线如下 [2]:- “CAMEL”(骆驼:大模型心智交互框架)- 发布于 2023.3.21

- “AutoGPT” - 发布于 2023.3.30

- “BabyGPT” - 发布于 2023.4.3

- “Westworld” simulation(斯坦福西部世界小镇) — 发布于 2023.4.7

作为最早基于 ChatGPT 的 autonomous agents 知名项目,CAMEL 重点探索了一种称为角色扮演(role-playing)的新型合作代理框架,该框架可以有效缓解智能体对话过程中出现的错误现象,从而有效引导智能体完成各种复杂的任务,人类用户只需要输入一个初步的想法就可以启动整个过程。目前,CAMEL 已经被国际人工智能顶级会议 NeurIPS 2023 录用。

CAMEL框架

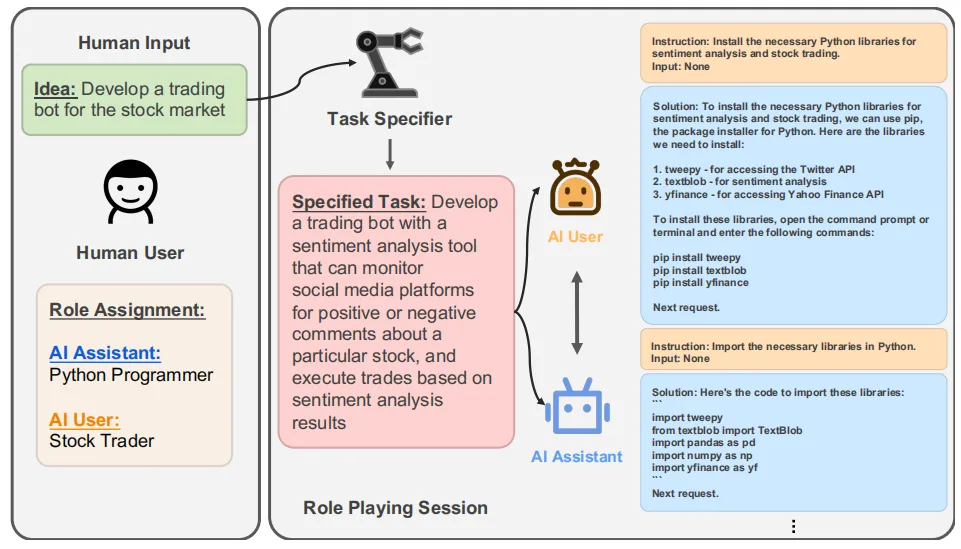

下图展示了 CAMEL 中的 role-playing 框架,人类用户需要首先制定一个想要实现的想法或目标,例如:开发一个用于股票市场的交易机器人。这项任务涉及的角色是 AI 助理智能体(使其扮演 Python 程序员角色)和 AI 用户智能体(使其扮演股票交易员角色)。

作者首先为 CAMEL 设置了一个任务细化器(Task Specifier),该细化器会根据输入的想法来制定一个较为详细的实现步骤,随后 AI 助理智能体(AI Assistant)和 AI 用户智能体(AI User)通过聊天的方式来进行协作通信,各自一步步完成指定的任务。

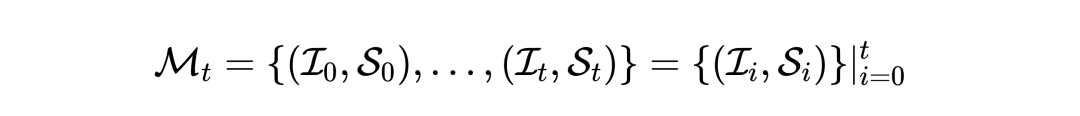

其中协作通信通过系统级的消息传递机制来实现,令 为传递给 AI 助理智能体的系统消息, 为传递给 AI 用户智能体的系统消息。随后为 AI 助理智能体和 AI 用户智能体分别实例化为两个 ChatGPT 模型 和 ,相应得到 AI 助理智能体 和 AI 用户智能体 。角色分配完成后,AI 助理智能体和 AI 用户智能体会按照指令跟随的方式协作完成任务,令 为时间 时刻获得的用户指令消息, 为 AI 助理智能体给出的解决方案,因而 时刻得到的对话消息集为:

CAMEL使用示例

2.1 协作角色扮演(cooperate role-playing)

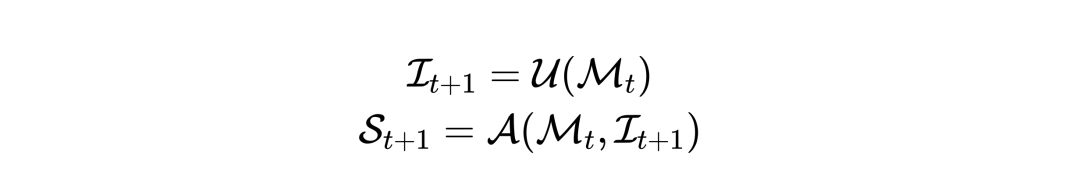

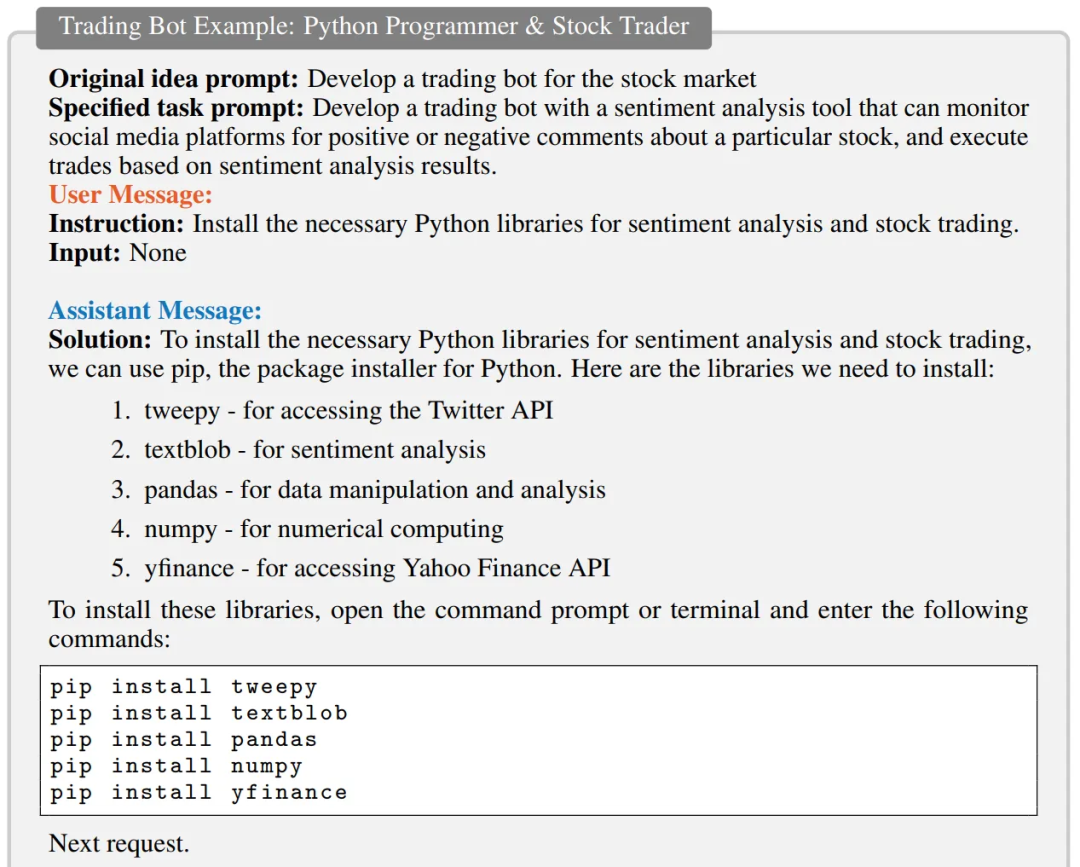

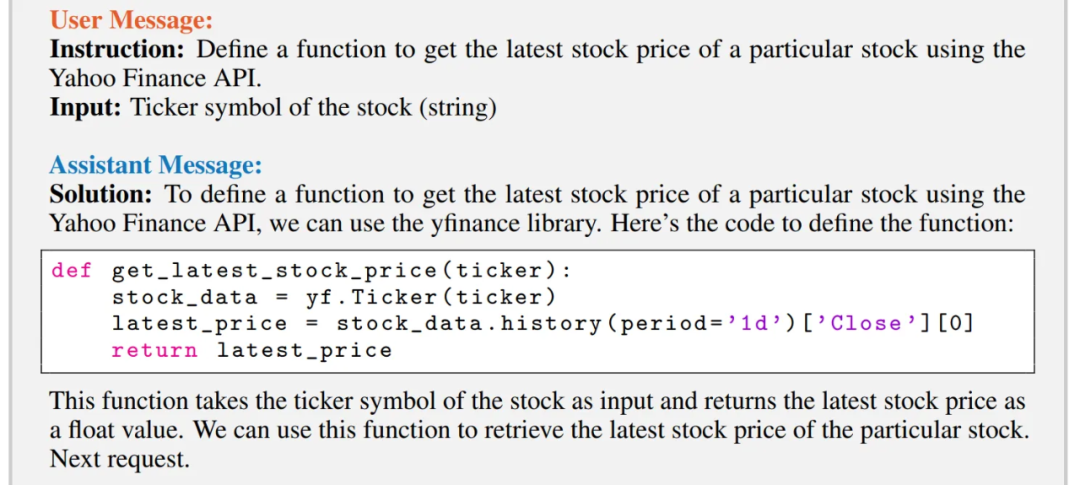

CAMEL 内置的协作式 role-playing 框架可以在人类用户不具备专业知识的情况下,通过 Agents 之间的协作方式完成复杂任务,下图展示了 CAMEL 开发股票市场交易机器人的例子,其中 AI 助理智能体的扮演的角色是一名 Python 程序员,而 AI 用户智能体扮演的角色为一名股票交易员。

在 role-playing 框架中,AI 智能体都具有特定领域的专业知识,此时我们只需要指定一个原始想法的 Prompt,随后两个AI智能体就会围绕着这一想法展开工作,在上图中,用户智能体提出交易机器人需要有对股票评论的情绪分析功能,随后助理智能体直接给出了安装情绪分析和股票交易所需的 python 库的脚本。

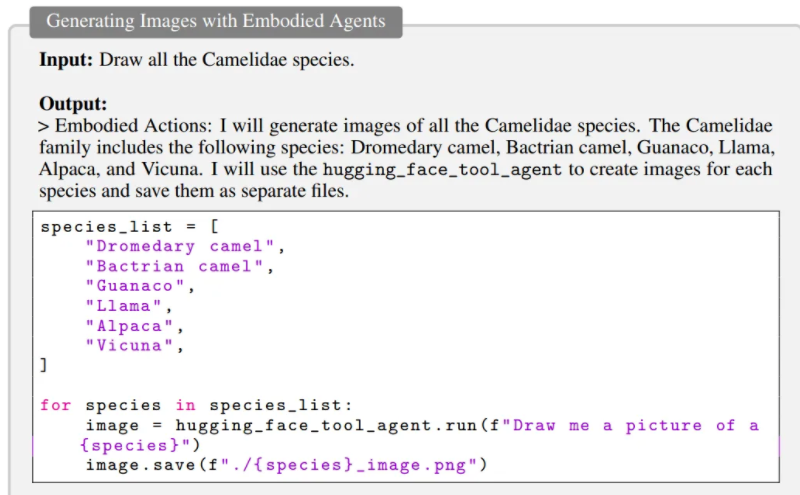

上图展示了 CAMEL 通过使用 embodied agent 调用 HuggingFace 提供的 Stable Diffusion 工具链生成骆驼科图像的样例,在这一过程中,embodied agent 首先会推理出骆驼科所包含的所有动物,随后调用扩散模型生成图像并进行保存。

2.3 critic在环(critic-in-the-loop)

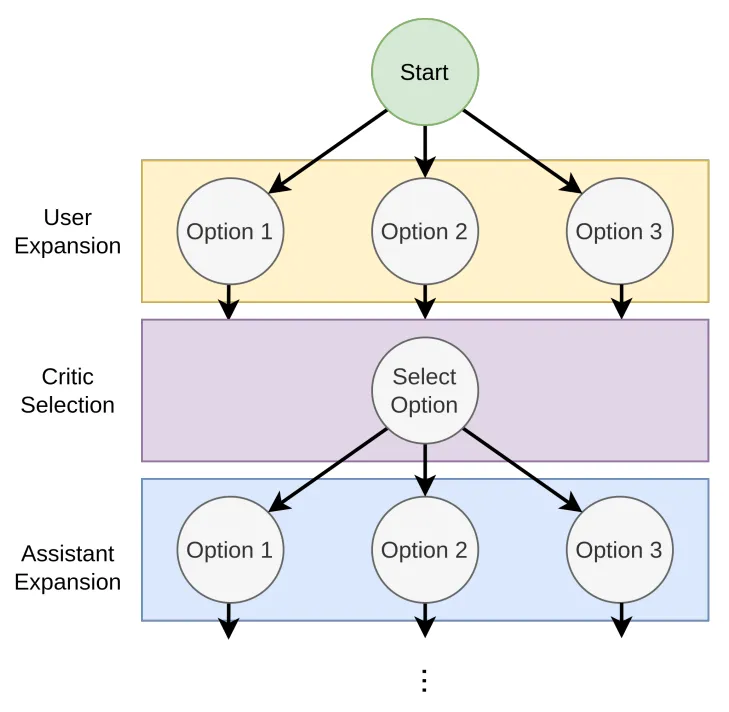

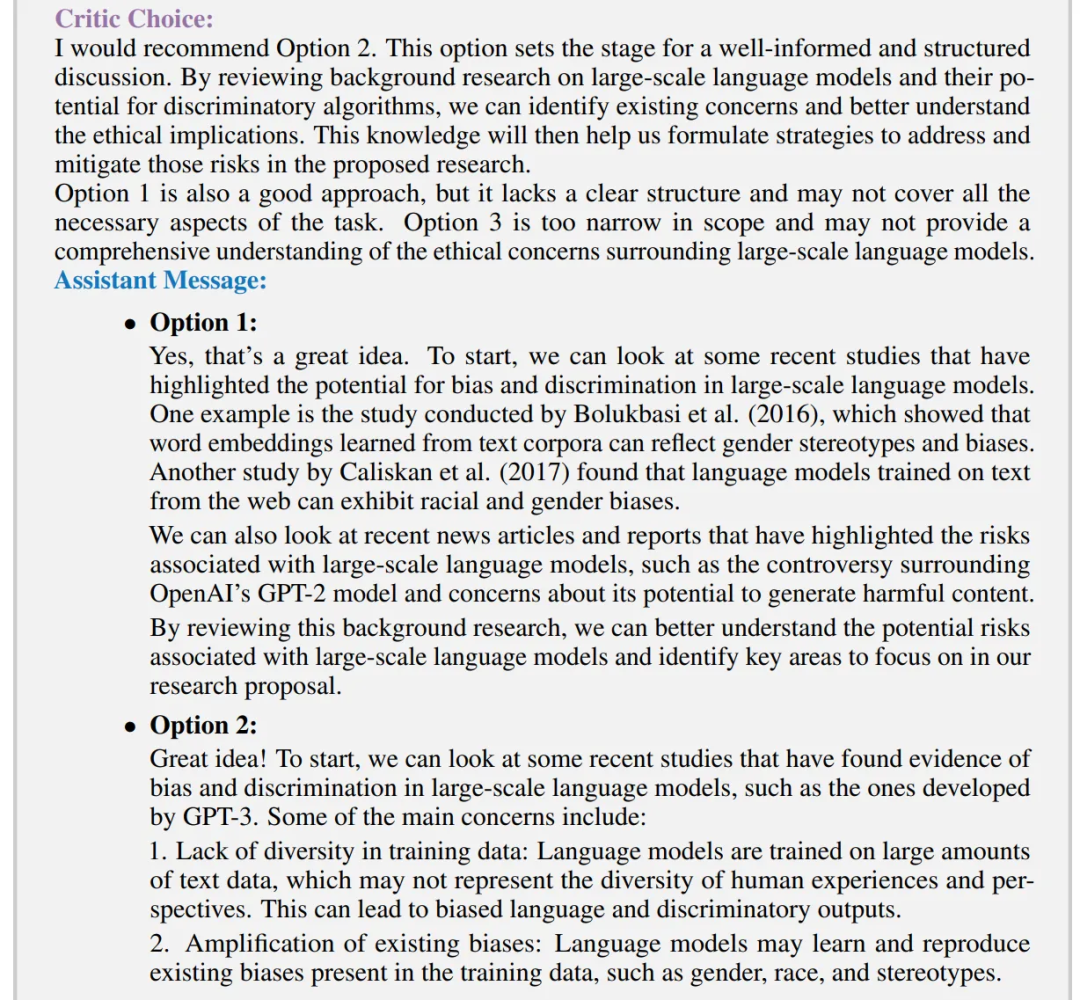

为了增强 role-playing 框架的可控性,作者团队还为 CAMEL 设计了一种 critic-in-the-loop,这种机制受到了蒙特卡洛树搜索(MTCS)方法的启发,它可以结合人类偏好实现树搜索的决策逻辑来解决任务,CAMEL 可以设置一个中间评价智能体(critic)来根据用户智能体和助理智能体出的各种观点进行决策来完成最终任务,整体流程如下图所示。

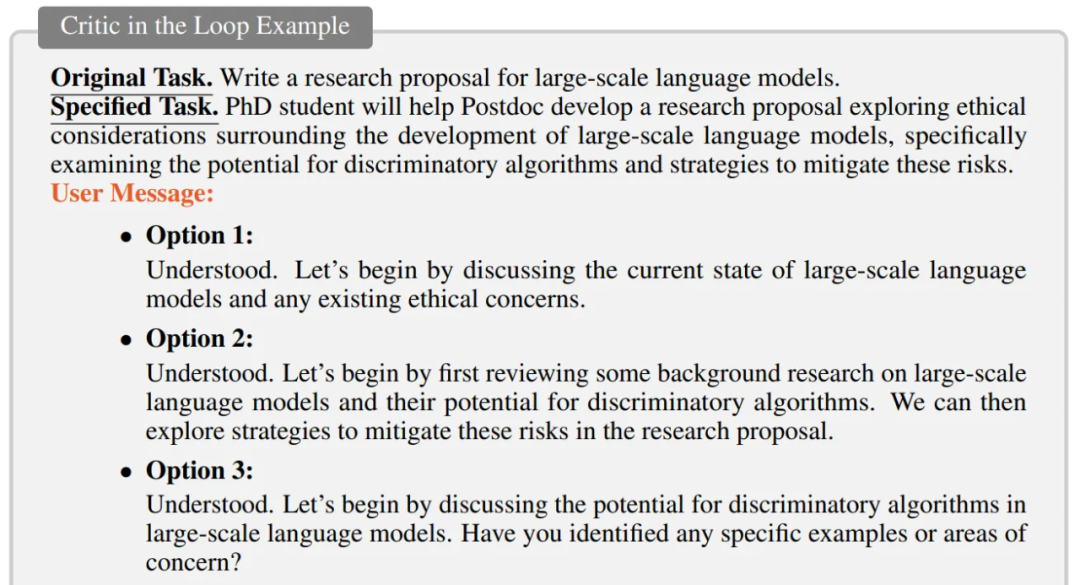

考虑这样一个场景,我们让 CAMEL 主持一场很具体的科研项目讨论会,而科研项目的主题“大型语言模型”,CAMEL 可以将用户智能体的角色设置为一个博士后,将助理智能体的角色设置为博士生,而中间评价智能体的角色设置为教授。任务指示博士生来帮助博士后制定研究计划,需要围绕大模型的伦理展开研究。

在接到任务后,博士后智能体首先抛出了关于这一项目的三个观点,表明项目应该首先从调研大模型伦理方面的相关工作着手。随后教授智能体会根据这三个观点给出自己的看法。并且认为观点 2 最为合理的,即研究大模型歧视性算法。同时还会给出另外两个观点的缺陷,例如观点 1 缺乏更加清晰的结构,观点 3 的研究范围太窄等等。

在教授发言之后,博士生智能体会进行更加具体的项目规划,例如直接列出一些大模型伦理安全方向的相关文献,并且讨论如何开展具体的研究。

在教授发言之后,博士生智能体会进行更加具体的项目规划,例如直接列出一些大模型伦理安全方向的相关文献,并且讨论如何开展具体的研究。

实验效果

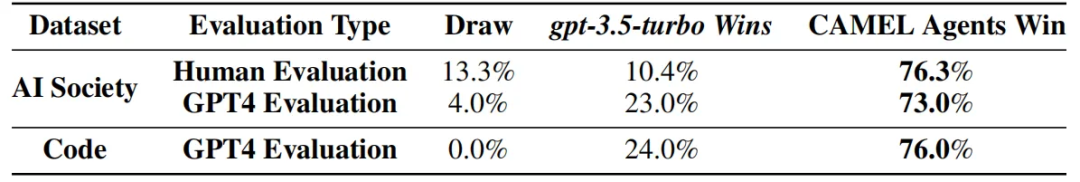

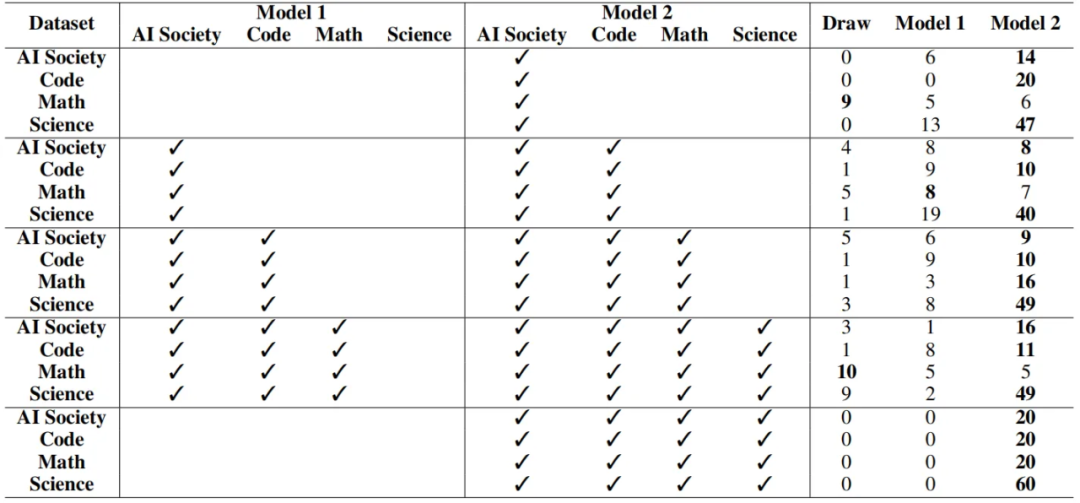

本文的性能评估主要从三个方面进行,并且采用两个 gpt-3.5-turbo 作为实验智能体,实验的数据集使用 CAMEL 框架生成的四个 AI 数据集,其中 AI Society 和 AI Code 侧重于智能体的对话效果,而 AI Math 和 AI Science 侧重于智能体的问题解决能力。3.1 Agent评估在这一部分,作者从 AI Society 和 AI Code 数据集中分别随机选择 100 个任务进行评估,然后使用 CAMEL 框架和单个 gpt-3.5-turbo 进行对比实验,结果评估方面分为两部分,一方面由人类受试者对两种方法给出的解决方案给出 453 份投票数据,来决定哪种方案更加可行。另一方面,作者提示 GPT4 模型对两种方案直接给出评分,具体的对比数据如下表所示。

作者首先从 AI Society 数据集开始,让模型了解人类的互动常识和社会动态,随后 AI Code 和其他数据集的注入,模型获得了编程逻辑和语法的知识,同时拓宽了模型对科学理论、经验观察和实验方法的理解。

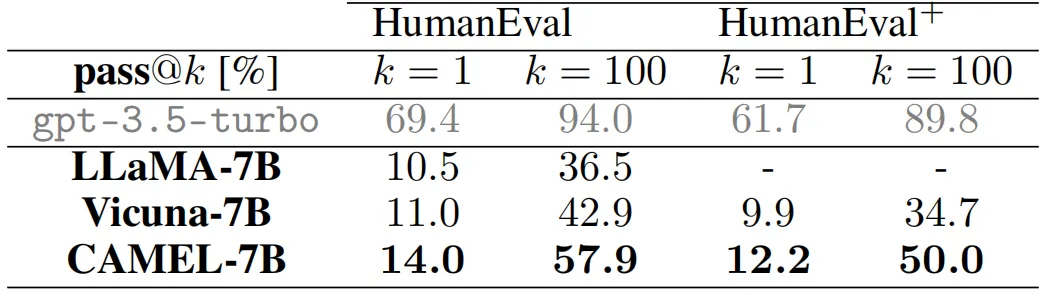

为了进一步评估 CAMEL 框架的代码编写任务解决能力,作者在 HumanEval 和 HumanEval+ 两个评估基准上进行了实验,实验结果如下表所示。

参考文献

[1] Minsky M. Society of mind[M]. Simon and Schuster, 1988.

[2] https://towardsdatascience.com/4-autonomous-ai-agents-you-need-to-know-d612a643fa92

原文标题:NeurIPS 2023 | AI Agents先行者CAMEL:首个基于大模型的多智能体框架

文章出处:【微信公众号:智能感知与物联网技术研究所】欢迎添加关注!文章转载请注明出处。

- 相关推荐

- 热点推荐

- 物联网

-

维智科技亮相WIF2025创新先行者论坛暨商业航天新十年盛典2026-01-27 864

-

基本半导体亮相2025未来汽车先行者大会2025-06-06 1085

-

上汽集团亮相2025未来汽车先行者大会2025-06-05 1037

-

兴威帆电子:RTC时钟芯片领域的先行者、专注者(中)2024-11-26 1121

-

深圳鸿合智远 兴威帆电子:RTC时钟芯片领域的先行者、专注者(上)2024-11-25 1529

-

蚂蚁集团发布首个开源金融场景多智能体框架2024-05-28 1637

-

Ignite China | 两周后,来这里抢先看AI先行者们创造新增长2023-12-27 746

-

NVIDIA 凭借生成式 AI 和通用智能体方面的研究获得 NeurIPS 奖2022-12-01 1137

-

HarmonyOS 先行者 | 美的与 HarmonyOS 共同布局智能家居产业升级2020-11-24 2039

-

Hello New World!华为HarmonyOS先行者技术沙龙回顾2020-11-17 3105

-

【HarmonyOS】HarmonyOS先行者技术沙龙—— Hello New World!2020-10-27 2165

-

智慧营销先行者大会 亮点抢先看2020-02-28 2507

-

Whome 人机情感交互的先行者2014-08-28 4793

-

海尔先行者692-733AA系列彩电开关电源电路2009-01-21 1670

全部0条评论

快来发表一下你的评论吧 !