上海微系统所在无人系统的多传感融合技术方面取得进展

描述

近日,中国科学院上海微系统与信息技术研究所李嘉茂研究员的研究团队在无人系统视-惯多传感器校准方面取得了重要进展。研究团队通过模拟人体视觉与前庭觉,成功提出一种基于流形传播模型的多传感器校准方法,并在基于视觉惯性里程计(Visual-Inertial Odometry, VIO)的无人车定位导航应用上完成了验证。相关成果以题目为“Fast Extrinsic Calibration for Multiple Inertial Measurement Units in Visual-Inertial System”的学术论文发表在机器人领域顶会ICRA(The 23RD International Conference on Robotics and Automation)上。

类人多感官的多传感融合是智能无人系统感知环境、完成决策的重要手段。其中,通过多传感器校准获取传感器间的外部相对关系,是保障后续多传感数据融合准确、有效的基本前提。多视觉传感器和多惯性传感器(IMU)融合是无人系统自主定位导航应用的主流方案之一,其现有校准方法需要基于精准的传感器运动轨迹,高度依赖外部传感器,并易受到环境条件与观测噪声的影响。

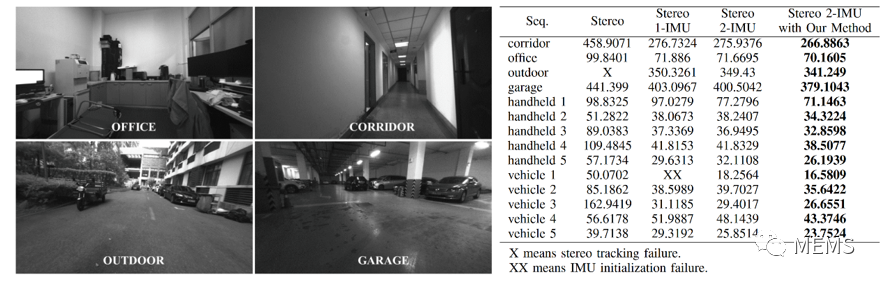

针对以上问题,研究团队提出了流形传播模型校准方法,通过建立两个非线性截断最小二乘问题来分别估计多IMU的相对平移和旋转,利用推导虚拟IMU算法的通用表达在流形上的传播方程,在不依赖外部传感器的条件下,解决了多视觉与多IMU标定的不稳定问题。研究团队将本方法应用于无人车定位导航系统,并在办公室、走廊、室外、车库等真实场景进行了功能验证,速度、准确性和稳健性方面优于SOTA方法。同时,模拟实验表明本方法在仅融合2个IMU预测运动时,其精度可以与9个IMU的效果相媲美。本方法具有良好的可扩展性,支持集成到其他IMU融合算法、VIO和激光雷达惯性里程计(LIO)系统。

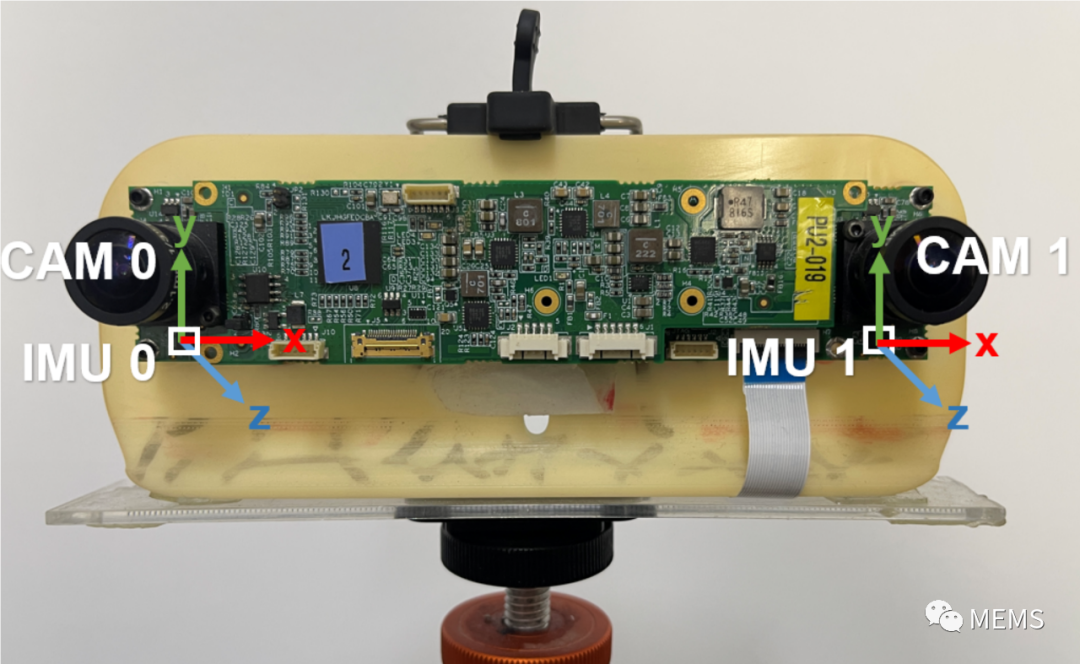

图1:多传感融合原型系统

图2:在多场景视惯定位中基于本方法的双视觉双IMU方案均取得最优性能

上海微系统所于有为工程师为该工作的第一作者,李嘉茂研究员为通讯作者。上述研究工作获得科技部科技创新2030、国家自然科学基金、上海市级重大专项、上海市优秀学术带头人、中科院青促会项目等支持。

-

上海微系统所在太赫兹半导体激光器光注入锁定方面取得进展2026-03-31 132

-

上海光机所在多波长同步皮秒光纤激光器方面取得进展2025-09-22 762

-

上海光机所在全息光刻研究方面取得进展2025-09-19 759

-

上海光机所在激光驱动离子加速方面取得新进展2025-08-06 842

-

上海光机所在基于激光时频同步的精密测量方面取得进展2025-01-08 930

-

中国科学院在薄膜荧光传感器研究方面取得进展,美国为F-22升级新传感器2024-04-26 1560

-

未来已来,多传感器融合感知是自动驾驶破局的关键2024-04-11 2411

-

上海微系统所在硅基磷化铟异质集成片上光源方面取得重要进展2024-03-15 2371

-

上海微系统所在300mm RF-SOI晶圆制造技术方面实现突破2023-10-23 2630

-

上海微系统所:在基于基因序列编辑器的电化学传感器研究方面取得进展2022-10-25 1113

-

怎么实现多传感信息融合的车辆主动防碰撞系统设计?2021-05-11 1518

-

宁波材料所在先进气体传感材料与传感器关键技术方面取得进展2019-01-21 1886

-

深度解析多传感器信息融合技术2018-11-07 3666

-

无人机遥感系统的研究进展与应用前景2016-01-08 1237

全部0条评论

快来发表一下你的评论吧 !