镜头常见光学问题及原理

机器视觉

描述

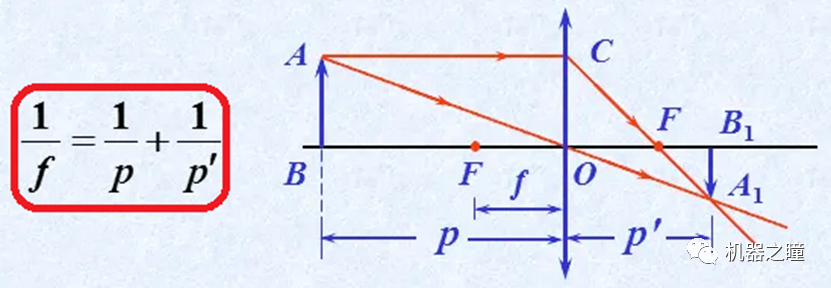

1.变焦与对焦 变焦就是改变镜头的焦距(准确说是像距),以改变拍摄的视角,也就是通常所说的把被摄体拉近或推远。例如18-55mm和70-200mm镜头就是典型的变焦镜头。焦距越长,视角越窄。 对焦通常指调整镜片组和底片(传感器平面)之间的距离,从而使被摄物在CCD/CMOS上成的像清晰。 我们通常说的“调焦”一般指“对焦”。有些人认为定焦镜头不能调焦的说法是错误的。

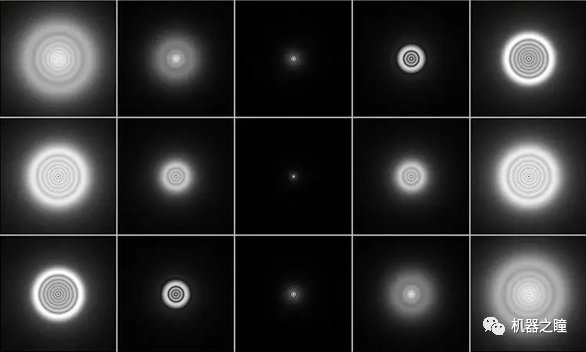

2.光圈与锐度 追求成像的锐利应该是所有镜头的追求。镜头的光圈值一般从F1.2-F32不等,例如F1.8-F16,对于普通的单反镜头来说,通常成像最锐利的光圈值是F5.6或者F8,为什么呢?这涉及到2个概念,一个是球差、一个是衍射。 衍射,超小光圈处影响锐利度的因素。

衍射(diffraction)是指波遇到障碍物时偏离原来直线传播的物理现象。在经典物理学中,波在穿过狭缝、小孔或圆盘之类的障碍物后会发生不同程度的弯散传播。与之相关的概念有爱里斑、瑞利判据等。 球差,大光圈处影响锐利度的因素。

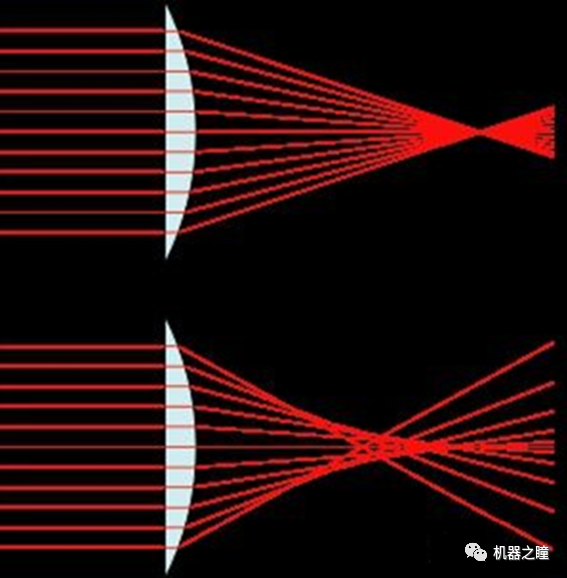

我们通常看到的透镜成像的简化图中,平行光通过透镜以后汇聚于一点,这点叫做焦点,其实真实的情况并非如此,如下图所示。

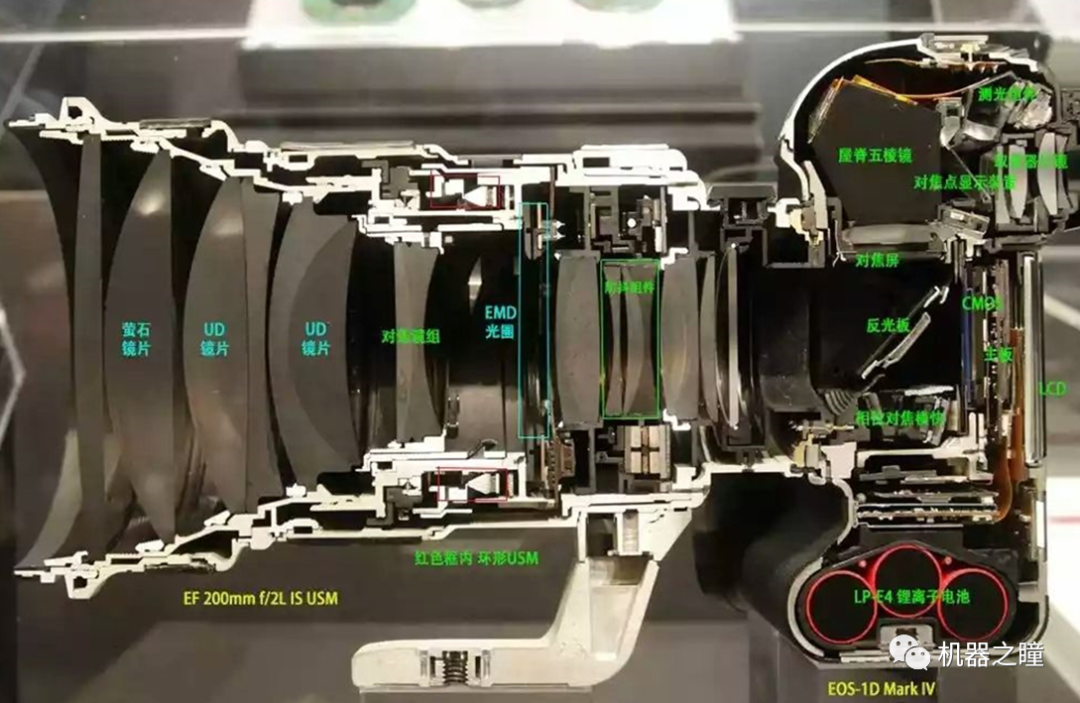

光线既然不能完美汇聚,也就不可能产生锐利的成像。当光圈大(光圈F值小)的时候,透镜接收光的圆面很大,于是光线的汇聚处会非常分散,造成成像不锐利。当光圈缩小的时候,透镜接收光的圆面很小,这时候光线经过透镜以后,汇聚处相对来说更集中一些,这样成像也就更加锐利了。一般来说对焦不会非常准确,光圈小的时候景深更深,也会显得更锐利。 对于实际的镜头来说,镜头内部的镜片是很复杂的,可能有几片甚至十几片镜片,有些镜片的材质还较为昂贵,例如萤石,它们的主要作用其实就是改善镜头的光学素质,校正各种球差、彗差、色散、畸变等等。例如EF 200mm f/2L IS USM镜头如下图所示。

3.微距镜头与远处对焦

其中,p是物距,p’是像距,f是焦距。 以手机拍照举例,你可以对半米远的茶杯对焦,也可以对50米外的高楼对上焦。但是有些定焦微距镜头却不可以,例如它只能对10厘米处的物体对焦,在其他距离上都不能对上焦。从上面的公式可知,当物距(p)很大的时候,1/p接近于0,此时焦距(平行光入射时从透镜光心到光聚集之焦点的距离)约等于像距。也就是说此时焦点和像面(底片)重合。 我们通常认为定焦镜头的焦距不变,但值得注意的是焦距是在平行光入射的情况下定义的。另外一种准确的说法是定焦镜头像距不变、视角不变。 普通定焦镜头可以认为焦距不变。例如50mm F1.8,它的最近对焦距离是450mm,物距比450mm小一点点。根据上面的公式,此时1/p就非常小了,可忽略,此时p’≈f,即焦点落在像面上。可认为焦距基本不变。但是对于佳能“百微”和尼康“105微”这样的微距镜头来说,最大放大比例是1倍,此时对焦距离就很近了,此时相对于焦距来说,1/p就不可以忽略了,这时算出来的实际的透镜焦点到光心的距离就不等于之前的焦距了。对于“百微”和“105微”这样的镜头来说,由于其极特殊的光学结构,既可以在无穷远处合焦,也可以在很近的“不同”位置合焦。这是靠移动镜头内部的多组镜片组实现的。 以单反加装近摄接圈为例,如果是50mm定焦镜头加近摄接圈,那么镜头的合焦距离就是一个确定的距离。如果是18-55mm变焦镜头加近摄接圈,那么镜头的合焦活动范围就是很小的一段距离。 还是看之前的公式如下图所示。

由于强行拉长了法兰距,像距p’必然变大很多。而焦点到光心的距离f基本变化不大,所以像距p会大大较小。假设加了接圈以后,像距p’=2f,那么此时p=2f,也就是只有物距等于2f的时候才能完美合焦。所以有些微距镜头不能在无穷远处对焦,变焦镜头加了接圈以后合焦活动范围有很小的一段距离,而不是固定的距离。(因为变焦镜头的焦距变化范围大一些)

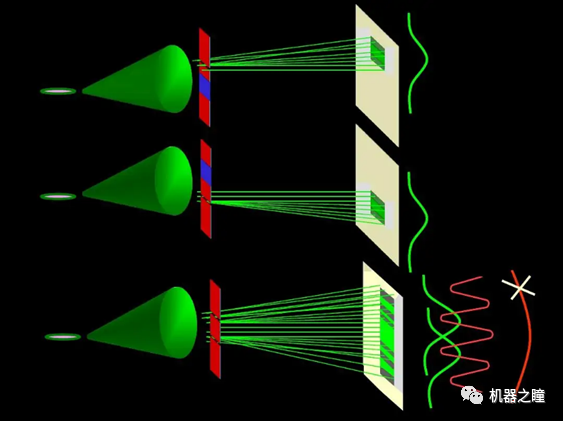

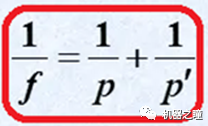

4.无穷共轭镜头与有限共轭镜头 共轭指的是某种互相对应的2个点或者两个元素,像点和物点就是一组共轭点。又涉及到两个概念叫做入瞳和出瞳,在此不展开。 无穷共轭镜头,像点对应的物点在无穷远处(可以理解为很远处),如下图所示。

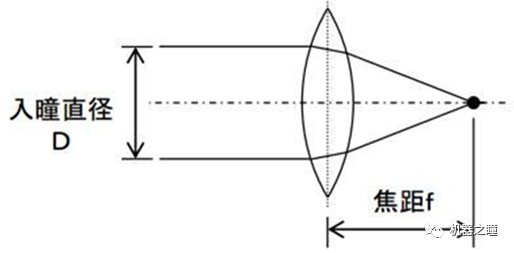

有限共轭镜头,像点对应的物点只能在有限的距离内,如下图所示。

一般来说,手机摄像头、普通镜头都是无穷共轭镜头,而工业微距镜头大多是有限共轭镜头,像“百微”、“105微”这样的奇葩,既可以是无穷共轭镜头,又可以使有限共轭镜头。

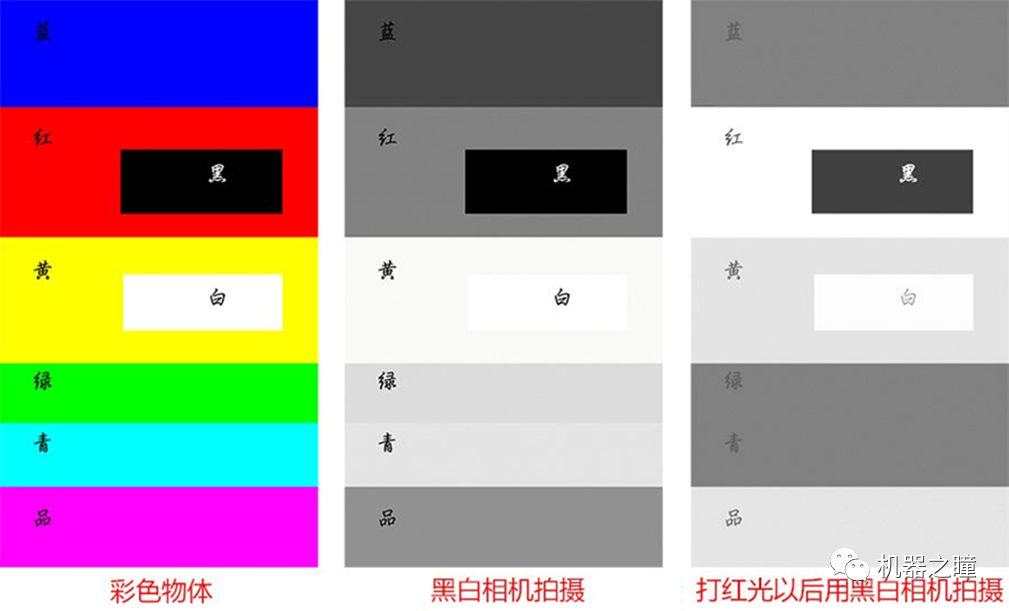

5.红光与蓝光 解像力方面,蓝光由于波长更短,衍射效应更弱,因此刻画细节的能力更强,拍摄微小的物体,蓝光是首选。而红光呢,黑白CCD对红光更敏感,但其实这优势并不大,或许在需要尽量减轻环境光干扰的时候,有一点作用。此外,红光源的优势是价格比蓝光源便宜一些。 拍摄彩色物体方面,很多人认为区分彩色物体一定需要彩色相机,其实不然。对于一幅RGB彩色图,转为有明暗变化的灰度图时,遵循的公式通常是这样的,结果亮度灰阶值=30%红色+59%绿色+11%蓝色。也就是说,不同颜色的物体转为灰色时,亮度是不一样的。并且,当你给物体打某种颜色的光的时候,再用黑白相机拍,得到的灰度图片又不一样,如下图所示。

这里不使用彩色相机的原因是,首先不同相机价格差异因素是一方面,更重要的是,黑白图片的数据量只有彩色图片的1/3,这种差异就会体现在图像处理的速度上。生产速度对于工业生产来说是极为重要的。规律大致可以总结如下,用红色光给彩色物体打光,然后用黑白相机拍摄,物体红色的部分变成亮白色,物体白色部分变成浅灰色,跟红色差异大的颜色则变成暗黑色,黑色还是黑色。 还有一点需要注意的是,红色光源通常要比蓝色光源便宜。红色LED光源制作简单,早就发明了出来,而蓝色LED的研制则晚了许多,2014年的诺贝尔物理学奖授予了3位曾经在蓝光LED研制方面做出卓越成就的科学家,由此可见一般。

6.工业领域与ISO参数 光圈、快门时间、ISO是取得合适曝光的三驾马车,三者互相合作也互相制约。ISO通常取值为100-3200。ISO这个参数在工业机器视觉领域被换了个名字,叫做gain(增益),这个参数一般不用调。 通常ISO越高,相机感应光的能力越强,相应的噪点也越多,画质也越差。对于每一个摄影师来说,绝大多数情况下,他都希望把ISO固定在100,因为这可以获得最纯净的画面,但这几乎是不可能的。因为在暗光环境下,ISO太低,只能强行调大光圈,但是光圈是有限的,因此只能增加快门时间,但是快门时间一长,手持拍摄必然糊片。但是在工业领域一般不存在这个问题(或者说这个问题是次要问题),一是因为工业相机一般不动,曝光时间很长也不会糊片,另外,工业视觉设备光源自带,几乎不存在暗光环境。

7.光源与亮度 首先,光源亮度高,快门时间就能降下来,有可能可以提高采图速度。其次,光源亮度高,可以大大减轻环境杂光的影响。另外,光源亮度高,可以将光圈缩小,而通常缩小光圈可以得到更锐利的画面和更大的景深,这些对于机器视觉系统来说是极为重要的。所以选择光源的时候,光源亮度越高越好。

8.单颗像素质量 单颗像素指的是传感器上的一颗像素,单颗像素质量通常直接和像素颗粒的大小有关。例如有的相机的像素颗粒是5um×5um,而很多手机的像素颗粒大小是1.12um×1.12um,或者1.3um×1.3um,这个数值越大,表明单颗像素质量越好。主要原因是,像素之间存在电讯干扰,像素颗粒越小,那么相当于相邻像素的间距越小,那么越容易产生相互干扰,带来的结果是画质纯净度的下降。

审核编辑:黄飞

-

DLP5531LEQ1EVM投影镜头组可见光学效率是多少?2025-02-18 299

-

关于红外测温光学镜头2012-08-16 5500

-

如何选择镜头2017-01-14 3248

-

常见光电器件有哪些?2021-11-10 2877

-

常见光纤连接器2010-03-15 600

-

光学镜头结构智能化设计系统2011-01-04 1114

-

镜头光学分析2009-06-14 2929

-

深度解析光学镜头2019-02-19 3197

-

关于红外镜头与可见光镜头的异同以及应用分析2019-08-26 15225

-

光学镜头的最新技术变革!2019-11-22 5219

-

光学镜头下游数字安防领域市场应用2023-02-13 1649

-

一文详解光学镜头及摄像模组2024-01-15 13830

-

光学镜头定心调校技术2024-03-15 4530

-

工业镜头光学原理、优势及应用2024-07-15 2241

-

光学测量镜头怎么选?2024-09-03 1454

全部0条评论

快来发表一下你的评论吧 !