如何用3D Occupancy处理遮挡问题下的图像匹配?

描述

1. 写在前面

图像匹配是SLAM和图像检索的核心任务,但是传统的图像匹配很难处理遮挡问题。今天笔者将为大家分享一篇旷视的开源工作Occ2Net,使用3D Occupancy来解决遮挡问题下的图像匹配。

下面一起来阅读一下这项工作~

2. 摘要

图像匹配是各种视觉应用中基本且关键的任务,如同时定位与地图构建( Simultaneous Localization and Mapping,SLAM )和图像检索,这些应用都需要精确的位姿估计。然而,现有的大多数方法忽略了由相机运动和场景结构引起的物体之间的遮挡关系。在本文中,我们提出了一种新的图像匹配方法Occ2Net,该方法使用3D占有率建模遮挡关系,并在遮挡区域中推断匹配点。得益于占有率估计( Occupancy Estimation,OE )模块中编码的归纳偏差,它大大简化了多视图一致3D表示的引导,从而可以集成来自多个视图的信息。它与一个遮挡感知( Occlusion-Aware,OA )模块一起,结合了注意力层和旋转对齐,以实现遮挡点和可见点之间的匹配。我们在真实世界和模拟数据集上评估了我们的方法,并在几个指标上展示了其优于最先进方法的性能,特别是在遮挡场景中。

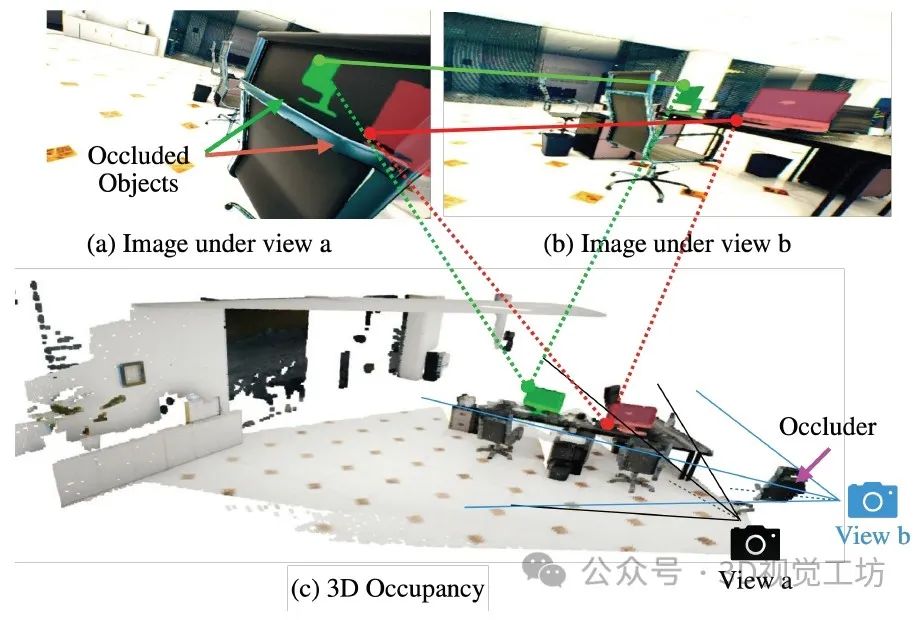

3. 效果展示

先看一下问题描述,( a )和( b )是从不同视点拍摄的图像,而( c )显示了遮挡区域的匹配过程。在( c )中,两个显示器显示绿色和红色的掩模,表示在( b )中可见但在( a )中被遮挡的区域。由于相机运动,两个图像的视差很大。虽然存在大量的重叠区域,但大的视差导致了遮挡,很大程度上减少了可见匹配对的数量。通过使用Occ2Net提取一致的占用特征并在( a )和( b )之间进行匹配,( a )中被遮挡的显示器仍然可以在( b )中进行匹配,从而使Occ2Net具备了在遮挡情况下进行匹配的能力。

4. 具体原理是什么?

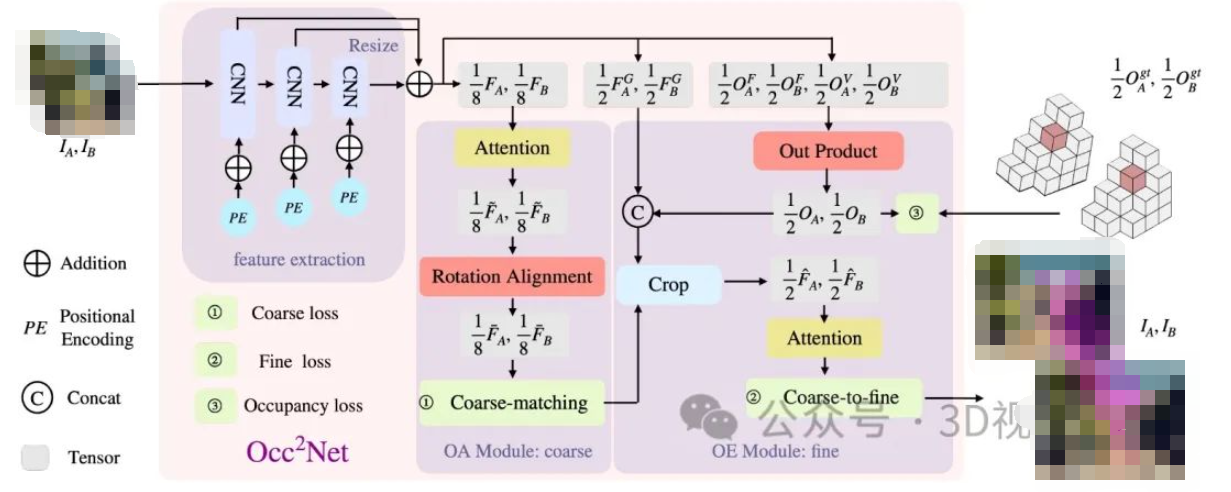

Occ2Net框架,通过隐式地模拟物体-遮挡关系,实现遮挡下的匹配。首先提取特征,然后应用OA模块获得粗匹配块,最后将精细特征与OE模块中的3D占用估计相结合进行精细匹配。

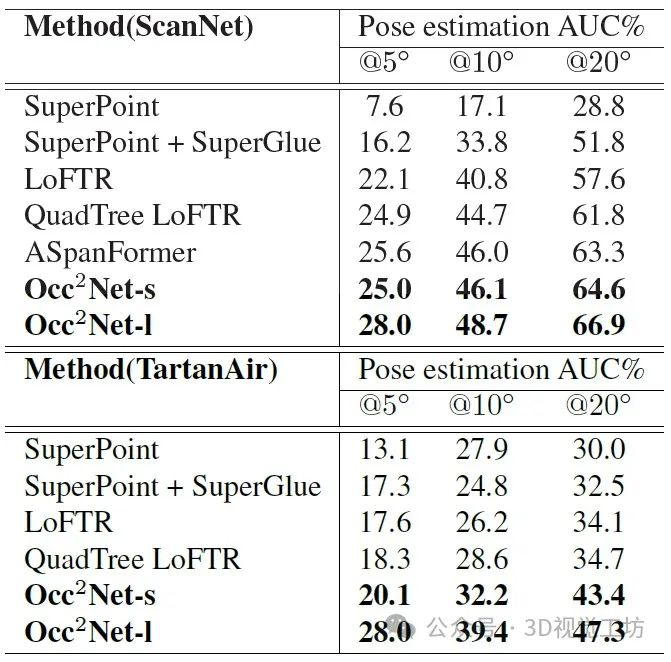

5. 和其他SOTA方法对比如何?

ScanNet、TartanAir-indoor、TartanAir-outdoor的匹配实例。绿色和黄色线条表示正确匹配,红色线条(误差大于10个像素)为错误匹配。

位姿误差的百分比AUC对比,Occ2Net最优。

6. 总结

这篇文章提出了一种遮挡问题下的图像匹配方式,设计了一种网络结构Occ2Net,可以在一定程度上感知遮挡点的存在。Occ2Net使用特征提取来获得多尺度的全局和位置特征,这些特征有助于猜测遮挡信息。OA模块使用了注意力和旋转对齐,这有助于在后期的由粗到精的过程中得到更多正确的匹配对。OE模块使用3D占用估计结合精细特征进行精细匹配。

审核编辑:黄飞

-

3D LED液晶电视设计方案2011-07-11 2958

-

3D图像的速度控制2016-11-30 4048

-

基于Dragonboard 410c平台的机器3D视觉—摄像机标定原理2018-09-28 2718

-

基于ToF的3D活体检测算法研究2021-01-06 3277

-

浩辰3D的「3D打印」你会用吗?3D打印教程2021-05-27 8331

-

3D图像的主流技术有哪几种?2021-05-28 2185

-

3D图像生成算法的原理是什么?2021-06-04 1658

-

基于深度学习和3D图像处理的精密加工件外观缺陷检测系统2022-03-08 28292

-

3D图像引擎,3D图像引擎原理2010-03-26 1687

-

平面人物秒变3D模式,图片中的人物可以从平面中“跑出来”,动起来2018-12-27 13182

-

iPhone 12没有3D屏幕无法显示3D图像?2020-12-04 5252

-

谷歌发明的由2D图像生成3D图像技术解析2020-12-24 5780

-

华为基于AI技术实现3D图像数字服务2021-08-12 6549

-

用于3D扫描的嵌入式图像预处理2022-11-07 598

-

特斯拉的Occupancy Network占用网络如何解决无法识别物体的难题呢?2024-04-16 3868

全部0条评论

快来发表一下你的评论吧 !