浅谈相机的图像分辨率

描述

本文转载自力显智能科技

谈到显微成像系统,常常会用分辨率来评价成像能力的高低,那分辨率到底指的是什么,又怎样计算呢?其实对于一个特定的显微成像系统,分辨率要从两个方面来考虑,一种是光学系统的分辨率—光学衍射极限,另一种就是成像探测器的图像分辨率,两个概念缺一不可,下面将对这两种分辨率及其对成像结果的影响进行详细说明。

1、相机的图像分辨率

我们在购买相机的时候,常常会说这个相机的分辨率是500万,800万,或者4k2k,这里说的分辨率,其实指的是成像探测器的图像分辨率,就是探测器芯片上的总像素数量。

探测器芯片的另一个非常重要的指标就是像元大小,对于sCMOS探测器来说,一个像素的大小通常是在几个um。以科研级荧光显微镜通常使用的Hamamatsu Flash 4.0 sCMOS探测器为例,像素尺寸为6.5um,相机分辨率是2048x2048,如果显微镜的总放大倍数为10倍,那么1um的物经光学系统放大为10um的像,这样的像会由10um/6.5um=1.54个像素来显示,用实际物体来理解,图像中的一个像素点表示的实际距离为650nm,像元尺寸越小,图像分辨率越高。

相机的图像分辨率=2*像素大小/放大倍数,则对上面的例子来说,相机的图像分辨率=2*6.5um/10=1.3um。

2、光学衍射极限

这里简单介绍下什么是“普通荧光显微镜的分辨率”—光学衍射极限(Abbe diffractionlimit)。

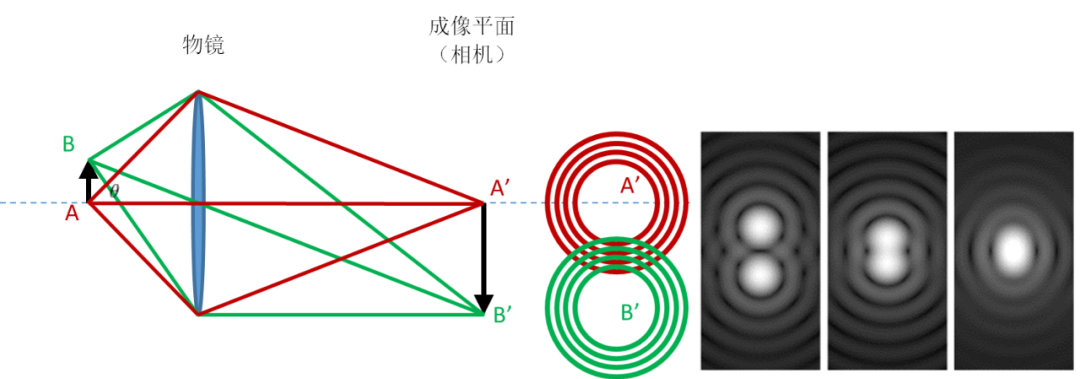

图. 光学衍射极限示意图

如上面的简图所示,黑色箭头表示的物体 AB 经过物镜等之后在相机上成像。由于光的衍射,物体上的点如A、B,在相机上并不是单独的点,而是一个个有一定大小的斑,被称为夫琅禾费衍射斑,如右侧的同心圆所示。根据光学中的瑞利判据,1873 年,德国物理学家恩斯特·阿贝(Ernst Abbe)推算出,显微镜能分辨的物体上两点 A、B 的最小距离 h 为:波长/(2*N.A.)。

这个公式就是光学显微镜的分辨率公式,或称为光学衍射极限。(注意此处的分辨率与通常说的显示器分辨率含义不同)其中,为光的波长,n为物方的折射率,θ为物体与物镜边缘连线和光轴的夹角。 也常称为数值孔径,简写为 NA。

目前常用的高倍物镜NA为 1.49,所以对于可见光,比如波长 500 纳米的绿光,计算得到显微镜的分辨率约为 200 纳米。因此可知,即使再提高物镜的放大倍率,也不能提高显微镜的分辨率。而 200 纳米这个数值也就通常被人称作衍射极限。如上图中(a)(b)(c)所示,当两个点逐渐靠近到一个程度时,我们就很难分辨该光斑是一个点还是两个点叠加在一起了(如图(c)),更别提其空间/立体位置关系了。

3、显微成像系统的分辨率

了解了上面两种分辨率的原理,那已知一个显微成像系统的参数,就可以计算出这个系统的分辨率究竟是多少了。

例如:一台生物显微镜,使用的物镜为放大倍数20倍,N.A.=0.4,光路中没有其他放大,使用的相机为Hamamatsu Flash 4.0 sCMOS,像素尺寸6.5um。探测的荧光波长按550nm计算。

系统的光学分辨率=550nm/(2*0.4)=688nm

系统探测器的图像分辨率=2*6.5um/20=650nm

比较两者,光学分辨率较差,所以对于这台显微成像系统,xy方向分辨率为688nm。

当然,谈到显微成像系统,就离不开对样品的讨论,生物样品特定结构的染色密度同样会对最终的成像分辨率有决定性的影响,这里由于篇幅原因就不对这方面做具体的展开,后续文章中会对染料及染色密度对荧光显微成像系统,特别是超分辨率成像系统的分辨率影响做具体的介绍。

审核编辑:汤梓红

-

超高分辨率相机的设计,分辨率6千万,有没有做相机方面的大神们!2016-11-12 2745

-

DLP4500与相机分辨率2018-06-23 3838

-

超分辨率图像重建方法研究2009-03-14 746

-

基于POCS算法的图像超分辨率重建2010-11-08 967

-

什么是分辨率2009-05-24 1506

-

数码相机图像分辨率2009-12-18 939

-

序列图像超分辨率重建算法研究2012-03-08 1190

-

分辨率有两种:即显示分辨率和图像分辨率2019-11-19 18277

-

如何有效匹配镜头分辨率和相机分辨率?2023-01-07 4429

-

基于事件相机的超分辨率图像恢复2023-03-08 2939

-

工业相机分辨率与精度 工业相机分辨率计算公式2023-03-28 16290

-

相机像素尺寸(像元大小)和成像系统分辨率之间的关系2023-05-10 15059

-

单张图像超分辨率和立体图像超分辨率的相关工作2023-06-27 2309

-

镜头分辨率简述2024-01-15 2289

-

基于CNN的图像超分辨率示例2024-03-11 2131

全部0条评论

快来发表一下你的评论吧 !