全面详解特斯拉的FSD车道算法

汽车电子

描述

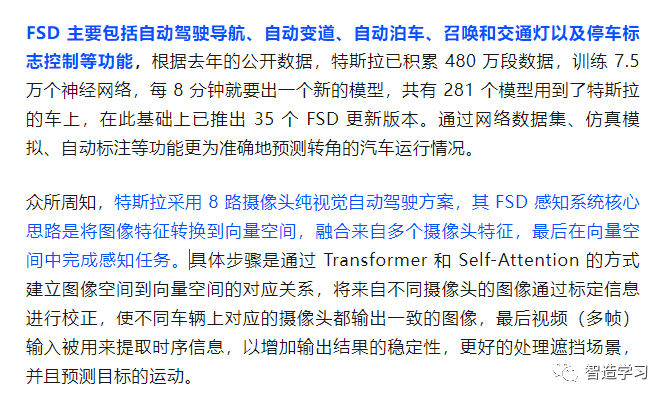

特斯拉一直强调其纯视觉自动驾驶方案的强大,人类感知、认知世界时,有70%-80%的数据,都是通过视觉进行处理的。这至少意味着,在“智能”的产生过程中,视觉占据了极其重要的地位。而特斯拉选择依靠纯视觉技术的持续升级不断向自动驾驶发起挑战,某种程度上是在复现智能的进化过程。

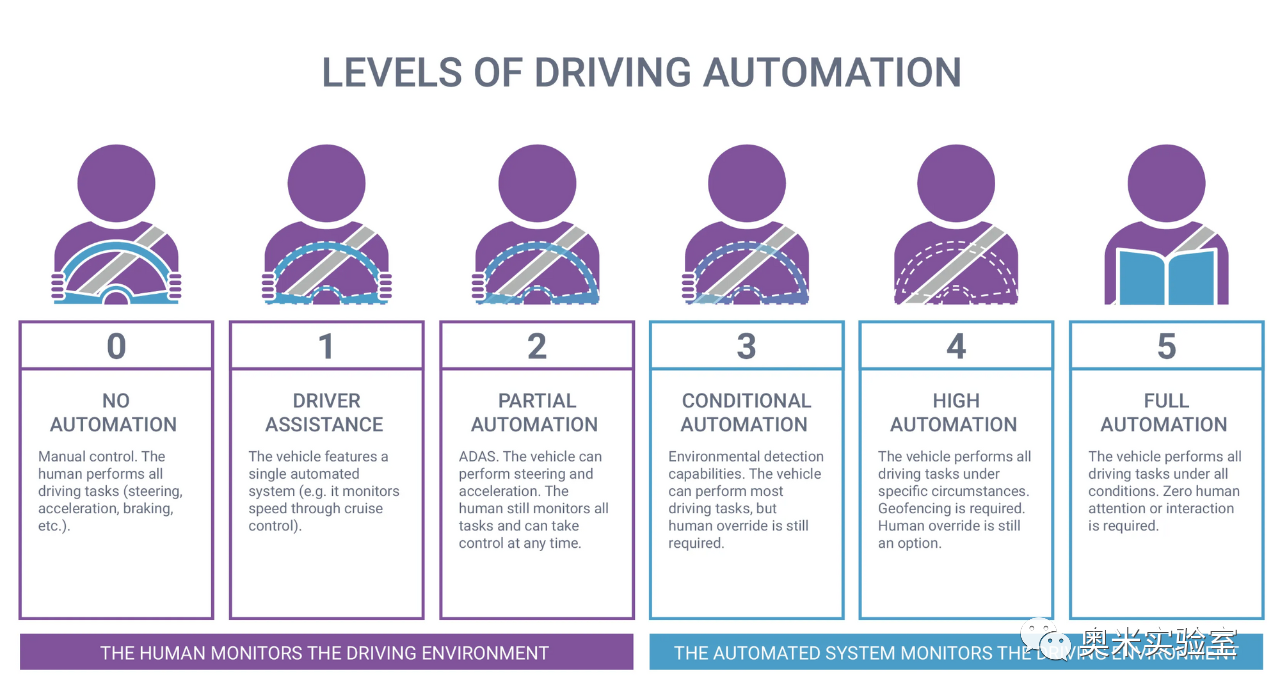

那么,什么是 FSD?

下面视频为您深度解读特斯拉自动驾驶系统(FSD)技术思路与核心原理:

值得关注的是,特斯拉在强大的 FSD 系统中,应用了大量 AI 算法,例如:

路径及运动规划算法:算法植入到终端,终端通过算法感知环境,规划路径,确保安全,平顺前进;

环境感知算法:Occupancy 算法用于可活动空间探测;Lane & Objects 算法用于交通中车道线、物体识别以及运动信息探测;

训练数据设施:超算中心用来支持数据处理,算法训练;

自动标注算法:标注数据,训练环境感知算法识别这类场景或者物体;

环境虚拟仿真:合成制造虚拟场景;

数据引擎:测试软件获取真实场景环境数据,闭环数据引擎,更正标签等。

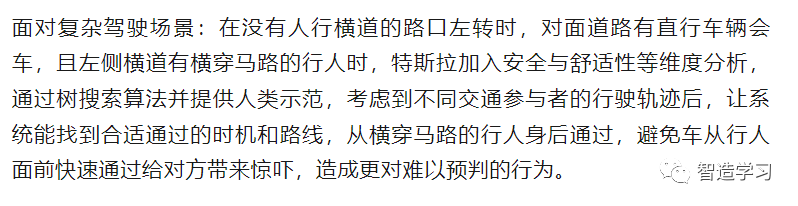

1. 路径以及运动规划算法:应对无保护左转

特斯拉采用的规划模型名为交互搜索(Interaction Search),主要分为五个步骤:

树搜索过程有两个核心模块,即决策树生成和决策树剪枝。

预先构建人类驾驶行为和虚拟驾驶行为库供算法查询的技术思路节省了计算时间,决策树提供了利用各项指标去框定选择最优路径的能力。

2. 环境感知算法:实现交通参与者行为预测

面对复杂驾驶场景:六个方向的交叉路口,每个路口均有较多行驶车辆、静止车辆、行人等交通参与者。即使车上配 8 个摄像头,如遇到其他车遮挡,其预测难度也大大增加。对此,特斯拉公布了一种详细架构 Occupancy Network 用以进行交通参与者(车辆、行人等)行为预测。

(1)Occupancy Network 算法

特斯拉环境感知主要依赖视觉,其提出 Occupancy Networks 算法用来探索可运动 3D 空间,该算法在算力和内存之间取得很好的效率,大概 10ms 可建模完成,此算法已经运行在所有 FSD 的特斯拉上,Occupancy Network 算法工作流如下:

Queryable Outputs:去卷积之后的反向物体有些可能不能完全代表真实的物体的大小,所以特斯拉算法采用查询法去数据库中查询真实世界的结果,进行位置和大小的矫正再进行空间放置。

(2)车道识别算法

传统车道识别算法采用 2D 分割算法,如 RegNet,在高速以及清晰高度结构化的场景应用较好,但在面对复杂的城市应用场景,如繁忙交通中交汇口前车遮挡等无法采集到足够数据时,特斯拉如何在不依赖高精地图仅仅依靠纯时间算法情况下进行对车道信息的精准识别呢?特斯拉给出的答案是:采用神经元算法预测,生成全套车道实例及其相互连接。

特斯拉最新的 FSD 车道算法由以下三个组件组成:

车道识别算法创新性地借鉴语言算法来解决视觉算法问题。

3. 语义分割+自动标注+场景仿真:完成周边车辆预测

面对复杂驾驶场景:如高速公路上行驶,车前摄像头出现雪花盲区或起雾导致其视线无法看清前车时,对车辆自主决策、自动安全驾驶等提出巨大挑战。

(1)语义分割

(2)自动标注

A. 车道线自动标注步骤

B. 场景仿真

即使特斯拉有大量数据和高效的自动化标注工具,也并不意味着它们的数据够用。现实场景的复杂程度超乎想象,比如场景非常罕见以至于几乎收集不到(例:高速上人车狗同时飞奔),或者是场景复杂程度超过自动化工具能力(例:一条街上塞了重重叠叠的几十上百号人)。特斯拉依靠过去收集到的数据,仿真出全新的、自带标注的场景以供训练。

视觉仿真的先决条件是要准备自动标注的真实世界道路信息 和丰富的图形素材库,然后依次执行以下步骤:

特斯拉提出,FSD 核心技术难点之一在于汽车如何去理解复杂的动态驾驶场景,保证自动驾驶的安全性。在座舱内对 BIVMS(Bulit-in Vehicle Intelligent Monitor System)开发过程中,其核心技术难点之一同样在于 BVIMS 如何去理解复杂、多样化的驾驶员动态驾驶场景,以保证其识别的准确性和提醒的合理性,需在面向复杂场景时将技术做深做精,减少误识别、漏识别等情况,打造高性能产品以快速抢占座舱智能化市场。随着座舱内功能的愈发丰富,为了提升用户越来越高的交互体验需求,参考特斯拉 FSD 采用多摄像头纯视觉方案,智能座舱内可同样采用多摄像头方案(DMS,即 Driver-Monitor-System;OMS,即 Occupancy Monitoring System;TOF,即 Time-of-flight),基于多传感器融合方案大大提高座舱算法识别精度,在数据丰富性和精准性上不断提升,开发多模态、3D TOF 应用、AR-HUD(Augmented Reality Head-Up Display)、健康检测等极具创新性的车载产品,此方案也是智能座舱视觉领域后期开发的演进思路和发展趋势。

审核编辑:黄飞

-

特斯拉测试新版FSD,可视化全面加强2021-07-14 7672

-

特斯拉“FSD”正式入华!6.4万元,背刺老车主?2025-02-26 3432

-

关于特斯拉自动驾驶FSD芯片NPU你想知道的都在这2021-06-17 4256

-

特斯拉推送FSD套件最新测试版:车道变窄会自动收起外后视镜2020-11-10 3388

-

特斯拉FSD已实现自动避让行人功能2020-11-30 4762

-

特斯拉FSD路上自动避开塑料袋 网友质疑其安全性2020-12-16 2608

-

特斯拉官方证实正在推进FSD落地中国2023-11-27 2018

-

特斯拉FSD进入中国?假消息!2024-01-11 1556

-

自动驾驶大杀器来了!特斯拉FSD v12已开始正式向用户推送2024-01-24 2082

-

特斯拉正与车企洽谈FSD系统授权事宜2024-04-24 1240

-

马斯克突然访华,特斯拉FSD要落地中国?对国内市场有何影响?2024-05-06 5785

-

特斯拉中国有望推出FSD系统2024-05-30 1468

-

特斯拉FSD V13.2版本正式发布2024-12-03 1742

-

特斯拉正在为FSD套件研发新的停车功能2024-12-12 1132

-

特斯拉中国FSD发布或延后2025-02-19 1278

全部0条评论

快来发表一下你的评论吧 !