复盘与分析:Sora是如何成功的?

描述

本文来自“技术复盘与分析:Sora是如何成功的?”,报告深入分析了Sora的各项能力、采用的技术路线和创新性的工作。我们认为Sora是将之前的研究工作上进行了很好的综合,并在强大的算力、工程能力以及GPT和DALL·E模型技术积累下诞生的。

随着OpenAI将这种具有开创性的技术路径走通,国内模型和应用厂商有望快速迭代出类Sora的视频生成模型和应用产品。

Sora的突破可以概括为以下几点:

➢ 从生成效果看,突破此前视频生成模型的时长限制,能够生成60s时长、分辨率1080p的视频,可用性极高。

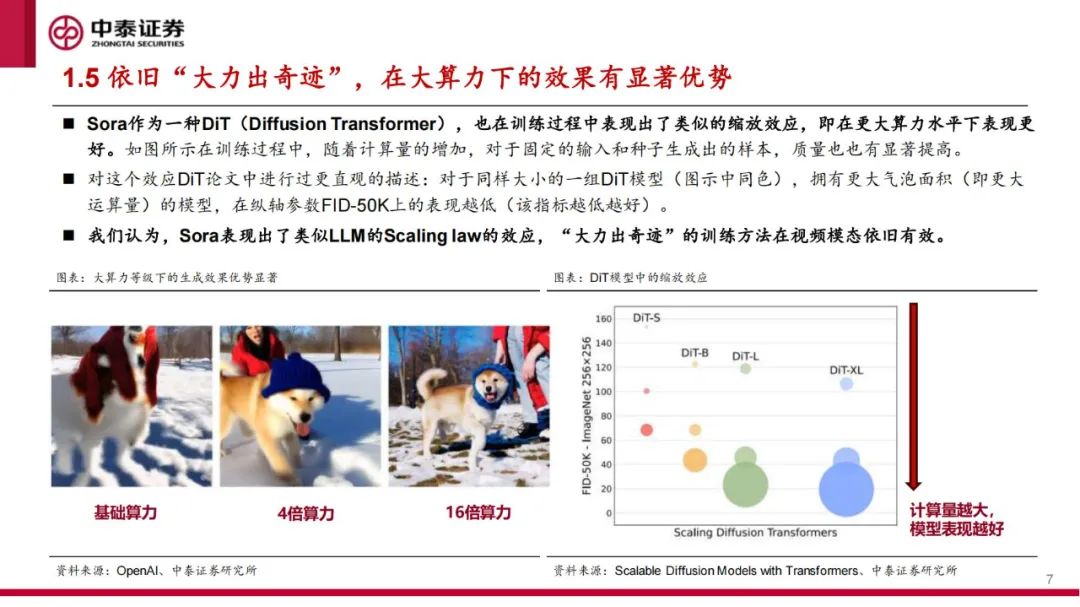

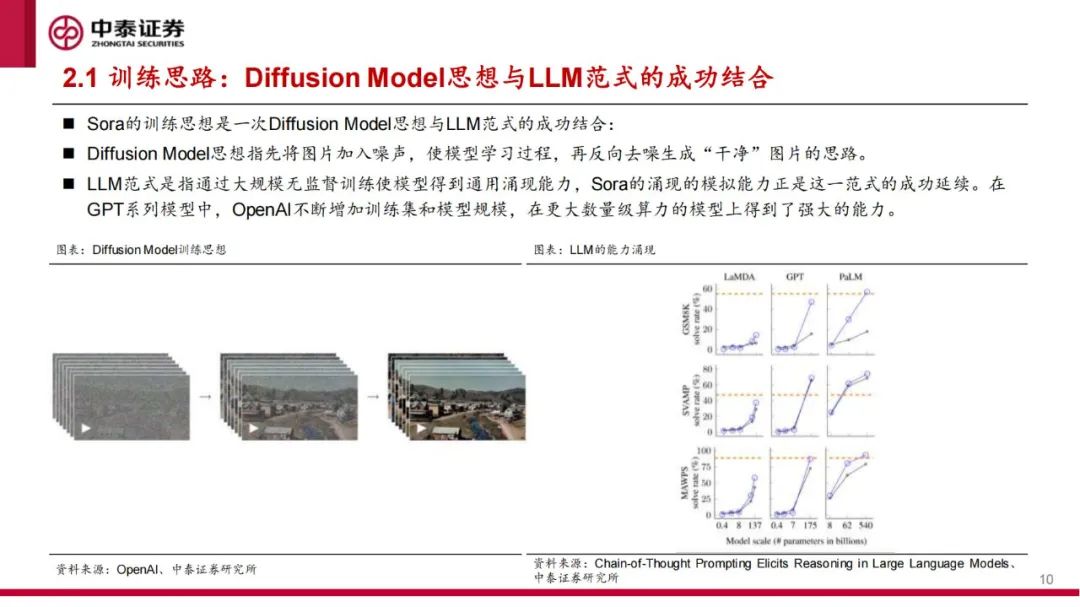

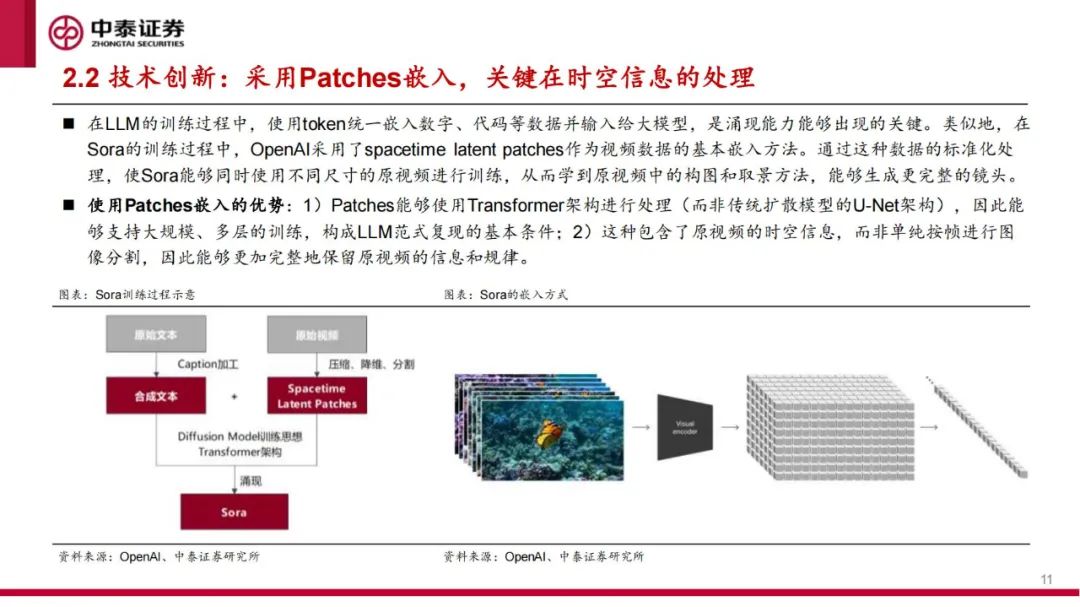

➢ 从技术路线看,依旧遵从LLM范式“大力出奇迹”,通过patches向量化与transformer架构结合,使得训练数据能够使用大小、尺寸、分辨率不同的视频,能够让模型学习到视频的规律乃至世界的规律;使用GPT生成prompt,在训练和推理过程中解决了模态之间的对齐问题,大大提升了生成效果。

➢ 从产业发展看,Sora通用性极强,有望统一视频生成生态;能够进一步赋能与促进下游应用发展,未来有望成为真正的“世界模拟器” 。

Sora的诞生无异是产业的里程碑,以其为代表的“多模型协同”方式是接近AGI的可行道路。与Gemini这样的多模态模型不同,Sora的核心能力依旧在视频生成领域,且在推理时需要调用GPT的能力重述prompt。这种方式可能不如Gemini符合直觉,但效果非常显著,大大加速了产业走向AGI的过程。

Sora代表LLM的通用和涌现范式在视频领域的成功复现,因此算力依旧是模型与应用厂商布局的关键。通过巧妙的patches嵌入方法,Sora能够运用高效的Transformer架构在海量的视频上进行训练,因此也涌现了模拟现实世界的能力。在其他技术路径的模型获得更好的效果之前,这种“大力出奇迹”的训练方式将依旧是产业的主流,算力需求将持续迎来更大的爆发。

Sora可能成为视频生成领域的Base Model,模型层的竞争格局可能走向收敛。相比其他轻应用,Sora的生成时长更长、质量更高,能够完全替代这些轻应用。因此在多数场景下,Sora都能取代其他的生成模型和应用,最终使视频模型格局走向收敛。

-

《合宙的第一个10年》故事连载04:高质量的复盘是成功之父2024-03-12 1203

-

sora模型怎么使用 sora模型对现实的影响2024-02-22 1930

-

sora系列是哪个公司的 sora视频怎么用2024-02-21 6810

-

Sora到底懂不懂物理世界? Sora开启更多可能2024-02-20 1314

-

什么是SORA?跟传统的无线通讯系统有什么不同?2019-08-02 2827

-

信号处理的复频域分析方法推荐2017-11-25 21314

-

连续系统的复频域分析2009-10-04 1409

全部0条评论

快来发表一下你的评论吧 !