常用的RGB-D SLAM解决方案

描述

目前室内RGB-D SLAM的sota方法有哪些呢?

由于室内场景的稠密三维重建是一个非常火热的研究领域了,到目前为止出现了许许多多好的研究工作,恕能力和时间的限制,不能进行一一介绍,所以对目前一些比较常用的RGB-D SLAM解决方案进行介绍。

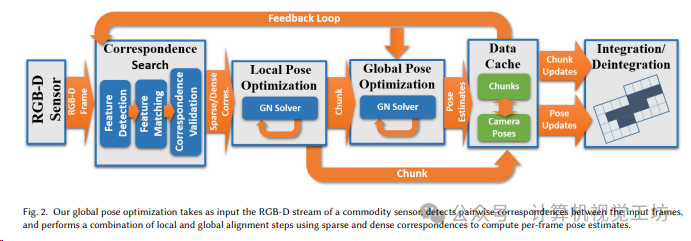

1.BundleFusion

BundleFusion是一种稠密的实时室内场景三维重建算法框架。输入为RGB-D相机采集的并且是对齐好的RGB图像和深度图的数据流。输出为重建好的稠密三维场景模型。

整个算法流程如下图所示:

其优点在于重建效果在所有RGB-D SLAM中靠前,支持在GPU上实时鲁棒跟踪,可以在跟踪失败时移动到重建成功的地方进行重定位,匹配上后继续跟踪。

但是缺点在于由于成像传感器存在噪音,稀疏关键点匹配可能产生小的局部误匹配。这些误匹配可能会在全局优化中传播,导致误差累积。实际重建时效果和所使用深度相机的性能、待重建场景的纹理丰富程度关系很大。

论文获取地址:http://arxiv.org/pdf/1604.01093.pdf

项目地址:https://graphics.stanford.edu/projects/bundlefusion/

源码获取地址:https://github.com/niessner/BundleFusion

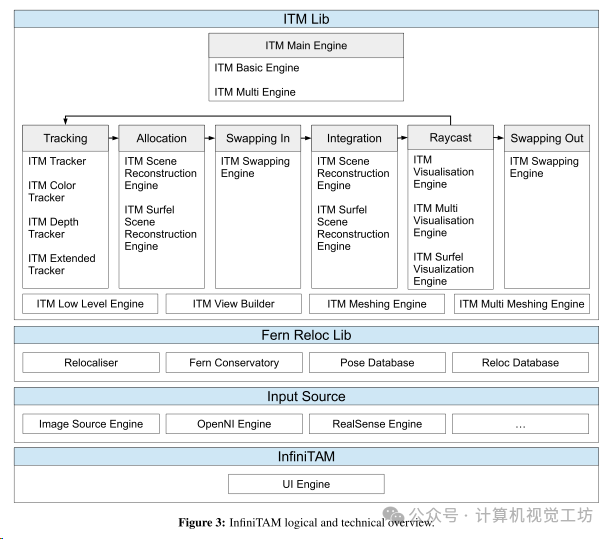

2.InfiniTAM

InfiniTAM是牛津大学于2016年发表的稠密SLAM方案,目前已经发展到了v3版本,该方案基于KinectFusion和体素块哈希表发展而来。首先,InfiniTAM方案在建图部分利用TSDF模型(截断符号距离场)进行建模,只是在建模的时候,不是对整个空间都划分等大小的网格,而是只在场景表面的周围划分网格,且只为待重建的表面上的体素块分配显存,并使用哈希表这一结构来管理GPU对体素块的内存分配和数据访问。通过这样的方法,InfiniTAM 大大减小了稠密建图对 GPU 的内存消耗,提升了算法效率。

算法流程如下图所示:

项目地址:https://www.robots.ox.ac.uk/~victor/infinitam/index.html

代码获取地址:https://github.com/victorprad/InfiniTAM

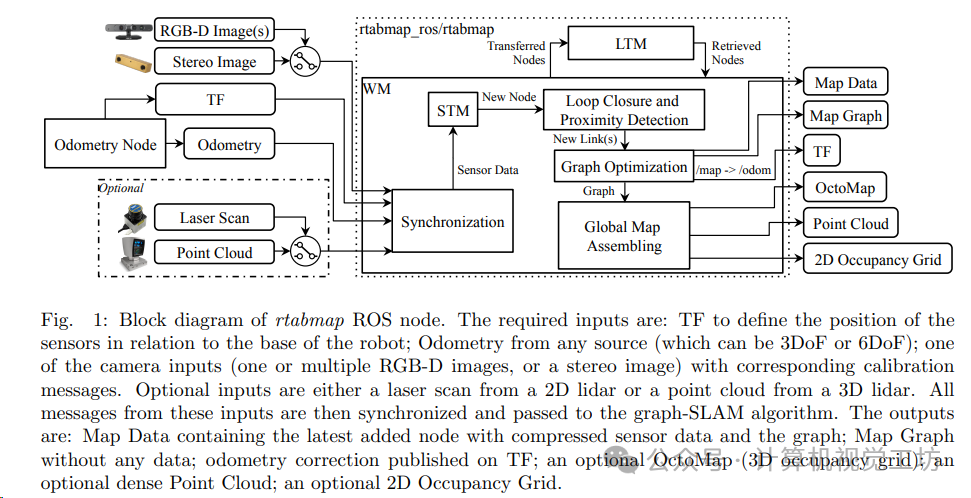

3.RTAB-Map

RTAB-Map(基于外观的实时映射)是一种基于RGB-D、立体和激光雷达的SLAM算法框架,它以基于外观的增量闭环检测为基础。闭环检测使用词袋法来确定新图像来自先前位置或新位置的可能性。当闭环检测假设被接受时,一个新的约束将被添加到地图的图形中,然后图形优化器将地图中的误差最小化。RTAB-Map可单独与手持Kinect、立体摄像头或3D激光雷达配合使用,用于6DoF地图绘制;也可与配备激光测距仪的机器人配合使用,用于3DoF地图绘制。

算法流程如下图所示:

其优点在于定位精度很准,支持视觉、激光传感器,支持跨平台、ROS,在线处理

缺点在于鲁棒性不是很好,如果建图时间和重定位时间间隔得比较久,或者光线变化都很明显的话,重定位会失败。而且点云网格化用possion重建,不是主流的TSDF,速度会慢。

项目地址:https://introlab.github.io/rtabmap/

代码获取地址:https://github.com/introlab/rtabmap

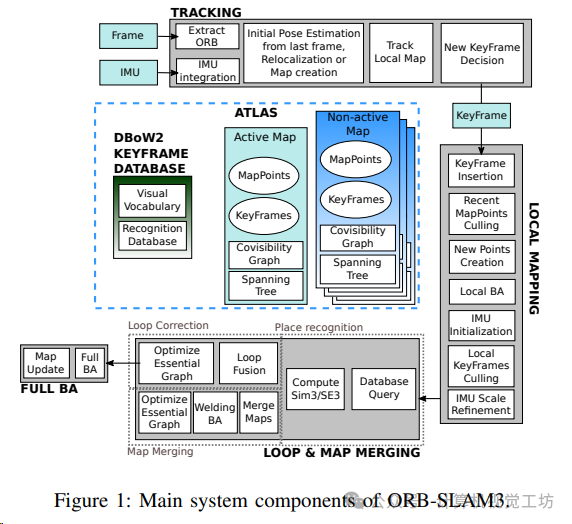

4.ORB-SLAM3

在前作ORB-SLAM2的基础上,大佬于2020年7月开源了ORB-SLAM3的论文和源码。ORB-SLAM3支持的设备和功能更多,支持单目、双目、RGB-D相机,针孔、鱼眼,视觉惯性里程计,多地图等,几乎覆盖了视觉SLAM各个分支。总体来说,ORB-SLAM3基本框架、代码结构都是ORB-SLAM2的延伸,但是加入了很多新的方法,实现了更好的效果。

主要系统架构如下图所示:

论文获取地址:https://arxiv.org/pdf/2007.11898.pdf

审核编辑:黄飞

-

动态环境中基于神经隐式表示的RGB-D SLAM2024-01-17 1892

-

RGB接口静电放电防护方案2017-04-21 4732

-

如何去开发一款基于RGB-D相机与机械臂的三维重建无序抓取系统2021-09-08 2237

-

基于RGB-D图像物体识别方法2017-12-07 1229

-

RGB-D图像是什么2020-11-01 20217

-

结合背景与前景的RGB-D图像显著性检测模型2021-04-13 1503

-

基于UWB、里程计和RGB-D融合的室内定位方法2021-04-25 1326

-

用于SLAM的神经隐含可扩展编码2023-01-30 1571

-

用于快速高保真RGB-D表面重建的神经特征网格优化的GO-Surf2023-03-17 1515

-

基于RGB-D相机的三维重建和传统SFM和SLAM算法有什么区别?2023-03-23 2131

-

用于神经场SLAM的矢量化对象建图2023-06-15 1831

-

瞄准AGV/AMR领域-维感科技发布高性价比RGB-D ToF相机DS86/872023-06-16 1471

-

一个动态环境下的实时语义RGB-D SLAM系统2023-08-25 1710

-

一种基于RGB-D图像序列的协同隐式神经同步定位与建图(SLAM)系统2023-11-29 1788

-

一种适用于动态环境的实时RGB-D SLAM系统2025-07-04 1539

全部0条评论

快来发表一下你的评论吧 !