大语言模型(LLM)快速理解

描述

自2022年,ChatGPT发布之后,大语言模型(Large Language Model),简称LLM掀起了一波狂潮。作为学习理解LLM的开始,先来整体理解一下大语言模型。

一、发展历史

大语言模型的发展历史可以追溯到早期的语言模型和机器翻译系统,但其真正的起点可以说是随着深度学习技术的兴起而开始。

1.1 统计语言模型

在深度学习技术出现之前,语言模型主要基于传统的统计方法,也称为统计语言模型(SLM)。

SLMs是基于统计语言方法开始,基本思想是基于马尔可夫假设建立词预测模型,如根据最近的上下文预测下一个词。具有固定上下文长度n的SLM也称为n—gram语言模型。

然而这些模型虽然简单,但在处理长文本序列时存在着词汇稀疏性和上下文理解能力有限等问题。

1.2 神经语言模型

随着神经网络技术的发展,Bengio等人于2003年提出了神经语言模型,将语言模型建模问题转化为了一个神经网络的学习问题。

循环神经网络(RNN)和长短期记忆网络(LSTM)的提出进一步增强了神经语言模型对文本序列的建模能力。这些模型能够捕捉到文本序列中的长程依赖关系,从而提高了语言模型的性能。

2013年,Google提出了Word2Vec模型,通过词嵌入(Word Embedding)的方式将单词映射到连续的向量空间中,提高了语言模型对单词语义的理解能力。

2017年,谷歌提出了Transformer模型,该模型通过自注意力机制(Self-Attention)实现了并行计算,大大提高了模型的训练速度。

1.3 预训练语言模型

2018年,OpenAI发布了第一个版本的GPT模型,利用Transformer结构进行预训练,这是首个成功利用大规模无监督学习方法来预训练通用语言表示的模型。

2018年,Google提出了BERT模型,与GPT的区别是GPT采用了单向的自回归方式进行预训练,而BERT通过MLM和NSP实现双向上下文建模。使得预训练语言模型的性能得到了进一步的提升。

随后就激发了后续一系列的预训练模型的发展,如XLNet、RoBERTTa、T5、 GPT-2、GPT-3、GPT 3.5、GPT-4 等等。而大语言模型也是在此过程中被定义下来的。

二、什么是大语言模型

2.1 定义

从大语言模型字面意思来理解,“语言”和“模型”很好理解,就是代表着在自然语言处理上的AI模型。而这个大指的是神经网络很大,包括模型的参数数量、训练数据量、计算资源等。

参数数量

大语言模型通常含有数十亿到数千亿个参数,使得模型能够有更强的语言理解、推理和生成能力。

如果只通过 GPT(生成式预训练 Transformer)模型的演进规模来看:

2018年发布的GPT-1包含 1.17 亿个参数,9.85 亿个单词。2019年发布的GPT-2包含15亿个参数。2020年发布的GPT-3包含1750亿个参数。ChatGPT 就是基于这个模型。2023年发布的GPT-4据爆料它可能包含1.8万亿个参数

训练数据训练大语言模型通常需要大规模的文本语料库。这些语料库可以包括来自互联网、书籍、新闻等各种来源的文本数据,从而确保模型能够学习到丰富和多样化的语言知识。如GPT-3,它是在混合数据集上进行训练的;PaLM使用了一个有社交媒体对话、过滤后的网页、书籍、Github、多语言维基百科和新闻组成的预训练数据集。计算资源训练大型语言模型需要大量的计算资源,包括高性能的计算机集群、大容量的存储设备以及高速的网络连接。英伟达价格高昂但依然一卡难求的高性能GPU H100,长期霸占着LLM领域的热门话题,可以说,英伟达垄断了目前的AI算力市场。马斯克甚至戏言:GPU现在比drug还紧俏。

2.2 大语言模型训练方式

现有的神经网络在进行训练时,一般基于反向传播算法(BP算法),先对网络中的参数进行随机初始化,再利用随机梯度下降(SGD)等优化算法不断优化模型参数。

大语言模型的训练通常采用两阶段方法:预训练(pre-training)和微调(fine-tuning)预训练(Pre-training):

- 在预训练阶段,模型使用大规模无监督的文本数据进行训练,学习文本数据中的语言表示。

- 通常采用自监督学习方法,即使用文本数据自身作为标签来训练模型。

训练过程中,模型通过最小化损失函数来优化参数,以使得模型能够更好地表示文本中的语义和语法信息。

微调(Fine-tuning):

- 在预训练完成后,可以将预训练好的模型参数应用于特定的下游任务,如文本生成、文本分类、情感分析等。

- 在微调阶段,通常使用带标签的数据集对模型进行进一步训练,以适应特定任务的需求。微调可以在预训练模型的顶部添加一个或多个额外的层,并使用标签数据对这些层进行训练。

微调的目标是调整模型参数,使得模型能够更好地适应特定任务的特征和标签,从而提高任务性能。

在微调阶段,模型在与目标任务或领域相关的更具体、更小的数据集上进一步训练。这有助于模型微调其理解,并适应任务的特殊要求。

三、预训练

3.1 数据收集及处理

3.1.1 数据来源

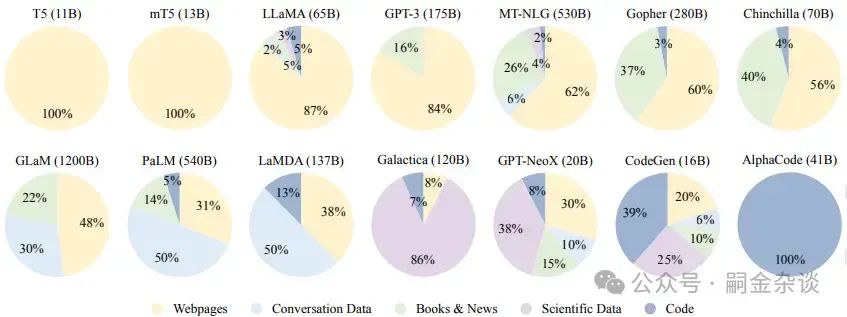

无论是怎样的模型,数据的质量都是相当重要的。现有的大语言模型主要混合各种公共文本数据集作为预训练语料库。如下为一些代表性模型的预训练数据来源的分布情况。 语料库的来源可以广义分为通用文本数据和专用文本数据。通用指的就是如网页、书籍和对话文本等广泛可获取的,可以增强模型的泛化能力;专用文本数据就是在想让模型更加专注某一专业领域时所用的,如科学数据、代码等。如上图中的模型中,就大部分都是使用了通用的预训练数据。

语料库的来源可以广义分为通用文本数据和专用文本数据。通用指的就是如网页、书籍和对话文本等广泛可获取的,可以增强模型的泛化能力;专用文本数据就是在想让模型更加专注某一专业领域时所用的,如科学数据、代码等。如上图中的模型中,就大部分都是使用了通用的预训练数据。

3.1.2 数据预处理

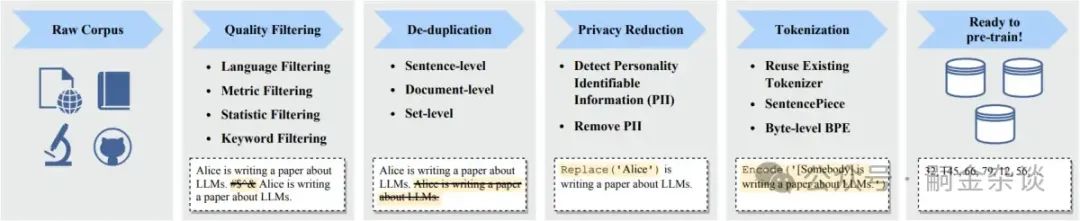

收集数据之后,由于不确定性,所以需要对数据进行预处理,尤其是噪声、荣誉、无关或有害的数据。预处理过程如下: (1) 质量过滤(Quality Filtering)删除低质量数据,常采用基于分类器和基于启发式两种方法。分类器就是使用用高质量数据训练好的二分类的模型来对数据进行分类,不过可能会删除方言、口语和社会语言的高质量文本。基于启发式就是设计一组精心设计的规则来消除低质量文本,如基于语言、生成文本的评估度量、统计特征、关键词等。

(1) 质量过滤(Quality Filtering)删除低质量数据,常采用基于分类器和基于启发式两种方法。分类器就是使用用高质量数据训练好的二分类的模型来对数据进行分类,不过可能会删除方言、口语和社会语言的高质量文本。基于启发式就是设计一组精心设计的规则来消除低质量文本,如基于语言、生成文本的评估度量、统计特征、关键词等。

(2)去重(De-duplication)

重复数据会降低语言模型的多样性,所以需要进行去重处理。

从数据颗粒上来说,可以分为在句子级、文档级和数据集级等进行去重;(3)隐私去除(Privary Reduction)如涉及敏感个人信息的隐私内容,也是需要去除的,很简单有效的就是用基于如姓名、地址、电话号码等关键词的方法。(4)分词(Tokenization)非常关键的步骤,将原始文本分割成词序列。

3.2 架构

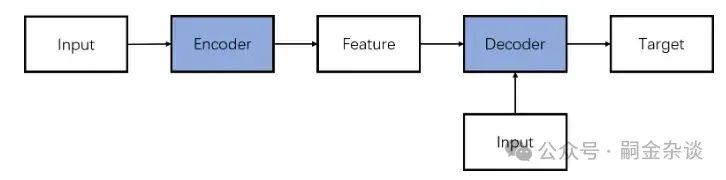

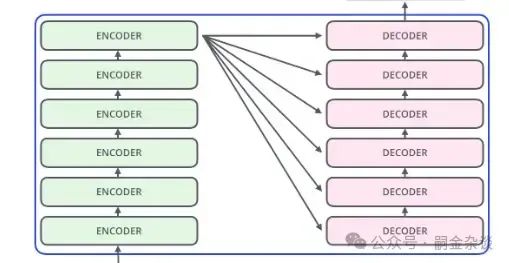

3.2.1 编码器-解码器架构(Encoder-Decoder)

如传统Transformer 模型就是建立在此结构上。它使用了6层的Encoder和Decoder

如传统Transformer 模型就是建立在此结构上。它使用了6层的Encoder和Decoder

3.2.2 因果编码器架构(Causal decoder)

这时当前主流使用的,采用单向注意力掩码,以确保每个输入标记只能关注过去的标记和它本身。输入输出标记通过解码器以相同的方式处理。典型的模型有 GPT1/23, OPT, BLOOM, Gopher。

3.2.3 前缀解码器架构(Prefix decoder)

修正了因果解码器的掩码机制,以使其能够对前缀标记执行双向注意力,并仅对生成的标记执行单向注意力。

这样与编码器-解码器架构类似,前缀解码器可以双向编码前缀序列并自回归地逐个预测输出标记,其中在编码和解码过程中共享相同的参数。总的来说,Encoder-Decoder适用于序列到序列的任务,Causal Decoder适用于需要生成自回归序列的任务,而Prefix Decoder适用于需要根据特定前缀生成序列的任务。

3.3 模型训练

在数据处理好,模型搭建好之后,就要开始对模型进行训练。

四、微调和强化学习

在预训练后,大语言模型可以获得解决各种任务的通用能力。然而,还可以通过特定目标进一步调整,也就是微调(Instruction Tuning)

4.1 指令微调

通过在特定的指令性任务数据集上进行训练,提高模型对于指令类输入的理解和响应。指令的意思,举个例子,对聊天机器人的指令,需要包括如“今天天气如何”和对应的回答,供模型学习。也就是说需要包含明确指令的数据集,一个指令需要包括一个任务描述、一个输入输出对以及少量实例(可选)。常用的指令实例格式化方法有格式化已有的数据集还有格式化人类需求。指令微调对模型的性能改进和任务泛化能够起到很好的作用

4.2 对齐微调

大语言模型有时可能表现出意外的行为,例如制造虚假信息、追求不准确的目标,以及产生有害的、误导性的和偏见性的表达。为了避免这些意外行为,研究提出了人类对齐,使大语言模型行为能够符合人类的期望也就是对齐微调。

在预训练阶段使用的训练语料库是没有对模型的主观定性评估的。所以可以在使用人类反馈的数据进行微调,这个过程称为强化学。

五、应用

大语言模型作为具有广泛应用的变革工具而受到重视。

文本生成:这些模型具有理解上下文、含义和语言的微妙复杂性的固有能力。因此,他们可以生成连贯且上下文相关的文本。

问答与信息检索:大语言模型在问答和信息检索领域正在快速发展。他们理解人类语言的卓越能力使他们能够从庞大的数据存储库中提取相关细节。

情感分析与意见挖掘:了解人类的情感和观点在不同的环境中都具有巨大的意义,从塑造品牌认知到进行市场分析。像在社交媒体监控和品牌认知分析领域的应用。

- 辅助代码生成:如GitHub Copilot、通义灵码

本文来源:嗣金杂谈

-

小白学大模型:从零实现 LLM语言模型2025-04-30 1487

-

无法在OVMS上运行来自Meta的大型语言模型 (LLM),为什么?2025-03-05 339

-

什么是LLM?LLM在自然语言处理中的应用2024-11-19 5109

-

使用LLM进行自然语言处理的优缺点2024-11-08 4463

-

新品|LLM Module,离线大语言模型模块2024-11-02 1962

-

理解LLM中的模型量化2024-10-25 1466

-

LLM模型的应用领域2024-07-09 2386

-

LLM之外的性价比之选,小语言模型2024-06-03 3858

-

2023年大语言模型(LLM)全面调研:原理、进展、领跑者、挑战、趋势2024-01-03 2709

-

从原理到代码理解语言模型训练和推理,通俗易懂,快速修炼LLM2023-09-19 4563

-

基于Transformer的大型语言模型(LLM)的内部机制2023-06-25 2701

-

大型语言模型(LLM)的自定义训练:包含代码示例的详细指南2023-06-12 3854

全部0条评论

快来发表一下你的评论吧 !