OpenAI发布o1大模型,数理化水平比肩人类博士,国产云端推理芯片的新蓝海?

制造/封装

描述

电子发烧友网报道(文/吴子鹏)9月12日晚,OpenAI正式对外发布一款名为o1的新模型。OpenAI o1的内部代号为“草莓”,具备超强的逻辑推理能力。和传统大模型不同,OpenAI o1会花更多时间思考后再做出回答,而传统大模型是直接给出回答,但往往这个回答并不准确。

OpenAI介绍称,OpenAI o1模型解决了很多传统模型,包括目前最强大模型OpenAI GPT-4o无法解决的复杂问题,模型的思维模型更加接近人类。在测试中,OpenAI o1的下一个更新模型在物理、化学和生物等具有挑战性的基准任务上,表现已经达到了人类博士生的水平。

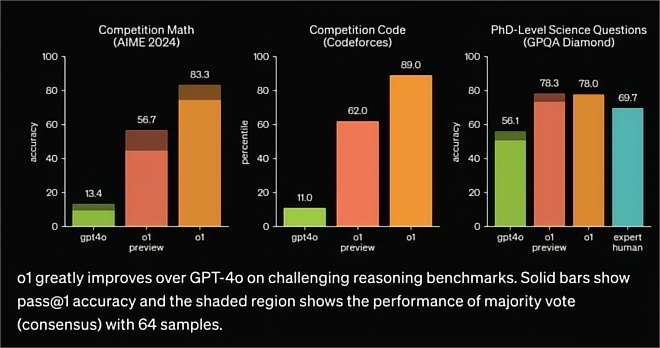

比如,在国际数学奥林匹克(IMO)资格考试中,GPT-4o平均解答率为13%,OpenAI o1将这成绩提升到了83%。

图源:OpenAI

OpenAI强调,OpenAI o1并非旨在取代GPT-4,而是对其的补充,代表着向其更广泛的类人人工智能目标迈出的坚定一步。当然,OpenAI o1更强的能力也意味着更昂贵的成本,OpenAI总结o1的特点就是:更大、更强、更慢、更贵。比如,通过API使用o1预览版,输入每百万token要收费15美元,与之相比GPT-4o的价格为5美元;输出每百万token要收费60美元,与之相比GPT-4o的价格为15美元。

作为补充类型的模型,OpenAI o1的发布让推理芯片在云端大模型里面扮演了更加重要的角色,相关芯片也迎来了更大的产业机遇。

注重推理的OpenAI o1

根据OpenAI的介绍,o1是首个经过强化学习训练的模型,在输出回答之前,会产生一个很长的思维链,以此增强模型的能力。OpenAI将其定义为创新的“思维链”(chain of thought)模式,采用了大规模强化学习算法,可以帮助模型在思考的过程中识别并纠正错误,将复杂问题分解成更简单的部分,并在必要时尝试不同的策略。

对此,OpenAI研究负责人杰里・特沃雷克(Jerry Tworek)表示,OpenAI为o1模型设计了全新的优化算法和专门为其定制的新训练数据集,“思维链”可以类似于人类通过逐步解决问题的方式处理问题,能够显著减少模型幻觉。

所谓的大模型幻觉是指在深度学习领域中,尤其是涉及大型神经网络时,模型展现出在理论上不应具备的性能或能力。这种现象可能导致误导性的结果,表现为在训练数据上过度拟合,使得模型在未曾见过的数据上表现异常。这种过度拟合可能是由于模型的复杂性和训练数据的不足导致的,形成了一种虚假的表现,行业人士将其描述为幻觉。

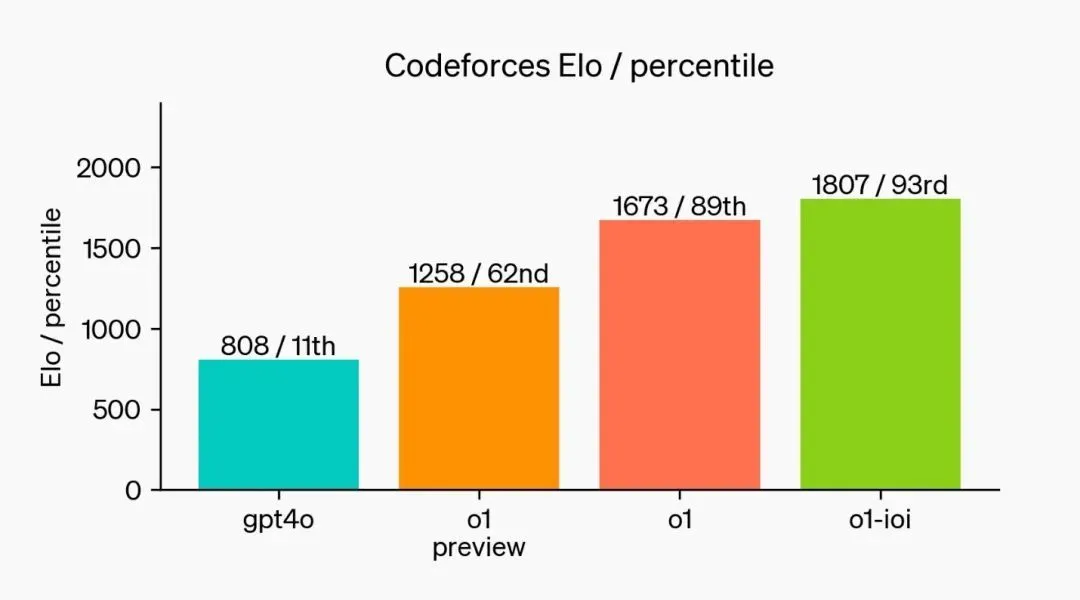

也就是说,OpenAI o1能够经过思考之后,给出更加精准的答案。正如上文提到的,OpenAI o1在数理化生等领域展示了人类博士水平的能力。在美国数学奥林匹克(AIME)的资格赛中位列美国前500名;在国际奥林匹克数学竞赛(IMO)中解决了83%的问题;在物理、生物和化学问题的基准测试(GPQA)上超越了人类博士水平的准确率;在Codeforces编程比赛中,新模型Elo等级为1807,表现优于93%的竞争者。在实际应用中,医疗保健研究人员可以使用o1为细胞测序数据添加注释,物理学家可以使用o1生成量子光学所需的复杂数学公式,等等。

图源:OpenAI

o1系列包含三款模型:OpenAI o1、OpenAI o1-preview和OpenAI o1-mini。其中,o1-preview是o1模型的预览版,这个版本更注重深度推理处理,每周限制使用30条消息;而o1-mini则是o1系列中的小尺寸版,这个版本更高效、划算,适用于编码任务,价格比o1-preview便宜80%,每周限制使用50条消息;OpenAI o1目前暂不对外开放。

OpenAI o1的发布也透露了后续GPT-5的升级方向。OpenAI首席技术官米拉·穆拉蒂(Mira Murati)指出,“GPT-5预计将融合本次展示的推理技术。我们有两个发展方向,一个是规模扩展,另一个是推理能力提升,我们希望最终将两者结合。”

云端推理芯片的大机遇

通过使用“思维链”算法模型,OpenAI o1拥有更强大的推理能力,在复杂逻辑问题中的表现已经接近甚至超越了人类博士生。不过,这也就意味着,OpenAI需要为OpenAI o1配备一个强大的推理算力集群,以帮助完成OpenAI o1应对每一个复杂问题时的“思维链”,这个深度思考的推理算力需求,相较于此前的GPT-4、GPT-4o等模型明显要大得多,这从OpenAI o1的使用成本就可以看出来。

由于OpenAI一直引领全球大模型产业发展,相信不久后就会出现一大批类OpenAI o1的大模型。届时,全球AI大模型的水平将迈上一个新台阶,AI大模型对推理算力的需求也将倍增,甚至是指数级增长。

根据研究机构Futurum Group的统计数据,2023年全球云端AI处理器和加速器市场规模为377亿美元,其中CPU份额为20.5%,GPU份额为73.5%,XPU的份额为3%,ASIC的份额为3%。预计到2024年,全球云端AI处理器和加速器市场规模将达到563亿美元,同比增长49.3%。到2028年增长至1383亿美元,未来几年的年复合增长率高达29.7%。

同时,目前英伟达GPU是主要的云端训练和推理芯片,Futurum Group的数据显示,英伟达在AI GPU的市场占比高达92%。英伟达CEO黄仁勋此前表示,过去一年里,英伟达GPU在云端训练和推理的应用占比为6:4。以此推算,目前全球云端AI推理芯片市场规模已经非常可观。

随着类OpenAI o1大模型的出现,云端AI推理芯片的需求预计将进一步暴涨,英伟达、谷歌、AMD、英特尔等国际巨头的相关业务预计将大幅增长。同时,国产高性能计算芯片预计也将迎来巨大的产业机会,包括燧原科技、壁仞科技、寒武纪、摩尔线程、天数智芯、平头哥半导体、昆仑芯、瀚博半导体等公司都有布局云端推理芯片。

以燧原科技为例,该公司人工智能推理加速卡云燧i20在行业内已经广为人知。云燧i20是基于邃思2.5芯片打造的面向数据中心的第二代人工智能推理加速卡,具有高能效、模型覆盖面广、易部署易运维等特点,可广泛应用于计算机视觉、语音识别与合成、自然语言处理、搜索与推荐等推理场景。

再比如天数智芯的智铠100,支持FP32、FP16、INT8等多精度推理混合计算,实现了指令集增强、算力密度提升、计算存储再平衡,相较于市场上现有主流产品,智铠100将提供2-3倍的实际使用性能。

第三个例子是摩尔线程的大模型智算加速卡MTT S4000,可用于AI大模型的训练、微调和推理。MTT S4000采用第三代MUSA架构,配备了128个Tensor 核心,单卡支持48GB 显存和768GB/s的显存带宽。基于摩尔线程自研MTLink 技术,MTT S4000可以支持多卡互联,支持千卡集群基础设施建设,加速千亿参数大语言模型计算。

随着类OpenAI o1大模型的发布,上述这些产品以及后续迭代的产品都有巨大的增量市场空间。

结语

OpenAI o1的出现是一个划时代的产品,它可以进行通用复杂推理,然后给出更加精准的答案。OpenAI o1让AI大模型向着类人智能迈出了坚实的一步。当然,OpenAI o1算法的形态要求其需要更强大的推理算力支撑,必将带动全球云端推理芯片需求的爆发。随着类OpenAI o1逐渐出现,国产云端推理芯片也会从巨大的蓝海市场里分一杯羹。

-

LLM推理模型是如何推理的?2026-01-19 727

-

OpenAI O3与DeepSeek R1:推理模型性能深度分析2025-02-18 1686

-

对标OpenAI o1,DeepSeek-R1发布2025-01-22 3372

-

OpenAI即将推出o3 mini推理AI模型2025-01-20 1008

-

OpenAI发布新一代推理模型o3及o3-mini2024-12-24 1395

-

OpenAI推出新一代推理模型o3系列2024-12-23 1370

-

OpenAI发布o1模型API,成本大幅下降60%2024-12-19 1097

-

OpenAI发布满血版ChatGPT Pro2024-12-06 1396

-

昆仑万维推出“天工大模型4.0”o1版(Skywork o1)邀请测试2024-11-28 1321

-

Kimi发布新一代推理模型k0-math2024-11-19 1746

-

天工大模型4.0 O1版即将启动邀测2024-11-18 1752

-

OpenAl发布o1推理模型物化生水平比肩人类博士电子发烧友网官方 2024-09-13

全部0条评论

快来发表一下你的评论吧 !