号称全球最强开源模型 ——Qwen2.5 系列震撼来袭!PerfXCloud同步上线,快来体验!

电子说

描述

9月19日凌晨,阿里通义千问正式开源Qwen2.5系列大模型,最新发布包括了语言模型Qwen2.5,以及专门针对编程的Qwen2.5-Coder和数学的Qwen2.5-Math模型。PerfXCloud(澎峰云)大模型开发与服务平台第一时间支持Qwen2.5 72B并在平台完成上线,赶快来体验吧!

Qwen2.5系列模型

更大的训练数据集:Qwen2.5语言模型的所有尺寸都在最新的大规模数据集上进行了预训练,该数据集包含多达18Ttokens。相较于Qwen2,Qwen2.5获得了显著更多的知识(MMLU:85+),并在编程能力(HumanEval 85+)和数学能力(MATH 80+)方面有了大幅提升。

更强的指令遵循能力:新模型在指令执行、生成长文本(超过8K标记)、理解结构化数据(例如表格)以及生成结构化输出特别是JSON方面取得了显著改进。Qwen2.5模型总体上对各种system prompt更具适应性,增强了角色扮演实现和聊天机器人的条件设置功能。

长文本支持能力:与Qwen2类似,Qwen2.5语言模型支持高达128K tokens,并能生成最多8K tokens的内容。

强大的多语言能力:它们同样保持了对包括中文、英文、法文、西班牙文、葡萄牙文、德文、意大利文、俄文、日文、韩文、越南文、泰文、阿拉伯文等29种以上语言的支持。

专业领域的专家语言模型能力增强:即用于编程的Qwen2.5-Coder和用于数学的Qwen2.5-Math,相比其前身CodeQwen1.5和Qwen2-Math有了实质性的改进。具体来说,Qwen2.5-Coder在包含5.5T tokens编程相关数据上进行了训练,使即使较小的编程专用模型也能在编程评估基准测试中表现出媲美大型语言模型的竞争力。同时,Qwen2.5-Math支持中文和英文,并整合了多种推理方法,包括CoT(Chain of Thought)、PoT(Program of Thought)和TIR(Tool-Integrated Reasoning)。

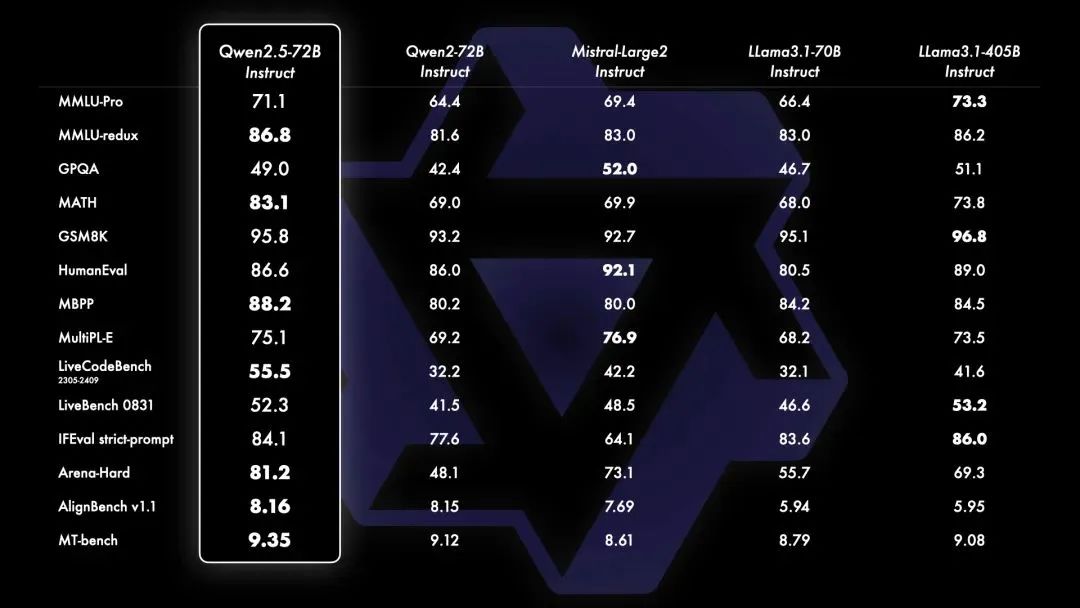

Qwen2.5-72B在多个基准测试中的结果

审核编辑 黄宇

-

号称全球最强开源AI模型DBRX登场电子发烧友网官方 2024-03-28

-

开源大模型Falcon(猎鹰) 180B发布 1800亿参数2023-09-18 1507

-

谷歌发布全球最强开源大模型Gemma2024-02-22 827

-

新火种AI|谷歌深夜炸弹!史上最强开源模型Gemma,打响新一轮AI之战2024-02-23 368

-

Meta推出最强开源模型Llama 3 要挑战GPT2024-04-19 853

-

通义千问推出1100亿参数开源模型2024-05-06 594

-

阿里通义千问Qwen2大模型发布并同步开源2024-06-11 1086

-

PerfXCloud顺利接入MOE大模型DeepSeek-V22024-07-27 657

-

阿里Qwen2-Math系列震撼发布,数学推理能力领跑全球2024-08-12 762

-

PerfXCloud 重大更新 端侧多模态模型 MiniCPM-Llama3-V 2.5 闪亮上架2024-08-27 539

-

零一万物正式开源Yi-Coder系列模型 PerfXCloud火速支持等你体验!2024-09-05 360

-

PerfXCloud重磅升级 阿里开源最强视觉语言模型Qwen2-VL-7B强势上线!2024-10-23 315

-

阿里云开源Qwen2.5-Coder代码模型系列2024-11-14 375

-

阿里通义千问代码模型全系列开源2024-11-14 367

-

阿里通义千问发布Qwen2.5-Turbo开源AI模型2024-11-19 614

全部0条评论

快来发表一下你的评论吧 !