机器视觉定位算法:二维图像模式定位系统算法

编程实验

描述

机器视觉(Machine Vision),又被称为计算机视觉或人工视觉,是用计算机模拟人眼的视觉功能,从图像或图像序列中提取信息,对客观世界的三维景物和物体进行形态和运动识别。 机器视觉技术已广泛应用于工业自动化生产线,各类检验和监视,视觉导航,图像自动解释、人机交互及虚拟现实等领域。

二维图像模式定位系统算法

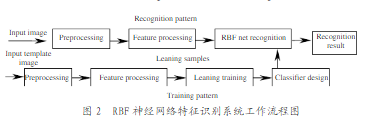

机器视觉中的二维图像模式定位系统算法整体流程图如图1所示,由RBF网络模式训练和模式定位两个部分组成。

径向基函数(RBF,Radial basis function) RBF网络为两层MLP(Multiple Layer Propagation)提供了一种前馈结构,具有最佳逼近(Best approximation)性质,无须学习系数,学习收敛速度极快,在样本数目多的情况下,正确率趋于稳定。故本算法中采用RBF网络对图像特征进行神经网络学习训练。

定位系统具体工作流程图如图2所示。先设定训练模式,对模板图像进行预处理,滤除干扰、噪声后再经特征提取得到训练样本,对样本进行学习,提供分类决策。在待识别模式中对待识别图像同样经过预处理、特征提取后,用训练模式中的分类器中提取的分类决策进行RBF网络识别,得到结果。若分类器不能提供目前的分类决策,则得到错误检测,需要更新训练模式,直到重新获得正确的分类决策。其中最重要的一个环节就是特征提取与选择,影响到最后的定位精度。

图像特征提取

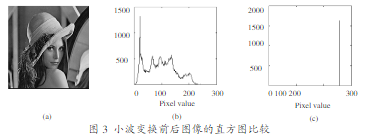

小波变换具有多分辨率特性,对原始图像的分解呈Mallat塔式分解,具有集中信号能量的能力,小波变换后图像的信息仅仅集中在少数几个变换系数上,多数变换系数为零,有助于降低图像目标小波变换的时间复杂度和空间复杂度(如图3所示)。同时小波变换后代表图像顶点等特征点的模极大值的范数不随图像的旋转、平移和伸缩的变化而改变,故本文在小波变换的基础上对图像提取特征。

视觉系统获得具有实际模式的二维图像,记为I(x,y)。存储在计算机内存中具有同样模式的参考图像(即模板)记为

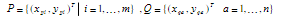

本文只考虑二维图像变化为刚性变化的情况。点集P、Q定义为

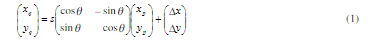

其中 点集P{p1、p2、… pm}表示参考图像W的数据,Q{q1、q2、… qn}为经过仿射变换(如平移、旋转、缩放等)的图像I数据。本文假设图像I和模板W中心重合,则P与Q之间的关系可以通过公式(1)求得

其中s 是两幅图像的放大缩小比例系数,θ是旋转角度,∆x、∆y分别是沿X轴,Y轴方向的位移偏移量。

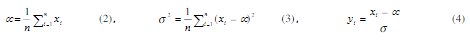

特征提取步骤为:首先对图像重采样,使得其宽度和高度是2的幂次方,然后进行小波变换得到矩阵X,将X归一化得到图像特征矩阵Y。其中X=[x1,…,xn]T为低分辨率的小波系数组合成的矩阵,均值µ,方差σ,矩阵Y=[y1,…,yn]T为

模式训练算法

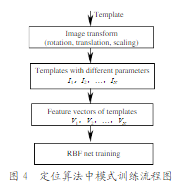

获得图像特征矩阵后,对特征进行 RBF网络学习训练,如图4所示。

具体如下:

对RBF中心的学习采用了模糊聚类算法

(1) 选取群数M(2≤M≤N)及指数型权重r(1≤ r ≤∞)。选取起始的分割矩阵U(0)及误差临界值ε。初始化聚类中心di(i=1,2,…,M),根据经验从输入图像特征样本Xj(j=1,2,…,N)中选择M个样本作为聚类中心。

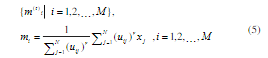

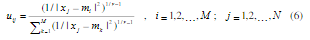

(2) 将U(t)代入公式(5)计算模糊聚类中心

将模糊聚类中心代入公式(6)计算新的分割矩阵U(t+1)。

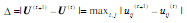

(4) 计算

若 ∆>ε,则t=t+1,回到(2);否则聚类中心的分布不再变化,结束。

计算权值系数

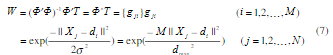

由于本算法中RBF选用的是高斯函数,因此方差为

其中 M为隐含层节点数,dmax为所选取中心之间的最大距离。隐含层至输出层单元连接权值用最小二乘法直接计算,即

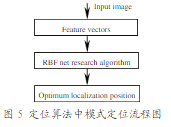

模式定位算法

对背景图像进行预处理后提取特征,用已经训练好的RBF网络分类器进行邻域搜索,求得最佳匹配位置。流程图如图5所示。

-

技术|二维PDOA平面定位方案2024-06-04 2585

-

基于RFID的二维室内定位算法怎么实现?2021-05-21 1801

-

机器视觉算法解析:二维图像模式定位系统算法2019-07-08 3231

-

机器人视觉系统组成及定位算法分析2019-06-08 3785

-

基于建筑特征及二维地图的移动机器人视觉定位2018-01-30 1243

-

二维网格的室内匹配定位算法2018-01-29 1221

-

【下载】《机器人学、机器视觉与控制――MATLAB算法基础》2018-01-17 49593

-

基于RFID室内定位算法分析2017-10-31 1344

-

车牌定位算法的研究及设计2017-09-06 933

-

基于labview机器视觉的图像定位2017-03-31 12355

-

机器视觉算法与应用(双语版)2016-06-29 3900

-

基于二维图像的FFT算法实现matlab程序2014-05-15 6595

-

二维声源定位算法仿真2010-07-08 919

-

二维声源定位算法仿真设计方案2009-12-10 21383

全部0条评论

快来发表一下你的评论吧 !