RT-Thread AIOS,让小车更懂你!

描述

如何在嵌入式系统上玩转 AI,到底是独立部署?云端部署?一直是一个争议不断地问题。同时,随着人形机器人技术的快速发展,移动设备对智能化的需求也变得尤为迫切。在这样一个背景下,RT-Thread AI 团队经历对大量芯片厂商和下游应用业务公司的咨询和讨论,认为在可预见的未来,AI 会产生一种端侧和云端混合部署的形态,即大规模、大参数模型运行在云端,如大语言模型,而中小规模、中小参数模型则运行在端侧,形成一种分布式 AI 部署的形态。本章将以智能小车的整个开发过程为例,向大家全景展示如何通过这种分布式 AI 的部署方式,最终实现传统小车的智能化过程。在这个过程中,我们将最大限度的保留原有小车硬件资源,而通过 RT-Thread AIOS 架构,最终实现大模型和端侧小模型协作,将传统小车智能化。

2硬件与软件架构

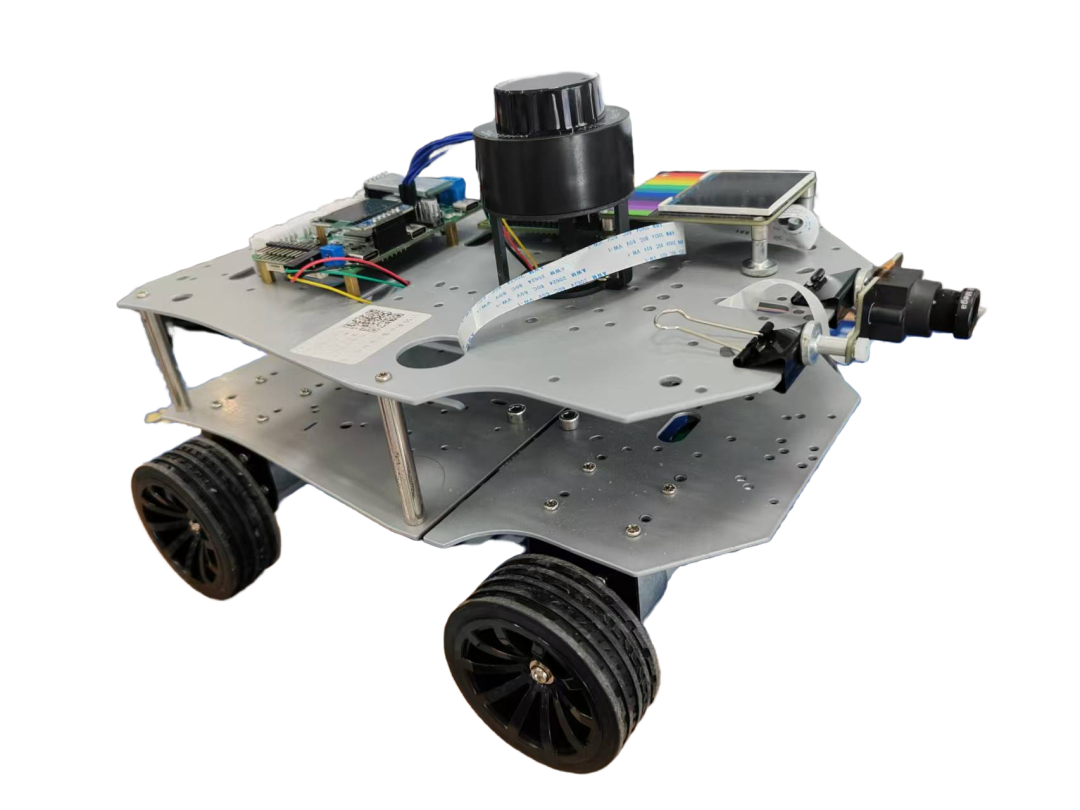

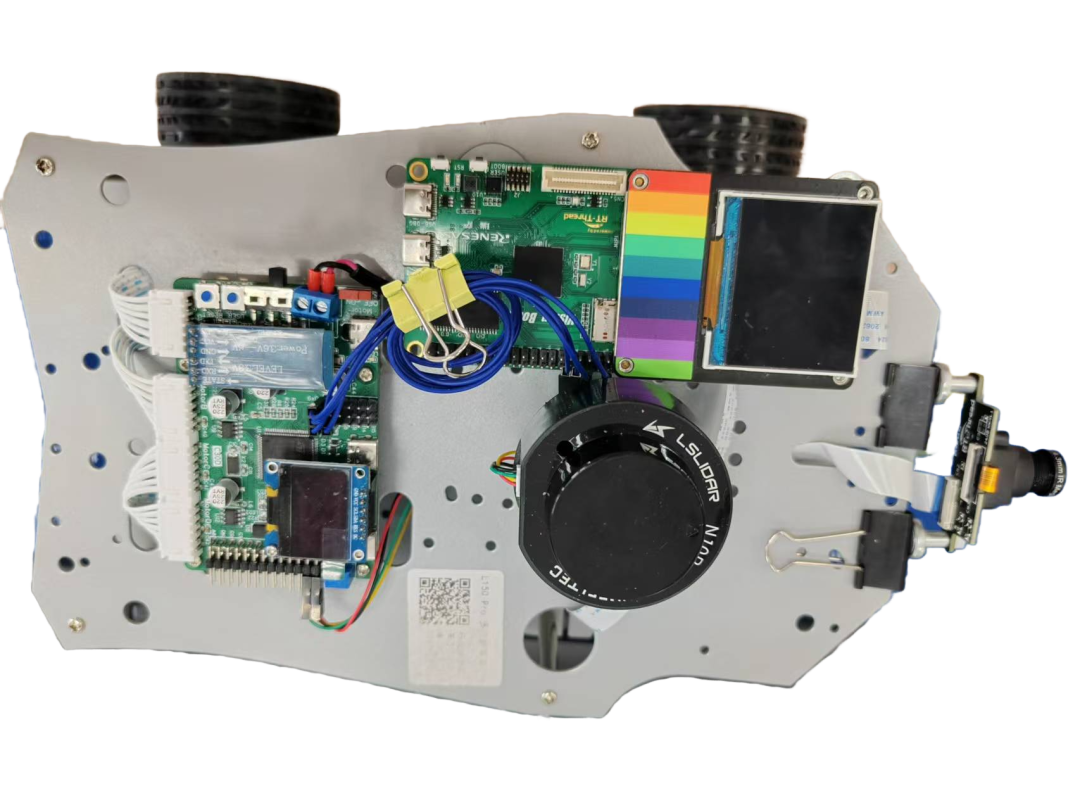

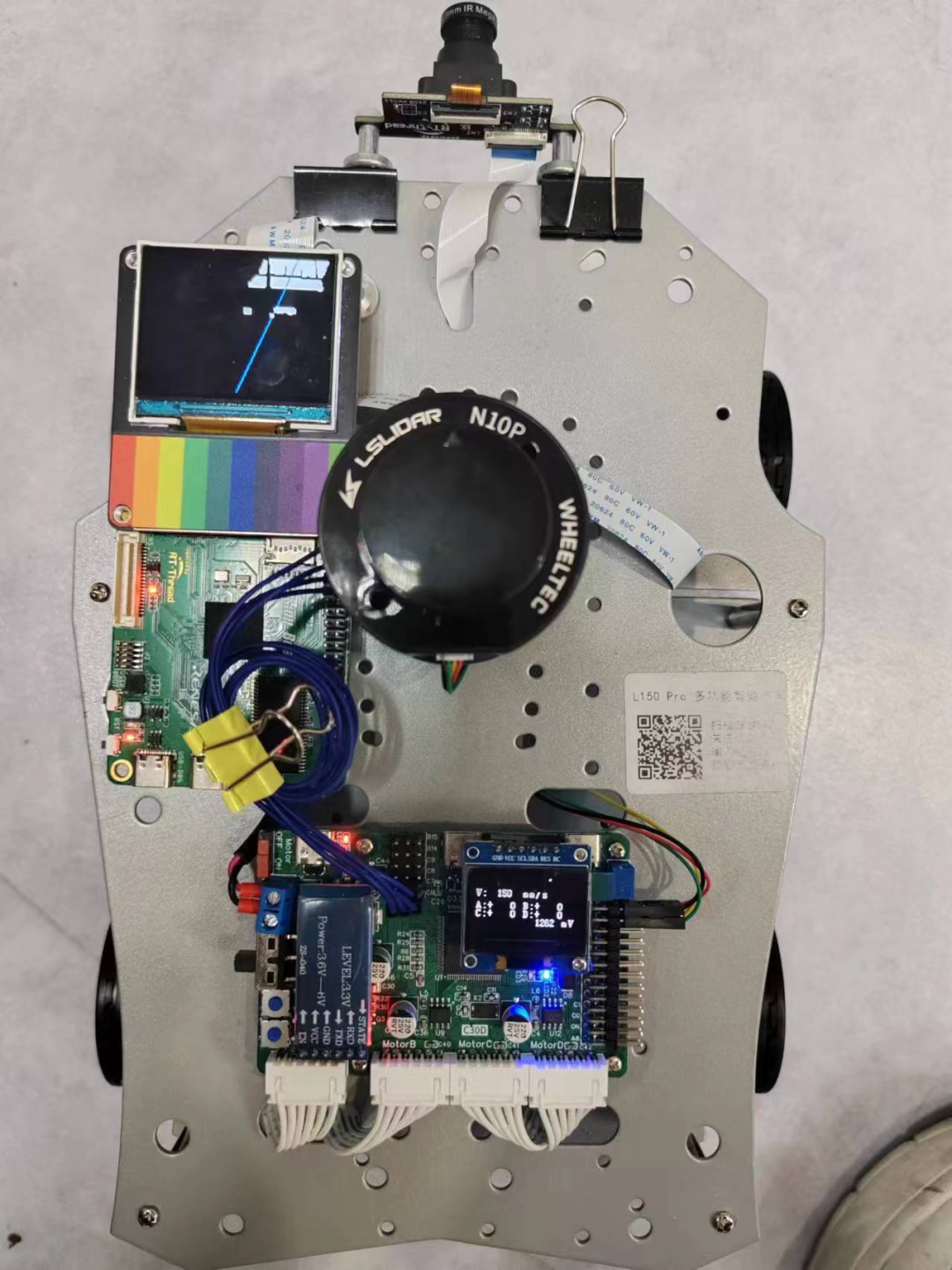

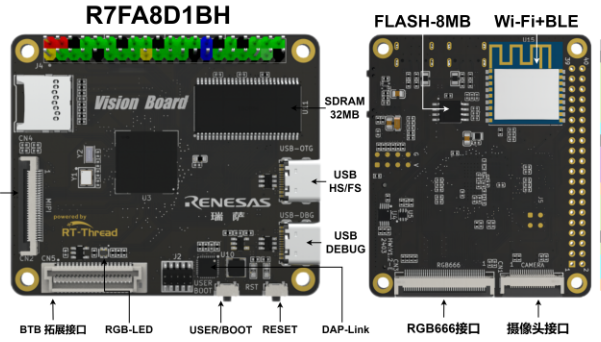

硬件上,智能小车的车控部分搭载了意法半导体最基础的 STM32407VET 芯片,该模块结合蓝牙模块、OLED 显示屏、激光雷达等模块,同时将 RT-Thread AIOS 框架集成在该芯片上,实现小车和云端大语言模型的交互。同时,小车配备了 Vision-Board 开发板,为智能小车构建了一个高性能的机器视觉模块。Vision-Board 开发板搭载 Cortex-M85 架构的 RA8D1 处理器,配备 LCD 显示屏和摄像头,能够进行实时图像处理和显示,通过串口和 STM32407VET 芯片进行交互。软件上,两款芯片均使用了 RT-Thread 实时操作系统作为控制系统,提供了一系列应用组件和驱动框架,如 TCP/IP 协议栈,虚拟文件系统,POSIX 接口,图形用户界面,FreeModbus 主从协议栈,CAN 框架,动态模块等。通过对智能小车车控功能语义级别的学习和应用,最终通过云端的大模型控制小车实现各种复杂功能。在大模型方面,智能小车采用基于开源大模型 SenseVoiceSmall 和通义千问大模型的微调模型进行联合处理。其中,SenseVoiceSmall 作为一个轻量化的语音识别模型,能够高效地将语音实时转化为文本。通义千问则对文本内容进行智能解析和理解,最终转换成小车可执行的逻辑和指令。在端侧的计算机视觉方面,为达到智能感知的效果,智能小车采用 openMV 进行图像处理,其搭载的处理器和摄像头可以轻松胜任小车的诸多功能,通过 openMV 实现了循迹、色块追踪、二维码识别、人脸追踪等功能,同时可以在 LCD 显示器上迅速、直观地看到 openmv 图像处理的过程。

智能小车支持 C/Python 等多种编程语言,提供丰富的接口,方便开发者灵活调用各类功能模块。

3

一些例子

语音控制基于 SenseVoiceSmall 和通义千问实现,深度融合了 AI 技术,用户通过语音指令对小车进行控制,不仅可以在多种模式之间随心切换,还能精准控制小车的运动状态。常用的模式包括循迹、色块追踪、二维码识别、人脸追踪、雷达避障、雷达跟随以及雷达走直线等。

3.1

示例 1:智能小车底盘控制

通过语音识别切换到寻迹模式后,智能小车通过摄像头实时采集图像,智能分析路面状况,精准识别并追踪指定路线。

3.2

示例 2:目标追踪

在色块追踪模式中,智能小车能够识别特定颜色的物体,并自动调整运动轨迹以追踪目标。小车还可以识别并获得二维码中的信息。

智能小车具备人脸识别功能,能够人脸录入系统中。录入后,小车便能自动追踪库中包含的目标人物,智能地跟随其移动。

以上功能充分展示了机器视觉在智能小车中的灵活应用,通过与小车的互动,能够深入理解图像处理和物体识别等关键技术。

3.3

示例 3:激光雷达应用

为了一步提升小车的智能化水平和环境感知能力,我们在小车上加装了激光雷达,这使小车能够实时获取距离信息,从而更有效地避开障碍物,加装激光雷达后,小车的整体性能得到了显著提升。

例如,基于激光雷达的避障功能,即使小车在一个狭小的空间内,也可以行动自如。

上文中我们提到了人脸追踪功能,在激光雷达加持下,即使我们没有录入人脸也可以实现跟踪,启动雷达跟踪可以使小车跟踪附近的一个物体并保持一定距离。

另外,雷达走直线模式通过对参照物体的识别来实现小车的直线运动。小车能够以其左侧的物体平面作为参照,保持稳定的直线行驶。如果需要更换其他角度作为参照,只需对代码进行相应修改或直接修改雷达角度即可。

3.4

总结:

我们已经展示的功能显示了在 RT-Thread AIOS 框架上,可以通过语音交互对基于 RT-Thread OS 的设备进行智能化,最终使得系统理解指令、执行指令实现指令发出者的控制目标。此外,用户也可以自行增加定制的源语级控制函数到 AIOS 框架中,并通过云端大模型进行理解和学习,最终通过语音交互进行控制,使得系统变得更加灵活、智能。

-

RT-Thread v5.0.2 发布2023-10-10 3569

-

基于RT-Thread Studio学习2023-05-15 6750

-

RT-Thread文档_RT-Thread 简介2023-02-22 1085

-

RT-Thread学习笔记 RT-Thread的架构概述2022-07-09 6378

-

RT-Thread记录(二、RT-Thread内核启动流程)2022-06-20 7468

-

RT-Thread全球技术大会:萤石研发团队使用RT-Thread的技术挑战2022-05-27 2936

-

RT-Thread AI kit开源:轻松实现一键部署AI模型至 RT-Thread2022-01-25 1576

-

RT-Thread软件包定义和使用2018-05-21 12338

-

RT-Thread编程指南2015-11-26 2351

全部0条评论

快来发表一下你的评论吧 !