激光雷达的工作原理和分类

描述

1、激光雷达的工作原理是什么?

激光雷达是一种以发射激光束来探测目标位置、速度等特征量的雷达系统。 这个系统也可以通过扫描发射和接收装置来获取目标物体的三维形状,在不同角度发射和接收激光脉冲,可以构建出物体的完整三维轮廓。

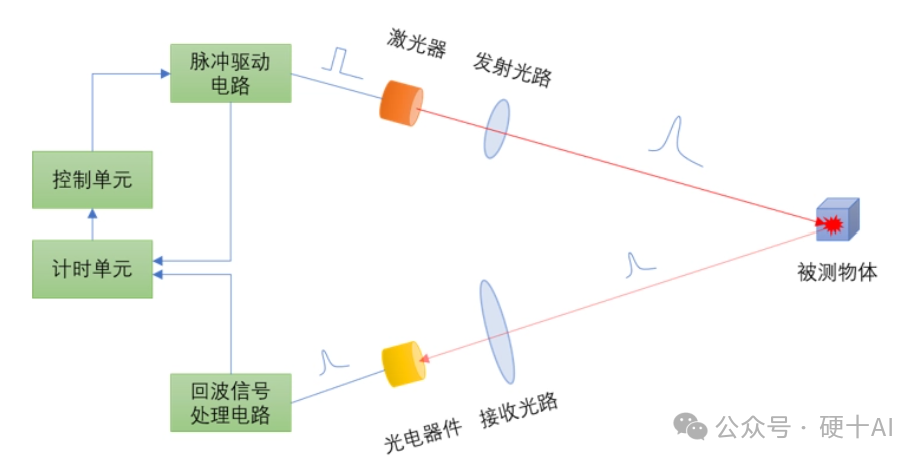

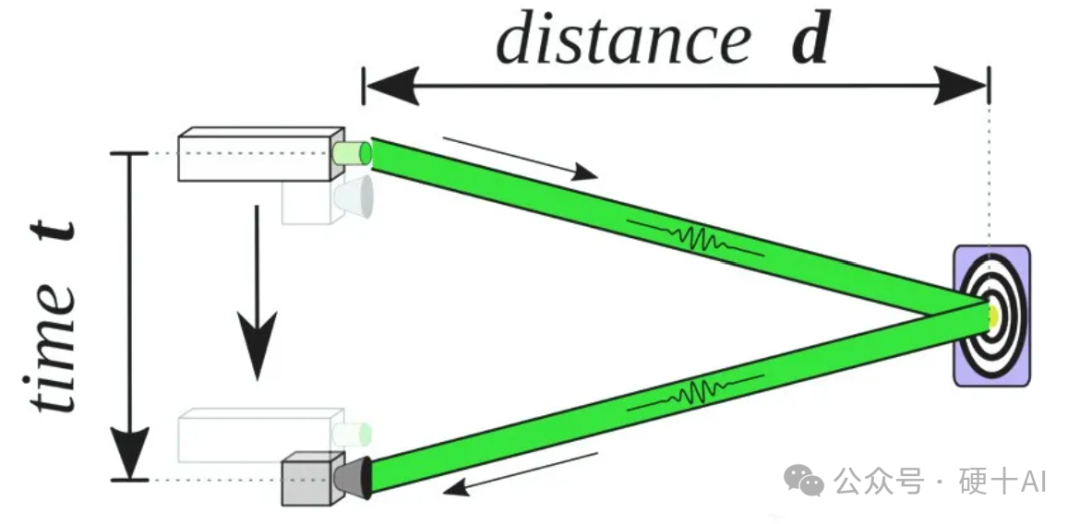

激光雷达的工作原理基于光的发射、传播和接收,最终通过测量光脉冲从发射到接收的时间来确定距离,下图是激光雷达测量距离的基本步骤。

发射激光脉冲:激光雷达设备发射一束激光脉冲,这些脉冲通常是红外或近红外光。

光的传播:激光脉冲以光速传播,向目标物体移动。

光的反射:当激光脉冲遇到目标物体时,部分光会被反射回来。

接收反射光:激光雷达设备中的接收器捕捉反射回来的激光。接收器通常与发射器紧密对齐,以确保接收到的光是直接从目标物体反射回来的。

时间测量:设备内部的计时器记录激光脉冲发射和接收的时间间隔。由于光速是已知的,这个时间间隔可以用来计算光脉冲往返目标物体的距离。

计算距离:距离的计算公式是,距离=光速×时间/2,其中时间是光脉冲往返的时间。

数据处理:测量到的距离数据可以用于生成点云,这激光雷达在短时间内可以获取大量的位置点信息(或者称为激光点云),这些点云可以进一步处理,生成三维模型或地形图。

2、激光雷达如何分类?

激光雷达有很多种不同的分类方法:

(1) 按照波长分类, 可分为905nm、1550nm、940nm等,目前主流的激光雷达主要有905nm和1550nm两种波长。

905nm: 激光雷达接收器可以直接选用价格较低的硅材质,905nm激光雷达成为了当下最主流的激光雷达所选用的波长。不过人眼可识别的可见光波长处在390780nm,而4001400nm波段内激光都可以穿过玻璃体,聚焦在视网膜上,而不会被晶状体和角膜吸收,人眼视网膜温度上升10℃就会造成感光细胞损伤。因此905nm激光雷达为了避免对人眼造成伤害,发射功率需先在在对人无害的范围内。因此,905nm激光的探测距离也会受到限制。

1550nm: 相比905nm激光,1550nm激光会被人眼晶状体和角膜吸收,不会对视网膜产生伤害,因此1550nm激光雷达可以发射更大功率,探测距离也可以做到更远。但是1550nm激光雷达无法采用常需要用到更加昂贵的铟镓砷(InGaAs)材质,因此在价格上较905nm激光雷达会较高。

(2) 按照测量方式分类 ,可以分为ToF激光雷达和FMCW激光雷达

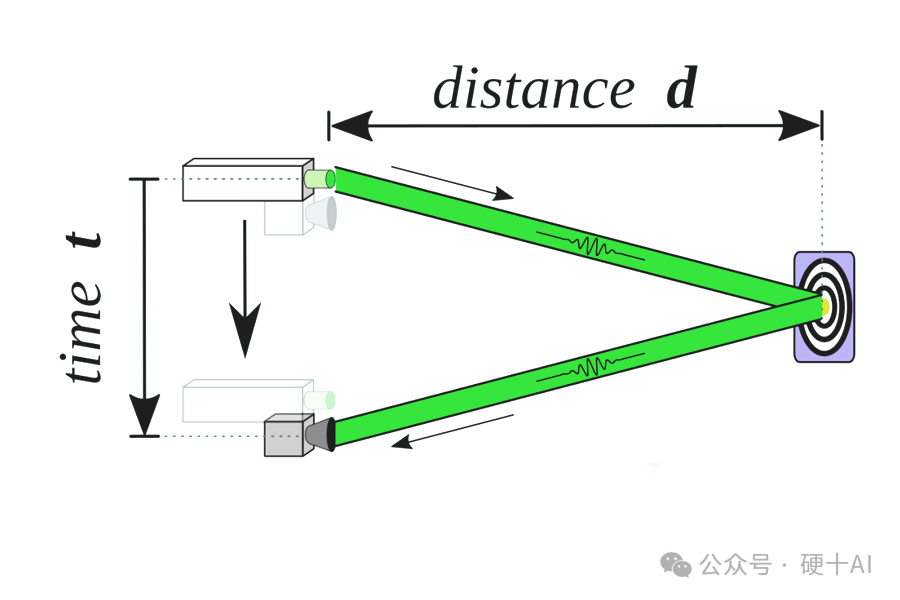

ToF(Time of Flight,飞行时间): ToF激光雷达通过直接测量发射激光与回波的信号的时间差,基于光在空气中的传播速度得到目标物体的距离信息,具有响应速度快,探测精度高的优势。ToF方案技术成熟度高,成本相对低,为目前主要激光雷达使用的方案。

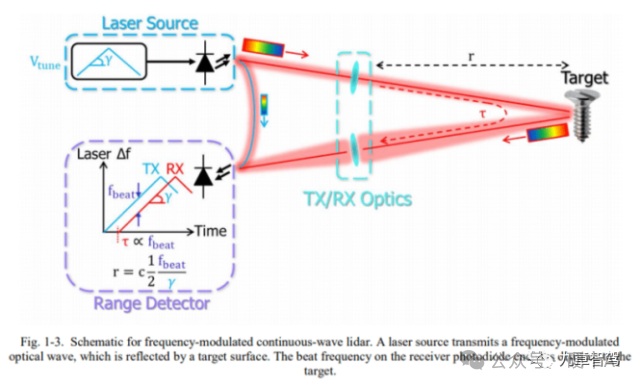

FMCW(Frequency Modulated Continuous Wave,调频连续波): FMCW激光雷达将发射激光的光频进行线性调制,通过回波信号与参考光进行相干拍频得到频率差,从而间接获得飞行时间推出目标距离。FMCW具有可直接测量速度信息和抗干扰强的优势。

(3*按照扫描方式分类,可以分为机械式、半固态和全固态雷达,雷达正在经历机械式到半固态,再由半固态到全固态的发展过程。

机械式激光雷达: 以一定的速度旋转,在水平方向采用机械结构进行 360°的旋转扫描,在垂直方向采用定向分布式扫描,机械式激光雷达的发射器、接收器都跟随扫描部件一同旋转。机械式激光雷达作为最早装车的产品,技术已经比较成熟,因为其是由电机控制旋转,所以可以长时间内保持转速稳定,每次扫描的速度都是线性的。

半固态激光雷达: 发射器和接收器固定不动,只通过少量运动部件实现激光束的扫描。半固态激光雷达由于既有固定部件又有运动部件,因此也被称为混合固态激光雷达。根据运动部件类型不同,半固态激光雷达又可以细分为转镜类半固态激光雷达、MEMS半固态激光雷达和棱镜类半固态激光雷达。

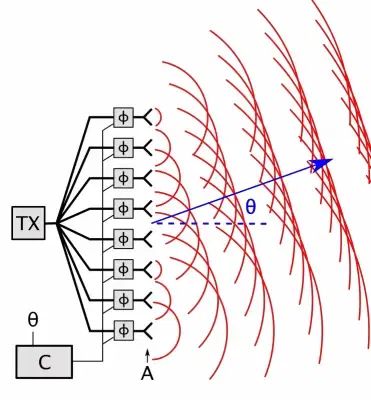

全固态激光雷达: 内部完全没有运动部件,使用半导体技术实现光束的发射、扫描和接收。固态激光雷达又可分为Flash固态激光雷达和OPA固态激光雷达。其中OPA(Optical Phase Array的简称,即光学相控阵)固态雷达应用的是相控阵技术,相控阵雷达发射的是电磁波,而OPA激光雷达发射的是光,而光和电磁波一样也表现出波的特性,所以原理上是一样的。波与波之间会产生干涉现象,通过控制相控阵雷达平面阵列各个阵元的电流相位,利用相位差可以让不同的位置的波源会产生干涉(类似的是两圈水波相互叠加后,有的方向会相互抵消,有的会相互增强),从而指向特定的方向,往复控制便得以实现扫描效果。光和电磁波一样也表现出波的特性,因此同样可以利用相位差控制干涉让激光“转向”特定的角度,往复控制实现扫描效果。

3、激光雷达的应用场景有哪些?

激光雷达在众多领域都发挥着重要作用,并且随着技术的不断发展,其应用范围还在不断扩大。

自动驾驶:在自动驾驶汽车中,激光雷达能够精确地感知车辆周围的环境,包括车辆、行人、障碍物的位置、速度和形状等,为车辆的路径规划和决策提供关键信息。

智能交通:用于交通流量监测、道路状况评估和智能交通信号控制。它可以实时检测道路上的车辆数量、速度和间距,优化交通流量。

测绘与地理信息:能够快速、高精度地获取地形、地貌和建筑物的三维信息,用于地图绘制、城市规划和土地测量。比如在大规模的地形测绘项目中,激光雷达可以生成详细的数字高程模型。

工业自动化:在工厂自动化中,用于物料搬运、机器人导航和质量检测。例如,在仓储物流中,激光雷达可以帮助自动导引车(AGV)准确地在仓库中行驶和装卸货物。

航空航天:用于飞机的防撞系统、地形跟随和地形规避。同时,在卫星遥感中,激光雷达可以测量大气参数和地表特征。

军事领域:用于目标侦察、武器制导和战场态势感知等。例如,在导弹制导系统中,激光雷达可以提高导弹的命中精度。

4、激光雷达选型时有哪些关键参数?

选择激光雷达时需要注意一些关键规格参数

测距精度: 表示为距离的误差

角分辨率: 可以探测到最小角度,与激光束发射和接收统计相关。

扫描频率: 每秒扫描次数,也称帧率,影响激光雷达的实时性能。

视场角: 雷达可以覆盖的水平和垂直角度范围,决定了激光雷达可以检测到多少个目标。

工作距离: 可以探测到的最远距离,实际应用和激光功率、接收机灵敏度等相关。

数据输出方式: 输出数据的格式和接口类型

扫地机器人是应用非常广泛的机器人形态,扫地机器人的的关键指标主要包括, 清洁能力指标 ,含清洁吸力、清扫部件设计、续航时间和清扫面积指标、尘盒容量、噪音指标等; 智能化指标 ,含建图能力、导航能力、传感器配置、避障能力、自动回充能力等;控制 APP易用性指标 ,含清扫模式设定、定时清扫设定、虚拟墙设置、地图存储等。

1、扫地机器人关键的技术指标有哪些?

(1)清洁能力

吸力指标: 吸力的强弱直接影响清扫效果,是衡量扫地机器人清洁能力的重要指标,单位为帕斯卡(Pa)。日常家用清洁1500~2500Pa的吸力可以应对灰尘、毛发等常见垃圾;如果需要清理较大颗粒杂物或较顽固的污渍,则需要更高的吸力。当然,吸力越大通常意味着噪音和能耗也会相应增加。

清扫部件设计: 包含滚刷、边刷等清洁部件的设计。 滚刷位于扫地机器人底部吸尘口前方,主要作用是将底部灰尘扫起 。滚刷材质有胶条滚刷和刷毛滚刷,胶条滚刷能刮掉地面顽固颗粒,刷毛滚刷可拔出地砖和地板缝隙的灰尘,一些产品采用两者结合的方式,滚刷的形状、长度、转速等设计也会影响清扫效果。 边刷位于扫地机器人的边缘,可将墙边和角落的灰尘清扫出来 ,边刷的长度、材质以及转动灵活度等也会影响其清扫性能。对于扫拖一体的扫地机器人还需要考虑拖布的设计,拖布的材质、形状、湿润度控制等都很关键。

清扫面积和续航时间指标: 续航时间决定了机器人在一次充电后能清扫的面积,单位为分钟;清扫面积以平方米(m²)计算。电池容量在3000mAh的家用扫地机器人可满足大多数日常清洁需求。

尘盒容量设计: 尘盒用于收集垃圾,尘盒容量越大,可容纳的垃圾就越多,减少清理尘盒的频率。

噪音指标: 清扫工作时产生的噪音,通常以分贝(dB)为单位,影响用户体验。噪音在60分贝以下的扫地机器人较为适合家用场景使用,一些扫地机器人会采用涡流降噪技术等方式来降低噪音。

(2)智能化程度

建图能力: 通过机器人的激光传感器扫描周围环境,构建地图,定位精度高、建图速度快。

定位和导航: 可通过激光雷达传感器、惯性传感器、视觉传感器等协同导航。定位和导航中应用的不同传感器都会遇到一些限制,如应用视觉导航对光线条件有要求,光线较暗影响导航精度;应用陀螺仪和加速度计等惯性传感器获取机器人的运动信息,容易产生累积误差。

路径规划: 合理的路径规划可提高扫地机器人的清洁效率和覆盖率,避免漏扫和重复清扫。比如根据房间的布局和障碍物分布,自动规划高效的清扫路线, 先沿边清扫、再分区清扫等 。

避障能力: 扫地机器人在清扫过程中避免碰撞家具、墙壁等障碍物,减少机身磨损和损坏。 通过红外避障、超声波避障、激光避障、视觉避障、碰撞传感器等协同实现避障 。不同成本的扫地机器人,会配置不同的传感器组合。

自动充电: 自动回充功能可以让扫地机器人在电量不足时自动返回充电座充电,充电完成后继续工作,

(3)控制APP易用性指标

机器人需支持手机等终端的APP控制、并有清洁模式选择、定时清扫、虚拟墙设置、地图存储等功能。

2、"聪明"和"不聪明"的扫地机器人的区别是什么?

智能化的扫地机器人需要具备自主导航、路径优化、动态避障、自动充电等能力。扫地机器人的智能化差别主要体现在以下几个方面。

(1)扫地机器人导航能力差别

不聪明的: 通常采用随机导航,仅仅依靠超声波探测实现基础避障;容易重复清扫或遗漏区域。

聪明的: 使用激光雷达、摄像头等进行地图构建和路径规划,能够高效避障。

(2)扫地机器人环境感知能力差别

不聪明的:传感器较少,缺乏学习能力,仅能进行基本的碰撞检测。

聪明的 :配备多种传感器,通过不同的传感器协同能识别不同地面类型、障碍物和污垢区域。

(3)扫地机器人清扫模式能力差别

不聪明的: 功能简单,可能有一种或几种基本清扫模式。

聪明的 :支持多种清扫模式,如自动清扫,局部清扫,边缘清扫,定点清扫,区域清扫,深度清扫,静音清扫等。聪明的扫地机器人会跟人一样,区分清楚哪些是干净的地方哪些是比较脏的地方,通过先沿边清扫、再分区清扫、最后定点深度清扫等组合操作实现智能清扫。

早期的扫地机器人就属于“不聪明”的模式,模式是“随机”清扫,没有规划能力,走到哪里扫到哪里,碰到哪里就改变路线。现在智能化的扫地机器人是 “聪明”的模式 ,清扫告别了“横冲直撞”的随机式,利用定位导航技术让清扫变得有规划,提高清扫效率,降低机器损耗。

1、机器人进入了未知的环境会怎样?

当我们去了一个陌生的环境,为了迅速熟悉环境并到达自己想去的地方,如图书馆、旅店、咖啡厅等,我们会做下面这些事情。

眼睛观察周围地标,如建筑、大树、花坛等,并记住他们的特征。

根据双眼获得的信息,在自己的脑海中把特征地标在三维地图中重建出来,形成完整的对环境认知的三维信息。

在行走时不断获取新的特征地标,并且校正自己头脑中的地图模型。

根据自己前一段时间行走获得的特征地标,确定自己的位置。

走了很长一段路的时候,我们可能会回头看看,和脑海中之前的地标进行匹配。

如以上五步在整个行进的过程中,我们同时进行定位和建图。

如果将一个机器人放入未知的环境中的未知位置, 是否有办法让机器人一边逐步描绘出此环境完全的地图,一边决定应该往哪个方向行进?例如扫地机器人,如何能不受障碍物影响行进到房间,并进入每个角落完成清扫工作。这就涉及到两个主要的任务,建图任务与定位任务,并且这两个任务是并发的。

2、SLAM是什么?

SLAM(Simultaneous Localization and Mapping,即同步定位与地图构建) ,是一种在机器人学、自动驾驶和移动机器人和增强现实等领域中非常重要的技术。SLAM最早由Smith、Self和Cheeseman于1988年提出,是实现真正全自主移动机器人的关键。

SLAM技术解决的问题是,机器人被放置在一个它从未见过的环境中,SLAM技术让机器人在没有任何先验地图信息的情况下,通过自身的传感器来探索环境,同时构建出环境的地图,并在这个过程中确定自己在地图中的位置。定位(Localization)任务和地图构建任务(Mapping)是同时进行的。

SLAM可以分为激光SLAM和视觉SLAM, 激光SLAM可以分为2D SLAM和3D SLAM,视觉SLAM可以分为Sparse SLAM和Dense SLAM

SLAM技术的发展涉及到多个学科,包括计算机视觉、机器人学、人工智能和控制理论等。随着技术的进步,SLAM在精度、效率和应用范围上都有了显著的提升。

3、SLAM中有哪些关键技术点?

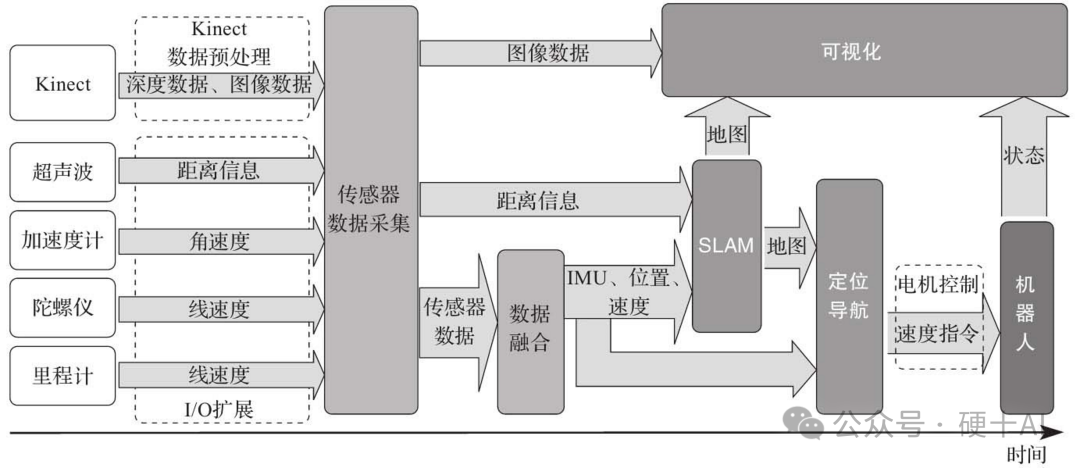

(1)传感器技术: 外部信息的采集依赖惯性测量单元(IMU)、霍尔编码器(Encoder)、激光雷达(Lidar)、深度摄像机等。

惯性测量单元: IMU提供姿态和位置信息。

霍尔编码器: 通过编码器获取车轮的运动数据,原理参考霍尔传感器 。

激光雷达 :Lidar通过发射激光束来探测目标位置、速度等特征量,感知外部信息。

摄像机 :包括单目摄像头、双目摄像头、深度摄像机,核心都是获取RGB和depth map(深度信息)。

(2)算法技术

应用SLAM算法的时候主要考虑下面几个方面

如何表示地图? 比如根据实际场景需求去选择dense或sparse算法。

如何感知信息? 比如选择激光雷达或者深度摄像机去感知外部环境。

如何关联传感器数据? 对于不同sensor的数据类型、时间戳、坐标系表达方式各有不同,需要统一处理。

如何进行定位与构图? 这是指实现位姿估计和建模,这里面涉及到很多数学问题,物理模型建立,状态估计和优化。

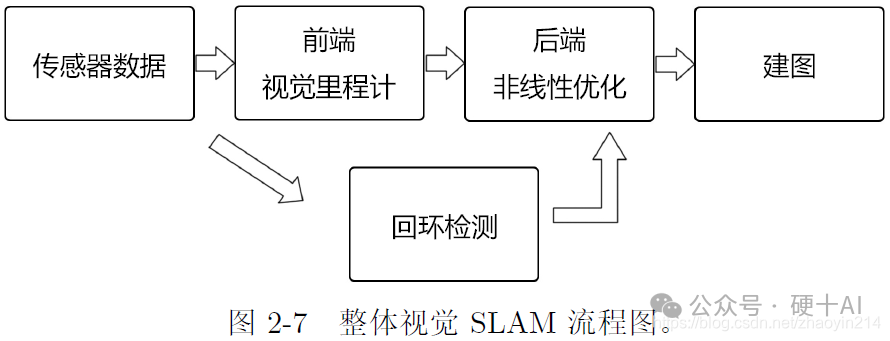

以视觉SLAM(VSLAM)为例,SLAM处理信息处理流程可以归纳为如下流程图, 其中“前端”是视觉里程计 ,提取每帧图像特征点,利用相邻帧图像,进行特征点匹配,然后去除大噪声进行匹配,得到一个位姿信息,同时利用IMU提供的姿态信息进行滤波融合。 “后端”则是通过非线性算法对前端输出的结果进行优化 ,涉及的数学知识较多,需利用滤波理论(EKF、UKF、PF)、或者优化理论等算法进行优化,最终得到最优的位姿估计。

常见的SLAM算法包括一下算法。PTAM算法,这是早期的视觉 SLAM 算法;Mono-SLAM算法,是单目视觉SLAM算法;ORB-SLAM算法,是基于 ORB 特征的视觉SLAM算法,具有较好的实时性和鲁棒性;还有RGBD-SLAM算法、LSD-SLAM算法等。实际应用中,SLAM建图具体实现方式会因使用的算法、传感器类型以及应用场景的不同而有所差异。

使用ROS实现机器人的SLAM是非常方便的 ,因为有较多现成的功能包可供开发者使用,如gmapping、hector_slam、cartographer、rgbdslam、ORB_SLAM、move_base、amcl等,并且开发者还能应用仿真环境进行验证。

4、SLAM技术在自动驾驶中的应用

(1)SLAM技术在自动驾驶中的应用体现在以下几个方面

环境感知: 自动驾驶汽车通过搭载的传感器(如激光雷达、相机、雷达等)实时获取周围环境的信息。利用SLAM技术, 车辆能够从这些传感器数据中提取特征 ,构建出周围环境的地图。

实时定位: 在行驶过程中,车辆需要实时确定自身在地图中的位置。SLAM技术通过传感器数据和地图信息,计算出车辆的精确位置和姿态。 这种定位不仅依赖于GPS,还依赖于车辆自身的传感器 ,确保在GPS信号弱或无信号的环境中也能准确定位。

路径规划: 有了环境地图和自身定位信息,自动驾驶汽车可以进行路径规划。SLAM技术帮助车辆识别可行路径,避开障碍物,规划出最优行驶路线。

自动避障: 在行驶过程中,车辆需要实时检测和避开障碍物。SLAM技术通过传感器数据,识别出前方的障碍物,并计算出避障路径。

回环检测: 回环检测是SLAM中的一个重要环节,指的是车辆在行驶过程中识别出曾经经过的地点。这有助于校正地图和定位信息,避免重复探索和定位误差。

动态地图更新: 环境是动态变化的,自动驾驶汽车需要不断更新其地图信息。SLAM技术能够实时处理新的传感器数据,更新地图,确保地图的准确性和时效性。

传感器融合: 自动驾驶汽车通常搭载多种传感器,每种传感器都有其优缺点。SLAM技术通过融合不同传感器的数据,提高整体的感知能力和鲁棒性。

数据关联: 不同传感器的数据类型和时间戳可能不同,SLAM技术需要将这些数据关联起来,确保数据的一致性和准确性。

(2)SLAM技术具体实现步骤

传感器数据采集: 车辆通过激光雷达、相机、IMU、超声波等传感器获取周围环境的图像和距离信息。

特征提取与匹配: 从传感器数据中提取特征点,并在不同时间点的图像中进行匹配。

位姿估计: 利用特征点匹配结果,计算车辆在地图中的位置和姿态。

地图构建: 将车辆的移动轨迹和环境特征结合起来,逐步构建出环境地图。

路径规划与优化: 根据地图和车辆定位信息,规划出最优行驶路径,并在行驶过程中不断优化。

动态更新: 实时处理新的传感器数据,更新地图和定位信息,应对环境变化。

通过这些步骤,SLAM技术为自动驾驶汽车提供了强大的环境感知和导航能力,确保其在复杂环境中的安全和高效行驶。

内容来源:硬十AI

-

激光雷达是自动驾驶不可或缺的传感器2017-09-08 5185

-

激光雷达分类以及应用2017-09-19 8738

-

常见激光雷达种类2017-09-25 13821

-

消费级激光雷达的起航2017-12-07 7309

-

固态设计激光雷达2018-01-25 8386

-

毫米波雷达VS激光雷达VS超声波雷达2019-09-19 20948

-

最佳防护——激光雷达与安防监控解决方案2020-02-29 5572

-

激光雷达知多少:从技术上讲讲未来前景2020-07-14 41514

-

激光雷达2021-01-17 20009

-

FMCW激光雷达与dTOF激光雷达的区别在哪?2021-07-23 30178

-

激光雷达传感技术的工作原理和特点2020-07-13 8399

-

激光雷达工作原理2022-03-16 11709

-

简述激光雷达的结构原理分类及特点 TIM320激光雷达的工作原理2023-08-22 4495

-

激光雷达LIDAR基本工作原理2024-03-05 9041

-

激光雷达(LiDAR)技术方案与工作原理全解析2025-04-25 2147

全部0条评论

快来发表一下你的评论吧 !