在NVIDIA BlueField-3 DPU上运行WEKA客户端的实际优势

描述

WEKA是可扩展软件定义数据平台的先驱,NVIDIA 正在与其合作,将 WEKA 先进的数据平台解决方案与功能强大的NVIDIA BlueField DPU相结合。

WEKA 数据平台的高级存储软件可充分发挥 AI 和性能密集型工作负载的潜力,而 NVIDIA BlueField DPU 则彻底改变了数据的访问、移动和安全性。这些前沿技术的集成将开创前所未有的数据管理效率和速度的新时代,并有望重塑高性能数据访问的格局。

解决高效的 AI 工作流程

AI 的迅速崛起推动了计算能力和网络速度的指数级增长,对存储资源提出了非常高的需求。虽然 NVIDIA GPU 提供了令人惊叹的可扩展、高效的计算能力,但是它们还需要高速的数据访问。

WEKA 与 NVIDIA 的合作解决了这一挑战。它们共同满足了模型训练和推理任务(包括检索增强生成,RAG)对 PB 级数据进行高带宽网络访问的关键需求。

关于 RAG 的用例,可阅读以下文章:

借助加速以太网网络和网络存储扩展企业 RAG

该联合解决方案专为处理丰富的图像和视频数据、向量数据库以及大量元数据保存的复杂性而设计。这确保了无缝且高效的 AI 工作流程,使集成变得及时,并成为未来数据驱动创新的关键。

提高吞吐量和安全性 降低延迟

此次合作的核心是集成 WEKA 客户端,并通过使用Virtio-FS 代码来完成。它直接在 BlueField DPU 上运行,而不是在主机服务器的 CPU 上运行。这种创新方法具有以下关键优势:

提高吞吐量:BlueField 硬件加速功能可实现更快的数据传输速率。

降低延迟:通过在 BlueField DPU 上运行 WEKA 客户端,数据访问操作可以绕过主机 CPU,从而显著降低延迟。

CPU 卸载:通过将 WEKA 客户端迁移到 DPU,可以释放宝贵的主机 CPU 资源用于应用程序处理,从而有可能提高整体系统性能和效率。

增强安全性:将存储操作卸载到 DPU 可创建额外的隔离层,从而增强整体系统安全性。

Virtio-FS 代码的实现有助于主机系统与网络数据之间的无缝通信,在不牺牲性能的情况下实现高效的文件系统操作。通过在 BlueField DPU 上运行 WEKA 客户端,可以从 CPU 卸载文件系统任务,从而减少开销,并释放高达 20% 的 CPU 资源以用于应用程序。

这种方法还可确保虚拟化环境中的本地文件系统效率和跨平台兼容性。此外,Virtio-FS 旨在适应不断发展的 DPU 技术, 采用NVIDIA DOCA 软件框架来简化未来的开发流程,并兼容新一代 NVIDIA BlueField DPU。

将 Virtio-FS 与 NVIDIA BlueField DPU 结合使用,可将高效、直接的文件共享与强大的卸载和加速功能的优势结合起来。这种协同作用可提高性能、降低系统复杂性,并支持适合 AI 工作负载的现代可扩展架构。

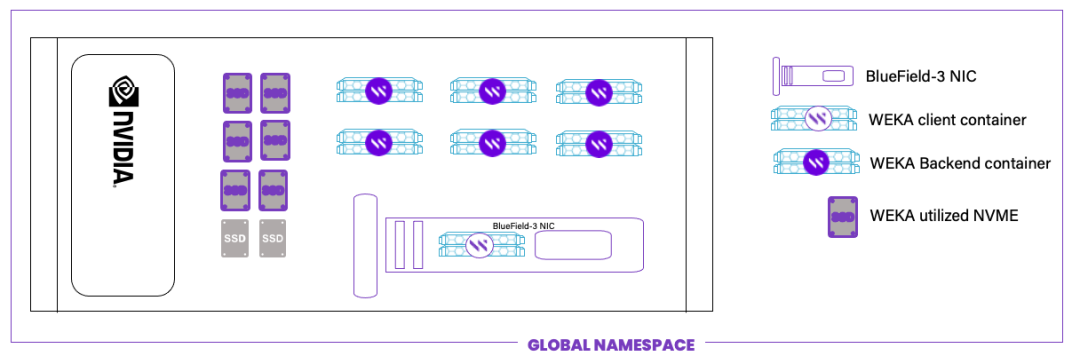

图 1:在 NVIDIA BlueField-3 DPU 上运行 WEKA 客户端可提高吞吐量、延迟和安全

硬件加速数据处理

AI 训练和推理对存储提出了独特的挑战,每个挑战都有不同的要求。训练需要高吞吐量来处理大型数据集和写入密集型操作,而推理需要出色的读取性能和低延迟来实现实时响应。这两种情况通常都依赖于共享文件系统。NVIDIA BlueField DPU 通过提供硬件加速数据处理来优化训练和推理工作负载。

优化 AI 模型训练

AI 模型训练对存储提出了很高的要求,需要快速访问庞大的数据池来支持 GPU 的生产力。训练过程包括定期读取大型数据池,以及频繁的持续写入操作,例如记录日志、保存检查点和记录指标。BlueField DPU 提供强大的写入性能和优化的读/写平衡,并有效提供高 IOPS。

适用于推理的低延迟和高读取性能

AI 推理具有不同的存储需求,需要快速访问来自多个来源的少量数据,以保持较低的用户响应时间。低延迟对于实时或近乎实时的处理至关重要,因为延迟会影响应用程序的响应能力和有效性。推理通常需要使用多个经过训练的模型和其他数据源来快速做出预测或决策。BlueField DPU 提供快速读取性能,这对于保持数据流畅运行至关重要,从而为时间敏感型 AI 应用程序提供准确的输出。

平衡训练和推理以提高 AI 性能和效率

训练和推理之间的特定压力略有不同。平衡这些需求对于构建高效且富有弹性的 AI 存储架构至关重要,对于创建有效且强大的 AI 存储解决方案也至关重要。将 WEKA 数据平台客户端与 NVIDIA BlueField DPU 集成,可提高训练和推理工作负载的存储性能,并提高解决方案的效率和安全性。

总结

在 NVIDIA BlueField DPU 上运行 WEKA 客户端有助于从 WEKA 文件系统访问文件,从而充分发挥性能密集型工作负载的潜力,并有利于数据访问、移动和安全性。

在 SC 2024 大会上,WEKA 和 NVIDIA 通过现场演示展示了集成解决方案的实际优势。与会者见证了通过提高数据访问速度和高效工作负载处理来加速 AI 数据处理。我们的专家团队随时可为您解答问题,并就此解决方案如何改变您的数据中心运营提供见解。

-

NVIDIA推出全新BlueField-4 DPU2025-11-03 1311

-

NVIDIA BlueField-3 DPU助力思科提高工作负载安全性和运营效率2024-06-27 2044

-

《数据处理器:DPU编程入门》+初步熟悉这本书的结构和主要内容2023-12-08 1569

-

借助 NVIDIA DPU 和 NVIDIA DOCA 为人工智能时代的数据中心带来变革2023-03-29 1843

-

GTC 2023:NVIDIA BlueField-3 DPU正式发布2023-03-24 3351

-

GTC23 | Oracle 云基础设施 (OCI) 选择 NVIDIA BlueField 数据中心加速平台2023-03-23 1392

-

Oracle 云基础设施 (OCI) 选择NVIDIA BlueField数据中心加速平台2023-03-22 958

-

NVIDIA BlueField DPU 和 DOCA 连获三奖,大放光彩2022-12-30 1085

-

NVIDIA BlueField DPU应用程序的不同编译方法2022-04-20 2968

-

在BlueField DPU上通过DOCA加速方案开发2022-04-14 2840

-

NVIDIA DOCA 软件可编程在 DPU 上运行的数据中心基础架构2021-12-29 2486

-

NVIDIA BlueField-2 DPU达到极高的 IOPS 性能2021-12-28 2482

-

NVIDIA推出基于 NVIDIA BlueField DPU 的 DOCA 1.2 软件框架2021-12-23 3023

-

NVIDIA BlueField-3,引领数据中心基础设施新潮2021-04-13 3029

全部0条评论

快来发表一下你的评论吧 !