深度学习可视化分析发展概览

电子说

描述

前言

深度学习由于对传统方法较为困难处理的问题有着十分优秀的解决,所以近年来在各个领域飞速发展。但由于内部的复杂性和网络中的非线性结构,人们对于深度神经网络取得高水平表现的潜在原因并不清晰,理解其中的决策过程也充满了挑战,对于网络的解读也充满了神秘。随着深度学习向各个领域的广泛渗透,我们需要为用户提供一种可以理解深度学习的工具,让人们可以明白网络何时在正确的工作,什么时候失效,同时也有助于提高算法的性能。

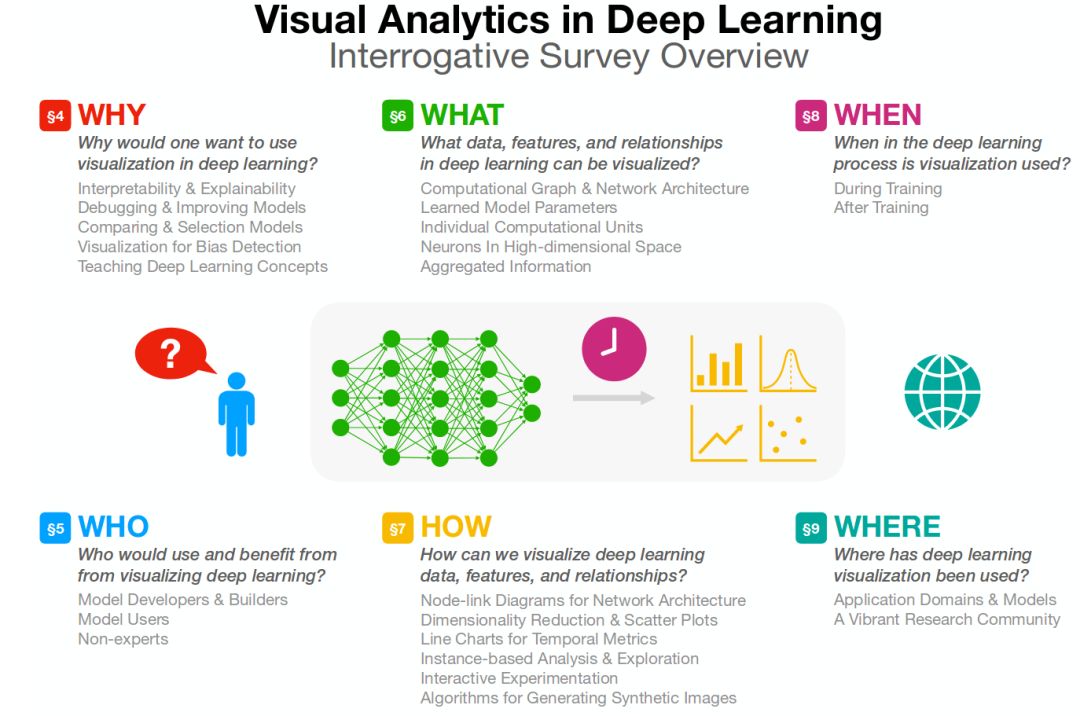

目前,标准化的神经网络工具箱让深度学习的构建变得十分容易,而今对于系统的可视化分析又在帮助着我们解释、解读、调整和改进网络。我们在这篇文章中呈现了目前对于深度学习可视化分析的方法,总结了先进的分析框架,主要集中在5w1h上(即why,who,what,how,when和where)来总结深度学习视觉分析方面的研究成果。同时,这篇论文还归纳了这一领域的研究方向和尚未解决的问题以供参考。这篇论文可以帮助深度学习和可视化分析领域的新研究者和从业者尽快的掌握这一年轻又迅速发展的领域以及其中的分类和范围。

深度学习的强大和迅速发展有目共睹,但这也带来了独特和全新的挑战,例如深度学习方法缺乏可解释性和透明性,从学习表象到潜在的决策过程缺乏可靠的有效解释是其中一个重要的问题。另外,对于模型构建者来说寻找对于特定模型误分类的数据或者行为还面临着挑战。

同样,终端用户在使用基于深度学习应用的app时对于其可靠性的疑虑还无从解决。尝试着解释神经网络是十分重要的,但深度学习同时还带来了一系列新的问题。例如:人工智能的安全性(例如用于自动驾驶)、模型的可信度、不透明的自动化决策过程、数据和模型内在的偏见,还有很多不一一列举。就像人们担心的一样,随着AI系统更加大规模和广泛的应用,这些问题只会变得越来越大,所以对于模型的理解不仅有益于深度学习的发展,更是这一领域所必须的方面来解决这些潜在的但影响重大的问题。

数据可视化和视觉分析通过将抽象的数据转换为形象的表现从而可以高效的发现数据的信息并凝练出知识。Zeiler和Fergus提出了一种影响深远的方法,这种称为解卷积神经网络的技术可以将模型习得的特征反投影到像素空间中去,可以让我们清晰的洞察深度网络的特定层习得了哪种类型的特征,同时可以作为一个提高模型性能的工具来使用。这一工作近年来在机器学习和计算机视觉领域流行起来,为人们理解和改进深度学习模型提供了方法和手段。但对于神经网络的可视化研究才刚刚开始。

人们发明了一系列的方法来帮助理解神经网络。其中一部分属于静态方法,例如图像分类中的注意力图和热力图方法,用于表明图像中的对于分类影响最大的部分。同时交互性方法在模型视觉分析理解中的引入增进了人们对于模型的洞察力。这一领域在学术界和工业界都在高速发展,造就了论文、研讨会、工具包等蓬勃发展。

在这篇文章中,作者总结了基于5W和H的深度学习可视化研究工作,具体见下图所示:

这篇论文提供了深度学习可视化和视觉分析领域全面、及时的总结,利用以人为本的疑问式框架来组织文章结构,给予5W和H的方面灵活但全面地总结出现有工作的贡献。利用这样的框架可以通俗化的讲解这一领域,让新近人员迅速掌握领域的研究现状,不仅为描述现有工作提供了框架,更为新工作提供了样本。

为了强调和整理视觉分析在深度学习各个方面的影响,本文聚焦于可视化分析,同时探讨了目前在人工智能、机器学习、深度学习、计算机视觉等方面的进展,同时还阐述了可视化如何作为帮助解决一些著名的现代AI问题,例如神经网络的可解释性、置信度和安全性等方面。

由于深度学习和AI触及生活生产的方方面面,本文还为总结出未来的研究方向和开放问题供研究人员参考,包括促进视觉分析系统对于神经网络的可解释性、对于这类系统有效性和可用性的评价指标、以人为中心的AI系统、AI应用的伦理性与适用范围等。

关于研究方法,为了总结目前这一领域的研究状况,作者选取了顶级的可视化和视觉分析领域的期刊、以及一系列深度学习的顶级会议、论坛、研讨会作为信息来源。同时为了保证信息的时效性,作者参考了预印本网站arXiv,同时还涵盖了一系列非学术资源以保证最前沿的信息获取,例如Distall,行业实验室和研究博客等等。

- 相关推荐

- 热点推荐

- 深度学习

-

可视化分布式系统的未来发展趋势2023-08-25 3227

-

什么样的数据分析软件能让全员自助可视化分析更丝滑?2022-09-22 51577

-

原始数据量大、质量参差不齐,能立即投入数据可视化分析吗?2021-11-02 1823

-

智能钻取功能对数据可视化分析效果的影响2021-10-09 949

-

盘点浏览者能做的自助式数据可视化分析2021-09-30 651

-

怎么结合园区地图做数据可视化分析?2021-07-01 9463

-

不懂技术的业务,该怎么做数据可视化分析?2021-06-30 6385

-

基于MVVM模式的气动数据可视化分析系统2021-06-23 706

-

大学生心理健康调查问卷数据可视化分析2021-06-07 1366

-

教育大数据可视化分析研究的综合分析2021-03-26 1214

-

大屏可视化报表也能自助分析了2021-02-06 4921

-

有了它,0基础也能做大屏可视化2020-12-24 1950

-

请问大屏的数据可视化分析报表怎么做?2020-09-08 2481

全部0条评论

快来发表一下你的评论吧 !