树莓派驱动的智能假肢:用眼感知,用心行走!

描述

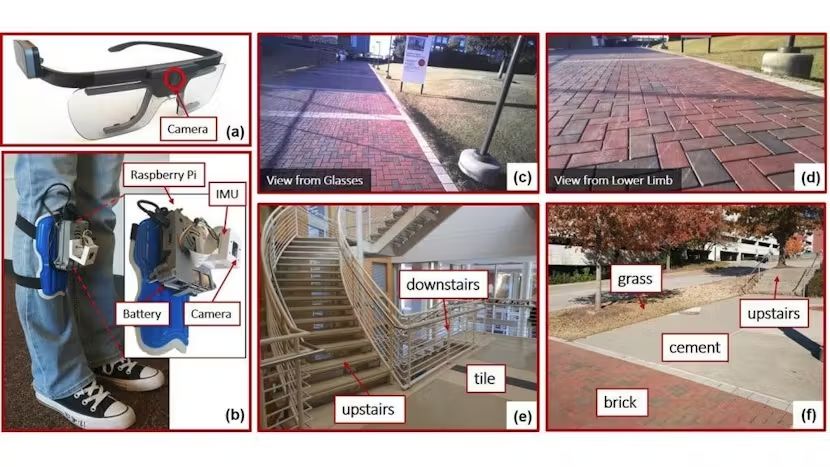

通过将摄像头安装在眼镜上或肢体本身,来使计算机视觉系统改善下肢假肢的运动能力。

研究团队测试了两套计算机视觉系统:一套佩戴于眼镜上,另一套则安装于腿部。

北卡罗来纳州立大学与北卡罗来纳大学教堂山分校的研究人员发布了一篇论文,阐述了如何借助计算机视觉技术——结合部分由树莓派驱动的预测机制——助力配备下肢机器人假肢的用户在不平整路面上更自然、更安全地行走。

论文作者之一、副教授Edgar Lobaton解释道:“下肢机器人假肢需根据用户所处地形执行不同动作。我们构建的框架能让假肢中的人工智能预测用户即将踏上的地形类型,量化与此预测相关的不确定性,并将这种不确定性纳入决策过程。”

为验证这一概念,研究团队打造了两套计算机视觉系统:一套集成于眼镜中,另一套则安装于下肢假肢上,围绕树莓派单板计算机、摄像头以及惯性测量单元(IMU)构建。论文摘要指出:“借助贝叶斯神经网络(BNNs),我们的框架能够量化由不同因素(如观测噪声、训练数据不足或存在偏差)引发的不确定性,并为在线决策生成经过校准的预测概率。”

“我们的框架在便携嵌入式系统上的推理时间每帧不到80毫秒。本研究成果或可推动在可靠决策、高效传感器融合以及各类应用中智能系统设计的创新上下文识别策略发展。”

论文共同作者Helen Huang补充道:“将计算机视觉技术融入可穿戴机器人控制软件是一个激动人心的新研究领域。我们发现,同时使用两个摄像头效果良好,但需要大量计算资源,成本可能也较高。不过,我们还发现仅使用安装于下肢的摄像头也能取得不错效果——特别是在短期预测方面,比如预测接下来一两步的地形情况。”

原文地址:

https://www.hackster.io/news/raspberry-pi-powered-computer-vision-system-calculates-uncertainty-to-make-robotic-prosthetics-safer-5e3dbc2a1391

-

树莓派分类器:用树莓派识别不同型号的树莓派!2025-06-13 1686

-

用 树莓派 Zero 打造的智能漫游车!2025-05-13 1397

-

树莓派控制步进电机2023-03-21 1027

-

树莓派教程 详解树莓派驱动OLED模块2022-05-06 8461

-

如何利用树莓派实现智能小车的四轮驱动?2021-10-19 2546

-

树莓派的学习设计方案合集2021-03-11 1810

-

使用树莓派制作HomeKit安防监控2020-05-30 4430

-

用树莓派制作一款口袋电脑2019-06-03 5384

-

我的天,桌子都变智能了!用树莓派做了个未来风书桌~2019-05-21 4443

-

树莓派怎么用2018-11-07 24835

-

树莓派驱动舵机介绍_树莓派驱动舵机代码2018-05-30 15176

-

树莓派用什么语言编程_树莓派python编程详解2018-01-15 39851

-

树莓派智能车AlphaBot系列教程2017-05-15 9090

-

树莓派2代安卓5.1.1用rtl8192cu无线驱动源码rpi22016-06-21 1705

全部0条评论

快来发表一下你的评论吧 !